gf_point(Thumb ~ Height, data = Fingers)10 Κεφάλαιο: Μοντέλα με μια Ποσοτική Ανεξάρτητη Μεταβλητή

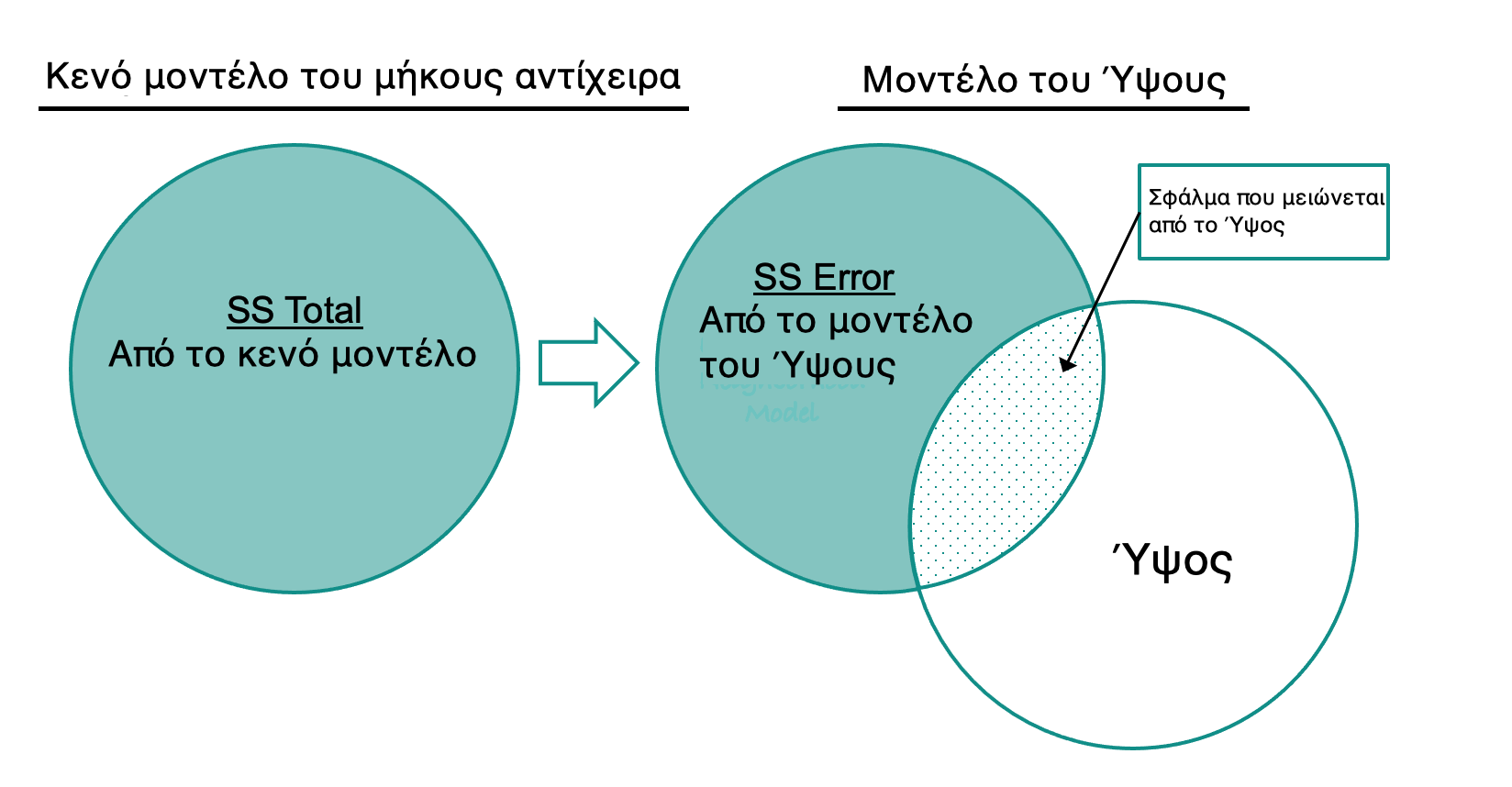

10.1 Χρήση Ποσοτικής Ανεξάρτητης Μεταβλητής σε ένα Μοντέλο

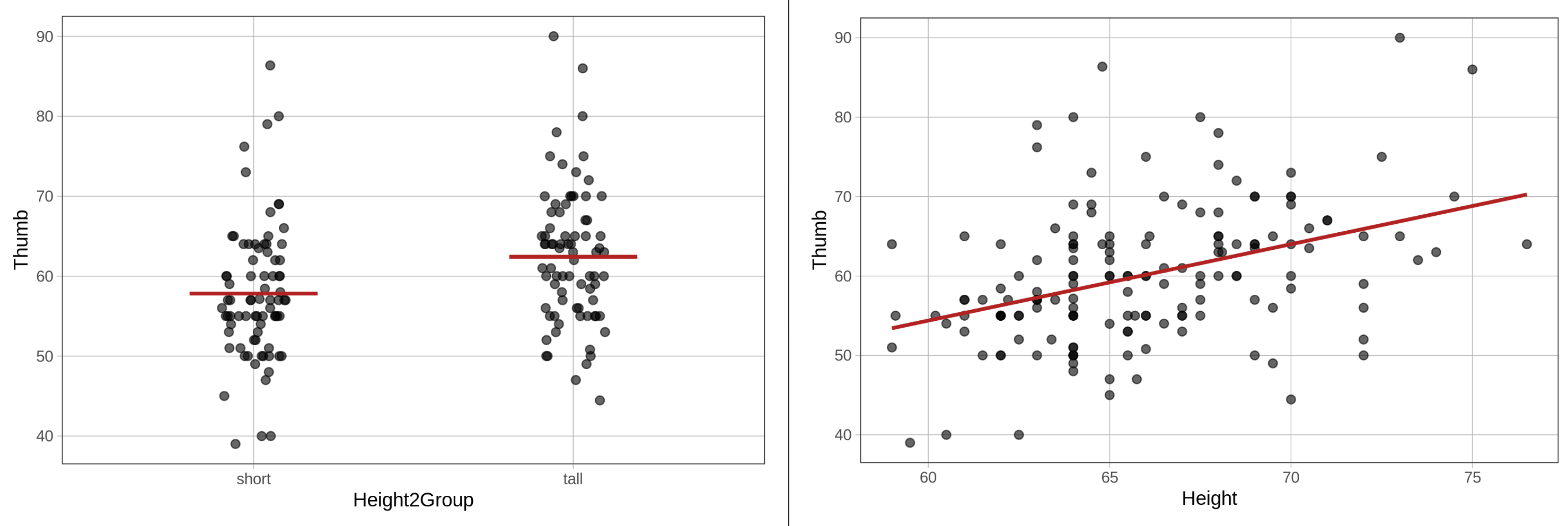

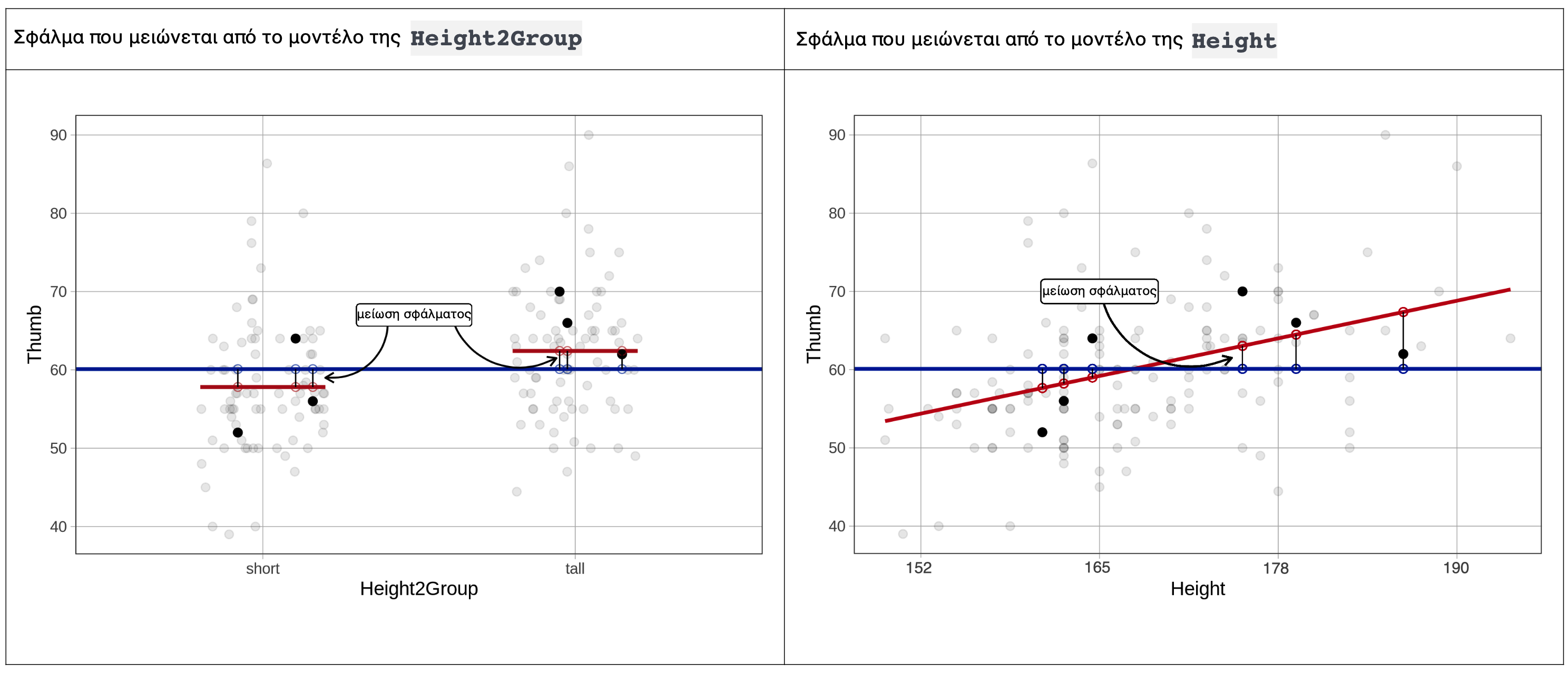

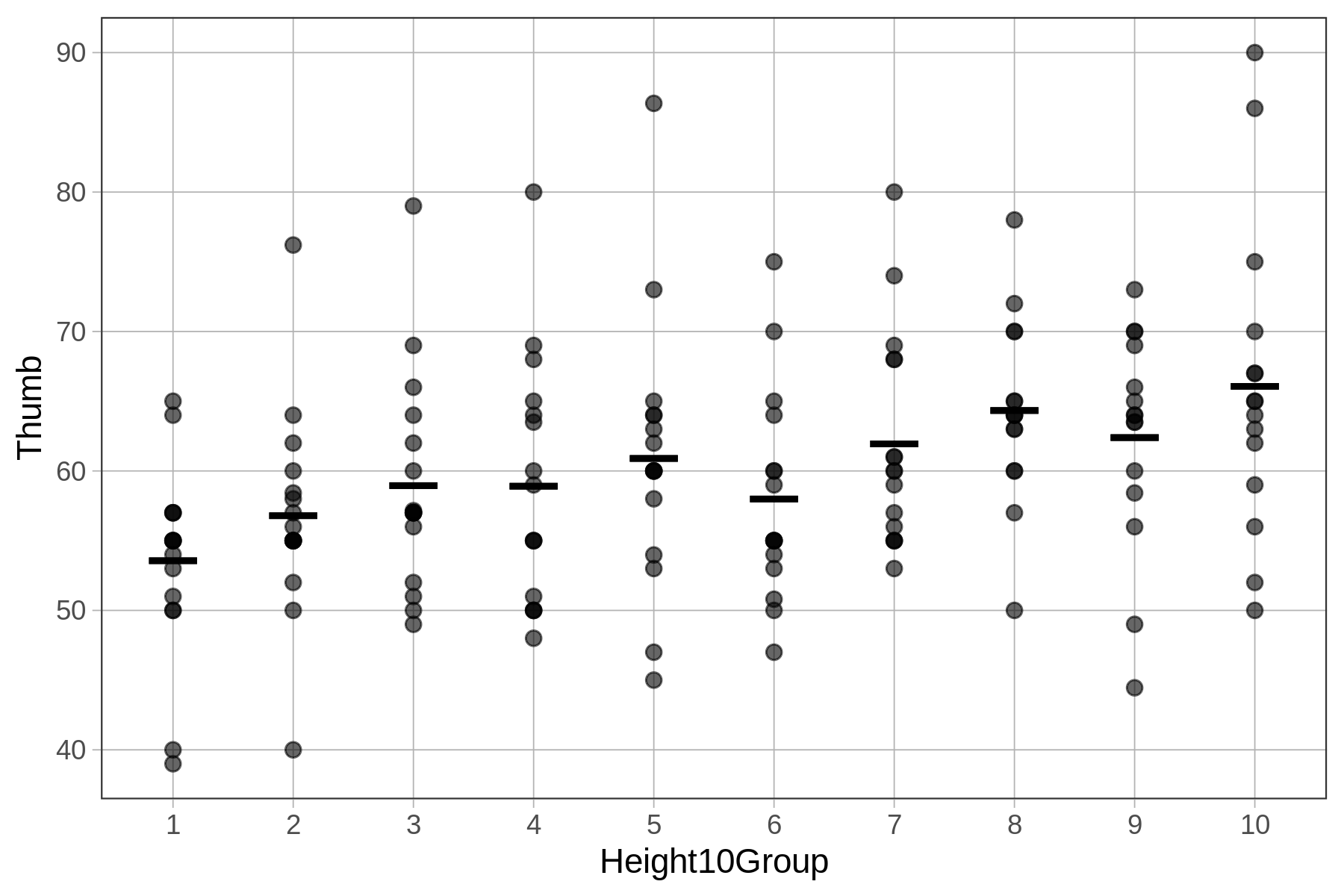

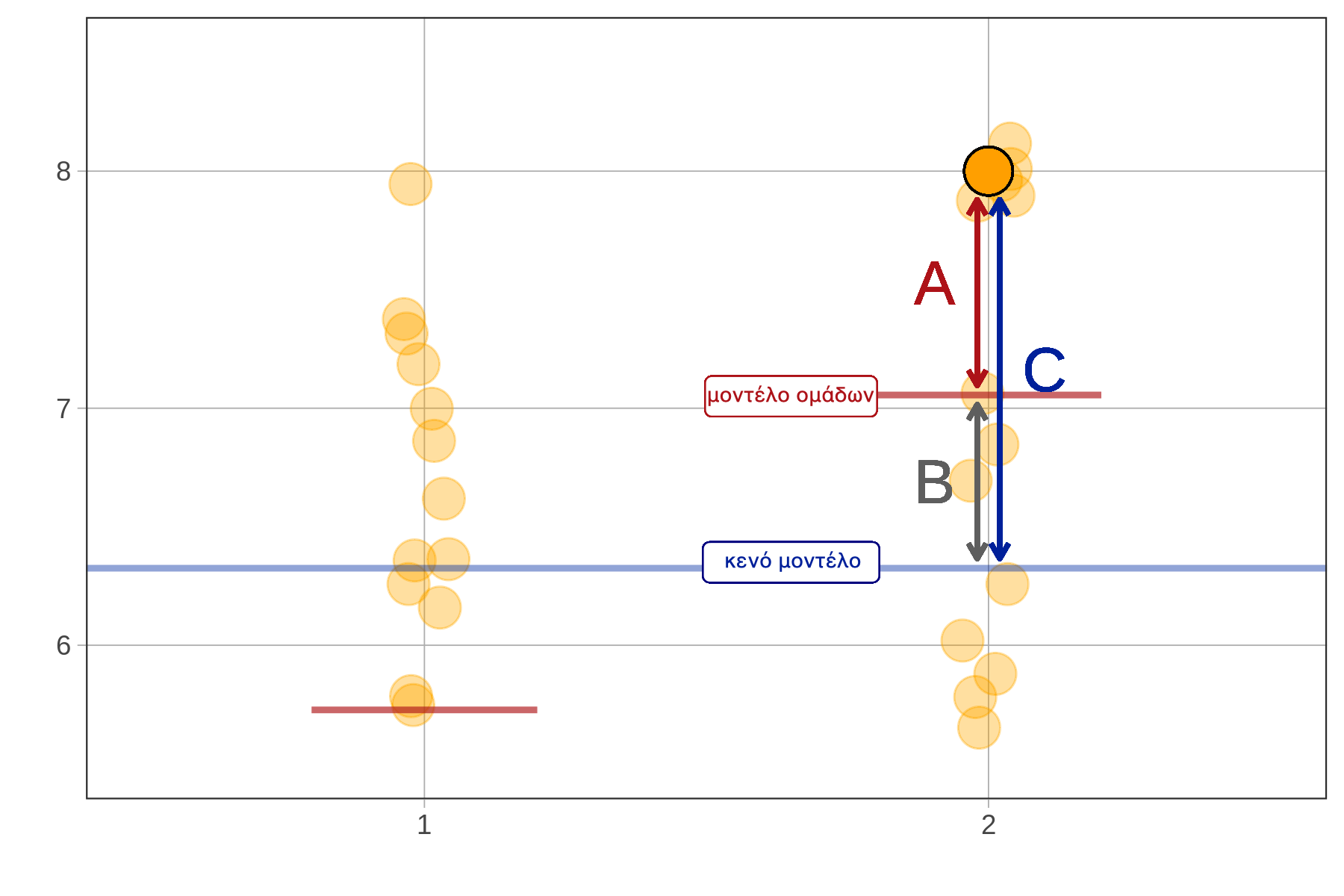

Η μεταβλητή Height2Group είναι ποιοτική. Το μοντέλο με ανεξάρτητη μεταβλητή τη Height2Group ονομάζεται μοντέλο ομάδων, καθώς στηρίζεται στους μέσους όρους των ομάδων για να προβλέψει το μήκος του αντίχειρα σε κάθε ομάδα (στην προκειμένη περίπτωση, «κοντοί» και «ψηλοί» φοιτητές).

Ωστόσο, δεν είναι όλα τα μοντέλα αυτού του τύπου. Όταν η ανεξάρτητη μεταβλητή είναι ποσοτική, απαιτείται μια διαφορετική προσέγγιση. Τα μοντέλα που περιλαμβάνουν ποσοτικές ανεξάρτητες μεταβλητές ονομάζονται συνήθως μοντέλα παλινδρόμησης (regression models).

Το Μοντέλο του Ύψους (Height)

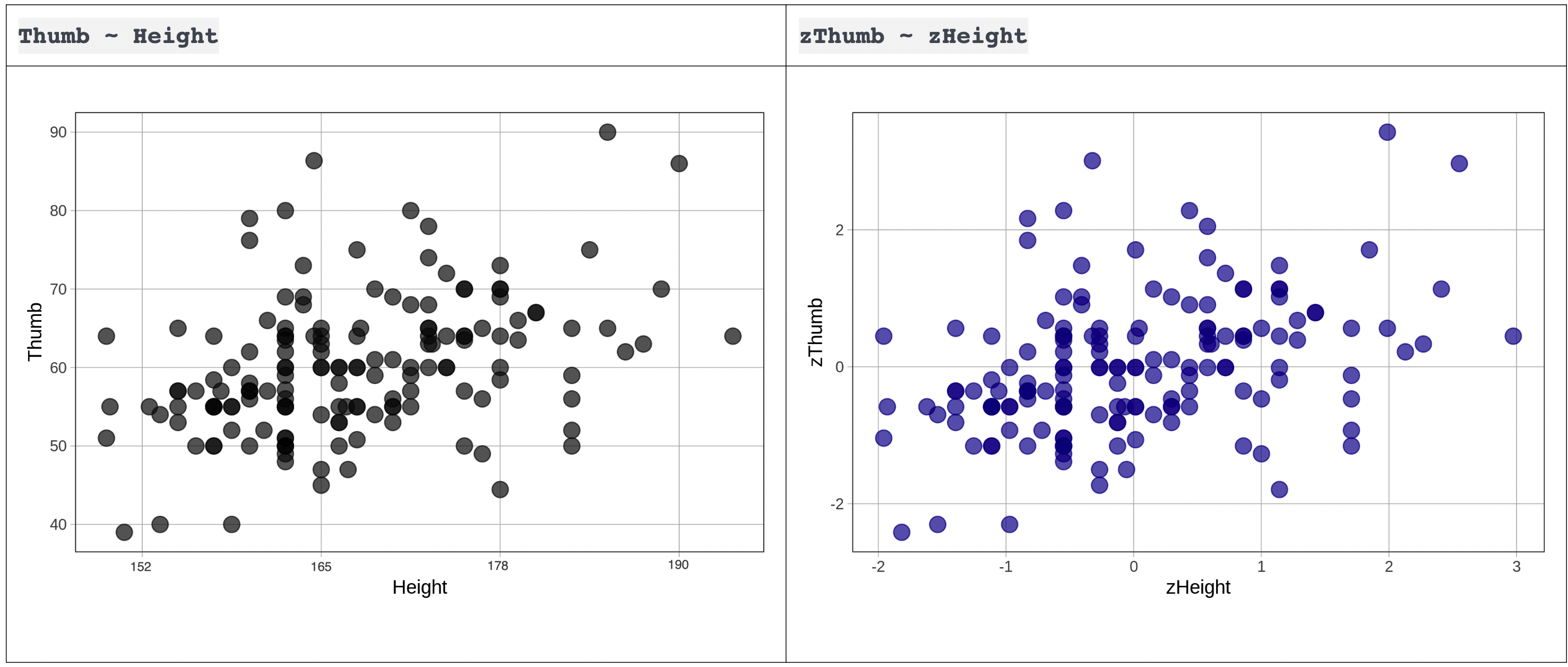

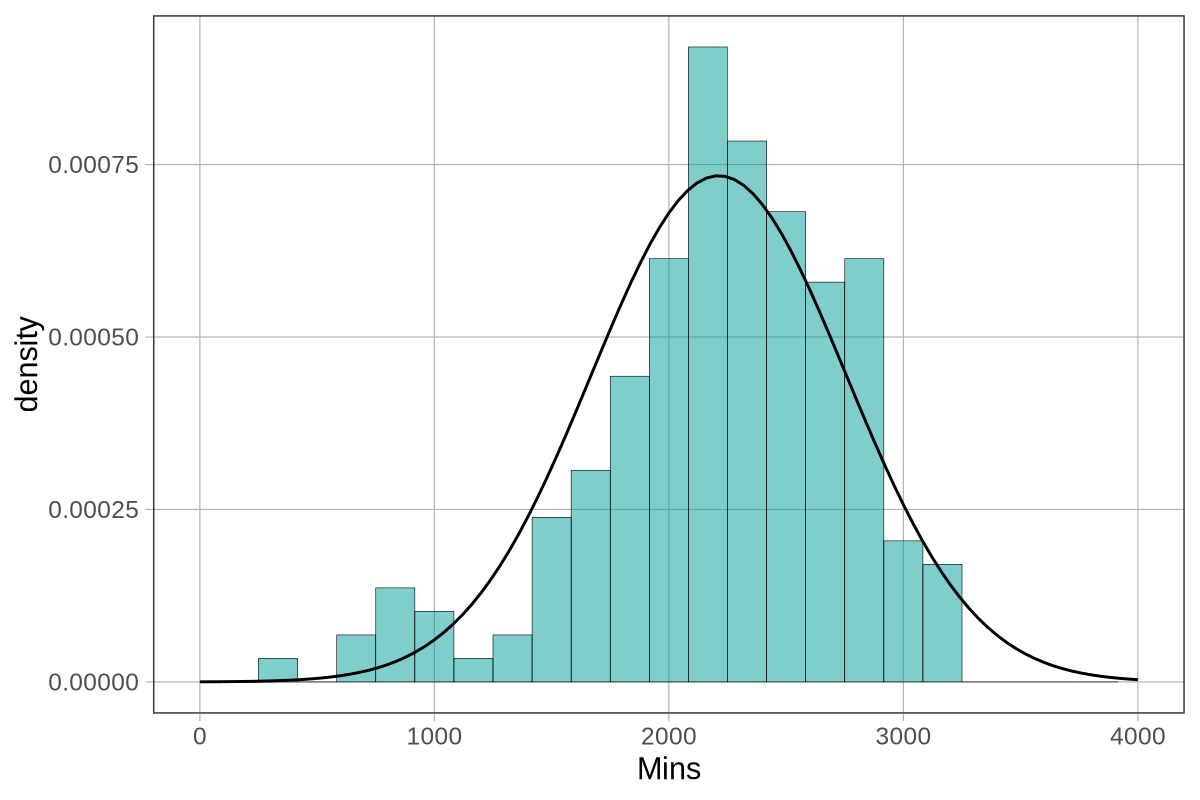

Μια ποσοτική μεταβλητή από το σύνολο δεδομένων Fingers, η οποία ενδέχεται να εξηγεί μέρος της μεταβλητότητας στο μήκος του αντίχειρα (Thumb), είναι η Height — το ύψος φοιτητή ή φοιτήτριας. (Σημείωση: η μεταβλητή Height μετριέται σε εκατοστά, ενώ η Thumb σε χιλιοστά.)

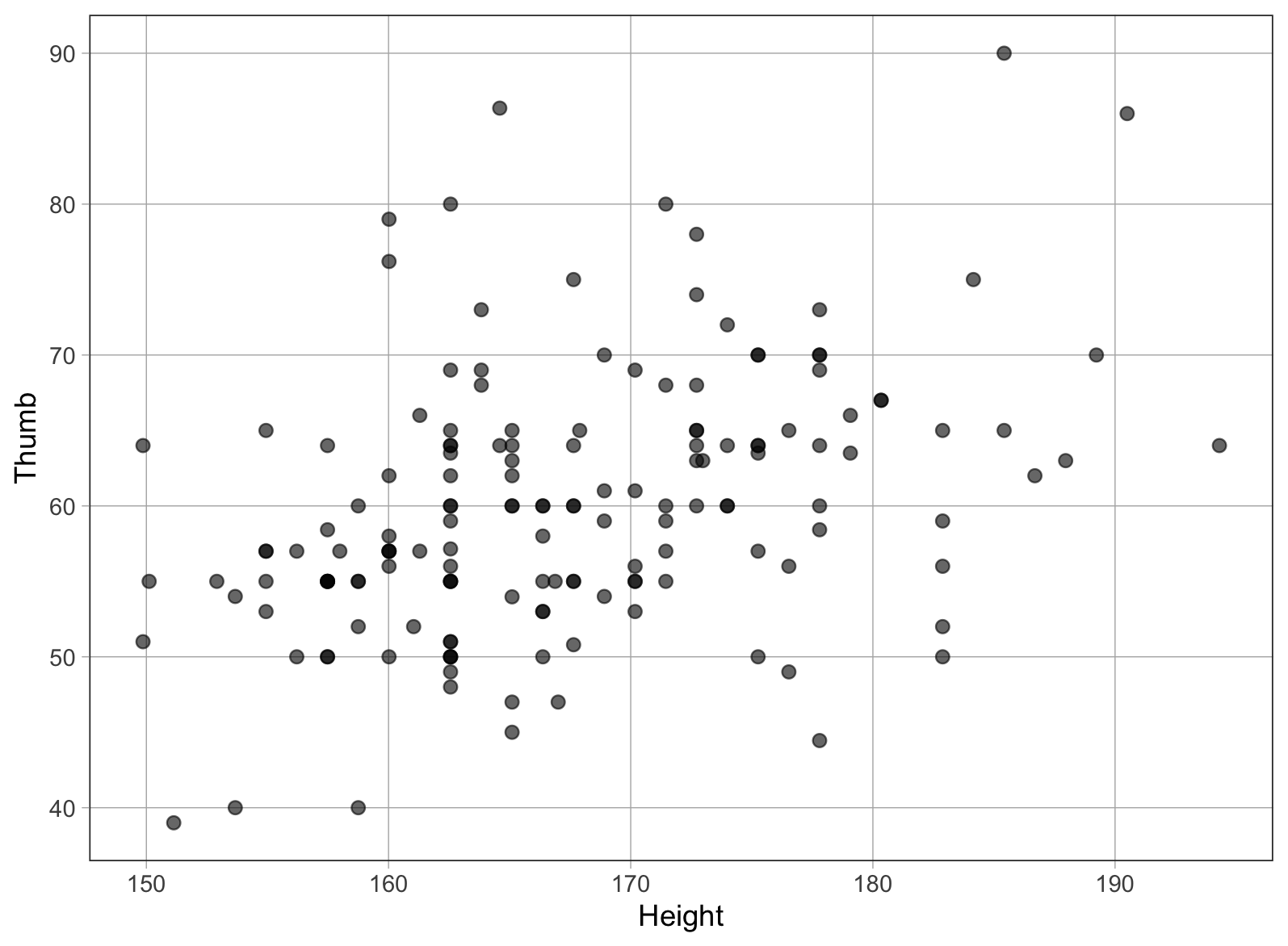

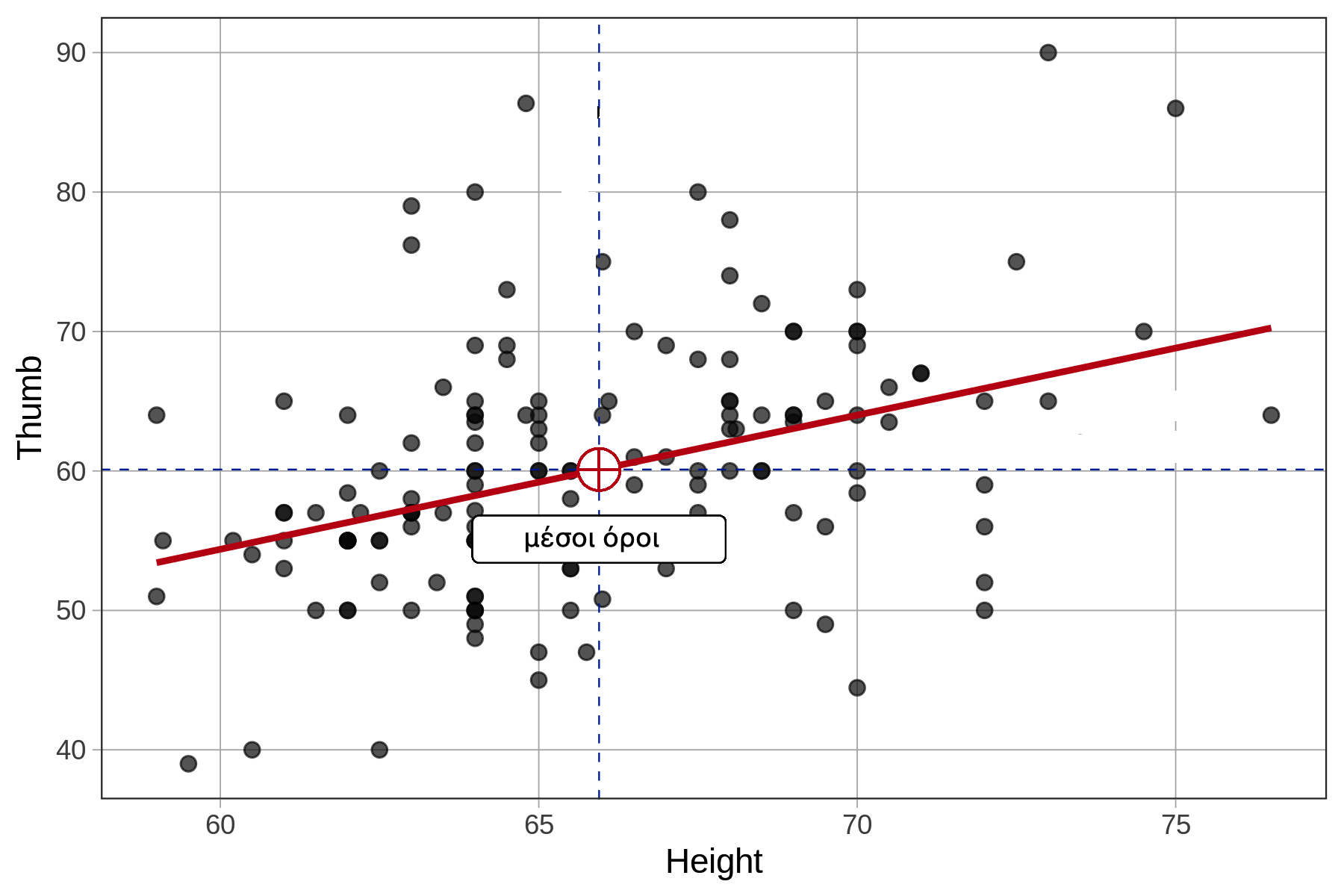

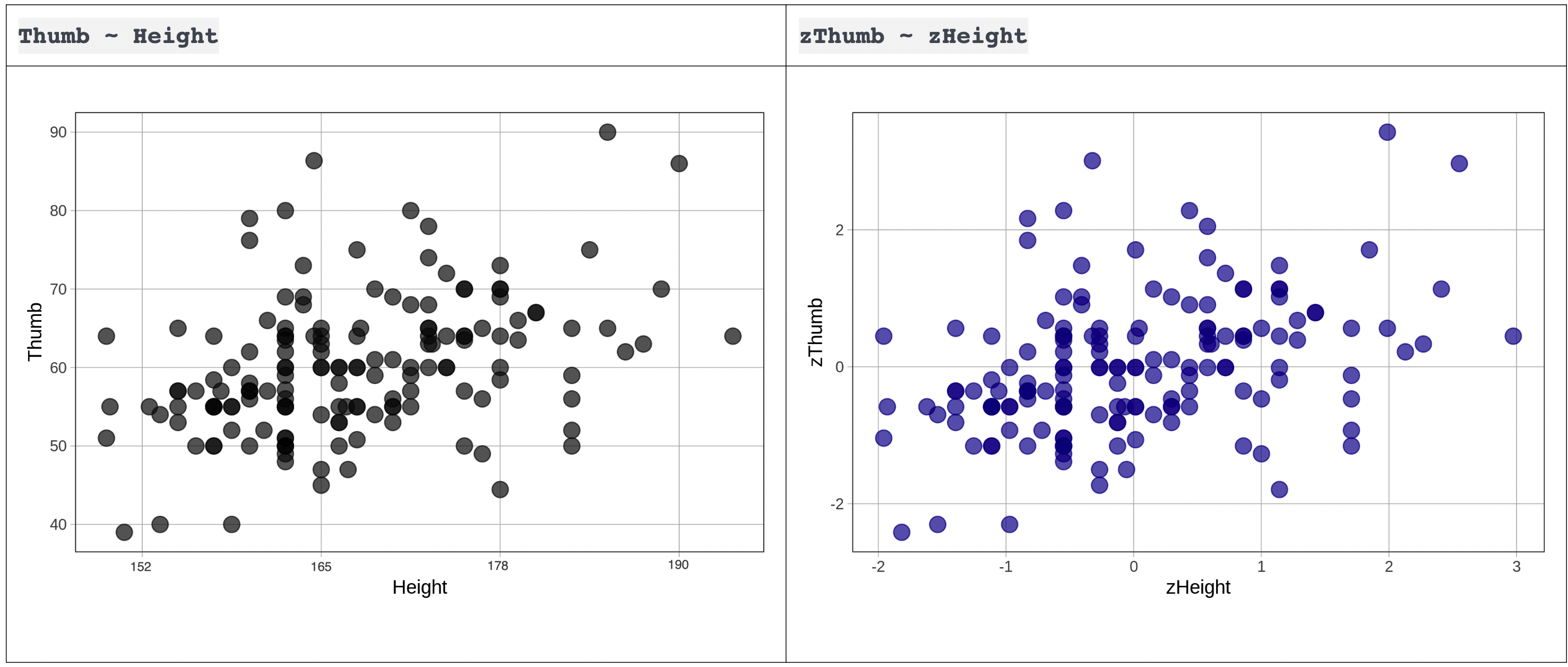

Σε προηγούμενο κεφάλαιο δημιουργήσαμε ένα διάγραμμα διασποράς που αναπαριστά τη σχέση μεταξύ των μεταβλητών Thumb και Height. Το επαναλαμβάνουμε παρακάτω:

Όπως φαίνεται, αν γνωρίζουμε το ύψος ενός ατόμου μπορούμε να κάνουμε πιο ακριβή πρόβλεψη για το μήκος του αντίχειρά του σε σχέση με το να μην είχαμε αυτή την πληροφορία. Τα ψηλότερα άτομα τείνουν να έχουν μεγαλύτερους αντίχειρες, ενώ τα κοντύτερα μικρότερους. Πρόκειται για μια θετική συσχέτιση, καθώς η αύξηση της μιας μεταβλητής συνοδεύεται από αύξηση της άλλης.

Αν θέλουμε να κάνουμε συγκεκριμένες προβλέψεις και να συγκρίνουμε ποσοτικά το μοντέλο της Height με άλλα μοντέλα, πρέπει να το μετατρέψουμε σε στατιστικό μοντέλο, όπως κάναμε και με το μοντέλο της Height2Group. Αυτή τη φορά, όμως, δεν μπορούμε να βασιστούμε σε μέσους όρους ομάδων — γιατί δεν υπάρχουν ομάδες! Αντί για αυτό, θα χρησιμοποιήσουμε μια ευθεία γραμμή, γνωστή ως ευθεία παλινδρόμησης (regression line), για να κάνουμε τις προβλέψεις.

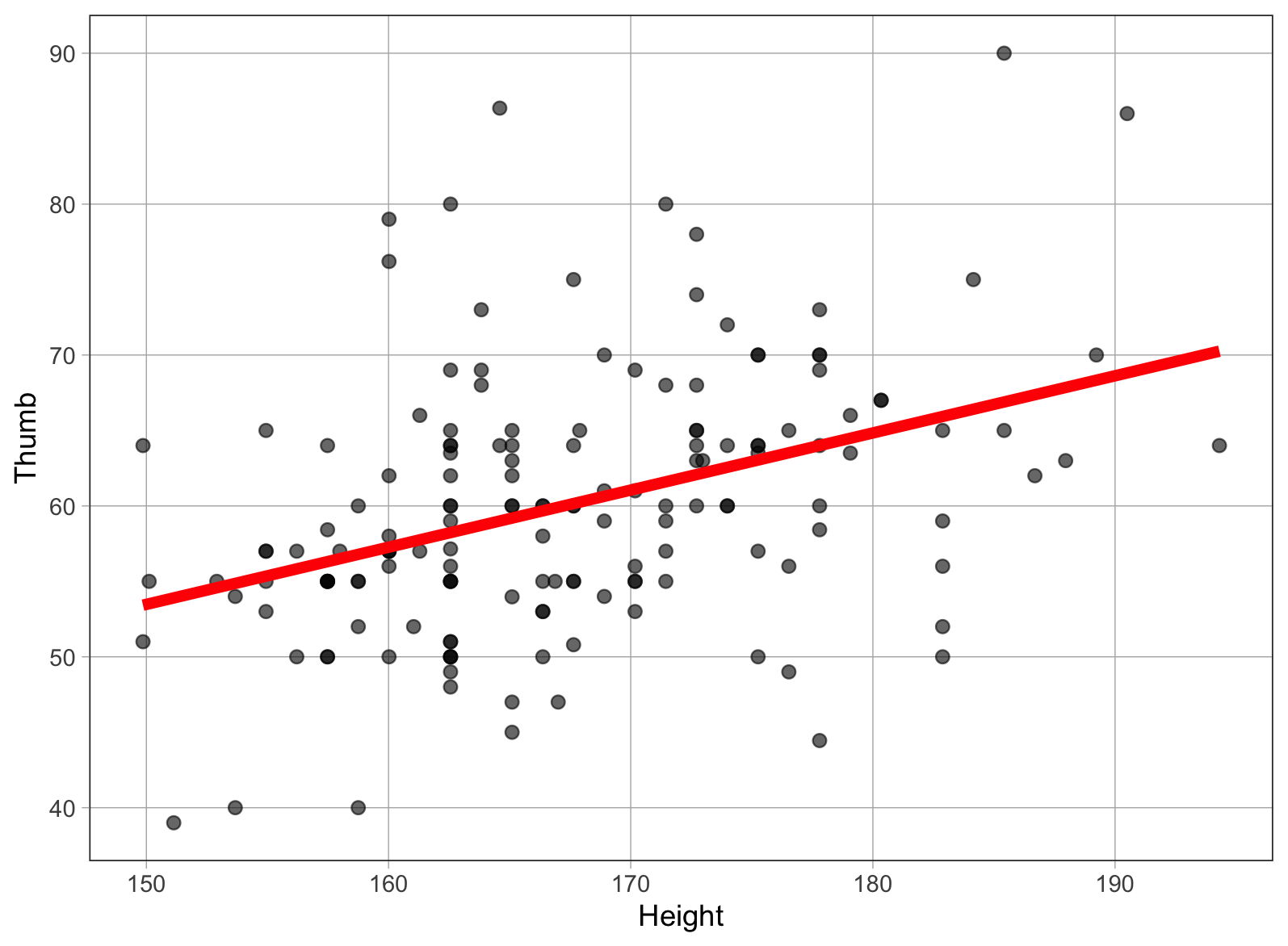

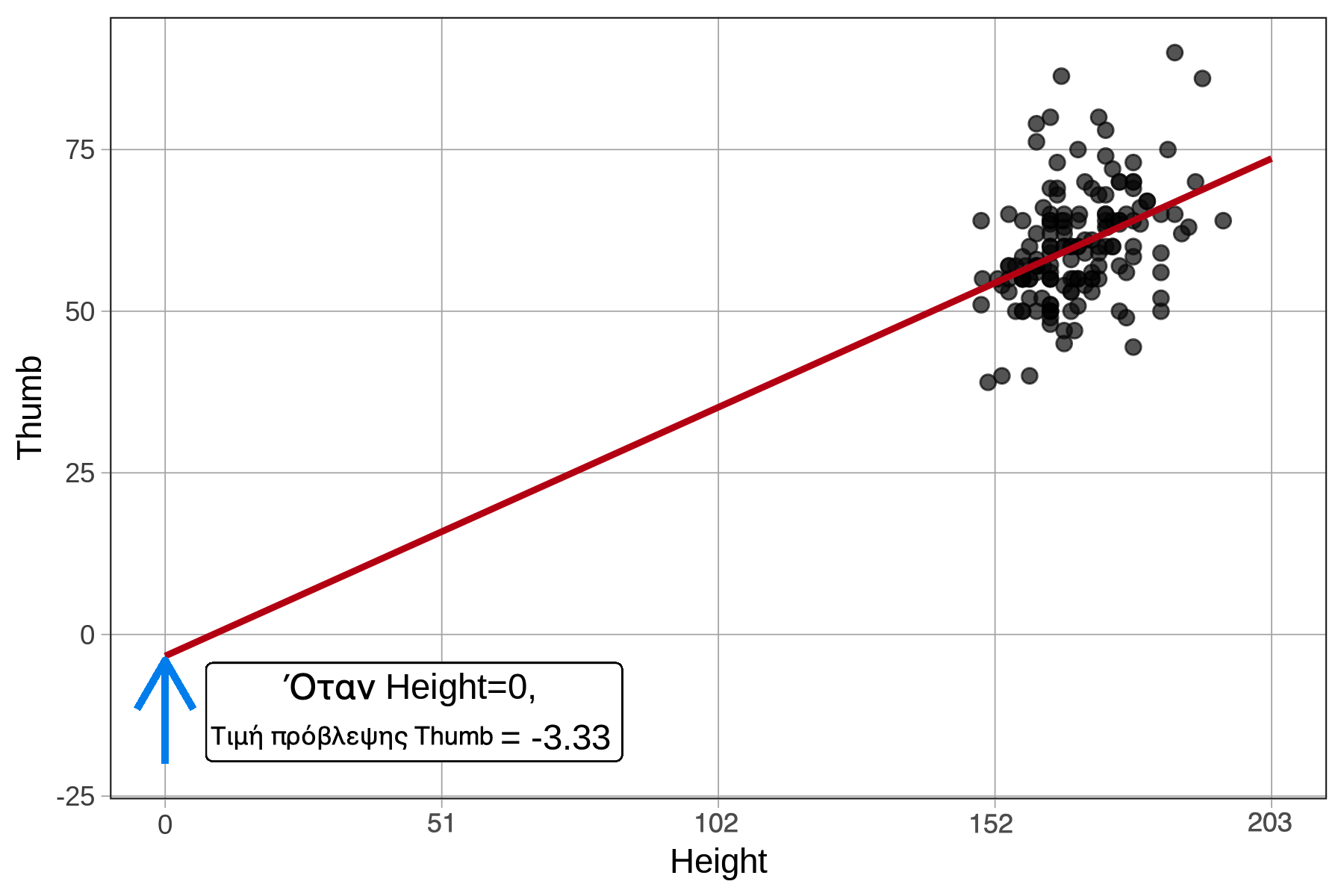

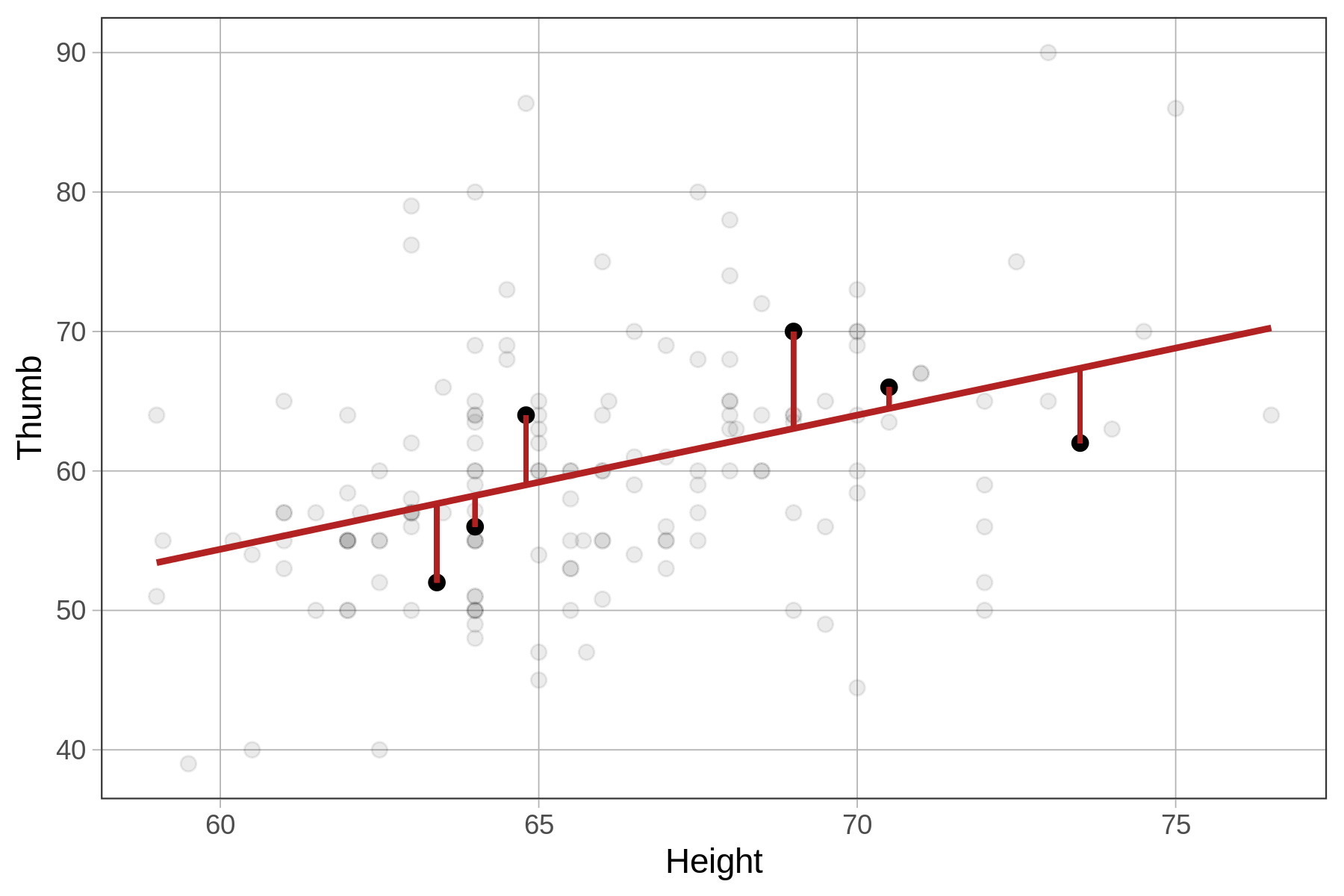

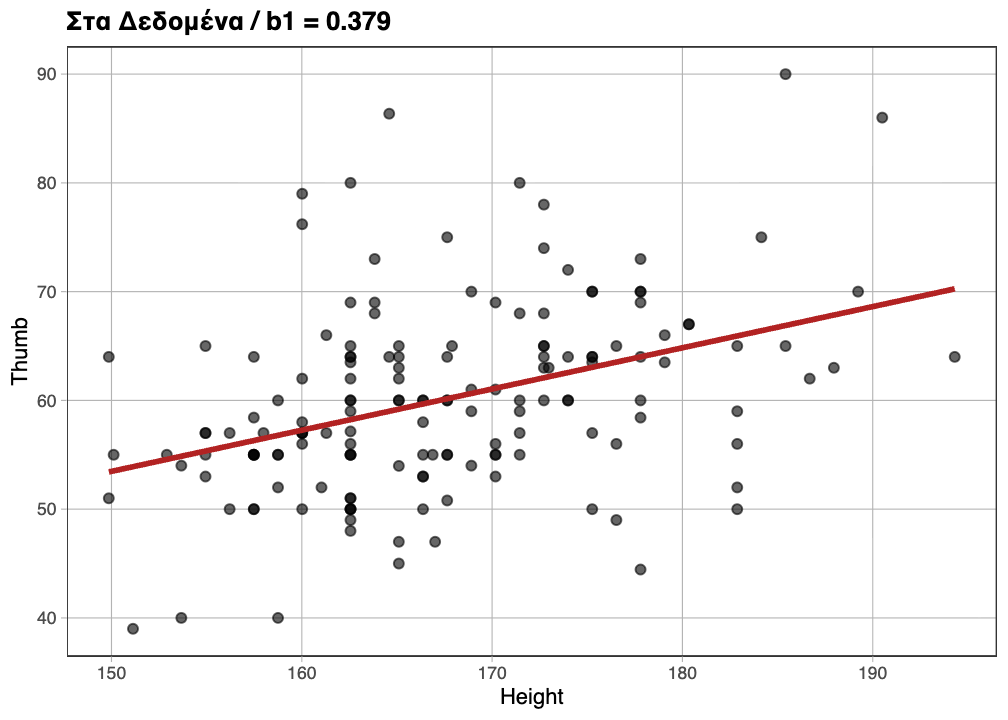

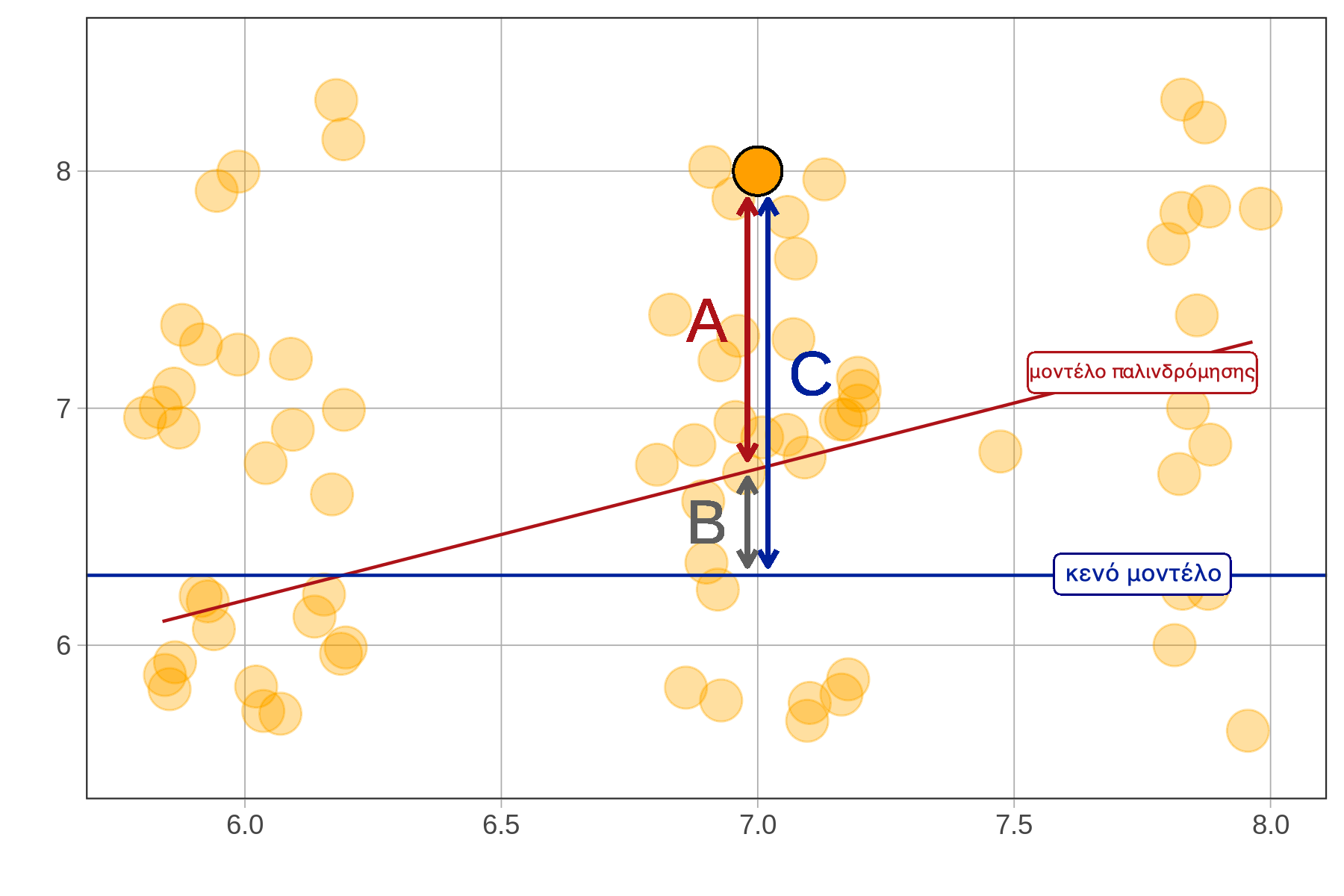

Η ευθεία παλινδρόμησης είναι ο απλούστερος τρόπος να περιγράψουμε τη σχέση μεταξύ δύο ποσοτικών μεταβλητών. Στο παρακάτω διάγραμμα έχουμε προσθέσει την ευθεία παλινδρόμησης. Η γραμμή αυτή δείχνει την τιμή πρόβλεψης του μήκους αντίχειρα ενός οποιουδήποτε ατόμου με βάση το ύψος του.

Θα δούμε στη συνέχεια πώς να προσαρμόζουμε ένα μοντέλο παλινδρόμησης με την R — δηλαδή πώς να βρίσκουμε τη μοναδική αυτή ευθεία που περιγράφει με τον καλύτερο δυνατό τρόπο τη σχέση μεταξύ δύο μεταβλητών. Πριν το κάνουμε αυτό, αξίζει να τονίσουμε ότι η ευθεία παλινδρόμησης δεν είναι μια τυχαία ευθεία, όπως ακριβώς ο μέσος όρος δεν είναι ένας τυχαίος αριθμός.

Όπως οι μέσοι όροι των ομάδων είναι εκείνες οι τιμές που ελαχιστοποιούν το άθροισμα τετραγώνων των υπολοίπων σε ένα μοντέλο ομάδων, έτσι και η ευθεία παλινδρόμησης είναι η μοναδική ευθεία — ορισμένη από την κλίση της και το σημείο τομής της με τον άξονα y — για την οποία τα υπόλοιπα είναι ισορροπημένα και το άθροισμα τετραγώνων των υπολοίπων ελαχιστοποιείται.

Ας δούμε πιο αναλυτικά τι σημαίνει αυτό.

Προβλέψεις από το Μοντέλο της Height

Για να προσαρμόσουμε το μοντέλο παλινδρόμησης με ανεξάρτητη μεταβλητή το ύψος (Height) θα χρησιμοποιήσουμε τη συνάρτηση lm() με τον ίδιο τρόπο όπως και στα μοντέλα ομάδων. Δεν χρειάζεται να δηλώσουμε στη R ότι πρόκειται για μοντέλο παλινδρόμησης — θα το αναγνωρίσει αυτόματα, επειδή η ανεξάρτητη μεταβλητή είναι ποσοτική.

Δίνεται παρακάτω η εντολή για την προσαρμογή του μοντέλου δύο ομάδων με την Height2Group ως ανεξάρτητη μεταβλητή:

Πώς θα την τροποποιήσουμε αν θέλουμε να χρησιμοποιήσουμε την Height αντί της Height2Group για να εξηγήσουμε τη μεταβλητότητα στην Thumb;

Σωστή απάντηση: Β - lm(Thumb ~ Height, data = Fingers)

Δομή της συνάρτησης lm():

Όπου:

Y = Εξαρτημένη μεταβλητή

X = Ανεξάρτητη μεταβλητή

dataset = Το όνομα του πλαισίου δεδομένων

Η σύνταξη διαβάζεται ως:

«Μοντελοποίησε την Y ως συνάρτηση της X χρησιμοποιώντας δεδομένα από το dataset.»

Τι αλλάζει στο ερώτημα;

Αρχικό μοντέλο:

Εξαρτημένη (Y):

Thumb(μήκος αντίχειρα)Ανεξάρτητη (X):

Height2Group(ποιοτική:short/tall)Πλαίσιο δεδομένων:

Fingers

Νέο μοντέλο (ζητούμενο):

Εξαρτημένη (Y):

Thumb(ίδια! ✓)Ανεξάρτητη (X):

Height(ποσοτική/συνεχής μεταβλητή)Δεδομένα:

Fingers(ίδιο! ✓)

Τι αλλάζει: Μόνο η ανεξάρτητη μεταβλητή (από Height2Group σε Height)

Τι παραμένει ίδιο: - Η εξαρτημένη μεταβλητή (Thumb)

- Το πλαίσιο δεδομένων (

Fingers)

Διαφορά μεταξύ Height2Group και Height

Height2Group (ποιοτική μεταβλητή):

Τύπος:

Factorμε 2 επίπεδα (short,tall)Μοντέλο: \(\text{Thumb}_i = b_0 + b_1 \times \text{Height2Group}_{\text{tall},i}\)

Ερμηνεία: Διαφορά μέσων όρων μεταξύ ομάδων

Height (ποσοτική μεταβλητή):

Τύπος: Αριθμητική μεταβλητή (numeric)

Τιμές: Ύψος σε cm (π.χ., 165, 170, 175, …)

Μοντέλο: \(\text{Thumb}_i = b_0 + b_1 \times \text{Height}_i\)

Γιατί οι άλλες είναι λάθος;

Α. lm(Height ~ Height2Group, data = Fingers) - ΛΑΘΟΣ

Αυτό αντιστρέφει την εξαρτημένη και ανεξάρτητη μεταβλητή

Μοντελοποιεί την

Height(ύψος) ως εξαρτημένηΧρησιμοποιεί την

Height2Groupως ανεξάρτητη

Τι μοντελοποιεί:

«Πρόβλεψη του ύψους από την ομάδα ύψους»

Το ζητούμενο:

«Πρόβλεψη του μήκους αντίχειρα από το ύψος»

Σύγκριση:

| Στοιχείο | Επιλογή Α | Ζητούμενο |

|---|---|---|

| Εξαρτημένη (Y) | Height ✗ | Thumb ✓ |

| Ανεξάρτητη (X) | Height2Group | Height |

| Πλαίσιο δεδομένων | Fingers ✓ | Fingers ✓ |

Γ. lm(Thumb ~ Height2Group, data = Height) - ΛΑΘΟΣ

Αυτό αλλάζει το πλαίσιο δεδομένων από

FingersσεHeightΤο

Heightδεν είναι πλαίσιο δεδομένων - είναι μεταβλητή!Θα προκαλέσει σφάλμα στην R:

lm(Thumb ~ Height2Group, data = Height)

# Error: object 'Height' not found

# (Εκτός αν υπάρχει πλαίσιο δεδομένων με όνομα "Height")Σύγχυση:

Height(μεταβλητή) ≠Fingers(πλαίσιο δεδομένων)Το

data =χρειάζεται το όνομα του πλαισίου δεδομένων, όχι μεταβλητής

Δ. lm(Height ~ Thumb, data = Fingers) - ΛΑΘΟΣ

Αυτό αντιστρέφει πλήρως το μοντέλο

Μοντελοποιεί την

Heightως εξαρτημένηΧρησιμοποιεί την

Thumbως ανεξάρτητη

Τι μοντελοποιεί:

«Πρόβλεψη του ύψους από το μήκος αντίχειρα»

Το ζητούμενο:

«Πρόβλεψη του μήκους αντίχειρα από το ύψος»

Σύγκριση:

| Στοιχείο | Επιλογή Δ | Ζητούμενο |

|---|---|---|

| Εξαρτημένη (Y) | Height ✗ | Thumb ✓ |

| Ανεξάρτητη (X) | Thumb ✗ | Height ✓ |

| Πλαίσιο δεδομένων | Fingers ✓ | Fingers ✓ |

Συμπέρασμα

Για να αλλάξουμε από Height2Group σε Height:

Αντικαθιστούμε μόνο την ανεξάρτητη μεταβλητή (δεξιά του ~)

Σωστή απάντηση:

Γιατί:

✓ Η Thumb παραμένει η εξαρτημένη - αυτό που προβλέπουμε

✓ Η Height γίνεται η νέα ανεξάρτητη - αντί για την Height2Group

✓ Το Fingers παραμένει το σύνολο δεδομένων

Χρησιμοποιήστε το παρακάτω πλαίσιο κώδικα για να προσαρμόσετε το μοντέλο της Height με τη συνάρτηση lm() και αποθηκεύστε το αποτέλεσμα σε ένα αντικείμενο με όνομα Height_model. Έπειτα, προσθέστε κώδικα που θα δημιουργεί τις τιμές πρόβλεψης του μοντέλου και θα τις αποθηκεύει ως νέα στήλη στο πλαίσιο δεδομένων Fingers. (Υπόδειξη: χρησιμοποιήστε τη συνάρτηση predict() για να δημιουργήσετε τις προβλέψεις.)

Thumb Height Height_predict

1 66.00 179.070 64.48330

2 64.00 164.592 59.00056

3 56.00 162.560 58.23105

4 58.42 177.800 64.00235

5 74.00 172.720 62.07859

6 60.00 172.720 62.07859Ας εξετάσουμε τις τιμές πρόβλεψης του μοντέλου της

Height(παραπάνω).Με ποιον τρόπο αυτές οι τιμές πρόβλεψης διαφέρουν από τις τιμές πρόβλεψης που παράγει το μοντέλο της

Height2Group;

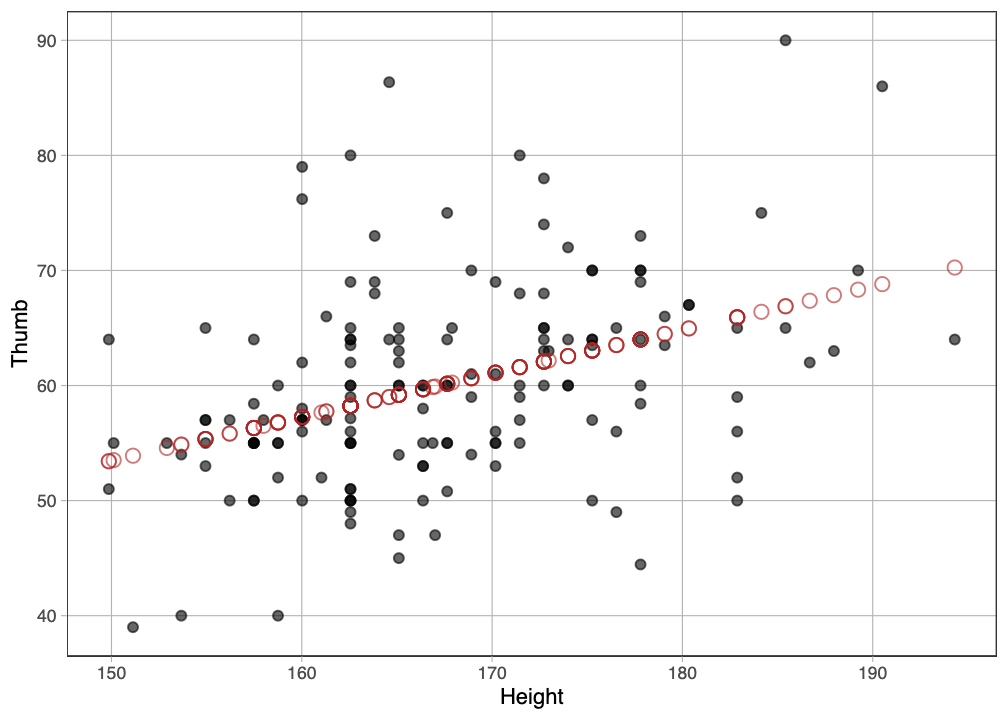

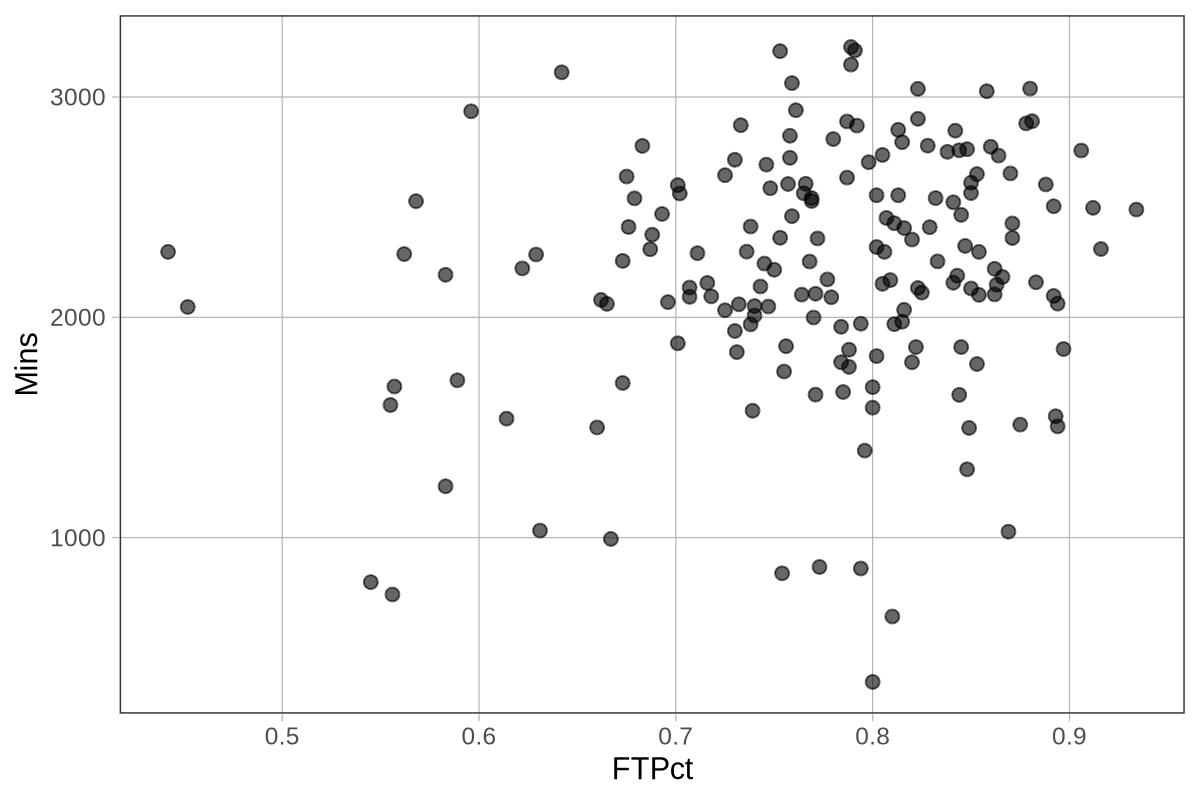

Εκτελέσαμε τον παρακάτω κώδικα για να προβάλλουμε στο αρχικό διάγραμμα διασποράς τις τιμές πρόβλεψης του μοντέλου της Height. Οι τιμές πρόβλεψης εμφανίζονται με κόκκινους κύκλους, κάτι που επιτύχαμε προσθέτοντας τα κατάλληλα ορίσματα για το σχήμα και το χρώμα στη συνάρτηση gf_point().

Fingers$prediction <- predict(Height_model)

gf_point(Thumb ~ Height, data = Fingers) %>%

gf_point(prediction ~ Height, shape = 1, size = 3, color = "firebrick") Κάθε τιμή της μεταβλητής

Κάθε τιμή της μεταβλητής Height (π.χ. 162.56, 172.72, 177.8) στο σύνολο δεδομένων αντιστοιχεί σε μια μοναδική τιμή πρόβλεψης του μοντέλου — που αναπαρίσταται με κόκκινο κύκλο. Παρατηρήστε ότι όλες οι προβλέψεις σχηματίζουν μια ευθεία γραμμή. Αυτό δεν είναι τυχαίο! Συμβαίνει επειδή οι προβλέψεις προέρχονται από την ευθεία παλινδρόμησης που προσαρμόστηκε στα δεδομένα μέσω της lm().

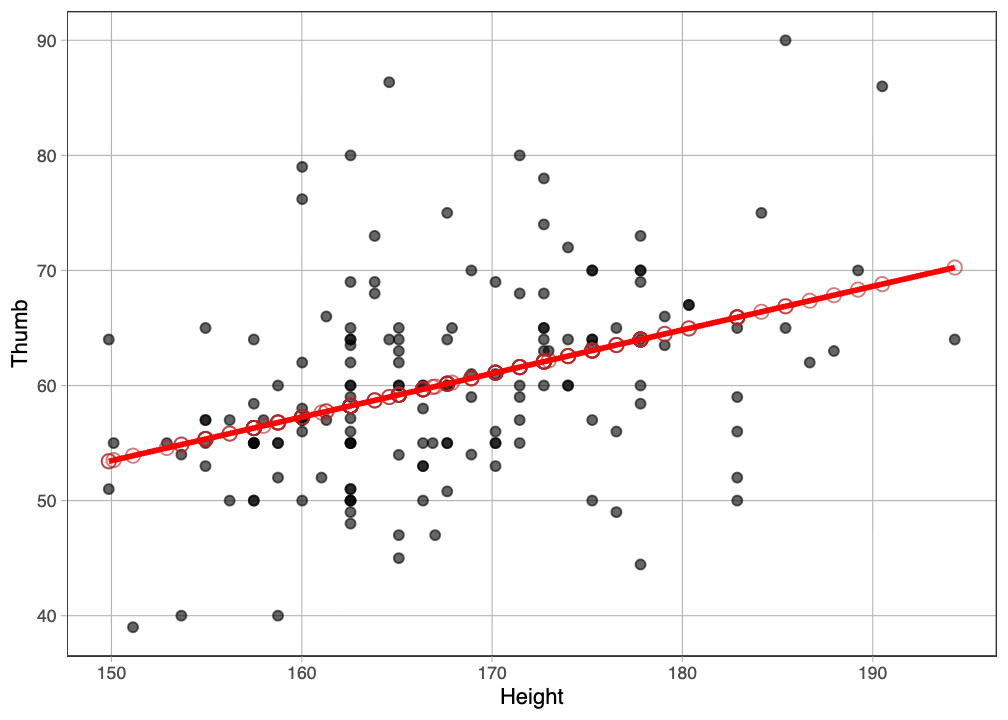

Αν προσθέσουμε τη συνάρτηση gf_model() στο διάγραμμα διασποράς, η καλύτερα προσαρμοσμένη ευθεία του μοντέλου θα συμπέσει ακριβώς με τις τιμές πρόβλεψης (τους κόκκινους κύκλους).

gf_point(Thumb ~ Height, data = Fingers) %>%

gf_point(prediction ~ Height, shape = 1, size = 3, color = "firebrick") %>%

gf_model(Height_model, color = "red") Σημειώστε ότι υπάρχουν δύο βασικοί τρόποι για να προβάλετε ένα μοντέλο παλινδρόμησης σε ένα διάγραμμα διασποράς. Ο πρώτος τρόπος είναι με τη χρήση της συνάρτησης

Σημειώστε ότι υπάρχουν δύο βασικοί τρόποι για να προβάλετε ένα μοντέλο παλινδρόμησης σε ένα διάγραμμα διασποράς. Ο πρώτος τρόπος είναι με τη χρήση της συνάρτησης gf_model(), η οποία απαιτεί να καθορίσουμε ρητά το μοντέλο που θέλουμε να εμφανίσουμε στο διάγραμμα (π.χ. gf_model(Height_model)). Το πλεονέκτημα της gf_model() είναι ότι μπορεί να χρησιμοποιηθεί τόσο για μοντέλα ομάδων όσο και για μοντέλα παλινδρόμησης.

Ο δεύτερος τρόπος είναι να προσθέσουμε τη συνάρτηση gf_lm() στο διάγραμμα διασποράς. Αυτή η συνάρτηση δεν χρειάζεται να της δοθεί κάποιο μοντέλο — το υπολογίζει αυτόματα με βάση τα δεδομένα του διαγράμματος. Ωστόσο, μπορεί να χρησιμοποιηθεί μόνο για μοντέλα παλινδρόμησης.

10.2 Προσδιορισμός του Μοντέλου της Height με τη Σημειογραφία του GLM

Ας δούμε πώς μπορούμε να περιγράψουμε ένα μοντέλο παλινδρόμησης όταν η ανεξάρτητη μεταβλητή είναι ποσοτική (όπως η Height):

\[Y_i = b_0 + b_1X_i + e_i\]

Μπορούμε τώρα να συγκρίνουμε αυτήν την εξίσωση με εκείνη που χρησιμοποιήσαμε στο προηγούμενο κεφάλαιο, όταν το μοντέλο αφορούσε δύο ομάδες (όπως στην περίπτωση της Height2Group):

\[Y_i = b_0 + b_1X_i + e_i\]

Ποια είναι η διαφορά στη σημειογραφία του GLM ανάμεσα σε αυτά τα δύο μοντέλα;

Παρατηρούμε ότι η εξίσωση είναι ίδια και στις δύο περιπτώσεις. Αυτή η ομοιότητα δεν είναι τυχαία· αποτελεί βασικό χαρακτηριστικό του Γενικού Γραμμικού Μοντέλου (General Linear Model).

Το GLM παρέχει ένα ενιαίο μαθηματικό πλαίσιο που μπορεί να περιγράψει τόσο μοντέλα με ποιοτικές ανεξάρτητες μεταβλητές (όπως ομάδες ή κατηγορίες) όσο και μοντέλα με ποσοτικές μεταβλητές (όπως μετρήσεις ή τιμές). Αυτό το καθιστά ένα ευέλικτο και ισχυρό εργαλείο για την ανάλυση δεδομένων σε πολλές διαφορετικές περιπτώσεις.

Αν και και τα δύο μοντέλα εκφράζονται με την ίδια εξίσωση, η ερμηνεία της διαφέρει ανάλογα με το είδος της ανεξάρτητης μεταβλητής και το πλαίσιο στο οποίο εφαρμόζεται.

Όπως είδαμε, και τα δύο μοντέλα, Height2Group και Height, μπορούν να αναπαρασταθούν με την ίδια εξίσωση του GLM: \(Y_i = b_0 + b_1X_i + e_i\).

Ποιο μέρος της εξίσωσης αντιπροσωπεύει την εξαρτημένη μεταβλητή (Thumb) και στα δύο μοντέλα;

Σωστή απάντηση: Α — Το \(Y_i\) αντιπροσωπεύει την εξαρτημένη μεταβλητή και στα δύο μοντέλα.

Ανάλυση της σημειογραφίας του GLM

Στο Γενικό Γραμμικό Μοντέλο (GLM), η εξίσωση \(Y_i = b_0 + b_1X_i + e_i\) περιλαμβάνει τα εξής στοιχεία:

- \(Y_i\): Η εξαρτημένη μεταβλητή — αυτό που προσπαθούμε να προβλέψουμε ή να εξηγήσουμε

- \(X_i\): Η ανεξάρτητη μεταβλητή — αυτό που χρησιμοποιούμε για την πρόβλεψη

- \(b_0\): Ο σταθερός όρος (intercept) — η τιμή του \(Y_i\) όταν \(X_i = 0\)

- \(b_1\): Ο συντελεστής κλίσης (slope) — η μεταβολή στο \(Y_i\) για κάθε μονάδα αύξησης του \(X_i\)

- \(e_i\): Το σφάλμα — η διαφορά μεταξύ της παρατηρούμενης τιμής και της τιμής πρόβλεψης

Εφαρμογή στα δύο μοντέλα

Και στα δύο μοντέλα (Height2Group και Height), η μεταβλητή Thumb είναι η εξαρτημένη μεταβλητή:

-

Μοντέλο της

Height2Group: Προβλέπουμε το μήκος αντίχειρα (\(Y_i\)) με βάση την ομάδα ύψους (short/tall) -

Μοντέλο της

Height: Προβλέπουμε το μήκος αντίχειρα (\(Y_i\)) με βάση το συνεχές ύψος

Και στις δύο περιπτώσεις, η Thumb αναπαρίσταται από το \(Y_i\) στην εξίσωση.

Γιατί οι άλλες επιλογές είναι λάθος

Β. «\(X_i\)» — ΛΑΘΟΣ

- Το \(X_i\) αντιπροσωπεύει την ανεξάρτητη μεταβλητή.

- Στο μοντέλο της

Height2Group, το \(X_i\) είναι η ομάδα ύψους (short/tall). - Στο μοντέλο της

Height, το \(X_i\) είναι το συνεχές ύψος. - Δεν είναι η εξαρτημένη μεταβλητή που προσπαθούμε να προβλέψουμε.

Γ. «\(e_i\)» — ΛΑΘΟΣ

- Το \(e_i\) αντιπροσωπεύει το σφάλμα ή το υπόλοιπο (residual).

- Είναι η διαφορά μεταξύ της πραγματικής τιμής της

Thumbκαι της τιμής πρόβλεψης από το μοντέλο. - Δηλαδή: \(e_i = Y_i - \hat{Y}_i\) (παρατηρούμενη τιμή μείον τιμή πρόβλεψης).

- Δεν είναι η εξαρτημένη μεταβλητή αλλά η απόκλιση από την πρόβλεψη.

Συμπέρασμα

- Το \(Y_i\) είναι πάντα η εξαρτημένη μεταβλητή σε ένα GLM.

- Στα δύο μοντέλα, το \(Y_i\) αντιπροσωπεύει το μήκος του αντίχειρα για κάθε παρατήρηση \(i\).

- Το \(X_i\) είναι η ανεξάρτητη μεταβλητή (

HeightήHeight2Group). - Το \(e_i\) είναι το σφάλμα πρόβλεψης.

Συνοπτικά: Το \(Y_i\) αναπαριστά την εξαρτημένη μεταβλητή (

Thumb) και στα δύο μοντέλα. Είναι η μεταβλητή που προσπαθούμε να προβλέψουμε χρησιμοποιώντας τις ανεξάρτητες μεταβλητές.

Ποιο μέρος της εξίσωσης αντιπροσωπεύει το σφάλμα (που ονομάζεται και υπόλοιπο) και στα δύο μοντέλα;

Σωστή απάντηση: Γ — Το \(e_i\) αντιπροσωπεύει το σφάλμα ή το υπόλοιπο (residual) και στα δύο μοντέλα.

Τι είναι το \(e_i\)

Στο Γενικό Γραμμικό Μοντέλο (GLM), το \(e_i\) αντιπροσωπεύει:

- Το σφάλμα πρόβλεψης

- Το υπόλοιπο ή κατάλοιπο

- Τη διαφορά μεταξύ της πραγματικής τιμής και της τιμής πρόβλεψης

Γιατί υπάρχει το σφάλμα \(e_i\)

Το μοντέλο δεν μπορεί να προβλέψει τέλεια τις τιμές της εξαρτημένης μεταβλητής επειδή:

- Υπάρχει φυσική μεταβλητότητα στα δεδομένα

- Άλλοι παράγοντες (που δεν περιλαμβάνονται στο μοντέλο) επηρεάζουν το αποτέλεσμα

- Υπάρχει σφάλμα μέτρησης

Για παράδειγμα, στο μοντέλο πρόβλεψης της Thumb:

- Δύο άτομα με το ίδιο ύψος μπορεί να έχουν διαφορετικό μήκος αντίχειρα

- Το \(e_i\) καταγράφει αυτή τη διαφορά για κάθε παρατήρηση \(i\)

Παράδειγμα

Έστω ότι για ένα άτομο:

- Πραγματικό μήκος αντίχειρα: \(Y_i = 58\) mm

- Τιμή πρόβλεψης του μήκους από το μοντέλο: \(\hat{Y}_i = 60\) mm

- Υπόλοιπο: \(e_i = 58 - 60 = -2\) mm

Το αρνητικό υπόλοιπο σημαίνει ότι το μοντέλο υπερεκτίμησε το μήκος του αντίχειρα κατά 2 mm.

Γιατί οι άλλες επιλογές είναι λάθος

Α. «\(Y_i\)» — ΛΑΘΟΣ

- Το \(Y_i\) είναι η εξαρτημένη μεταβλητή.

- Αντιπροσωπεύει την πραγματική, παρατηρούμενη τιμή του μήκους αντίχειρα.

- Δεν είναι το σφάλμα αλλά η τιμή που προσπαθούμε να προβλέψουμε.

Β. «\(X_i\)» — ΛΑΘΟΣ

- Το \(X_i\) είναι η ανεξάρτητη μεταβλητή.

- Αντιπροσωπεύει το ύψος (

Height) ή την ομάδα ύψους (Height2Group). - Δεν είναι το σφάλμα αλλά η μεταβλητή που χρησιμοποιούμε για την πρόβλεψη.

Συμπέρασμα

- Το \(e_i\) αντιπροσωπεύει το σφάλμα ή το υπόλοιπο στο GLM.

- Είναι η διαφορά μεταξύ της παρατηρούμενης τιμής \(Y_i\) και της τιμής πρόβλεψης \(\hat{Y}_i\).

- Καταγράφει την απόκλιση των δεδομένων από τις προβλέψεις του μοντέλου.

Συνοπτικά: Το \(e_i\) είναι το σφάλμα/υπόλοιπο που αντιπροσωπεύει τη διαφορά μεταξύ της πραγματικής τιμής και της τιμής πρόβλεψης. Δείχνει πόσο «αστοχεί» το μοντέλο για κάθε παρατήρηση.

Ποιο μέρος της εξίσωσης αντιπροσωπεύει την ανεξάρτητη μεταβλητή (είτε Height είτε Height2Group);

Σωστή απάντηση: Β — Το \(X_i\) αντιπροσωπεύει την ανεξάρτητη μεταβλητή και στα δύο μοντέλα.

Τι είναι το \(X_i\)

Στο Γενικό Γραμμικό Μοντέλο (GLM), το \(X_i\) αντιπροσωπεύει:

- Την ανεξάρτητη μεταβλητή Είναι η μεταβλητή που χρησιμοποιούμε για να εξηγήσουμε ή να προβλέψουμε τις τιμές της εξαρτημένης μεταβλητής \(Y_i\).

Εφαρμογή στα δύο μοντέλα

Και στα δύο μοντέλα, το \(X_i\) αντιπροσωπεύει μια μεταβλητή που σχετίζεται με το ύψος:

1. Μοντέλο της Height:

- \(X_i\) = το ύψος του ατόμου \(i\) σε εκατοστά (συνεχής μεταβλητή)

- Παράδειγμα: \(X_1 = 165\) cm, \(X_2 = 180\) cm, κ.λπ.

2. Μοντέλο της Height2Group:

- \(X_i\) = ψευδομεταβλητή (dummy variable) για την ομάδα ύψους

-

\(X_i = 0\) αν το άτομο ανήκει στην ομάδα

short -

\(X_i = 1\) αν το άτομο ανήκει στην ομάδα

tall

Πώς λειτουργεί το \(X_i\) στο μοντέλο

Στην εξίσωση \(Y_i = b_0 + b_1X_i + e_i\):

- Το \(X_i\) πολλαπλασιάζεται με τον συντελεστή \(b_1\)

- Όσο μεγαλύτερη είναι η τιμή του \(X_i\), τόσο περισσότερο επηρεάζει την πρόβλεψη του \(Y_i\)

- Η σχέση μεταξύ \(X_i\) και \(Y_i\) καθορίζεται από το πρόσημο και το μέγεθος του \(b_1\)

Γιατί οι άλλες επιλογές είναι λάθος

Α. «\(Y_i\)» — ΛΑΘΟΣ

- Το \(Y_i\) είναι η εξαρτημένη μεταβλητή.

- Αντιπροσωπεύει το μήκος του αντίχειρα.

- Είναι αυτό που προσπαθούμε να εξηγήσουμε, όχι η ανεξάρτητη μεταβλητή.

Γ. «\(e_i\)» — ΛΑΘΟΣ

- Το \(e_i\) είναι το σφάλμα ή το υπόλοιπο.

- Αντιπροσωπεύει τη διαφορά μεταξύ της παρατηρούμενης και της τιμής πρόβλεψης.

- Δεν είναι ανεξάρτητη μεταβλητή αλλά η απόκλιση από το μοντέλο.

Συμπέρασμα

- Το \(X_i\) αντιπροσωπεύει την ανεξάρτητη μεταβλητή στο GLM.

- Στο μοντέλο της

Height, το \(X_i\) είναι το συνεχές ύψος. - Στο μοντέλο της

Height2Group, το \(X_i\) είναι η ψευδομεταβλητή για την ομάδα ύψους. - Χρησιμοποιείται για να προβλέψουμε την εξαρτημένη μεταβλητή \(Y_i\).

Συνοπτικά: Το \(X_i\) είναι η ανεξάρτητη μεταβλητή που χρησιμοποιούμε για να προβλέψουμε το αποτέλεσμα. Στα δύο μοντέλα, το \(X_i\) αντιπροσωπεύει το ύψος (είτε ως συνεχής μεταβλητή είτε ως ποιοτική).

Στο μοντέλο της Height2Group, η μεταβλητή είχε δυαδική (dummy) κωδικοποίηση, με τιμές 0 και 1. Η τιμή 1 δεν αντιπροσώπευε κάποια ποσότητα, αλλά υποδήλωνε απλώς αν το άτομο ανήκει στην ομάδα των «ψηλών» ή όχι. Αντίθετα, στο μοντέλο της Height, η μεταβλητή αντιστοιχεί στο πραγματικό μετρημένο ύψος του ατόμου (σε εκατοστά), και συνεπώς έχει ποσοτικό χαρακτήρα.

Αυτή η διαφορά στην κωδικοποίηση οδηγεί σε ελαφρώς διαφορετικές —αλλά στενά συνδεδεμένες— ερμηνείες του συντελεστή \(b_1\).

Στο μοντέλο ομάδων (μοντέλο της Height2Group), ο συντελεστής \(b_1\) αντιπροσωπεύει:

Σωστή απάντηση: Όλα τα παραπάνω είναι σωστά.

Ανάλυση του μοντέλου ομάδων

Στο μοντέλο της Height2Group, η εξίσωση είναι:

\[Y_i = b_0 + b_1X_i + e_i\]

όπου:

- \(Y_i\) = μήκος αντίχειρα για το άτομο \(i\)

-

\(X_i\) = ψευδομεταβλητή (dummy variable):

-

\(X_i = 0\) αν το άτομο ανήκει στην ομάδα

short -

\(X_i = 1\) αν το άτομο ανήκει στην ομάδα

tall

-

\(X_i = 0\) αν το άτομο ανήκει στην ομάδα

-

\(b_0\) = το μέσο μήκος αντίχειρα της ομάδας αναφοράς (

short) - \(b_1\) = ο συντελεστής που αντιπροσωπεύει τη διαφορά μεταξύ των ομάδων

Γιατί όλες οι απαντήσεις είναι σωστές

Α. «Η μέση διαφορά μεταξύ των δύο ομάδων» — ΣΩΣΤΟ ✓

Ο συντελεστής \(b_1\) μετρά πόσο διαφέρει κατά μέσο όρο η ομάδα tall από την ομάδα short.

Για την ομάδα short (\(X_i = 0\)): \[\hat{Y}_i = b_0 + b_1 \times 0 = b_0\]

Για την ομάδα tall (\(X_i = 1\)): \[\hat{Y}_i = b_0 + b_1 \times 1 = b_0 + b_1\]

Διαφορά μεταξύ των ομάδων: \[(b_0 + b_1) - b_0 = b_1\]

Άρα, το \(b_1\) είναι η μέση διαφορά μεταξύ των δύο ομάδων.

Β. «Η ποσότητα που προστίθεται στο \(b_0\) για να πάρουμε το μέσο μήκος αντίχειρα της ομάδας των ψηλών φοιτητών» — ΣΩΣΤΟ ✓

Το \(b_0\) είναι το μέσο μήκος αντίχειρα για την ομάδα short (ομάδα αναφοράς).

Για να υπολογίσουμε το μέσο μήκος αντίχειρα της ομάδας tall: \[\text{Μέσος αντίχειρας tall} = b_0 + b_1\]

Δηλαδή, προσθέτουμε το \(b_1\) στο \(b_0\) για να βρούμε το μέσο όρο της ομάδας των ψηλών.

Γ. «Η ποσότητα που προστίθεται όταν το \(X_i\) είναι ίσο με 1» — ΣΩΣΤΟ ✓

Όταν \(X_i = 1\) (δηλαδή το άτομο είναι ψηλό), η εξίσωση γίνεται: \[Y_i = b_0 + b_1 \times 1 + e_i = b_0 + b_1 + e_i\]

Το \(b_1\) είναι η ποσότητα που προστίθεται στην πρόβλεψη όταν η ψευδομεταβλητή \(X_i\) έχει τιμή 1.

Παράδειγμα με αριθμούς

Έστω ότι το μοντέλο είναι: \[Y_i = 57 + 3X_i + e_i\]

όπου:

-

\(b_0 = 57\) mm (μέσο μήκος αντίχειρα για

short) -

\(b_1 = 3\) mm (διαφορά μεταξύ

tallκαιshort)

Για άτομο στην short (\(X_i = 0\)): \[\hat{Y}_i = 57 + 3 \times 0 = 57 \text{ mm}\]

Για άτομο στην tall (\(X_i = 1\)): \[\hat{Y}_i = 57 + 3 \times 1 = 60 \text{ mm}\]

Παρατηρούμε ότι:

- Η διαφορά μεταξύ των ομάδων είναι: \(60 - 57 = 3\) mm ✓

- Προσθέσαμε \(b_1 = 3\) στο \(b_0 = 57\) για να πάρουμε το 60 mm ✓

- Όταν \(X_i = 1\), προσθέτουμε την ποσότητα \(b_1 = 3\) ✓

Ερμηνεία του \(b_1\)

Σε ένα μοντέλο με ψευδομεταβλητή, ο συντελεστής \(b_1\) έχει τριπλή ερμηνεία:

- Διαφορά μέσων όρων: Πόσο διαφέρουν οι δύο ομάδες κατά μέσο όρο

-

Ποσότητα που προστίθεται στο

intercept: Τι προστίθεται στο \(b_0\) για την άλλη ομάδα - Επίδραση της μεταβλητής: Τι συμβαίνει όταν \(X_i\) αλλάζει από 0 σε 1

Και οι τρεις ερμηνείες είναι ισοδύναμες και σωστές.

Γενίκευση

Για οποιοδήποτε μοντέλο με ψευδομεταβλητή:

- Το \(b_0\) = μέσος όρος της ομάδας αναφοράς (\(X_i = 0\))

- Το \(b_1\) = μέση διαφορά από την ομάδα αναφοράς

- Το \(b_0 + b_1\) = μέσος όρος της άλλης ομάδας (\(X_i = 1\))

Συμπέρασμα

Ο συντελεστής \(b_1\) στο μοντέλο ομάδων:

- Αντιπροσωπεύει τη μέση διαφορά μεταξύ των δύο ομάδων

- Είναι η ποσότητα που προστίθεται στο \(b_0\) για την ομάδα

tall -

Ενεργοποιείται όταν \(X_i = 1\) (άτομο στην ομάδα

tall)

Και οι τρεις περιγραφές εκφράζουν την ίδια ιδέα με διαφορετικό τρόπο.

Συνοπτικά: Ο συντελεστής \(b_1\) σε ένα μοντέλο με ψευδομεταβλητή μπορεί να ερμηνευτεί με τρεις ισοδύναμους τρόπους: ως η διαφορά μέσων όρων, ως η ποσότητα που προστίθεται στον σταθερό όρο, και ως η επίδραση όταν \(X_i = 1\). Όλες οι απαντήσεις είναι σωστές!

Στο μοντέλο ομάδων (της Height2Group), το \(b_1\) ήταν η ποσότητα κατά την οποία αλλάζει η τιμή πρόβλεψης του μήκους αντίχειρα όταν η Height2Grouptall αυξάνεται κατά 1 (δηλαδή, πηγαίνει από 0 σε 1). Τι νομίζετε ότι είναι το \(b_1\) στο μοντέλο παλινδρόμησης (της Height);

Σωστή απάντηση: Β — Η ποσότητα που προστίθεται στην τιμή πρόβλεψης του μήκους αντίχειρα όταν το ύψος αυξάνεται κατά 1 μονάδα.

Αναλογία μεταξύ των μοντέλων

Και στα δύο μοντέλα, ο συντελεστής \(b_1\) αντιπροσωπεύει την αλλαγή στο \(Y_i\) όταν το \(X_i\) αυξάνεται κατά 1 μονάδα.

Μοντέλο της Height2Group (ποιοτική μεταβλητή):

\[Y_i = b_0 + b_1X_i + e_i\]

-

\(X_i\) = 0 (

short) ή 1 (tall) - Όταν το \(X_i\) αυξάνεται από 0 σε 1 (αλλαγή κατά 1 μονάδα):

- Πηγαίνουμε από την ομάδα

shortστην ομάδαtall - Η πρόβλεψη αλλάζει κατά \(b_1\)

- Πηγαίνουμε από την ομάδα

Μοντέλο της Height (συνεχής μεταβλητή):

\[Y_i = b_0 + b_1X_i + e_i\]

- \(X_i\) = ύψος σε εκατοστά (π.χ., 160, 165, 170, …)

- Όταν το \(X_i\) αυξάνεται κατά 1 μονάδα (π.χ. από 170 σε 171 cm):

- Το ύψος αυξάνεται κατά 1 εκατοστό

- Η πρόβλεψη αλλάζει κατά \(b_1\)

Η έννοια της κλίσης της ευθείας (slope)

Το \(b_1\) είναι ο συντελεστής διεύθυνσης ή η κλίση της ευθείας και δείχνει:

\[b_1 = \frac{\text{Αλλαγή στο } Y}{\text{Αλλαγή στο } X} = \frac{\Delta Y}{\Delta X}\]

Για μεταβολή 1 μονάδας στην \(X\): \[b_1 = \frac{\Delta Y}{1} = \Delta Y\]

Δηλαδή, το \(b_1\) είναι η μεταβολή στην \(Y\) όταν η \(X\) αλλάζει κατά 1 μονάδα.

Παράδειγμα με αριθμούς

Έστω ότι το μοντέλο της Height είναι: \[Y_i = 20 + 0.25X_i + e_i\]

όπου:

- \(b_0 = 20\) mm

- \(b_1 = 0.25\) mm/cm

Για άτομο με ύψος 170 cm: \[\hat{Y}_i = 20 + 0.25 \times 170 = 20 + 42.5 = 62.5 \text{ mm}\]

Για άτομο με ύψος 171 cm (αύξηση κατά 1 cm): \[\hat{Y}_i = 20 + 0.25 \times 171 = 20 + 42.75 = 62.75 \text{ mm}\]

Αλλαγή στην πρόβλεψη: \[62.75 - 62.5 = 0.25 \text{ mm}\]

Άρα, όταν το ύψος αυξάνεται κατά 1 cm, η τιμή πρόβλεψης του μήκους αντίχειρα αυξάνεται κατά \(b_1 = 0.25\) mm.

Γιατί οι άλλες επιλογές είναι λάθος

Α. «Η τιμή πρόβλεψης του μήκους αντίχειρα όταν το ύψος = 1» — ΛΑΘΟΣ

- Αυτό περιγράφει το \(b_0 + b_1 \times 1\), όχι απλώς το \(b_1\).

- Η τιμή πρόβλεψης του μήκους όταν \(X_i = 1\) θα ήταν: \(\hat{Y}_i = b_0 + b_1\)

- Επιπλέον, ύψος = 1 cm δεν έχει νόημα στο πλαίσιο του προβλήματος.

- Το \(b_1\) μόνο του δεν είναι μια πρόβλεψη αλλά μια μεταβολή.

Γ. «Η ποσότητα που πρέπει να αλλάξει η τιμή πρόβλεψης όταν η ομάδα ύψους αυξάνεται κατά 1» — ΛΑΘΟΣ

- Αυτό ισχύει για το μοντέλο της Height2Group, όχι για το μοντέλο της Height.

- Στο μοντέλο της

Height, δεν υπάρχουν ομάδες — το ύψος είναι συνεχής μεταβλητή. - Η ερώτηση ζητά την ερμηνεία του \(b_1\) στο μοντέλο της

Height, όχι σε αυτό τηςHeight2Group.

Σύγκριση των μοντέλων

| Μοντέλο | Τύπος \(X_i\) | Ερμηνεία του \(b_1\) |

|---|---|---|

Height2Group |

Ψευδομεταβλητή (0/1) | Διαφορά μέσων όρων μεταξύ tall και short

|

Height |

Συνεχής (cm) | Αλλαγή στο μήκος αντίχειρα ανά 1 cm αύξησης ύψους |

Και στις δύο περιπτώσεις, το \(b_1\) είναι η αλλαγή στο \(Y\) όταν το \(X\) αυξάνεται κατά 1.

Γενική αρχή

Σε οποιοδήποτε γραμμικό μοντέλο \(Y_i = b_0 + b_1X_i + e_i\):

- Το \(b_0\) (σταθερός όρος) = η τιμή του \(Y\) όταν \(X = 0\)

- Το \(b_1\) (κλίση) = η αλλαγή στο \(Y\) όταν το \(X\) αυξάνεται κατά 1

Αυτός ο κανόνας ισχύει ανεξάρτητα από το αν το \(X\) είναι:

- Ποιοτική μεταβλητή (ψευδομεταβλητή)

- Ποσοτική Συνεχής μεταβλητή

- Ποσοτική Διακριτή μεταβλητή

Συμπέρασμα

Στο μοντέλο της Height:

- Το \(b_1\) είναι η κλίση (slope) της ευθείας παλινδρόμησης

- Αντιπροσωπεύει την αλλαγή στην τιμή πρόβλεψης του μήκους αντίχειρα όταν το ύψος αυξάνεται κατά 1 cm

- Μας λέει πόσο αυξάνεται (ή μειώνεται αν \(b_1 < 0\)) ο αντίχειρας για κάθε επιπλέον εκατοστό ύψους

Συνοπτικά: Κατ’ αναλογία, όπως το \(b_1\) στο μοντέλο της

Height2Groupδείχνει την αλλαγή όταν πηγαίνουμε απόshortσεtall(αλλαγή κατά 1 στο \(X\)), έτσι και στο μοντέλο τηςHeightτο \(b_1\) δείχνει την αλλαγή όταν το ύψος αυξάνεται κατά 1 cm. Είναι η ποσότητα που προστίθεται στην τιμή πρόβλεψης ανά μονάδα αύξησης του ύψους.

Στο μοντέλο παλινδρόμησης, ο συντελεστής \(b_1\) εξακολουθεί να εκφράζει μια ποσότητα που προστίθεται στον σταθερό όρο \(b_0\). Πιο συγκεκριμένα, αντιπροσωπεύει τη μεταβολή που αναμένεται στη εξαρτημένη μεταβλητή για κάθε αύξηση κατά μία μονάδα της ανεξάρτητης μεταβλητής Height. Αυτός είναι ουσιαστικά ο ορισμός της κλίσης μιας ευθείας: το μέγεθος της «κατακόρυφης μεταβολής» που αντιστοιχεί σε κάθε μονάδα «οριζόντιας μεταβολής». Με άλλα λόγια, ο συντελεστής \(b_1\) δείχνει πόσο αλλάζει η τιμή της Thumb για κάθε επιπλέον εκατοστό ύψους. (Σημειώστε ότι η μεταβολή αυτή μπορεί να είναι και αρνητική, αν το \(b_1\) είναι αρνητικό.)

Ο συντελεστής \(b_1\), λοιπόν, είναι η κλίση της ευθείας παλινδρόμησης που προσαρμόζεται καλύτερα στα δεδομένα.

Και στα δύο μοντέλα, ο συντελεστής \(b_0\) αντιπροσωπεύει το σημείο τομής (intercept), δηλαδή την τιμή πρόβλεψης της εξαρτημένης μεταβλητής όταν η ανεξάρτητη μεταβλητή είναι μηδέν.

Ωστόσο, η ερμηνεία του διαφέρει:

- Στο μοντέλο της

Height2Group, τοHeight2Group = 0σημαίνει ότι το άτομο ανήκει στην ομάδα των φοιτητών χαμηλού αναστήματος (short), δηλαδή στην ομάδα αναφοράς. - Στο μοντέλο της

Height, τοHeight = 0θα σήμαινε κυριολεκτικά ότι το άτομο έχει ύψος 0 εκατοστά — κάτι που προφανώς δεν έχει νόημα στην πράξη. Παρ’ όλα αυτά, το μοντέλο μπορεί μαθηματικά να υπολογίσει τιμή πρόβλεψης ακόμη και για μια τέτοια υποθετική περίπτωση.

Τι θα προέβλεπε αυτό το μοντέλο για ένα άτομο που έχει ύψος 0;

Σωστή απάντηση: Α — Το μοντέλο θα προέβλεπε την τιμή του \(b_0\) για ένα άτομο με ύψος 0.

Ανάλυση της πρόβλεψης

Το γραμμικό μοντέλο είναι:

\[Y_i = b_0 + b_1X_i + e_i\]

Για να βρούμε την τιμή πρόβλεψης, χρησιμοποιούμε την εξίσωση χωρίς το σφάλμα:

\[\hat{Y}_i = b_0 + b_1X_i\]

Όταν το ύψος είναι 0 (δηλαδή \(X_i = 0\)):

\[\hat{Y}_i = b_0 + b_1 \times 0 = b_0 + 0 = b_0\]

Άρα, η πρόβλεψη του μοντέλου είναι απλώς ο σταθερός όρος \(b_0\).

Τι είναι ο σταθερός όρος (\(b_0\))

Το \(b_0\) είναι το σημείο τομής (intercept) και αντιπροσωπεύει:

- Την τιμή πρόβλεψης της \(Y\) όταν όλες οι ανεξάρτητες μεταβλητές είναι 0

- Το σημείο όπου η ευθεία παλινδρόμησης τέμνει τον κατακόρυφο άξονα (άξονας y)

- Το “σημείο εκκίνησης” της πρόβλεψης πριν προσθέσουμε την επίδραση της \(X\)

Γεωμετρική ερμηνεία

Σε ένα διάγραμμα διασποράς με γραμμή παλινδρόμησης:

- Ο οριζόντιος άξονας (X) είναι το ύψος

- Ο κατακόρυφος άξονας (Y) είναι το μήκος αντίχειρα

- Η ευθεία παλινδρόμησης τέμνει τον άξονα Y στο σημείο \((0, b_0)\)

- Όταν \(X = 0\), είμαστε ακριβώς σε αυτό το σημείο, άρα \(Y = b_0\)

Παράδειγμα με αριθμούς

Έστω ότι το μοντέλο είναι: \[Y_i = 25 + 0.20X_i + e_i\]

όπου:

- \(b_0 = 25\) mm

- \(b_1 = 0.20\) mm/cm

Για άτομο με ύψος \(X_i = 0\) cm: \[\hat{Y}_i = 25 + 0.20 \times 0 = 25 \text{ mm}\]

Για άτομο με ύψος \(X_i = 170\) cm: \[\hat{Y}_i = 25 + 0.20 \times 170 = 25 + 34 = 59 \text{ mm}\]

Βλέπουμε ότι όταν \(X = 0\), η πρόβλεψη είναι απλώς ο σταθερός όρος.

Γιατί οι άλλες επιλογές είναι λάθος

Β. «\(b_1\)» — ΛΑΘΟΣ

Το \(b_1\) είναι ο συντελεστής κλίσης της ευθείας (slope), όχι η πρόβλεψη.

Δείχνει πόσο αλλάζει η \(Y\) όταν η \(X\) αυξάνεται κατά 1.

Δεν είναι η τιμή της \(Y\) όταν \(X = 0\). Γ. «\(b_0 + b_1\)» — ΛΑΘΟΣ

Αυτή η έκφραση θα ήταν η πρόβλεψη αν \(X_i = 1\), όχι \(X_i = 0\).

Όταν \(X_i = 1\): \(\hat{Y}_i = b_0 + b_1 \times 1 = b_0 + b_1\)

Αλλά εδώ η ερώτηση είναι για \(X_i = 0\), όχι για \(X_i = 1\).

Επιπλέον, η πρόσθεση \(b_0 + b_1\) δεν έχει νόημα γιατί οι δύο μεταβλητές έχουν διαφορετικές μονάδες.

Συμπέρασμα

- Όταν \(X_i = 0\), η πρόβλεψη του μοντέλου είναι ο σταθερός όρος \(b_0\).

- Αυτό ισχύει για κάθε γραμμικό μοντέλο της μορφής \(Y = b_0 + b_1X\).

- Το \(b_0\) είναι η βασική τιμή πρόβλεψης πριν προσθέσουμε την επίδραση της ανεξάρτητης μεταβλητής.

Συνοπτικά: Όταν το ύψος είναι 0 (\(X_i = 0\)), η εξίσωση γίνεται \(\hat{Y}_i = b_0 + b_1 \times 0 = b_0\). Ο σταθερός όρος \(b_0\) είναι η πρόβλεψη του μοντέλου όταν η ανεξάρτητη μεταβλητή είναι μηδέν.

Ας ερμηνεύσουμε ξανά αυτή την εξίσωση στο πλαίσιο των μεταβλητών Thumb και Height:

\[Y_i = b_0 + b_1X_i + e_i\]

1. Τι αντιπροσωπεύει το \(Y_i\) στο πλαίσιο αυτού του μοντέλου;

Σωστή απάντηση: Β — Το μήκος αντίχειρα (σε mm)

Το \(Y_i\) είναι η εξαρτημένη μεταβλητή που προσπαθούμε να προβλέψουμε. Στο πλαίσιο αυτού του μοντέλου, αντιπροσωπεύει το μήκος του αντίχειρα για το άτομο \(i\), μετρημένο σε χιλιοστά (mm).

2. Τι αντιπροσωπεύει το \(b_0\) στο πλαίσιο αυτού του μοντέλου;

Σωστή απάντηση: Β — Το μήκος αντίχειρα όταν το \(X_i\) είναι 0

Το \(b_0\) είναι το intercept (σταθερός όρος) του μοντέλου. Αντιπροσωπεύει την τιμή πρόβλεψης του \(Y_i\) όταν η ανεξάρτητη μεταβλητή \(X_i = 0\).

Στο μοντέλο της Height2Group: Το \(b_0\) είναι το μέσο μήκος αντίχειρα για την ομάδα αναφοράς (short), επειδή όταν \(X_i = 0\), το άτομο ανήκει στην ομάδα short.

Στο μοντέλο της Height: Το \(b_0\) είναι το θεωρητικό μήκος αντίχειρα όταν το ύψος είναι 0 cm (αν και αυτό δεν έχει πρακτική ερμηνεία).

3. Τι αντιπροσωπεύει το \(b_1\) στο πλαίσιο αυτού του μοντέλου;

Σωστή απάντηση: Γ — Η ποσότητα που προστίθεται για κάθε μονάδα της \(X_i\)

Το \(b_1\) είναι ο συντελεστής κλίσης (slope). Δείχνει πόσο αλλάζει η τιμή πρόβλεψης του μήκους αντίχειρα όταν το \(X_i\) αυξάνεται κατά 1 μονάδα.

Στο μοντέλο της Height2Group: Το \(b_1\) είναι η διαφορά μέσου όρου μεταξύ της ομάδας tall και της ομάδας short. Όταν \(X_i\) πηγαίνει από 0 (short) σε 1 (tall), η τιμή πρόβλεψης αλλάζει κατά \(b_1\).

Στο μοντέλο της Height: Το \(b_1\) είναι η αλλαγή στο μήκος αντίχειρα για κάθε 1 cm αύξησης στο ύψος.

4. Τι αντιπροσωπεύει το \(X_i\) στο πλαίσιο αυτού του μοντέλου;

Σωστή απάντηση: Γ — Το ύψος (σε εκατοστά) ή σε ποια ομάδα ύψους ανήκει κάποιος

Το \(X_i\) είναι η ανεξάρτητη μεταβλητή που χρησιμοποιούμε για να προβλέψουμε το \(Y_i\).

Στο μοντέλο της Height2Group: Το \(X_i\) είναι μια ψευδομεταβλητή που παίρνει τιμές: - \(X_i = 0\) αν το άτομο ανήκει στην ομάδα short - \(X_i = 1\) αν το άτομο ανήκει στην ομάδα tall

Στο μοντέλο της Height: Το \(X_i\) είναι το συνεχές ύψος του ατόμου σε εκατοστά.

5. Τι αντιπροσωπεύει το \(e_i\) στο πλαίσιο αυτού του μοντέλου;

Σωστή απάντηση: Δ — Πόσο «εκτός» είναι η πρόβλεψη του μοντέλου (το υπόλοιπο)

Το \(e_i\) είναι το σφάλμα ή το υπόλοιπο (residual). Αντιπροσωπεύει τη διαφορά μεταξύ της πραγματικής παρατηρούμενης τιμής και της τιμής πρόβλεψης από το μοντέλο:

\[e_i = Y_i - \hat{Y}_i\]

Δείχνει πόσο “αστοχεί” το μοντέλο για κάθε παρατήρηση. Αν το \(e_i\) είναι θετικό, το μοντέλο υποεκτίμησε την πραγματική τιμή. Αν είναι αρνητικό, το μοντέλο υπερεκτίμησε την πραγματική τιμή.

Σχέση με την Άλγεβρα

Στην άλγεβρα, μια ευθεία περιγράφεται συνήθως από την εξίσωση:

\(y = \alpha x+\beta\)

όπου το \(\alpha\) είναι η κλίση και το \(\beta\) είναι η τομή με τον άξονα \(y\).

Στη στατιστική, χρησιμοποιούμε την ίδια βασική εξίσωση, αλλά αλλάζουμε λίγο τη μορφή της, ώστε ο σταθερός όρος να εμφανίζεται πρώτος \(y = \beta + \alpha x\), και χρησιμοποιούμε διαφορετικά γράμματα για να αναπαραστήσουμε το σταθερό όρο και την κλίση (\(b_0\) και \(b_1\), αντίστοιχα).

Παρατηρήστε ότι υπάρχει ομοιότητα μεταξύ της εξίσωσης του GLM και της εξίσωσης μιας ευθείας:

\[Y_i = b_0 + b_1X_i + e_i \text{ έναντι } y = αx + β\]

1. Ποιο μέρος της εξίσωσης του GLM αντιστοιχεί στο \(y\) στην εξίσωση της ευθείας;

Σωστή απάντηση: Α — \(Y_i\)

Το \(Y_i\) στο GLM αντιστοιχεί στο \(y\) στην εξίσωση της ευθείας. Και τα δύο αντιπροσωπεύουν την εξαρτημένη μεταβλητή - την τιμή που προβλέπουμε ή υπολογίζουμε.

Ομοιότητες:

- Και τα δύο είναι το αποτελέσμα της εξίσωσης

- Και τα δύο εξαρτώνται από την τιμή του \(x\) ή \(X_i\)

- Και τα δύο μπορούν να παρασταθούν στον κατακόρυφο άξονα ενός διαγράμματος

Διαφορά: Το \(Y_i\) στο GLM περιλαμβάνει επίσης το σφάλμα \(e_i\), ενώ η απλή εξίσωση ευθείας δεν έχει όρο σφάλματος.

2. Ποιο μέρος της εξίσωσης του GLM αντιστοιχεί στο \(\beta\) στην εξίσωση της ευθείας;

Σωστή απάντηση: Β — \(b_0\)

Το \(b_0\) στο GLM αντιστοιχεί στο \(\beta\) στην εξίσωση της ευθείας. Και τα δύο αντιπροσωπεύουν το σημείο τομής - τη σταθερά της εξίσωσης.

Ομοιότητες:

- Και τα δύο είναι η τιμή του \(y\) ή \(Y_i\) όταν \(x\) ή \(X_i\) είναι 0

- Και τα δύο δείχνουν πού η ευθεία τέμνει τον κατακόρυφο άξονα

- Και τα δύο είναι σταθερές (δεν αλλάζουν με το \(x\) ή \(X_i\))

Σημείωση: Στη στατιστική, το \(b\) συνήθως χρησιμοποιείται για τον σταθερό όρο, ενώ στα μαθηματικά το \(\beta\) είναι ο σταθερός όρος στην εξίσωση \(y = \alpha x + \beta\). Στο GLM, το \(b_0\) είναι πιο περιγραφικό (δείχνει ότι είναι η παράμετρος με δείκτη 0).

3. Ποιο μέρος της εξίσωσης του GLM αντιστοιχεί στο \(\alpha\) στην εξίσωση της ευθείας;

Σωστή απάντηση: Γ — \(b_1\)

Το \(b_1\) στο GLM αντιστοιχεί στο \(\alpha\) στην εξίσωση της ευθείας. Και τα δύο αντιπροσωπεύουν την κλίση (slope) - πόσο αλλάζει το \(y\) ή \(Y_i\) για κάθε μονάδα αλλαγής στο \(x\) ή \(X_i\).

Ομοιότητες:

- Και τα δύο δείχνουν το ρυθμό μεταβολής του \(y\) ως προς το \(x\)

- Και τα δύο πολλαπλασιάζονται με την ανεξάρτητη μεταβλητή

- Και τα δύο καθορίζουν την κλίση της ευθείας

Ερμηνεία:

\[\text{Κλίση} = \frac{\text{Αλλαγή στο } y}{\text{Αλλαγή στο } x} = \frac{\Delta y}{\Delta x}\]

Για μία μονάδα αύξησης στο \(x\) ή \(X_i\), το \(y\) ή \(Y_i\) αλλάζει κατά \(\alpha\) ή \(b_1\) μονάδες.

4. Ποιο μέρος της εξίσωσης του GLM αντιστοιχεί στο \(x\) στην εξίσωση της ευθείας;

Σωστή απάντηση: Δ — \(X_i\)

Το \(X_i\) στο GLM αντιστοιχεί στο \(x\) στην εξίσωση της ευθείας. Και τα δύο αντιπροσωπεύουν την ανεξάρτητη μεταβλητή - την τιμή εισόδου που χρησιμοποιούμε για να υπολογίσουμε το \(y\) ή \(Y_i\).

Ομοιότητες:

- Και τα δύο είναι η είσοδος της εξίσωσης

- Και τα δύο πολλαπλασιάζονται με την κλίση (\(\alpha\) ή \(b_1\))

- Και τα δύο μπορούν να παρασταθούν στον οριζόντιο άξονα ενός διαγράμματος

Σημείωση: Το \(i\) στο \(X_i\) δείχνει ότι πρόκειται για την τιμή της παρατήρησης \(i\) - στη στατιστική έχουμε πολλές παρατηρήσεις, όχι μόνο μία τιμή \(x\).

5. Ποιο είναι το στοιχείο που υπάρχει στην εξίσωση του GLM αλλά ΔΕΝ υπάρχει στην απλή εξίσωση ευθείας \(y = \alpha x + \beta\);

Σωστή απάντηση: Γ — Ο όρος σφάλματος \(e_i\)

Η κύρια διαφορά μεταξύ του GLM και της απλής εξίσωσης ευθείας είναι ο όρος σφάλματος \(e_i\).

Απλή εξίσωση ευθείας: \[y = \alpha x + \beta\]

Αυτή είναι μια ντετερμινιστική σχέση - για κάθε τιμή \(x\), υπάρχει μία ακριβής τιμή \(y\).

GLM: \[Y_i = b_0 + b_1X_i + e_i\]

Αυτή είναι μια στατιστική σχέση - αναγνωρίζει ότι υπάρχει μεταβλητότητα στα δεδομένα. Για την ίδια τιμή \(X_i\), διαφορετικές παρατηρήσεις μπορεί να έχουν διαφορετικές τιμές \(Y_i\).

Γιατί χρειαζόμαστε το \(e_i\):

- Τα πραγματικά δεδομένα δεν πέφτουν ακριβώς πάνω σε μια ευθεία

- Υπάρχει φυσική μεταβλητότητα στις μετρήσεις

- Άλλοι παράγοντες (που δεν περιλαμβάνονται στο μοντέλο) επηρεάζουν το αποτέλεσμα

- Υπάρχει σφάλμα μέτρησης

Πίνακας με αντιστοιχίες:

| GLM | Εξίσωση ευθείας | Ερμηνεία |

|---|---|---|

| \(Y_i\) | \(y\) | Εξαρτημένη μεταβλητή |

| \(b_0\) | \(\beta\) | Σταθερός όρος (Intercept) |

| \(b_1\) | \(\alpha\) | Κλίση (slope) |

| \(X_i\) | \(x\) | Ανεξάρτητη μεταβλητή |

| \(e_i\) | — | Σφάλμα/υπόλοιπο |

Συμπέρασμα:

Το GLM είναι μια επέκταση της απλής εξίσωσης ευθείας που:

- Χρησιμοποιεί πιο περιγραφικά σύμβολα (\(b_0, b_1\) αντί για \(\beta, \alpha\))

- Προσθέτει δείκτες \(i\) για να δείξει ότι έχουμε πολλές παρατηρήσεις

- Περιλαμβάνει τον όρο σφάλματος \(e_i\) για να αναγνωρίσει τη μεταβλητότητα στα δεδομένα

Συνοπτικά: Το GLM \(Y_i = b_0 + b_1X_i + e_i\) είναι η στατιστική εκδοχή της εξίσωσης ευθείας \(y = \alpha x + \beta\). Η βασική δομή είναι η ίδια, αλλά στο GLM προστίθεται ο όρος σφάλματος \(e_i\) για να λάβει υπόψη τη μεταβλητότητα στα πραγματικά δεδομένα.

Η προσαρμογή ενός μοντέλου παλινδρόμησης είναι τελικά ζήτημα εύρεσης εκείνης της ευθείας που προσαρμόζεται καλύτερα στα δεδομένα — δηλαδή, εκείνης που ελαχιστοποιεί το άθροισμα των τετραγώνων των σφαλμάτων.

10.3 Ερμηνεία των Εκτιμήσεων Παραμέτρων σε ένα Μοντέλο Παλινδρόμησης

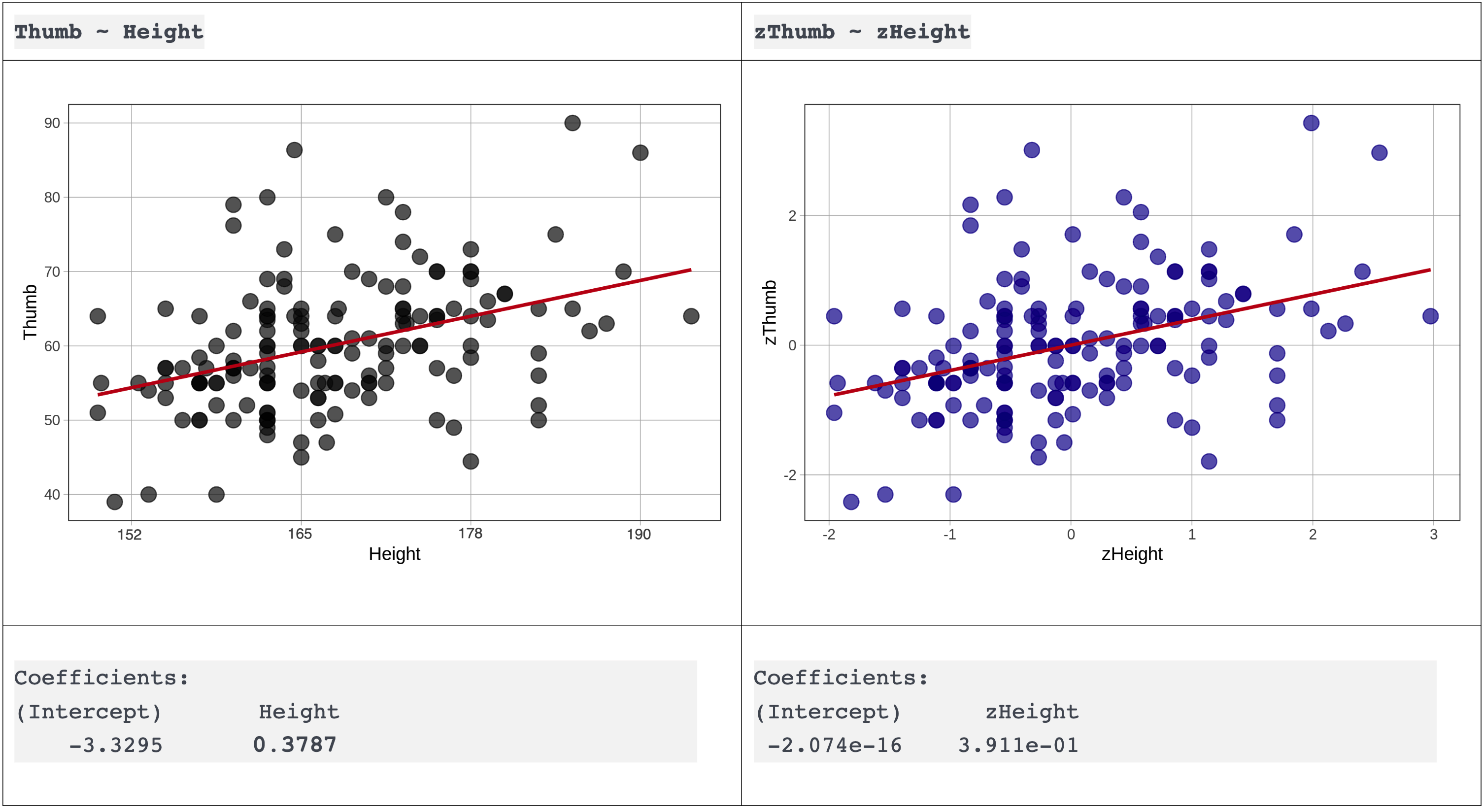

Προηγουμένως, χρησιμοποιήσαμε τη συνάρτηση lm() για να προσαρμόσουμε το μοντέλο του ύψους (Height) για την πρόβλεψη του μήκους αντίχειρα (Thumb) και το αποθηκεύσαμε ως Height_model:

Height_model <- lm(Thumb ~ Height, data = Fingers)Ας εξετάσουμε τώρα τις εκτιμήσεις των παραμέτρων του μοντέλου και ας δούμε πώς μπορούμε να τις ερμηνεύσουμε. Χρησιμοποιήστε το παρακάτω παράδειγμα κώδικα για να εμφανίσετε τις εκτιμήσεις των παραμέτρων του μοντέλου του ύψους (Height model).

Call:

lm(formula = Thumb ~ Height, data = Fingers)

Coefficients:

(Intercept) Height

-3.3295 0.3787Τι είναι το \(-3.33\) στα παραπάνω αποτελέσματα; (Υπάρχουν περισσότερες από μία σωστές απαντήσεις.)

Σωστές απαντήσεις: Α και ΣΤ

Το \(-3.3295\) είναι ο σταθερός όρος (intercept) του μοντέλου παλινδρόμησης.

Α. «\(b_0\)» — ΣΩΣΤΟ ✓

Το -3.33 είναι το \(b_0\) στην εξίσωση: \[Y_i = b_0 + b_1X_i + e_i\]

Από τα αποτελέσματα: \[\text{Thumb}_i = -3.33 + 0.378 \times \text{Height}_i + e_i\]

ΣΤ. «Ο σταθερός όρος (η τιμή του \(Y_i\) όταν \(X_i = 0\))» — ΣΩΣΤΟ ✓

Ο σταθερός όρος είναι η τιμή πρόβλεψης του μήκους αντίχειρα όταν το ύψος είναι 0.

Όταν \(\text{Height} = 0\): \[\hat{\text{Thumb}} = -3.33 + 0.378 \times 0 = -3.33 \text{ mm}\]

Σημείωση: Αν και αλγεβρικά αυτός είναι ο σταθερός όρος, στην πράξη δεν έχει νόημα - κανείς δεν έχει ύψος 0 εκατοστά! Ο σταθερός όρος είναι απαραίτητος για τη μαθηματική μορφή της εξίσωσης, αλλά η ερμηνεία του έχει νόημα μόνο εντός του εύρους των παρατηρούμενων δεδομένων.

Γιατί οι άλλες επιλογές είναι λάθος

Β. «\(b_1\)» — ΛΑΘΟΣ

Το \(b_1\) είναι ο συντελεστής κλίσης (slope), όχι ο σταθερός όρος.

Στο output: - \(b_0 = -3.3295\) (Intercept) - \(b_1 = 0.3787\) (Height)

Το -3.33 είναι το \(b_0\), όχι το \(b_1\).

Γ. «\(X_i\)» — ΛΑΘΟΣ

Το \(X_i\) είναι η ανεξάρτητη μεταβλητή (Height), όχι μια παράμετρος του μοντέλου.

- Το \(X_i\) είναι δεδομένα που παρατηρούμε (π.χ., ύψος = 170 cm)

- Το \(b_0\) είναι μια τιμή παραμέτρου που εκτιμά το μοντέλο

Το -3.33 είναι τιμή παραμέτρου, όχι δεδομένα.

Δ. «Η κλίση μιας ευθείας παλινδρόμησης» — ΛΑΘΟΣ

Η κλίση (slope) είναι το \(b_1 = 0.3787\), όχι το \(b_0 = -3.33\).

- Η κλίση δείχνει πόσο αλλάζει η

Thumbγια κάθε 1 μονάδα αύξησης στηνHeight - Ο σταθερός όρος είναι η τιμή εκκίνησης όταν

Height= 0

Αυτές είναι δύο διαφορετικές τιμές παραμέτρου με διαφορετικές ερμηνείες.

Ε. «Η διαφορά μεταξύ δύο ομάδων» — ΛΑΘΟΣ

Αυτό θα ίσχυε αν το μοντέλο ήταν με ποιοτική ανεξάρτητη μεταβλητή (π.χ., Height2Group).

Στο μοντέλο της Height2Group:

Το \(b_0\) = μέσος όρος της ομάδας αναφοράς

Το \(b_1\) = διαφορά μέσων όρων μεταξύ των ομάδων

Αλλά στο τρέχον μοντέλο, η Height είναι συνεχής μεταβλητή, όχι κατηγορική. Δεν υπάρχουν ομάδες - το ύψος μετράται σε εκατοστά.

Επομένως, το -3.33 είναι ο σταθερός όρος για τη συνεχή σχέση, όχι διαφορά ομάδων.

Γεωμετρική ερμηνεία

Σε ένα διάγραμμα διασποράς:

- Ο οριζόντιος άξονας (X) =

Height - Ο κατακόρυφος άξονας (Y) =

Thumb - Η ευθεία παλινδρόμησης έχει:

- Κλίση = 0.3787 (πόσο απότομη είναι η ευθεία)

- Intercept = -3.33 (πού τέμνει τον άξονα Y στο σημείο X = 0)

Γιατί ο σταθερός όρος είναι αρνητικός;

Η αρνητική τιμή του σταθερού όρου δεν σημαίνει ότι υπάρχουν αρνητικά μήκη αντίχειρα! Συμβαίνει επειδή:

- Η ευθεία παλινδρόμησης εκτείνεται πέρα από το εύρος των δεδομένων

- Κανείς δεν έχει πραγματικά ύψος κοντά στο 0

- Ο σταθερός όρος είναι ένα μαθηματικό χαρακτηριστικό της εξίσωσης

- Οι προβλέψεις είναι αξιόπιστες μόνο εντός του εύρους των παρατηρούμενων υψών

Πρακτική χρήση:

Ο σταθερός όρος είναι απαραίτητος για τον υπολογισμό προβλέψεων, αλλά η άμεση ερμηνεία του συχνά δεν έχει νόημα. Αυτό που έχει νόημα είναι:

- Η κλίση \(b_1 = 0.3787\): Πόσο αλλάζει το μήκος αντίχειρα ανά cm ύψους

- Οι προβλέψεις για ρεαλιστικές τιμές ύψους (π.χ., 150-200 cm)

Συμπέρασμα

Το -3.33 είναι:

- ✓ Το \(b_0\) (η εκτίμηση παραμέτρου)

- ✓ Το intercept (η τιμή του \(Y\) όταν \(X = 0\))

- ✗ ΌΧΙ η κλίση

- ✗ ΌΧΙ διαφορά ομάδων (γιατί η

Heightείναι συνεχής μεταβλητή)

Συνοπτικά: Το -3.33 είναι ο σταθερός όρος (\(b_0\)) του μοντέλου - η θεωρητική τιμή του μήκους αντίχειρα όταν το ύψος είναι 0. Αν και δεν έχει πρακτική ερμηνεία (κανείς δεν έχει ύψος 0), είναι απαραίτητο για την αλγεβρική μορφή της εξίσωσης παλινδρόμησης.

Τι είναι το 0.3787 στα παραπάνω αποτελέσματα; (Υπάρχουν περισσότερες από μία σωστές απαντήσεις.)

Σωστές απαντήσεις: Β και Δ

Το 0.3787 είναι ο συντελεστής κλίσης (slope) του μοντέλου παλινδρόμησης.

Β. «\(b_1\)» — ΣΩΣΤΟ ✓

Το 0.3787 είναι το \(b_1\) στην εξίσωση: \[Y_i = b_0 + b_1X_i + e_i\]

Από τα αποτελέσματα: \[\text{Thumb}_i = -3.3295 + 0.3787 \times \text{Height}_i + e_i\]

όπου:

\(b_0 = -3.3295\) (Σταθερός όρος)

\(b_1 = 0.3787\) (

Height— αυτός είναι ο συντελεστής που πολλαπλασιάζει τηνHeight)

Δ. «Η κλίση μιας ευθείας παλινδρόμησης» — ΣΩΣΤΟ ✓

Το \(b_1 = 0.3787\) είναι η κλίση (slope) της ευθείας παλινδρόμησης.

Ερμηνεία: Για κάθε 1 cm αύξησης στο ύψος, το μήκος αντίχειρα αυξάνεται κατά μέσο όρο 0.3787 mm.

Αλγεβρικά: \[\text{Κλίση} = \frac{\Delta \text{Thumb}}{\Delta \text{Height}} = \frac{0.3787 \text{ mm}}{1 \text{ cm}}\]

Γιατί οι άλλες επιλογές είναι λάθος

Α. «\(b_0\)» — ΛΑΘΟΣ

Το \(b_0\) είναι ο σταθερός όρος, όχι η κλίση.

Στα αποτελέσματα: - \(b_0 = -3.3295\) (σταθερός όρος) - \(b_1 = 0.3787\) (ύψος) ← Αυτό είναι το 0.3787

Το 0.3787 είναι το \(b_1\), όχι το \(b_0\).

Γ. «\(X_i\)» — ΛΑΘΟΣ

Το \(X_i\) είναι η ανεξάρτητη μεταβλητή (Height), δηλαδή τα δεδομένα που έχουμε.

- Το \(X_i\) παίρνει διαφορετικές τιμές για κάθε άτομο (π.χ., 165 cm, 170 cm, 180 cm)

- Το \(b_1 = 0.3787\) είναι μια εκτίμηση παραμέτρου που εκτιμά το μοντέλο - είναι σταθερή για όλες τις παρατηρήσεις

Το 0.3787 δεν είναι μια παρατήρηση αλλά ο συντελεστής που πολλαπλασιάζει το \(X_i\).

Ε. «Η διαφορά μεταξύ δύο ομάδων» — ΛΑΘΟΣ

Αυτό θα ίσχυε αν το μοντέλο είχε ποιοτική ανεξάρτητη μεταβλητή (π.χ., την Height2Group με ομάδες short/tall).

Μοντέλο με ποιοτική μεταβλητή (Height2Group): \[\text{Thumb}_i = b_0 + b_1 \times \text{Height2Grouptall}_i + e_i\]

Εδώ το \(b_1\) θα ήταν η διαφορά μέσου όρου μεταξύ tall και short.

Μοντέλο με συνεχή μεταβλητή (Height): \[\text{Thumb}_i = b_0 + b_1 \times \text{Height}_i + e_i\]

Εδώ το \(b_1\) είναι η κλίση - η αλλαγή στο Thumb ανά μονάδα αύξησης της Height.

Το τρέχον μοντέλο χρησιμοποιεί την συνεχή Height, όχι ομάδες, άρα το 0.3787 δεν είναι διαφορά ομάδων.

ΣΤ. «Ο σταθερός όρος (η τιμή του \(Y_i\) όταν \(X_i = 0\))» — ΛΑΘΟΣ

Ο σταθερός όρος είναι το \(b_0 = -3.3295\), όχι το \(b_1 = 0.3787\).

- Σταθερός όρος (\(b_0\)): Η τιμή του \(Y\) όταν \(X = 0\)

- Κλίση (\(b_1\)): Πόσο αλλάζει το \(Y\) όταν το \(X\) αυξάνεται κατά 1

Αυτά είναι δύο διαφορετικές εκτιμήσεις παραμέτρων με διαφορετικές ερμηνείες.

Λεπτομερής ερμηνεία του \(b_1 = 0.3787\)

Το μοντέλο είναι: \[\text{Thumb}_i = -3.3295 + 0.3787 \times \text{Height}_i + e_i\]

Τι σημαίνει η κλίση 0.3787:

- Για κάθε 1 cm αύξησης στο ύψος, το μήκος αντίχειρα αυξάνεται κατά μέσο όρο 0.3787 mm (περίπου 0.378 mm)

- Η σχέση είναι θετική: όσο πιο ψηλό το άτομο, τόσο μεγαλύτερος ο αντίχειρας

- Η σχέση είναι γραμμική: η αύξηση είναι σταθερή (0.378 mm ανά cm) σε όλο το εύρος των υψών

Παραδείγματα προβλέψεων:

Για άτομο με ύψος 160 cm: \[\hat{\text{Thumb}} = -3.33 + 0.3787 \times 160 = -3.33 + 60.59 = 57.26 \text{ mm}\]

Για άτομο με ύψος 170 cm: \[\hat{\text{Thumb}} = -3.33 + 0.3787 \times 170 = -3.33 + 64.38 = 61.05 \text{ mm}\]

Διαφορά μεταξύ των δύο προβλέψεων: \[61.05 - 57.26 = 3.79 \text{ mm} \approx 10 \times 0.378 \text{ mm}\]

Για 10 cm διαφορά στο ύψος, έχουμε περίπου 3.8 mm διαφορά στον αντίχειρα, που είναι ακριβώς \(10 \times 0.3787\).

Εναλλακτική ερμηνεία:

Μπορούμε να εκφράσουμε την κλίση και ως:

- Για κάθε 10 cm αύξησης στο ύψος → αύξηση 3.787 mm στον αντίχειρα

- Για κάθε 1 m αύξησης στο ύψος → αύξηση 37.87 mm (3.787 cm) στον αντίχειρα

Γεωμετρική ερμηνεία

Σε ένα διάγραμμα διασποράς:

- Ο οριζόντιος άξονας (X) =

Heightσε cm - Ο κατακόρυφος άξονας (Y) =

Thumbσε mm - Η ευθεία παλινδρόμησης έχει:

- Κλίση = 0.3787 (πόσο απότομη είναι η γραμμή)

- Σταθερός όρος = -3.33 (πού τέμνει τον άξονα Y στο σημείο X = 0)

Η κλίση 0.3787 σημαίνει ότι για κάθε 1 cm που κινούμαστε δεξιά στον οριζόντιο άξονα, ανεβαίνουμε 0.378 mm στον κατακόρυφο άξονα.

Συμπέρασμα

Το 0.3787 είναι:

- ✓ Το \(b_1\) είναι

- ✓ η κλίση της ευθείας παλινδρόμησης

- ✗ ΌΧΙ ο σταθερός όρος

- ✗ ΌΧΙ διαφορά ομάδων (γιατί η

Heightείναι συνεχής μεταβλητή)

Συνοπτικά: Το 0.3787 είναι η κλίση (\(b_1\)) του μοντέλου παλινδρόμησης - η αλλαγή στο μήκος αντίχειρα (σε mm) για κάθε 1 cm αύξησης στο ύψος. Η τιμή του συντελεστή εξαρτάται από τις μονάδες μέτρησης (0.378 mm), αλλά η υποκείμενη σχέση παραμένει η ίδια.

Ο σταθερός όρος (Intercept) αντιστοιχεί στο \(b_0\) και ο συντελεστής της Height αντιστοιχεί στο \(b_1\). Το προσαρμοσμένο μας μοντέλο μπορεί να γραφτεί ως:

\[Thumb_i = -3.33 + 0.378 \, Height_i + e_i\] Ή, ισοδύναμα, χρησιμοποιώντας τη σημειογραφία του GLM:

\[Y_i = -3.33 + 0.378 \, X_i + e_i\]

Τι θα προέβλεπε αυτό το μοντέλο ως μήκος αντίχειρα για ένα άτομο με ύψος 0; (Υπάρχουν περισσότερες από μία σωστές απαντήσεις.)

Σωστές απαντήσεις: Α, Γ και Δ

Ανάλυση της πρόβλεψης

Το μοντέλο είναι: \[Y_i = b_0 + b_1X_i + e_i\]

Για την πρόβλεψη χρησιμοποιούμε: \[\hat{Y}_i = b_0 + b_1X_i\]

Όταν το ύψος είναι 0 (δηλαδή \(X_i = 0\)): \[\hat{Y}_i = b_0 + b_1 \times 0 = b_0 + 0 = b_0\]

Α. «\(b_0\)» — ΣΩΣΤΟ ✓

Όταν \(X_i = 0\), η πρόβλεψη είναι απλώς ο σταθερός όρος \(b_0\).

Από την εξίσωση: \[\hat{Y}_i = b_0 + b_1 \times 0 = b_0\]

Γ. «\(b_0 + b_1(0)\)» — ΣΩΣΤΟ ✓

Αυτή είναι η πλήρης μορφή της εξίσωσης πρόβλεψης όταν \(X_i = 0\).

\[\hat{Y}_i = b_0 + b_1(0) = b_0 + 0 = b_0\]

Αυτή η έκφραση είναι μαθηματικά ισοδύναμη με την επιλογή Α, απλώς δείχνει ρητά τον υπολογισμό.

Δ. «-3.33» — ΣΩΣΤΟ ✓

Από τα αποτελέσματα του μοντέλου: \[b_0 = -3.3295\]

Άρα, όταν \(\text{Height} = 0\): \[\hat{\text{Thumb}} = -3.3295 + 0.378 \times 0 = -3.3295 \text{ mm}\]

Αυτή είναι η αριθμητική τιμή της πρόβλεψης.

Γιατί οι άλλες επιλογές είναι λάθος

Β. «\(b_1\)» — ΛΑΘΟΣ

Το \(b_1\) είναι η κλίση, όχι η πρόβλεψη όταν \(X = 0\).

- Το \(b_1 = 0.378\) δείχνει πόσο αλλάζει το \(Y\) όταν το \(X\) αυξάνεται κατά 1

- Η πρόβλεψη όταν \(X = 0\) είναι το \(b_0 = -3.33\), όχι το \(b_1\)

Ε. «0.378» — ΛΑΘΟΣ

Το 0.378 είναι η τιμή του \(b_1\) (η κλίση), όχι η πρόβλεψη όταν \(X = 0\).

Από τα αποτελέσματα: - Σταθερός όρος = \(b_0 = -3.3295\) - Συντελεστής της Height = \(b_1 = 0.378\)

Η πρόβλεψη όταν Height = 0 είναι ο σταθερός όρος (-3.3295), όχι η κλίση (0.378).

ΣΤ. «\(-3.3295 + 0.378\)» — ΛΑΘΟΣ

Αυτή η έκφραση θα ήταν σωστή αν το ύψος ήταν 1, όχι 0.

Πρακτική σημασία

Αν και αλγεβρικά η πρόβλεψη για ύψος 0 είναι -3.33 mm, αυτό δεν έχει πρακτικό νόημα επειδή:

- Κανείς δεν έχει ύψος 0 cm

- Αρνητικό μήκος αντίχειρα είναι φυσικά αδύνατο

- Οι προβλέψεις είναι αξιόπιστες μόνο εντός του εύρους των παρατηρούμενων δεδομένων

Ο σταθερός όρος είναι απαραίτητος για τη μαθηματική μορφή της εξίσωσης, αλλά η ερμηνεία του έχει νόημα μόνο όταν \(X = 0\) βρίσκεται εντός (ή κοντά στο) εύρος των δεδομένων.

Συμπέρασμα

Όταν το ύψος είναι 0, το μοντέλο προβλέπει:

- ✓ \(b_0\) (συμβολικά)

- ✓ \(b_0 + b_1(0)\) (πλήρης έκφραση)

- ✓ \(-3.33\) mm (αριθμητικά)

Και οι τρεις εκφράσεις είναι αλγεβρικά ισοδύναμες και σωστές.

Συνοπτικά: Όταν το ύψος είναι 0, η πρόβλεψη του μοντέλου είναι ο σταθερός όρος \(b_0 = -3.33\) mm. Αυτό προκύπτει από την εξίσωση \(\hat{Y} = b_0 + b_1 \times 0 = b_0\). Αν και μαθηματικά ορθή, αυτή η πρόβλεψη δεν έχει πρακτικό νόημα γιατί κανείς δεν έχει ύψος 0.

Η σταθερά \(b_0 = -3.33\) αντιπροσωπεύει το σημείο τομής, δηλαδή την τιμή πρόβλεψης του μήκους αντίχειρα (Thumb) όταν το ύψος (Height) είναι 0.

Φυσικά, ούτε ένα ύψος 0 εκατοστών ούτε ένα μήκος αντίχειρα \(-3.33\) χιλιοστών είναι ρεαλιστικά. Αυτό μας υπενθυμίζει ότι οι προβλέψεις ενός μοντέλου παλινδρόμησης δεν έχουν πάντα πρακτικό ή φυσικό νόημα. Είναι λοιπόν σημαντικό να εξετάζουμε ποιες τιμές των μεταβλητών και ποιες προβλέψεις είναι λογικές μέσα στο πλαίσιο των δεδομένων μας.

Πώς τα Μοντέλα Παλινδρόμησης Κάνουν Προβλέψεις

Μπορούμε να χρησιμοποιήσουμε το μοντέλο της Height για να προβλέψουμε το μήκος του αντίχειρα ατόμων διαφορετικού ύψους, όπως ακριβώς χρησιμοποιήσαμε το μοντέλο της Height2Group για να προβλέψουμε το μήκος του αντίχειρα για φοιτητές με χαμηλό και υψηλό ανάστημα.

Μπορούμε να γράψουμε το προσαρμοσμένο μοντέλο της Height ως εξής:

\[\text{Thumb}_i = -3.3295 + 0.378\text{Height}_i + e_i\]

Ποιο μέρος αυτής της εξίσωσης θα χρησιμοποιούσαμε για να προβλέψουμε το μήκος αντίχειρα ενός νέου άτομου;

Σωστή απάντηση: Γ — \(-3.3295 + 0.378\text{Height}_i\)

Γιατί χρησιμοποιούμε αυτό το μέρος της εξίσωσης;

Για να κάνουμε πρόβλεψη, χρησιμοποιούμε μόνο το ντετερμινιστικό μέρος του μοντέλου, δηλαδή το μέρος χωρίς τον όρο σφάλματος \(e_i\).

Πλήρες μοντέλο: \[\text{Thumb}_i = -3.3295 + 0.378\text{Height}_i + e_i\]

Εξίσωση πρόβλεψης: \[\hat{\text{Thumb}}_i = -3.3295 + 0.378\text{Height}_i\]

Το σύμβολο \(\hat{Y}\) (“Y hat”) υποδηλώνει την τιμή πρόβλεψης.

Γιατί αφαιρούμε το \(e_i\);

Ο όρος σφάλματος \(e_i\) αντιπροσωπεύει:

Τη μεταβλητότητα που δεν εξηγείται από το μοντέλο

Την απόκλιση της πραγματικής παρατήρησης από την πρόβλεψη

Την επίδραση άλλων παραγόντων που δεν περιλαμβάνονται στο μοντέλο

Για ένα νέο άτομο, δεν γνωρίζουμε το σφάλμα \(e_i\) (γιατί δεν έχουμε ακόμα μετρήσει το πραγματικό μήκος του αντίχειρα του). Επομένως:

- Δεν μπορούμε να συμπεριλάβουμε το \(e_i\) στην πρόβλεψη

- Χρησιμοποιούμε μόνο το συστηματικό μέρος του μοντέλου: \(b_0 + b_1X_i\)

- Υποθέτουμε ότι κατά μέσο όρο το σφάλμα είναι 0: \(E(e_i) = 0\)

Γιατί οι άλλες επιλογές είναι λάθος

Α. «\(\text{Thumb}_i = -3.3295 + 0.378\text{Height}_i + e_i\)» — ΛΑΘΟΣ

Αυτή είναι η πλήρης εξίσωση του μοντέλου, όχι η εξίσωση πρόβλεψης.

Η εξίσωση αυτή περιγράφει τη σχέση μεταξύ των μεταβλητών για τα υπάρχοντα δεδομένα: \[\text{Thumb}_i = \underbrace{-3.3295 + 0.378\text{Height}_i}_{\text{τιμή πρόβλεψης}} + \underbrace{e_i}_{\text{απόκλιση από την πρόβλεψη}}\]

Για νέο άτομο, χρησιμοποιούμε μόνο το μέρος της πρόβλεψης: \[\hat{\text{Thumb}}_i = -3.3295 + 0.378\text{Height}_i\]

Β. «\(-3.3295 + 0.378\text{Height}_i + e_i\)» — ΛΑΘΟΣ

Αυτή η έκφραση περιλαμβάνει τον όρο σφάλματος \(e_i\), ο οποίος δεν πρέπει να συμπεριληφθεί στην πρόβλεψη.

Γιατί όχι;

- Δεν γνωρίζουμε το \(e_i\) για νέο άτομο (δεν έχουμε μετρήσει ακόμα το πραγματικό μήκος αντίχειρα (

Thumb) - Κατά μέσο όρο, το \(e_i = 0\) (τα σφάλματα είναι τυχαία γύρω από το μηδέν)

- Η πρόβλεψη βασίζεται μόνο στο συστηματικό μέρος του μοντέλου

Διαφορά μεταξύ μοντέλου και πρόβλεψης

| Εξίσωση | Χρήση | Περιλαμβάνει \(e_i\); |

|---|---|---|

| \(Y_i = b_0 + b_1X_i + e_i\) | Περιγραφή των δεδομένων | Ναι |

| \(\hat{Y}_i = b_0 + b_1X_i\) | Πρόβλεψη για νέα δεδομένα | Όχι |

Παράδειγμα πρόβλεψης

Έστω ότι ένα νέο άτομο έχει ύψος 170 cm. Για να προβλέψουμε το μήκος του αντίχειρα του:

ΣΩΣΤΟΣ τρόπος (χρησιμοποιώντας την εξίσωση πρόβλεψης): \[\hat{\text{Thumb}} = -3.3295 + 0.378 \times 170 = -3.3295 + 64.26 = 60.93 \text{ mm}\]

ΛΑΘΟΣ τρόπος (αν συμπεριλάβουμε το \(e_i\)): \[\text{Thumb} = -3.3295 + 0.378 \times 170 + e_i = 60.93 + e_i\]

Αλλά τι είναι το \(e_i\); Δεν το γνωρίζουμε! Το \(e_i\) είναι η διαφορά μεταξύ της πραγματικής τιμής (που δεν έχουμε ακόμα) και της πρόβλεψης.

Η φύση του σφάλματος \(e_i\)

Το \(e_i\) μπορεί να υπολογιστεί μόνο αφού έχουμε την πραγματική παρατήρηση:

- Πρόβλεψη: \(\hat{\text{Thumb}} = -3.3295 + 0.378 \times 170 = 60.93\) mm

- Πραγματική μέτρηση: Έστω \(\text{Thumb} = 62\) mm

- Υπόλοιπο: \(e_i = 62 - 60.93 = 1.07\) mm

Το \(e_i\) είναι το υπόλοιπο (residual) - πόσο η πραγματική τιμή διαφέρει από την πρόβλεψη.

Ιδιότητες της εξίσωσης πρόβλεψης

Η εξίσωση πρόβλεψης \(\hat{Y}_i = b_0 + b_1X_i\):

- Δίνει την καλύτερη εκτίμηση με βάση τα διαθέσιμα δεδομένα

- Είναι η τιμή με τη μικρότερη μέση τετραγωνική απόκλιση

- Αντιπροσωπεύει τη μέση τιμή του \(Y\) για δεδομένο \(X\)

- Δεν περιλαμβάνει τυχαίο σφάλμα

Γραφική αναπαράσταση

Σε ένα διάγραμμα διασποράς:

- Η ευθεία παλινδρόμησης \(\hat{Y} = b_0 + b_1X\) είναι η γραμμή πρόβλεψης

- Τα σημεία δεδομένων δεν πέφτουν ακριβώς πάνω στη γραμμή

- Η κατακόρυφη απόσταση κάθε σημείου από τη γραμμή είναι το \(e_i\)

Όταν κάνουμε πρόβλεψη για νέο σημείο, χρησιμοποιούμε την ευθεία, όχι τις αποκλίσεις.

Συμπέρασμα

Για να προβλέψουμε το μήκος αντίχειρα ενός νέου ατόμου, χρησιμοποιούμε:

\[\hat{\text{Thumb}}_i = -3.3295 + 0.378\text{Height}_i\]

Δηλαδή, μόνο το ντετερμινιστικό μέρος του μοντέλου, χωρίς τον όρο σφάλματος \(e_i\).

Βασικές αρχές:

- Το \(e_i\) περιγράφει την παρατηρούμενη απόκλιση στα υπάρχοντα δεδομένα

- Για νέες προβλέψεις, δεν γνωρίζουμε (ούτε μπορούμε να γνωρίζουμε) το \(e_i\)

- Η τιμή πρόβλεψης είναι ο μέσος όρος για δεδομένο \(X\)

- Το σφάλμα έχει μέση τιμή 0

Συνοπτικά: Για πρόβλεψη χρησιμοποιούμε την εξίσωση \(\hat{\text{Thumb}}_i = -3.3295 + 0.378\text{Height}_i\) χωρίς τον όρο σφάλματος \(e_i\), γιατί το σφάλμα είναι άγνωστο για νέες παρατηρήσεις και έχει μέση τιμή μηδέν. Η πρόβλεψη αντιπροσωπεύει την αναμενόμενη (μέση) τιμή του μήκους αντίχειρα για δεδομένο ύψος.

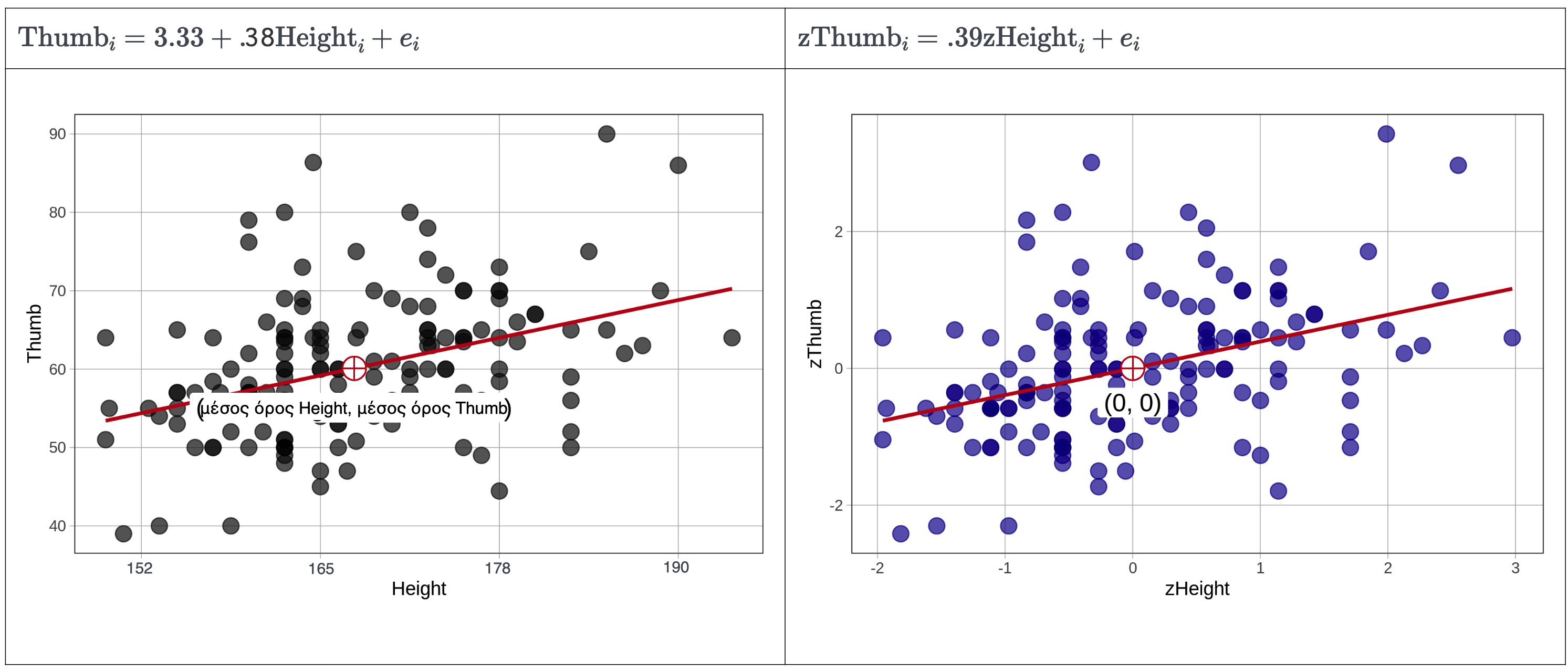

Θυμηθείτε ότι το μήκος αντίχειρα (και η τιμή πρόβλεψής του) εκφράζεται σε χιλιοστά. Η τιμή -3.3295 είναι η τιμή πρόβλεψης του μήκους αντίχειρα, σε χιλιοστά, για ένα άτομο με ύψος 0 εκατοστά. Αν προεκτείνουμε τον οριζόντιο άξονα ώστε να περιλαμβάνει το 0, θα περιμέναμε η ευθεία παλινδρόμησης να τέμνει τον κατακόρυφο άξονα στο -3.3295. (Παρατηρήστε, ωστόσο, ότι στο παρακάτω διάγραμμα δεν υπάρχουν άνθρωποι με ύψος 0 εκατοστά — για προφανείς λόγους!)

Η εκτίμηση παραμέτρου \(b_1\) = 0.378 είναι η κλίση: για κάθε αύξηση κατά 1 μονάδα στο ύψος (Height), το μοντέλο μας προβλέπει αύξηση κατά 0.378 μονάδες στο μήκος του αντίχειρα (Thumb).

Το γεγονός ότι το ύψος μετριέται σε εκατοστά, ενώ το μήκος του αντίχειρα σε χιλιοστά, δεν δημιουργεί πρόβλημα· η ευθεία παλινδρόμησης είναι μια συνάρτηση (το τμήμα \(b_0 +b_1X\) που δέχεται τιμές σε εκατοστά και παράγει προβλέψεις σε χιλιοστά). Αυτό σημαίνει ότι, κατά μέσο όρο, τα άτομα που είναι 1 cm ψηλότερα αναμένεται να έχουν αντίχειρες 0.378 mm μακρύτερους, σύμφωνα με το μοντέλο.

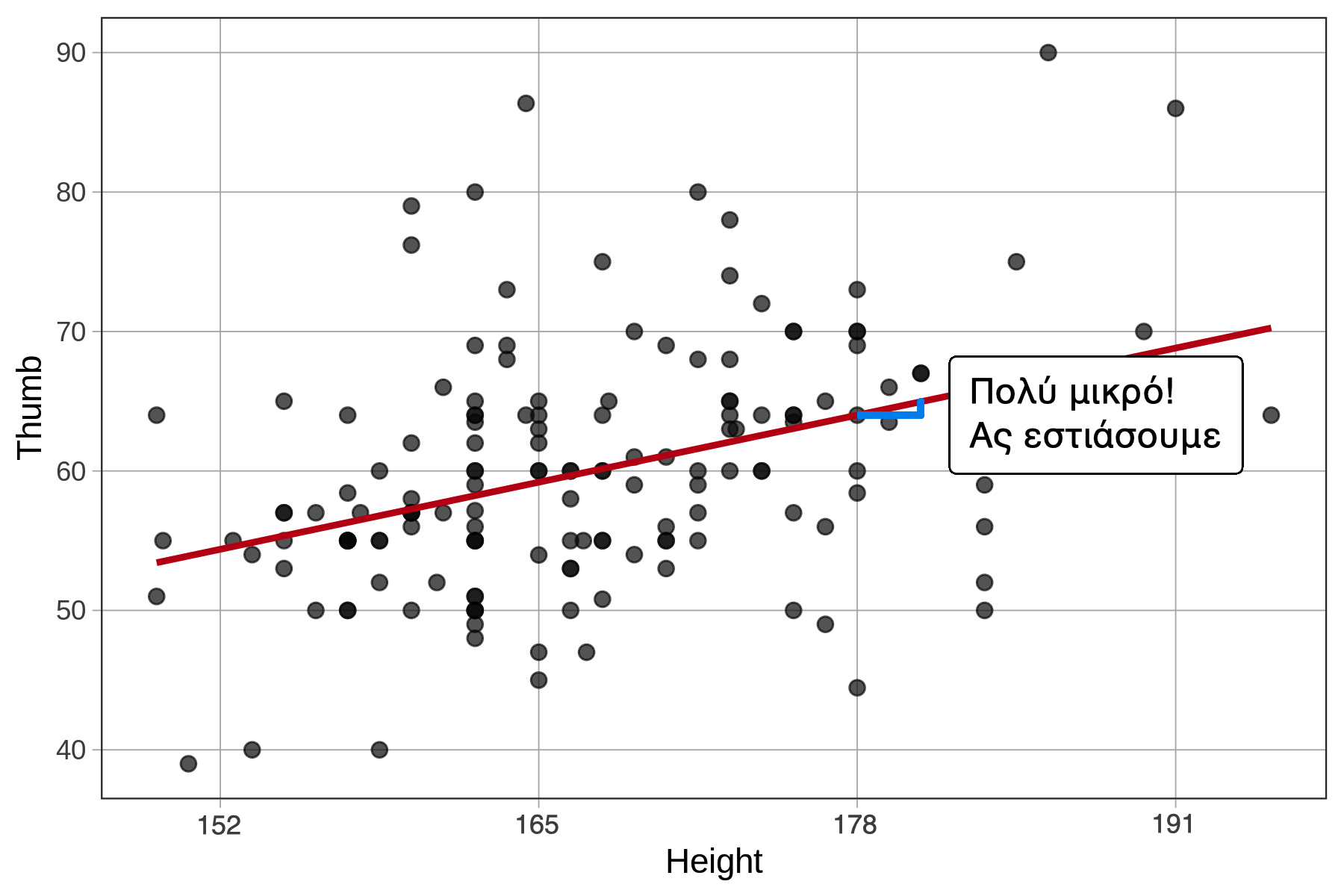

Παρακάτω παρουσιάζεται μια διαγραμματική αναπαράσταση αυτής της σχέσης:

Ας εστιάσουμε σε μια συγκεκριμένη περιοχή του διαγράμματος. Η τιμή πρόβλεψης του μήκους αντίχειρα ενός ατόμου με ύψος 178 εκατοστά είναι περίπου 178 \(\times\) 0.378 \(-\) 3.3295 = 63.95 χιλιοστά. Όταν το ύψος αυξάνεται κατά 1 cm, τότε η τιμή πρόβλεψης του μήκους αντίχειρα γίνεται 63.85 + 0.378 = 64.33 χιλιοστά.

Ας εστιάσουμε σε μια συγκεκριμένη περιοχή του διαγράμματος. Η τιμή πρόβλεψης του μήκους αντίχειρα ενός ατόμου με ύψος 178 εκατοστά είναι περίπου 178 \(\times\) 0.378 \(-\) 3.3295 = 63.95 χιλιοστά. Όταν το ύψος αυξάνεται κατά 1 cm, τότε η τιμή πρόβλεψης του μήκους αντίχειρα γίνεται 63.85 + 0.378 = 64.33 χιλιοστά.

Ποια από τις παρακάτω εκφράσεις θα δώσει την τιμή πρόβλεψης του μήκους αντίχειρα του μοντέλου για ένα άτομο με ύψος 180 cm;

Σωστή απάντηση: Α — \(-3.3295 + 0.378(180)\)

Ανάλυση της εξίσωσης πρόβλεψης

Το μοντέλο της Height είναι: \[\hat{\text{Thumb}}_i = -3.3295 + 0.378 \times \text{Height}_i\]

Για άτομο με ύψος 180 cm, αντικαθιστούμε το \(\text{Height}_i = 180\): \[\hat{\text{Thumb}} = -3.3295 + 0.378 \times 180\]

Υπολογισμός: \[\hat{\text{Thumb}} = -3.3295 + 68.04 = 64.71 \text{ mm}\]

Α. «\(-3.3295 + 0.378(180)\)» — ΣΩΣΤΟ ✓

Αυτή είναι η ορθή εφαρμογή της εξίσωσης πρόβλεψης.

Η γενική μορφή είναι: \[\hat{Y}_i = b_0 + b_1X_i\]

Όπου:

\(b_0 = -3.3295\) (σταθερός όρος)

\(b_1 = 0.378\) (κλίση)

\(X_i = 180\) (ύψος σε cm)

Άρα: \[\hat{Y}_i = -3.3295 + 0.378 \times 180\]

Βήμα προς βήμα:

- Πολλαπλασιάζουμε την κλίση επί το ύψος: \(0.378 \times 180 = 68.04\)

- Προσθέτουμε τον σταθερό όρο: \(-3.3295 + 68.04 = 64.71\) mm

Γιατί οι άλλες επιλογές είναι λάθος

Β. «\(-3.3295 + 0.378 + (180)\)» — ΛΑΘΟΣ

Αυτή η έκφραση προσθέτει όλες τις τιμές αντί να πολλαπλασιάσει την κλίση με το ύψος.

Λάθος υπολογισμός: \[-3.3295 + 0.378 + 180 = 177.048\]

Αυτό θα έδινε μήκος αντίχειρα 177 mm, που είναι παράλογο (θα ήταν 17.7 cm!).

Το σωστό:

Η κλίση πρέπει να πολλαπλασιαστεί με το ύψος, όχι απλώς να προστεθεί: \[-3.3295 + (0.378 \times 180) \neq -3.3295 + 0.378 + 180\]

Γιατί πολλαπλασιάζουμε;

Η κλίση \(b_1 = 0.378\) σημαίνει “0.378 mm ανά cm ύψους”. Για 180 cm: \[0.378 \frac{\text{mm}}{\text{cm}} \times 180 \text{ cm} = 68.04 \text{ mm}\]

Γ. «\(180 + 0.378\)» — ΛΑΘΟΣ

Αυτή η έκφραση:

- Παραλείπει τον σταθερό όρο \(b_0 = -3.33\)

- Προσθέτει αντί να πολλαπλασιάζει

- Αντιστρέφει τη σειρά των όρων

Λάθος υπολογισμός: \[180 + 0.378 = 180.378\]

Αυτό θα έδινε μήκος αντίχειρα 180.378 mm (18 cm!), που είναι εντελώς λάθος.

Το σωστό:

Πρέπει να ξεκινήσουμε με τον σταθερό όρο και να πολλαπλασιάσουμε την κλίση με το ύψος: \[-3.3295 + 0.378 \times 180\]

Δ. «\(180X_i\)» — ΛΑΘΟΣ

Αυτή η έκφραση δεν έχει καμία σχέση με την εξίσωση πρόβλεψης.

Προβλήματα:

- Το \(X_i\) είναι το ύψος (180 cm), όχι μια άλλη μεταβλητή

- Παραλείπονται τόσο ο σταθερός όρος όσο και η κλίση

- Ο πολλαπλασιασμός \(180 \times X_i = 180 \times 180 = 32400\) δεν έχει νόημα

Σημείωση: Το \(X_i\) είναι το σύμβολο για την ανεξάρτητη μεταβλητή (Height). Στην περίπτωσή μας, \(X_i = 180\) cm.

Κατανόηση της δομής της εξίσωσης

Η εξίσωση γραμμικής παλινδρόμησης έχει τη μορφή: \[\hat{Y} = b_0 + b_1X\]

Στοιχεία της εξίσωσης:

- \(b_0\) (intercept): Σταθερά που προστίθεται

- \(b_1\) (κλίση): Συντελεστής που πολλαπλασιάζει το \(X\)

- \(X\) (ανεξάρτητη μεταβλητή): Η τιμή εισόδου (ύψος)

Για το μοντέλο μας:

| Σύμβολο | Τιμή | Ερμηνεία |

|---|---|---|

| \(b_0\) | -3.3295 | Σταθερός όρος |

| \(b_1\) | 0.378 | Κλίση (mm/cm) |

| \(X\) | 180 | Ύψος (cm) |

| \(\hat{Y}\) | ? | Τιμή πρόβλεψης Thumb (mm) |

Επαλήθευση της απάντησης

Η τιμή πρόβλεψης \(\hat{\text{Thumb}} = 64.71\) mm είναι λογική;

- Ύψος 180 cm είναι λίγο πάνω από το μέσο όρο

- Μήκος αντίχειρα ~65 mm (6.5 cm) είναι ρεαλιστικό

- Η τιμή είναι θετική (όπως αναμένεται)

- Η τιμή είναι εντός λογικού εύρους (50-80 mm)

✓ Η απάντηση φαίνεται σωστή!

Συμπέρασμα

Για να προβλέψουμε το μήκος αντίχειρα ατόμου με ύψος 180 cm, χρησιμοποιούμε:

\[\hat{\text{Thumb}} = -3.3295 + 0.378(180) = 64.71 \text{ mm}\]

Βασική δομή: Σταθερός όρος + (Κλίση × Ύψος)

Συνοπτικά: Η σωστή έκφραση είναι \(-3.3295 + 0.378(180)\), που ακολουθεί τη μορφή \(\hat{Y} = b_0 + b_1X\). Αντικαθιστούμε το ύψος 180 cm στο \(X\) και πολλαπλασιάζουμε με την κλίση 0.378, μετά προσθέτουμε τον σταθερό όρο -3.3295, για να πάρουμε την τιμή πρόβλεψης 64.71 mm.

Αντίστοιχα, η τιμή πρόβλεψης του μήκους αντίχειρα ενός ατόμου με ύψος 180 εκατοστά είναι 64.71 χιλιοστά. Αυτή είναι η τιμή του μήκους αντίχειρα (Thumb) πάνω στην ευθεία παλινδρόμησης όταν το ύψος (Height) είναι 180, όπως φαίνεται στο παρακάτω διάγραμμα:

Οι Συντελεστές Παλινδρόμησης δεν είναι Συμμετρικοί

Όταν προσαρμόζουμε ένα μοντέλο παλινδρόμησης, έχει σημασία ποια μεταβλητή επιλέγουμε ως εξαρτημένη και ποια ως ανεξάρτητη. Για παράδειγμα, αν προσαρμόσουμε το μοντέλο Thumb ∼ Height, τα αποτελέσματα (σταθερός όρος και κλίση) θα διαφέρουν από εκείνα που θα προκύψουν αν προσαρμόσουμε το μοντέλο Height ∼ Thumb.

Call:

lm(formula = Thumb ~ Height, data = Fingers)

Coefficients:

(Intercept) Height

-3.3295 0.3787

Call:

lm(formula = Height ~ Thumb, data = Fingers)

Coefficients:

(Intercept) Thumb

143.2327 0.4038 Ο λόγος αυτής της διαφοράς είναι ότι οι δύο μεταβλητές έχουν διαφορετικές μονάδες μέτρησης και διαφορετικές κατανομές. Αν η εξαρτημένη μεταβλητή είναι η Thumb, τότε η κλίση (\(b_1\) = 0.3787) δείχνει πόσο μεταβάλλεται η τιμή πρόβλεψης του μήκους αντίχειρα (σε χιλιοστά) για κάθε αύξηση κατά 1 εκατοστό στο ύψος. Αντίθετα, αν η εξαρτημένη μεταβλητή είναι η Height, τότε η κλίση (\(b_1\) = 0.4038) δείχνει πόσο μεταβάλλεται η τιμή πρόβλεψης του ύψος (σε εκατοστά) για κάθε αύξηση κατά 1 χιλιοστό στο μήκος του αντίχειρα.

Πρόκειται, επομένως, για δύο διαφορετικές σχέσεις με διαφορετική ερμηνεία, παρόλο που βασίζονται στα ίδια δεδομένα.

10.4 Σύγκριση Μοντέλων Παλινδρόμησης με Μοντέλα Ομάδων

Σύγκριση των Μοντέλων της Height2Group και της Height

Έχουμε πλέον μάθει πώς να ορίζουμε και να προσαρμόζουμε δύο διαφορετικούς τύπους μοντέλων: τα μοντέλα ομάδων (π.χ. Height2Group_model) και τα μοντέλα παλινδρόμησης (π.χ. Height_model). Ας σκεφτούμε τώρα λίγο ποιες είναι οι ομοιότητες και οι διαφορές ανάμεσα σε αυτούς τους δύο τύπους μοντέλων.

| Σύμβολο |

Μοντέλο Ομάδων \(Y_i = b_0 + b_1 X_i + e_i\) \(Thumb_i = b_0 + b_1 Height2Group_{tall,i} + e_i\) |

Μοντέλο Παλινδρόμησης \(Y_i = b_0 + b_1 X_i + e_i\) \(Thumb_i = b_0 + b_1 Height_i + e_i\) |

|---|---|---|

| \(Y_i\) | Μήκος αντίχειρα του φοιτητή \(i\) | Μήκος αντίχειρα του φοιτητή \(i\) |

| \(b_0\) | Τιμή πρόβλεψης μήκους αντίχειρα όταν \(Height2Group_i = 0\) (μέσο μήκος αντίχειρα για τους φοιτητές χαμηλού αναστήματος) |

Τιμή πρόβλεψης μήκους αντίχειρα όταν \(Height_i = 0\) (τεταγμένη τομής της γραμμής παλινδρόμησης) |

| \(b_1\) | Μεταβολή στην τιμή πρόβλεψης μήκους αντίχειρα για φοιτητές υψηλού αναστήματος (η μέση διαφορά μεταξύ των δύο ομάδων) |

Μεταβολή στην τιμή πρόβλεψης μήκους αντίχειρα για κάθε αύξηση του ύψους κατά μία μονάδα (η κλίση της γραμμής παλινδρόμησης) |

| \(X_i\) | Μεταβλητή Height2Group του φοιτητή \(i\) (κωδικοποιημένη ως 0 = όχι ψηλός, 1 = ψηλός) |

Ύψος του φοιτητή \(i\) (σε εκατοστά) |

| \(e_i\) | Σφάλμα πρόβλεψης για τον φοιτητή \(i\) | Σφάλμα πρόβλεψης για τον φοιτητή \(i\) |

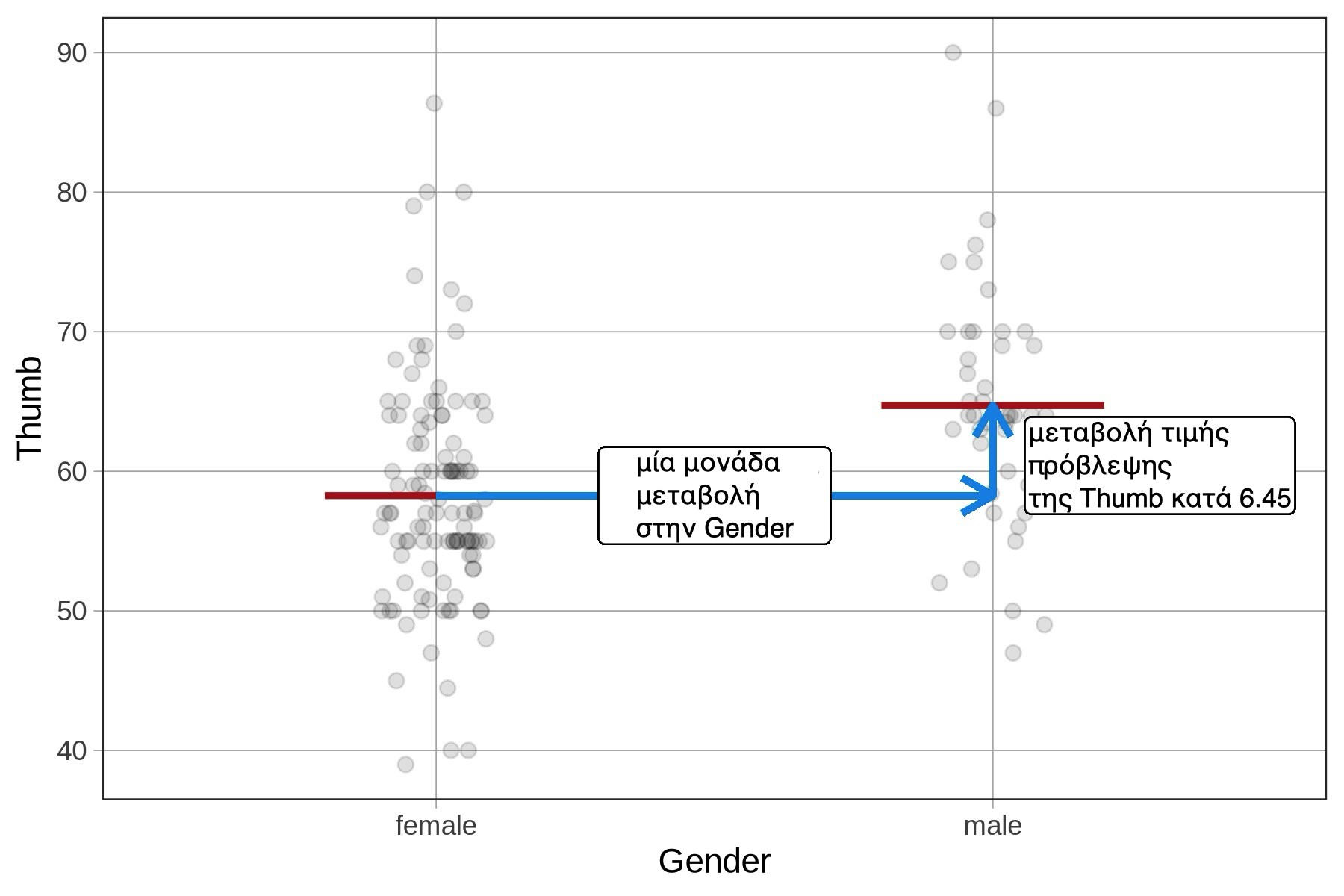

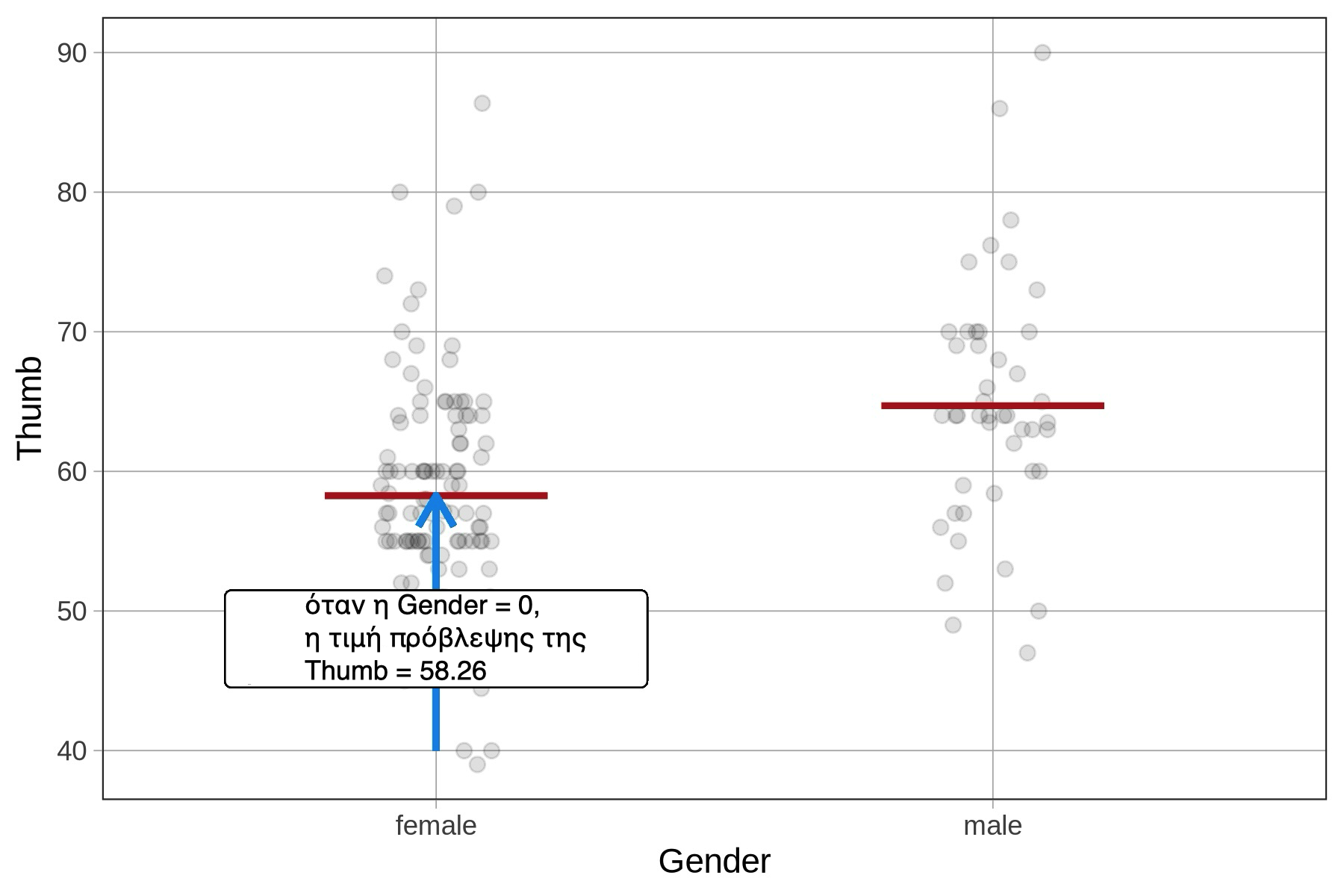

Οπτικοποίηση των Μοντέλων

Προσαρμογή Μοντέλου Παλινδρόμησης κατά Λάθος

Αν και η R είναι αρκετά «έξυπνη» ώστε να αναγνωρίζει ποιο είδος μοντέλου πρέπει να εφαρμόσει, δεν κάνει πάντα τη σωστή επιλογή. Αν κωδικοποιήσουμε τη μεταβλητή ομάδων με αλφαριθμητικές τιμές όπως female και male ή short και tall, η R θα καταλάβει ότι η μεταβλητή είναι ποιοτική και θα προσαρμόσει ένα μοντέλο ομάδων.

Ωστόσο, αν χρησιμοποιήσουμε αριθμητική κωδικοποίηση, π.χ. 1 και 2, και ξεχάσουμε να τη δηλώσουμε ως παράγοντα (factor), τότε η R μπορεί να «μπερδευτεί» και να θεωρήσει τη μεταβλητή ποσοτική, προσαρμόζοντας έτσι ένα μοντέλο παλινδρόμησης αντί για ένα μοντέλο ομάδων.

Για παράδειγμα, προσθέσαμε μια νέα μεταβλητή στα δεδομένα Fingers, ονόματι GenderNum. Τα δεδομένα φαίνονται ως εξής:

Thumb Gender GenderNum

1 66 male 2

2 64 female 1

3 56 female 1

4 70 male 2

5 52 female 1

6 62 male 2Αν παρατηρήσουμε τις μεταβλητές Gender και GenderNum, θα δούμε ότι περιέχουν την ίδια πληροφορία: οι φοιτητές 2, 3 και 5 ανήκουν στη μία ομάδα, ενώ οι φοιτητές 1, 4 και 6 στην άλλη.

Είτε προσαρμόσουμε ένα μοντέλο με τη Gender (π.χ. Gender_model) είτε με τη GenderNum (π.χ.GenderNum_model), θα περιμέναμε να προκύψουν ακριβώς τα ίδια αποτελέσματα. Ας το δοκιμάσουμε στην πράξη.

Call:

lm(formula = Thumb ~ Gender, data = Fingers)

Coefficients:

(Intercept) Gendermale

58.256 6.447

Call:

lm(formula = Thumb ~ GenderNum, data = Fingers)

Coefficients:

(Intercept) GenderNum

51.809 6.447Ποια εκτίμηση παραμέτρου είναι διαφορετική στο μοντέλο της Gender έναντι του μοντέλου της GenderNum;

Σωστή απάντηση: Α - \(b_0\), η τιμή πρόβλεψης του μήκους αντίχειρα όταν \(X_i = 0\)

Σύγκριση παραμέτρων:

| Εκτίμηση παραμέτρου | Μοντέλο της Gender

|

Μοντέλο της GenderNum

|

Διαφορά; |

|---|---|---|---|

| \(b_0\) (σταθερός όρος) | 58.256 | 51.809 | ΝΑΙ ✓ (διαφορετικό) |

| \(b_1\) (κλίση) | 6.447 | 6.447 | ΟΧΙ (ίδιο) |

Η μόνη διαφορά είναι το \(b_0\) (σταθερός όρος)!

Κωδικοποίηση των μεταβλητών

Gender (factor):

Τύπος: Factor με 2 επίπεδα

-

Κωδικοποίηση στο μοντέλο:

female= 0 (ομάδα αναφοράς, αυτόματα από την R)male= 1

GenderNum (numeric):

Τύπος: Αριθμητική μεταβλητή (1 ή 2)

-

Κωδικοποίηση:

female= 1male= 2

Βασική διαφορά: Η Gender χρησιμοποιεί 0/1, ενώ η GenderNum χρησιμοποιεί 1/2. Αυτή η μετατόπιση κατά 1 μονάδα επηρεάζει τον σταθερό όρο!

Γιατί το \(b_0\) διαφέρει;

Ο σταθερός όρος \(b_0\) αντιπροσωπεύει την τιμή πρόβλεψης όταν \(X = 0\).

Μοντέλο της Gender (κωδικοποίηση 0/1):

\[\text{Thumb}_i = 58.256 + 6.447 \times \text{Gender}_{\text{male},i}\]

Όταν \(\text{Gender}_{\text{male}} = 0\) (δηλ.

female): \(\hat{Y} = 58.256\)Άρα το \(b_0 = 58.256\) είναι ο μέσος όρος για τις γυναίκες

Μοντέλο της GenderNum (κωδικοποίηση 1/2):

\[\text{Thumb}_i = 51.809 + 6.447 \times \text{GenderNum}_i\]

Όταν \(\text{GenderNum} = 0\) (υποθετική τιμή): \(\hat{Y} = 51.809\)

Αλλά η τιμή \(\text{GenderNum} = 0\) δεν υπάρχει στα δεδομένα!

Το \(b_0 = 51.809\) είναι η υποθετική τιμή που θα είχαμε αν υπήρχε \(\text{GenderNum} = 0\)

Επαλήθευση με τις πραγματικές προβλέψεις:

GenderNum=1 (female): \(\hat{Y} = 51.809 + 6.447 \times 1 = 58.256\) ✓GenderNum=2 (male): \(\hat{Y} = 51.809 + 6.447 \times 2 = 64.703\) ✓

Οι προβλέψεις ταιριάζουν με τους μέσους όρους των ομάδων!

Μαθηματική σχέση μεταξύ των μοντέλων

Μοντέλο της Gender (0/1):

\[Y = 58.256 + 6.447 \times X_{\text{Gender}}\]

Όπου \(X_{\text{`Gender`}} \in \{0, 1\}\)

Μοντέλο της GenderNum (1/2):

\[Y = 51.809 + 6.447 \times X_{\text{GenderNum}}\]

Όπου \(X_{\text{GenderNum}} \in \{1, 2\}\)

Παρατηρήστε ότι:

\[X_{\text{GenderNum}} = X_{\text{Gender}} + 1\]

Η GenderNum είναι η Gender μετατοπισμένη κατά 1.

Αντικαθιστώντας:

\[Y = 51.809 + 6.447 \times (X_{\text{Gender}} + 1)\]

\[Y = 51.809 + 6.447 \times X_{\text{Gender}} + 6.447\]

\[Y = (51.809 + 6.447) + 6.447 \times X_{\text{Gender}}\]

\[Y = 58.256 + 6.447 \times X_{\text{Gender}}\]

Ακριβώς το μοντέλο της Gender! ✓

Γενικός τύπος:

Όταν \(X_{\text{new}} = X_{\text{old}} + c\), τότε:

\[b_{0,\text{new}} = b_{0,\text{old}} - b_1 \times c\]

Στην περίπτωσή μας (\(c = 1\)):

\[b_{0,\text{GenderNum}} = b_{0,\text{Gender}} - 6.447 \times 1\]

\[51.809 = 58.256 - 6.447\] ✓

Γιατί το \(b_1\) παραμένει ίδιο;

Το \(b_1 = 6.447\) σε αμφότερα τα μοντέλα

Το \(b_1\) εκφράζει τη διαφορά μεταξύ των δύο ομάδων:

mean(Thumb ~ Gender, data = Fingers)

# female male

# 58.25641 64.70339

# Διαφορά

64.70339 - 58.25641

# [1] 6.44698 ≈ 6.447 ✓Αυτή η διαφορά δεν αλλάζει με την κωδικοποίηση!

Στη

Gender: Από 0 σε 1 (αύξηση 1 μονάδας) → +6.447 mmΣτη

GenderNum: Από 1 σε 2 (αύξηση 1 μονάδας) → +6.447 mm

Και στις δύο περιπτώσεις, μία μονάδα αύξησης αντιστοιχεί στη μετάβαση από female σε male, δηλαδή στην ίδια διαφορά.

Σύγκριση κωδικοποιήσεων

| Χαρακτηριστικό |

Gender (0/1) |

GenderNum (1/2) |

Σχόλιο |

|---|---|---|---|

Κωδικοποίηση female

|

0 | 1 | Διαφορά +1 |

Κωδικοποίηση male

|

1 | 2 | Διαφορά +1 |

| \(b_0\) | 58.256 | 51.809 | Διαφορά -6.447 |

| \(b_1\) | 6.447 | 6.447 | Ίδιο |

Πρόβλεψη female

|

58.256 | 58.256 | Ίδιο ✓ |

Πρόβλεψη male

|

64.703 | 64.703 | Ίδιο ✓ |

Παρατήρηση: Η διαφορά στο \(b_0\) είναι ακριβώς \(-b_1\), επειδή η κωδικοποίηση μετατοπίστηκε κατά +1.

Συμπέρασμα

Ποια εκτίμηση παραμέτρου διαφέρει;

Μόνο το \(b_0\) (σταθερός όρος) είναι διαφορετικό μεταξύ των δύο μοντέλων.

Γιατί διαφέρει το \(b_0\);

✓ Η Gender χρησιμοποιεί κωδικοποίηση 0/1 (female=0, male=1)

✓ Η GenderNum χρησιμοποιεί κωδικοποίηση 1/2 (female=1, male=2)

✓ Το \(b_0\) αντιπροσωπεύει την πρόβλεψη όταν \(X = 0\):

Στη

Gender: το \(X=0\) αντιστοιχεί σεfemale→ \(b_0 = 58.256\) (μέσος όροςfemale)Στη

GenderNum: το \(X=0\) είναι υποθετική τιμή (δεν υπάρχει) → \(b_0 = 51.809\)

✓ Η μετατόπιση της κωδικοποίησης κατά +1 προκαλεί αλλαγή στο \(b_0\) κατά \(-b_1\):

\[b_{0,\text{GenderNum}} = b_{0,\text{Gender}} - b_1 = 58.256 - 6.447 = 51.809\] ✓

Γιατί ΔΕΝ διαφέρει το \(b_1\);

✓ Το \(b_1\) εκφράζει τη διαφορά μεταξύ των ομάδων: male - female = 6.447 mm

✓ Αυτή η διαφορά είναι ανεξάρτητη από την κωδικοποίηση

✓ Και στα δύο μοντέλα, 1 μονάδα αύξηση στο \(X\) σημαίνει μετάβαση από female σε male

Τελική σύνοψη:

| Στοιχείο |

Gender (0/1) |

GenderNum (1/2) |

|---|---|---|

| \(b_0\) | 58.256 | 51.809 (διαφέρει κατά -6.447) |

| \(b_1\) | 6.447 | 6.447 (ίδιο) |

| Προβλέψεις | Ίδιες | Ίδιες |

Το \(b_0\) διαφέρει επειδή η κωδικοποίηση 1/2 “μετατοπίζει” το σημείο αναφοράς κατά 1 μονάδα, αλλά τα δύο μοντέλα περιγράφουν την ίδια σχέση και δίνουν ταυτόσημες προβλέψεις!

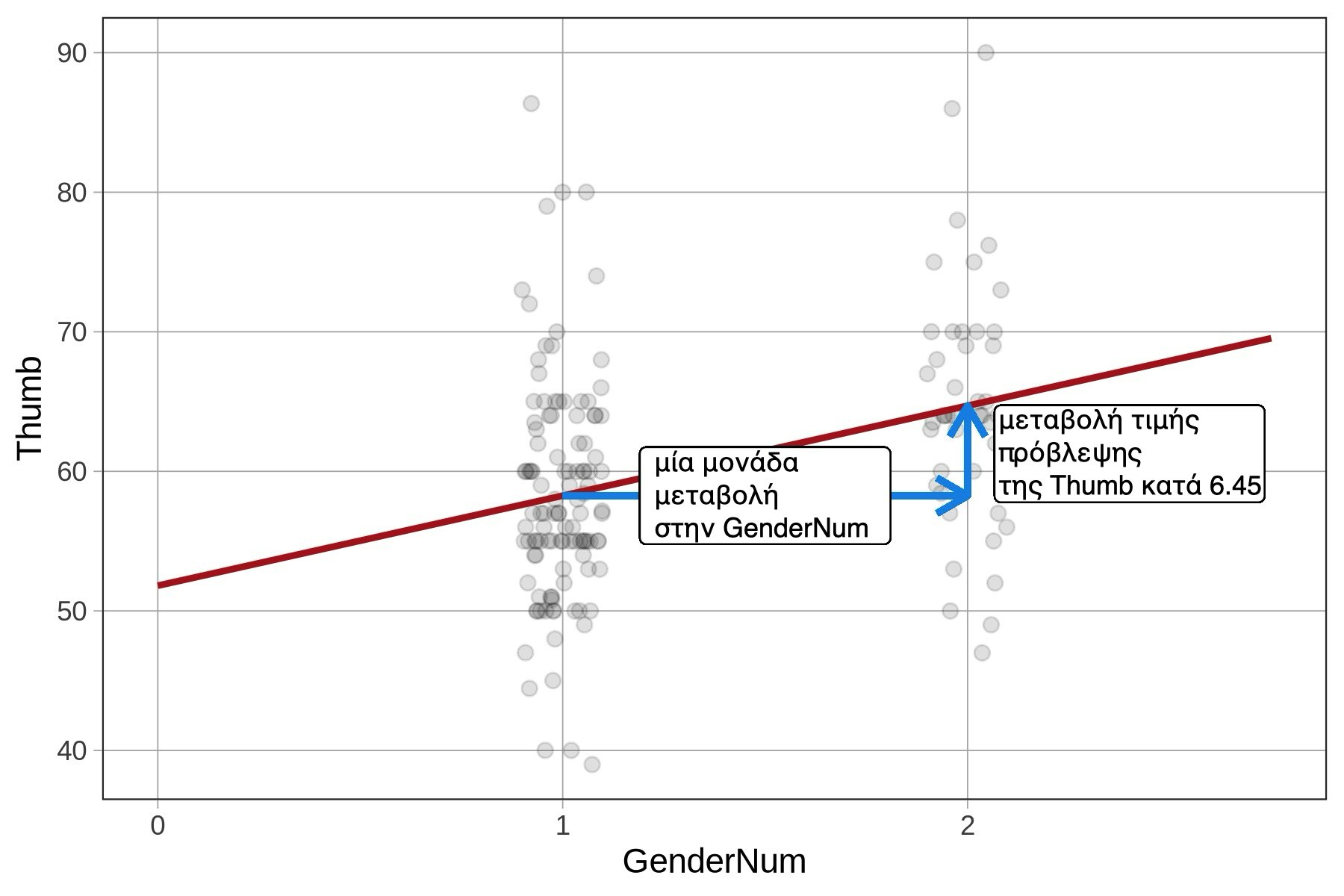

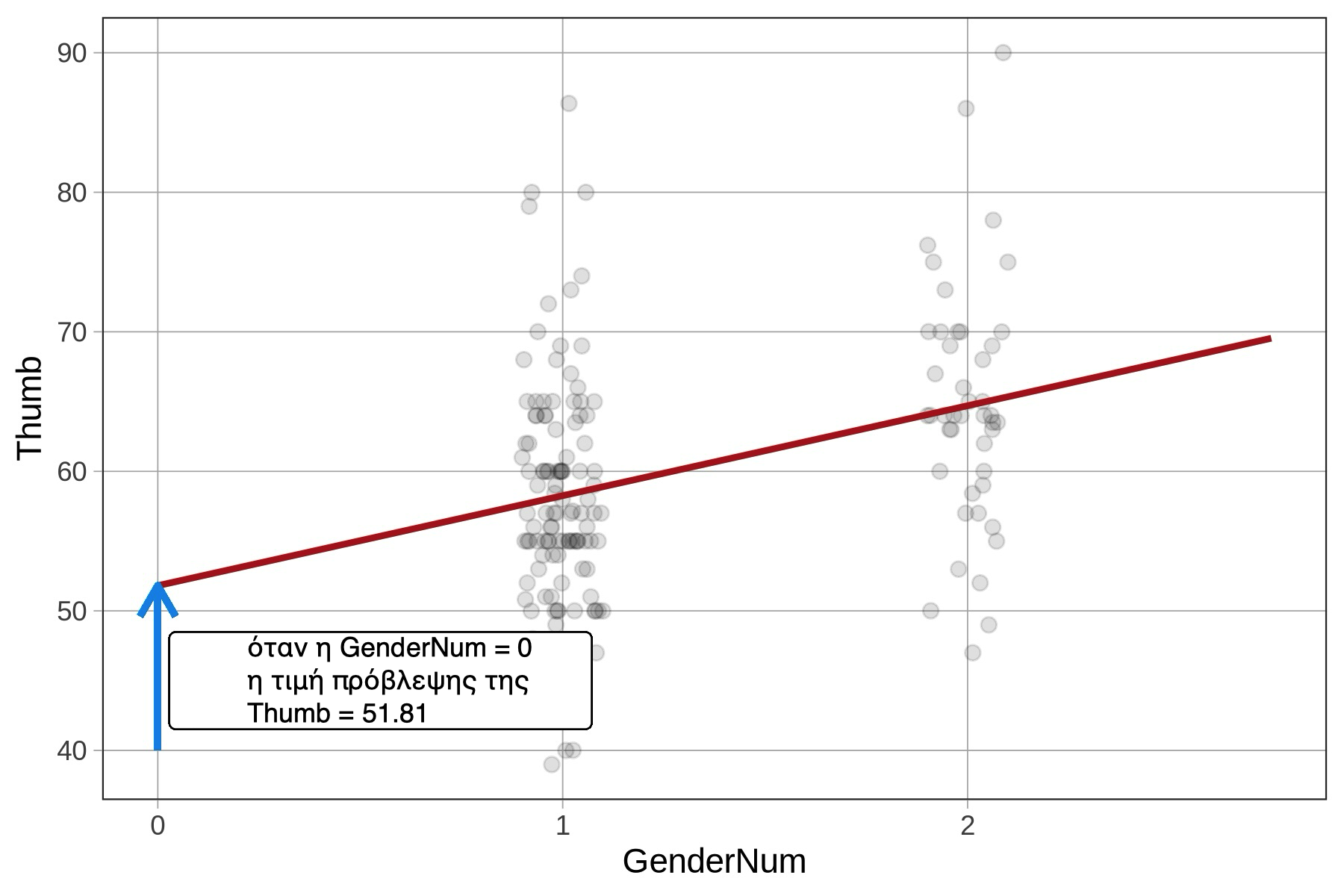

Γιατί οι εκτιμήσεις των παραμέτρων στο μοντέλο

GenderNumδεν είναι ίδιες με αυτές του μοντέλουGender;

Επειδή η Gender είναι ποιοτική μεταβλητή (δηλαδή τύπου factor), η συνάρτηση lm() προσαρμόζει ένα μοντέλο ομάδων. Αντίθετα, όταν χρησιμοποιούμε τη GenderNum, η lm() θεωρεί ότι η αριθμητική κωδικοποίηση (1 ή 2) αντιστοιχεί σε ποσοτική μεταβλητή. Εφόσον δεν δηλώσαμε ρητά ότι η GenderNum πρέπει να αντιμετωπιστεί ως ποιοτική, η lm() προσαρμόζει μια ευθεία παλινδρόμησης αντί για ένα μοντέλο δύο ομάδων. Ως αποτέλεσμα, η ερμηνεία των εκτιμήσεων της παλινδρόμησης διαφέρει από αυτήν που θα περιμέναμε σε ένα μοντέλο ομάδων.

H κλίση (\(b_1\)) θα είναι αριθμητικά ίδια με εκείνη του μοντέλου δύο ομάδων, καθώς εξακολουθεί να εκφράζει τη μεταβολή στο μήκος του αντίχειρα για μια μονάδα αύξησης της ανεξάρτητης μεταβλητής.

Για τη Gender, μια μεταβολή κατά μία μονάδα σημαίνει μετάβαση από το «όχι άνδρας» (\(X_i = 0\)) στο «άνδρας» (\(X_i = 1\)).

Για τη

Για τη GenderNum, η μεταβολή από το «όχι άνδρας» (\(X_i = 1\)) στο «άνδρας» (\(Χ_i = 2\)) έχει το ίδιο νόημα, αλλά το μοντέλο την αντιμετωπίζει ως συνεχή αριθμητική μεταβολή και όχι ως μέση διαφορά ανάμεσα σε ομάδες.

GenderNum

Ωστόσο, ο σταθερός όρος (\(b_0\)) θα είναι διαφορετικός στο μοντέλο με τη GenderNum, όπου αντιπροσωπεύει το σημείο τομής της ευθείας παλινδρόμησης με τον άξονα y, δηλαδή την τιμή πρόβλεψης του μήκους αντίχειρα όταν η μεταβλητή έχει τιμή 0. Αυτό, βέβαια, δεν έχει νόημα όταν υπάρχουν μόνο δύο ομάδες που έχουν κωδικοποιηθεί ως 1 και 2. Σε αυτή την περίπτωση, το αποτέλεσμα είναι ανεπιθύμητο μοντέλο παλινδρόμησης που προσαρμόστηκε κατά λάθος.

Gender

GenderNum

Τι νομίζεις ότι θα συνέβαινε αν κωδικοποιούσαμε τις ομάδες της

GenderNumως 0 και 1 αντί για 1 και 2; Γιατί;

10.5 Σφάλμα από το Μοντέλο της Height

Ανεξάρτητα από το είδος του μοντέλου, το σφάλμα του μοντέλου (ή υπόλοιπο, residual) υπολογίζεται πάντα με τον ίδιο τρόπο για κάθε παρατήρηση:

υπόλοιπο = παρατηρούμενη τιμή - τιμή πρόβλεψης

Θυμηθείτε και την εξίσωση ΔΕΔΟΜΕΝΑ = ΜΟΝΤΕΛΟ + ΣΦΑΛΜΑ. Ποια στοιχεία αυτής της εξίσωσης αντιστοιχούν στα μέρη της παραπάνω σχέσης;

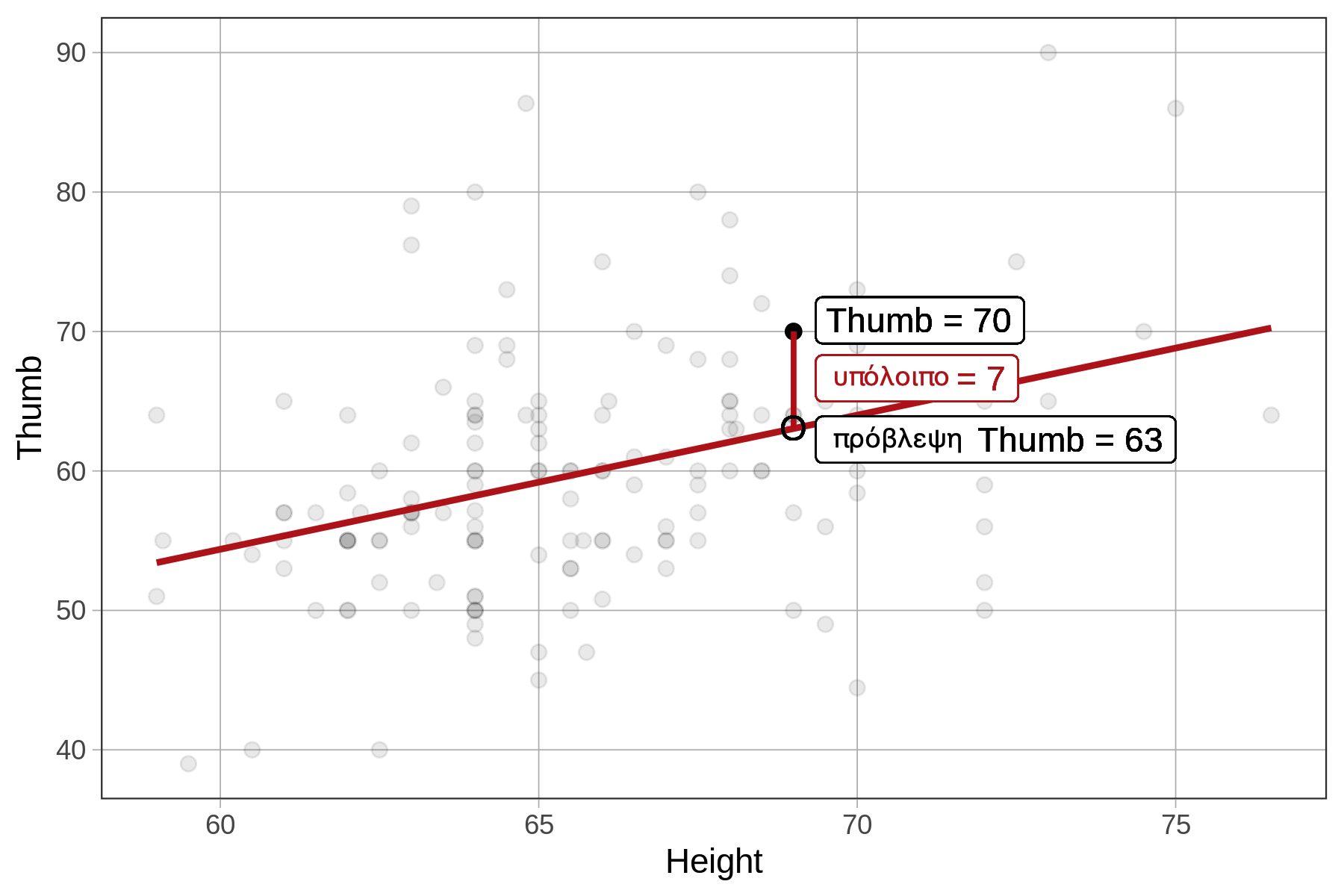

Για τα μοντέλα παλινδρόμησης, η τιμή πρόβλεψης της \(Y_i\) βρίσκεται επάνω στην ευθεία παλινδρόμησης. Συνεπώς, το σφάλμα (υπόλοιπο) υπολογίζεται ως η κατακόρυφη απόσταση μεταξύ της πραγματικής τιμής μιας παρατήρησης στον άξονα \(Y\) (την εξαρτημένη μεταβλητή) και της αντίστοιχης τιμής πρόβλεψης που δίνει η ευθεία παλινδρόμησης.

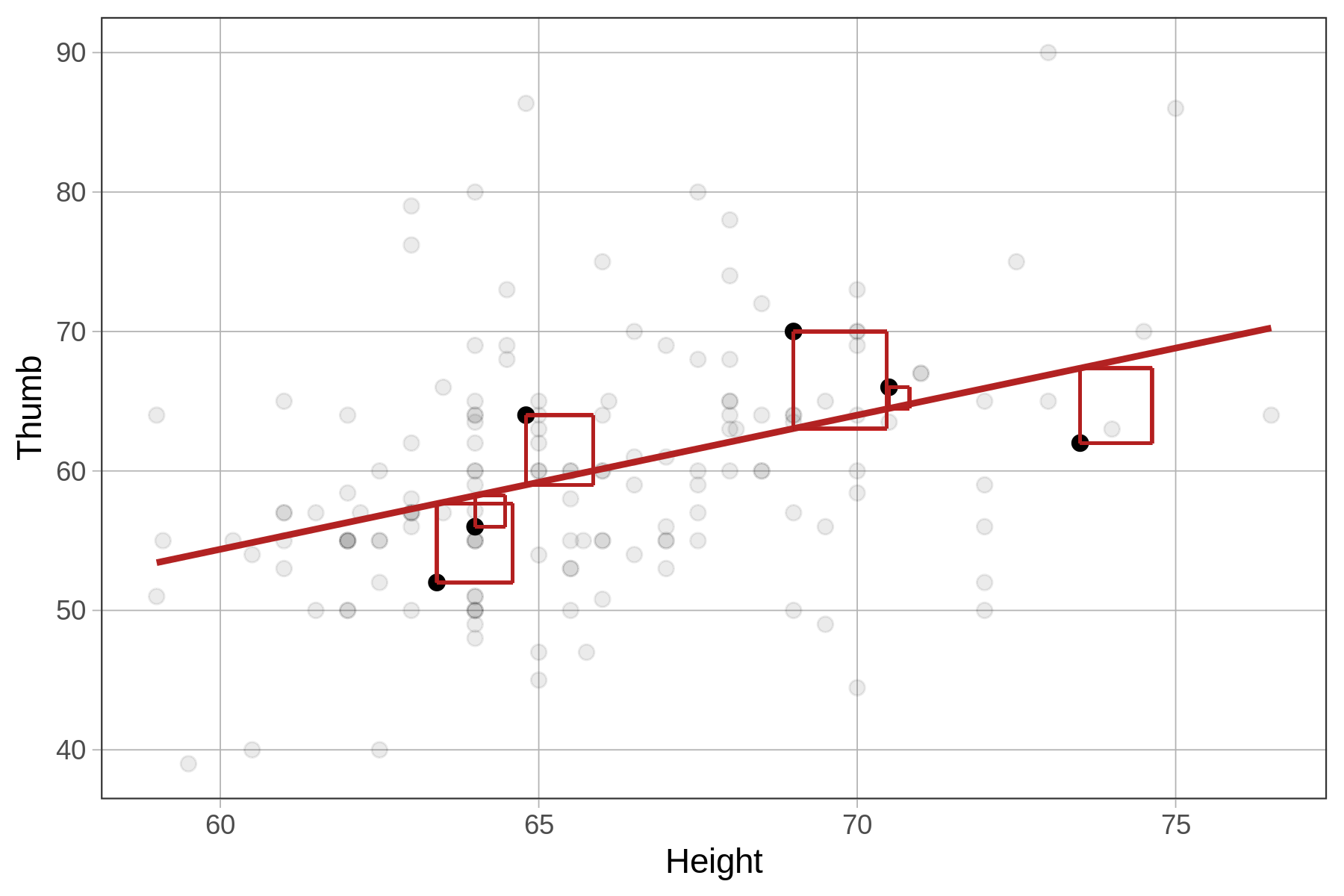

Στο παρακάτω διάγραμμα επισημαίνονται έξι παρατηρήσεις (σημεία με μαύρο χρώμα) και τα αντίστοιχα υπόλοιπά τους (οι κάθετες γραμμές με κόκκινο χρώμα) από το μοντέλο παλινδρόμησης της Height.

Σημειώστε ότι μια αρνητική τιμή υπολοίπου (που βρίσκεται κάτω από την ευθεία παλινδρόμησης) σημαίνει ότι η παρατηρούμενη τιμή του μήκους αντίχειρα (

Σημειώστε ότι μια αρνητική τιμή υπολοίπου (που βρίσκεται κάτω από την ευθεία παλινδρόμησης) σημαίνει ότι η παρατηρούμενη τιμή του μήκους αντίχειρα (Thumb) είναι μικρότερη από την τιμή πρόβλεψης του μήκους αντίχειρα, με βάση το ύψος του φοιτητή.

Τι σημαίνει μια θετικη τιμή υπολοίπου;

Τα υπόλοιπα από το μοντέλο της Height αντιπροσωπεύουν τη μεταβλητότητα του μήκους αντίχειρα (Thumb) που υπολείπεται αφού αφαιρεθεί το μέρος που μπορεί να εξηγηθεί από το ύψος.

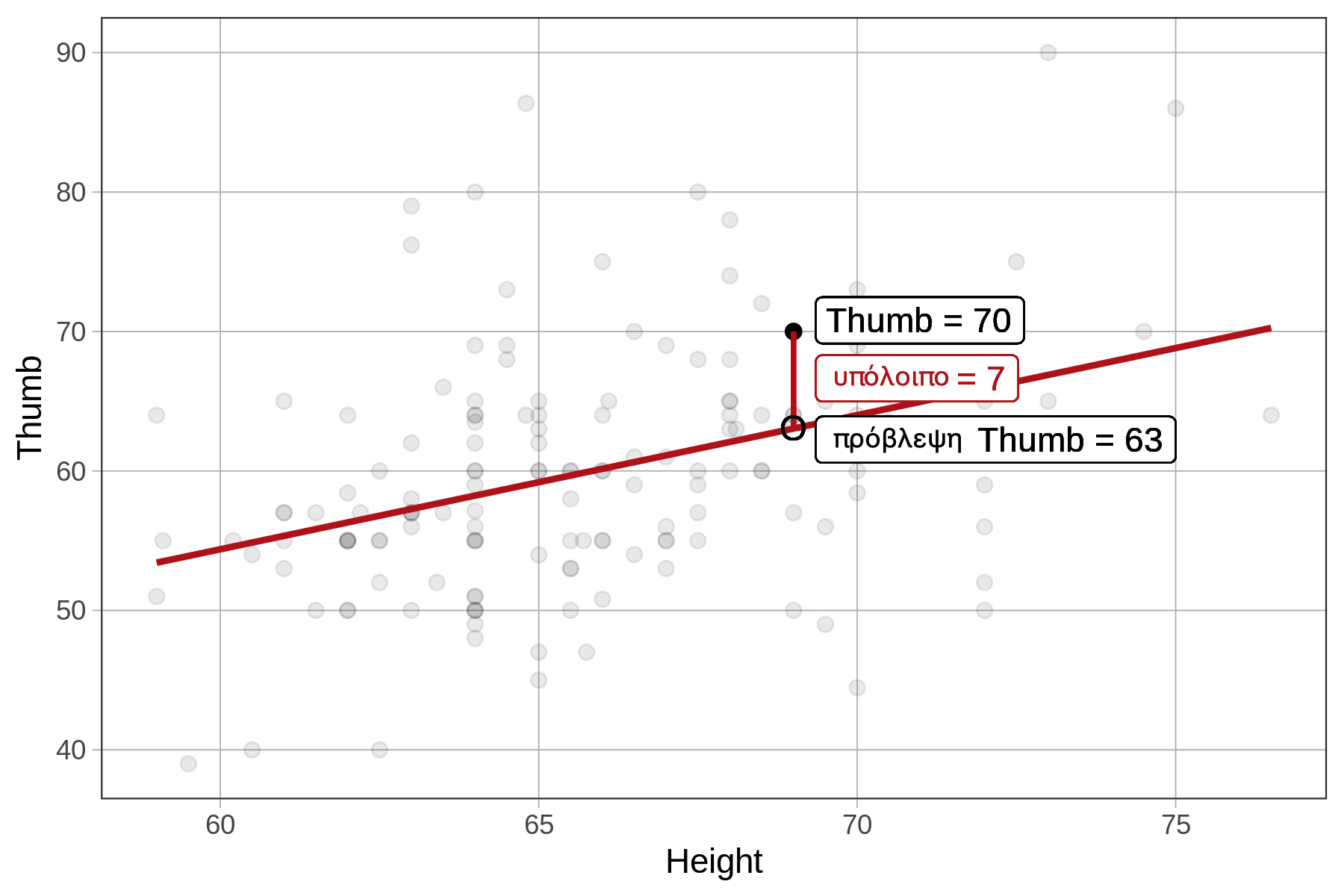

Για παράδειγμα, ας εξετάσουμε ένα συγκεκριμένο φοιτητή (που εμφανίζεται στο παρακάτω διάγραμμα) με μήκος αντίχειρα 70 mm. Ένα υπόλοιπο ίσο με 7 σημαίνει ότι ο αντίχειρας του φοιτητή είναι 7 mm μακρύτερος από αυτόν που θα είχε προβλεφθεί από το μοντέλο με βάση το ύψος του.

Με άλλα λόγια, μπορούμε να πούμε ότι, λαμβάνοντας υπόψη την επίδραση του ύψους (controlling for Height), ο αντίχειρας αυτού του φοιτητή είναι 7 mm μακρύτερος από το αναμενόμενο.

Ένα θετικό υπόλοιπο δείχνει ότι ο αντίχειρας είναι μακρύτερος από το αναμενόμενο για ένα άτομο αυτού του ύψους, ενώ ένα αρνητικό υπόλοιπο δείχνει ότι είναι κοντύτερος από το αναμενόμενο.

Αυτά τα υπόλοιπα μπορεί να μας οδηγήσουν στο ερώτημα: ποιοι άλλοι παράγοντες, πέρα από το ύψος θα μπορούσαν να εξηγήσουν αυτές τις διαφορές;

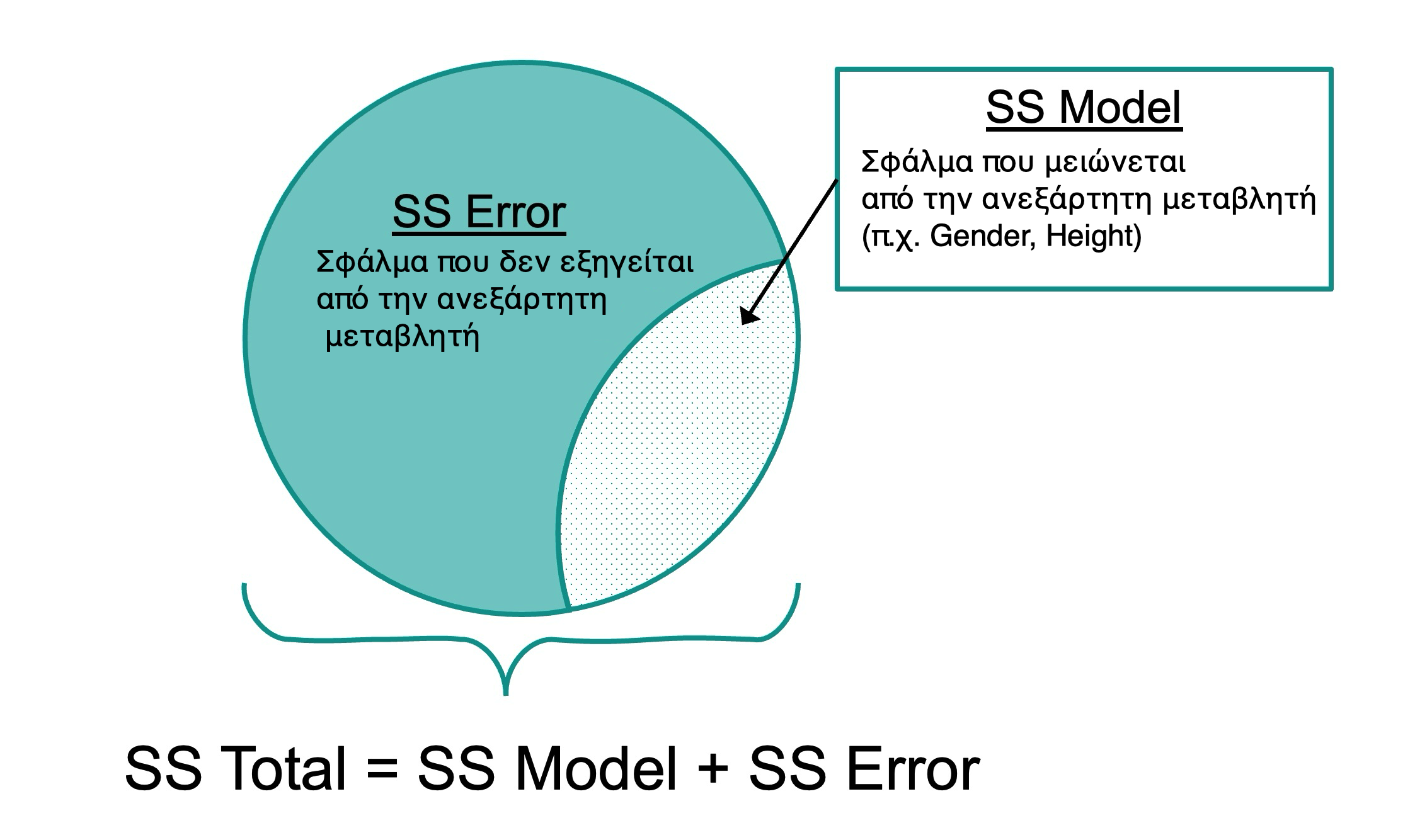

Άθροισμα Τετραγώνων Σφαλμάτων (SS Error) για το Μοντέλο του Ύψους

Όπως και στα άλλα μοντέλα που έχουμε δει (π.χ. το κενό μοντέλο και το μοντέλο ομάδων), η μετρική που χρησιμοποιούμε για να ποσοτικοποιήσουμε το συνολικό σφάλμα του μοντέλου της Height είναι το άθροισμα τετραγώνων των υπολοίπων (Sum of Squared Errors, ή SS Error).

Το SS Error υπολογίζεται από τα υπόλοιπα με τον ίδιο τρόπο όπως και στο μοντέλο ομάδων — δηλαδή, υψώνοντας κάθε υπόλοιπο στο τετράγωνο και στη συνέχεια αθροίζοντάς τα όλα (βλ. παρακάτω διάγραμμα).

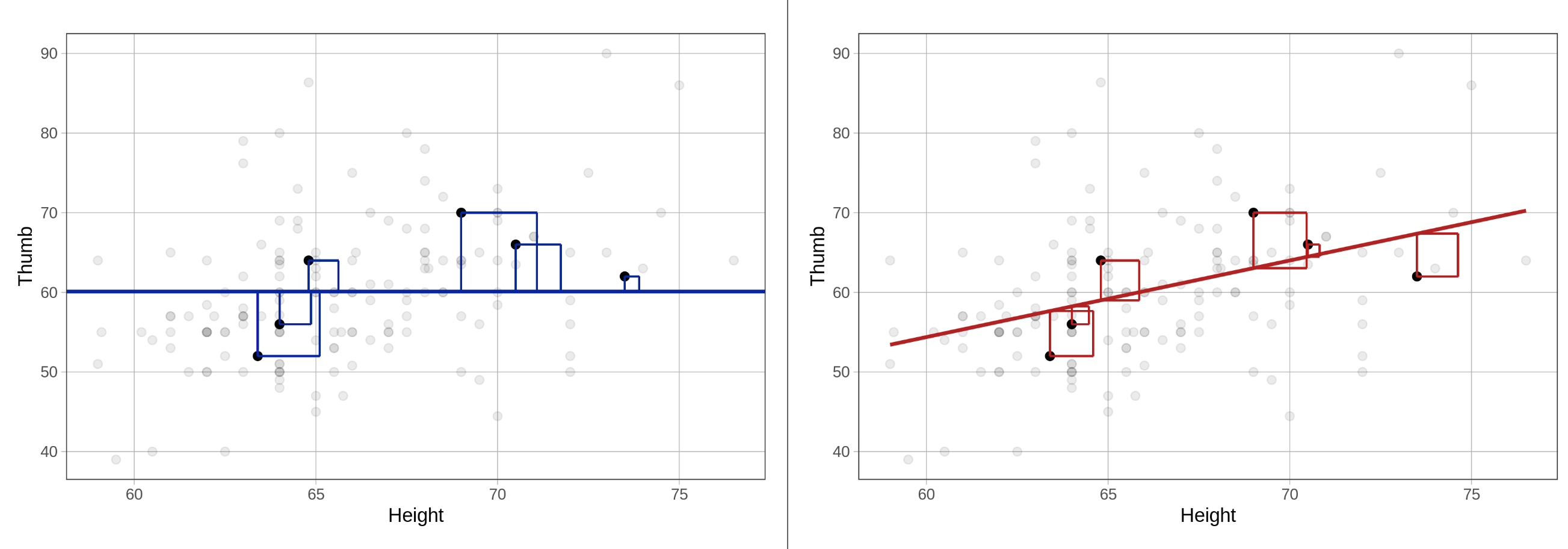

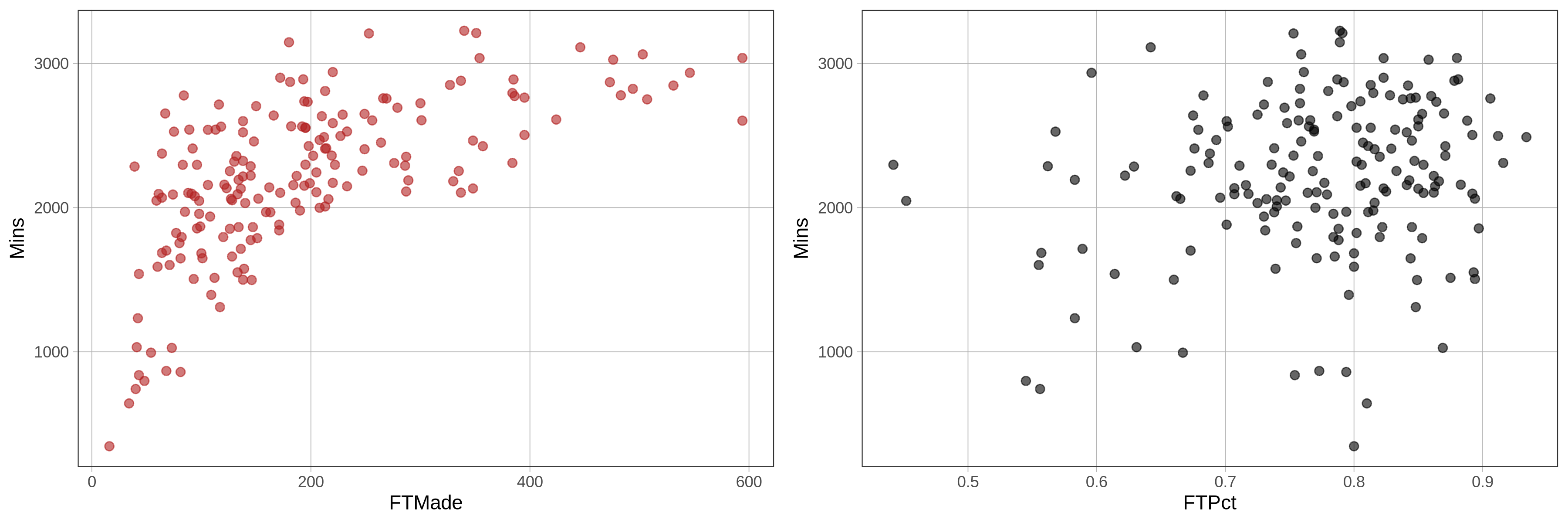

Να συγκρίνετε το άθροισμα τετραγώνων των υπολοίπων από το κενό μοντέλο (SS Total - SST) και το μοντέλο του ύψους (SS Error - SSE) για τις έξι παρατηρήσεις που φαίνονται στα παρακάτω διαγράμματα.

SS Total, Άθροισμα Τετραγώνων των Υπολοίπων από το κενό μοντέλο (αριστερά) και SS Error, Άθροισμα Τετραγώνων των Υπολοίπων από το μοντέλο της Height (δεξιά)Με βάση τα τετραγωνισμένα υπόλοιπα για αυτές τις 6 παρατηρήσεις, ποιο μοντέλο πιστεύετε ότι θα είχε μικρότερο άθροισμα τετραγώνων των υπολοίπων; Με άλλα λόγια, σε ποιο μοντέλο, κατά μέσο όρο, είναι τα τετράγωνα μικρότερα;

Σωστή απάντηση: Α — Το SSE φαίνεται μικρότερο για το μοντέλο του ύψους

Κατανόηση των όρων

Πρώτα, ας ξεκαθαρίσουμε την ορολογία:

SSE (Άθροισμα Τετραγώνων των Υπολοίπων ή των Σφαλμάτων):

Το άθροισμα των τετραγωνισμένων υπολοίπων για ένα συγκεκριμένο μοντέλο

Μετρά πόσο οι παρατηρήσεις αποκλίνουν από τις προβλέψεις του μοντέλου

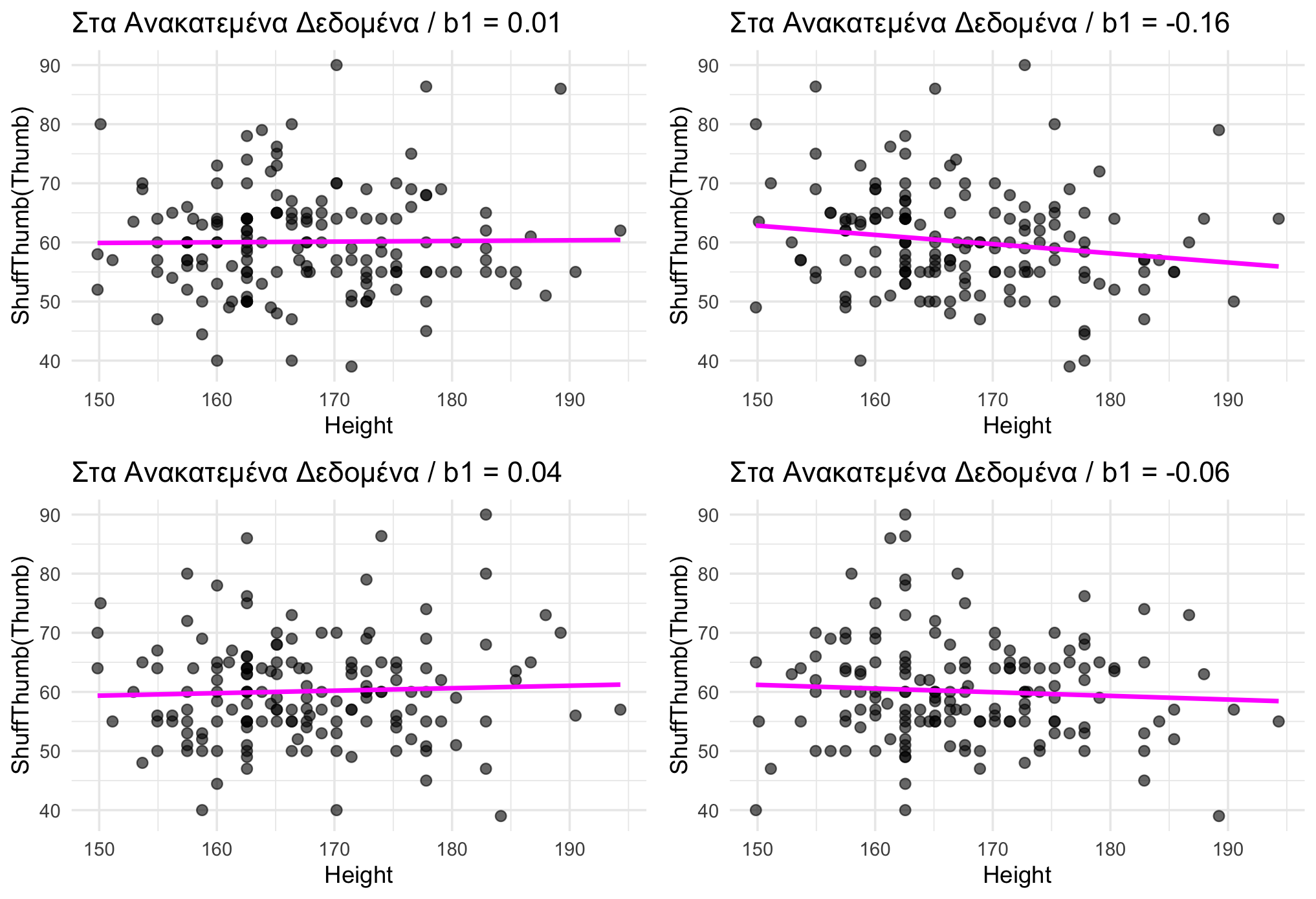

Όσο μικρότερο το SSE, τόσο καλύτερα προβλέπει το μοντέλο