7 Κεφάλαιο: Ποσοτικοποίηση του Σφάλματος

Μια κατά προσέγγιση απάντηση στο σωστό πρόβλημα αξίζει πολύ περισσότερο από μια σωστή απάντηση σε ένα κατά προσέγγιση πρόβλημα.

— John Tukey

7.1 Ποσοτικοποίηση του Συνολικού Σφάλματος ενός Μοντέλου

Μέχρι στιγμής έχουμε αναπτύξει την ιδέα ότι ένα στατιστικό μοντέλο μπορεί να θεωρηθεί ως ένας αριθμός—μία τιμή της εξαρτημένης μεταβλητής. Στην ουσία προσπαθούμε να μοντελοποιήσουμε τη Διαδικασία Παραγωγής Δεδομένων (ΔΠΔ). Επειδή όμως δεν μπορούμε να έχουμε απευθείας πρόσβαση στη ΔΠΔ, προσαρμόζουμε ένα μοντέλο στα δεδομένα που διαθέτουμε και εκτιμούμε τις παραμέτρους του.

Με βάση τη λεκτική εξίσωση ΔΕΔΟΜΕΝΑ = ΜΟΝΤΕΛΟ + ΣΦΑΛΜΑ, έχουμε ορίσει το σφάλμα ως το υπόλοιπο που παραμένει αφότου αφαιρέσουμε το μοντέλο από τα δεδομένα. Στην περίπτωση του απλού μας μοντέλου για μια ποσοτική εξαρτημένη μεταβλητή, το μοντέλο είναι ο μέσος όρος, και το σφάλμα—ή υπόλοιπο—είναι η απόκλιση κάθε τιμής πάνω ή κάτω από το μέσο όρο.

Αναπαριστούμε το κενό μοντέλο με τη σημειολογία του Γενικού Γραμμικού Μοντέλου:

\[Y_i = b_0 + e_i\]

Αυτή η εξίσωση αναπαριστά κάθε τιμή στα δεδομένα μας ως το άθροισμα δύο μερών: του μέσου όρου της κατανομής (αναπαρίσταται από το \(b_0\)), και της απόκλισης της τιμής πάνω ή κάτω από το μέσο όρο (αναπαρίσταται ως \(e_i\)). Με άλλα λόγια, ΔΕΔΟΜΕΝΑ = ΜΟΝΤΕΛΟ + ΣΦΑΛΜΑ.

Σε αυτό το κεφάλαιο, θα εμβαθύνουμε στο ΣΦΑΛΜΑ. Συγκεκριμένα, θα αναπτύξουμε μεθόδους για την ποσοτικοποίηση του συνολικού σφάλματος γύρω από ένα μοντέλο, και για τη μοντελοποίηση της κατανομής του σφάλματος αυτού καθαυτού.

Η ποσοτικοποίηση του συνολικού σφάλματος θα μας βοηθήσει να συγκρίνουμε μοντέλα για να δούμε ποιο εξηγεί περισσότερη μεταβλητότητα. Η μοντελοποίηση της κατανομής του σφάλματος θα μας βοηθήσει να κάνουμε πιο λεπτομερείς προβλέψεις για μελλοντικές παρατηρήσεις και πιο ακριβείς δηλώσεις για τη ΔΠΔ.

Εξαρχής, αξίζει να υπενθυμίσουμε την πεμπτουσία της στατιστικής ανάλυσης: την εξήγηση της μεταβλητότητας. Αφού δημιουργήσουμε ένα μοντέλο, μπορούμε να σκεφτούμε την εξήγηση της μεταβλητότητας με έναν νέο τρόπο: ως μείωση του σφάλματος γύρω από τις προβλέψεις του μοντέλου.

Έχουμε δει στο προηγούμενο κεφάλαιο ότι ο μέσος όρος είναι το καλύτερο μοντέλο μιας ποσοτικής εξαρτημένης μεταβλητής όταν η διασπορά της κατανομής είναι μικρότερη παρά όταν είναι μεγαλύτερη. Όταν η διασπορά είναι μικρότερη, τα υπόλοιπα από το μοντέλο είναι μικρότερα. Η ποσοτικοποίηση του συνολικού σφάλματος γύρω από ένα μοντέλο θα μας βοηθήσει να γνωρίζουμε πόσο καλά είναι τα μοντέλα μας, και ποια μοντέλα είναι καλύτερα από άλλα.

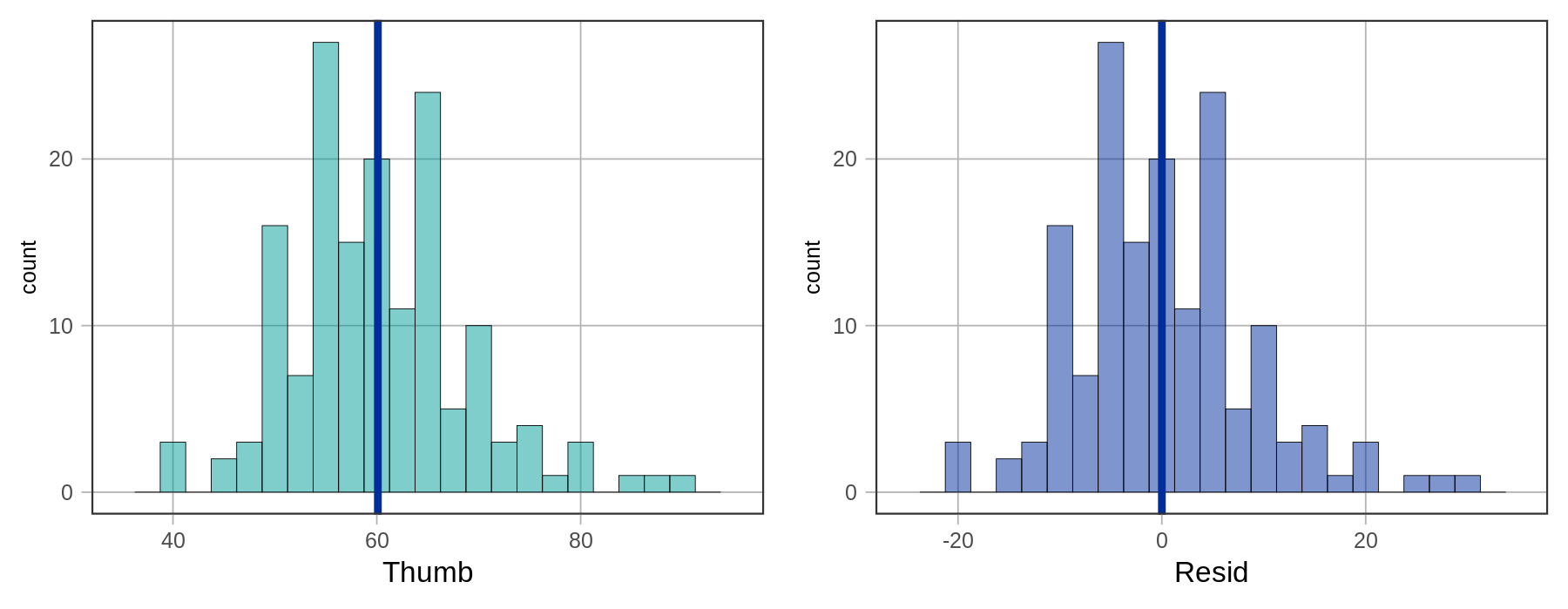

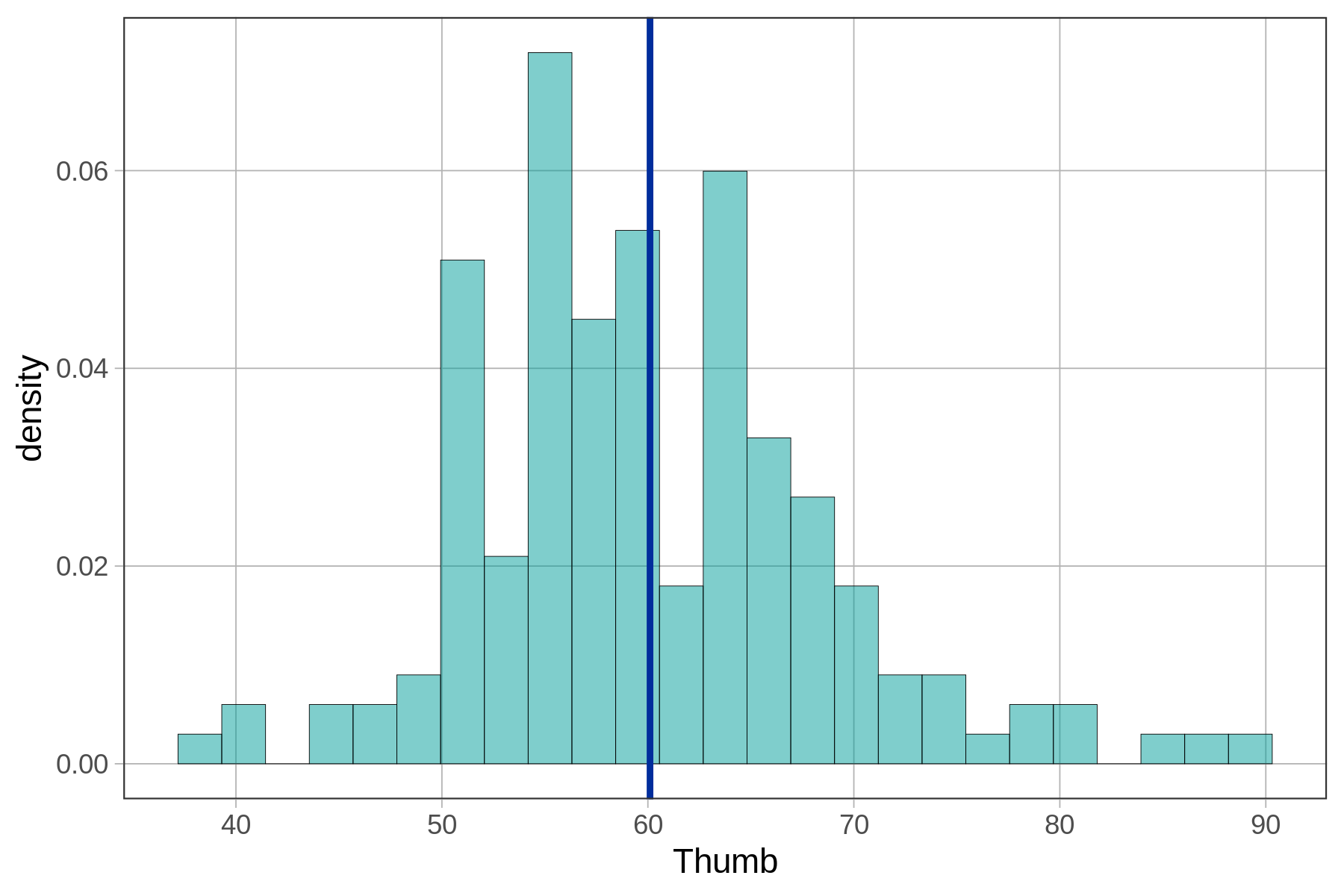

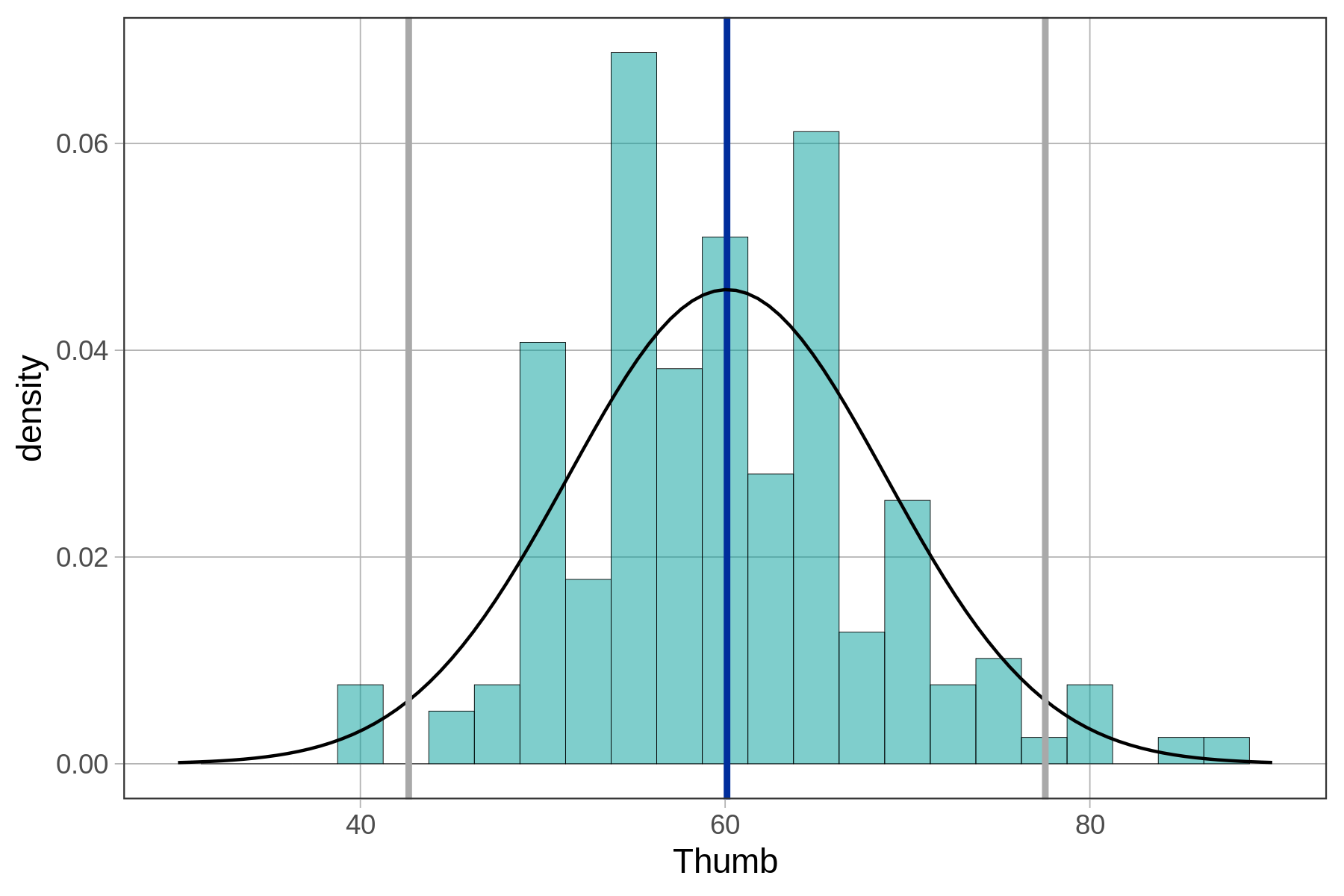

Άθροιση των Υπολοίπων

Τα παρακάτω ιστογράμματα δείχνουν την κατανομή του μήκους αντίχειρα φοιτητών (Thumb) και την κατανομή των υπολοίπων (Resid) για το σύνολο δεδομένων μας. Όπως εξηγήθηκε προηγουμένως, αυτές οι κατανομές έχουν ακριβώς το ίδιο σχήμα, αλλά διαφορετικούς μέσους όρους.

Όπως φαίνεται, έχει νόημα να χρησιμοποιήσουμε τα υπόλοιπα για την ανάλυση του σφάλματος του μοντέλου. Αν θέλουμε να ποσοτικοποιήσουμε το συνολικό σφάλμα, γιατί να μην αθροίσουμε απλώς όλα τα υπόλοιπα; Τα χειρότερα μοντέλα αναμένεται να έχουν μεγαλύτερο σφάλμα, άρα το άθροισμα όλων των σφαλμάτων θα πρέπει να αναπαριστά το «συνολικό» σφάλμα. Το πρόβλημα με αυτήν την προσέγγιση, όπως συζητήθηκε προηγουμένως, είναι ότι το άθροισμα των υπολοίπων γύρω από το μέσο όρο θα είναι πάντα 0. Ο παρακάτω κώδικας θα προσθέσει όλα τα υπόλοιπα από ένα κενό μοντέλο (empty_model).

Γιατί το άθροισμα των υπολοίπων ισούται με 0;

Επειδή ο μέσος όρος εξισορροπεί τα υπόλοιπα είναι η σωστή απάντηση.

Μαθηματική απόδειξη:

Στο κενό μοντέλο:

\[Y_i = b_0 + e_i\]

όπου \(b_0 = \bar{Y}\) (μέσος όρος)

Το υπόλοιπο για κάθε παρατήρηση:

\[e_i = Y_i - b_0 = Y_i - \bar{Y}\]

Άθροισμα όλων των υπολοίπων:

\[\sum_{i=1}^{n} e_i = \sum_{i=1}^{n} (Y_i - \bar{Y})\]

\[= \sum_{i=1}^{n} Y_i - \sum_{i=1}^{n} \bar{Y}\]

\[= \sum_{i=1}^{n} Y_i - n\bar{Y}\]

Αφού \(\bar{Y} = \frac{1}{n}\sum_{i=1}^{n} Y_i\), έχουμε \(n\bar{Y} = \sum_{i=1}^{n} Y_i\):

\[\sum_{i=1}^{n} e_i = \sum_{i=1}^{n} Y_i - \sum_{i=1}^{n} Y_i = 0\]

Αυτό ισχύει ΠΑΝΤΑ στο κενό μοντέλο, ανεξάρτητα από το μέγεθος των δεδομένων ή την πολυπλοκότητα.

Γιατί οι άλλες επιλογές είναι λάθος:

Α - “Μικρό σύνολο δεδομένων” - ΛΑΘΟΣ:

Το μέγεθος του δείγματος δεν επηρεάζει αυτή την ιδιότητα

Ισχύει για n=3 όσο και για n=10,000

Είναι μαθηματική ιδιότητα του μέσου όρου

Β - “Λανθασμένος υπολογισμός” - ΛΑΘΟΣ:

Τα υπόλοιπα υπολογίζονται σωστά ως \(Y_i - \bar{Y}\)

Το άθροισμα 0 είναι αναμενόμενο, όχι σφάλμα

Αν το άθροισμα ΔΕΝ ήταν 0, τότε θα υπήρχε σφάλμα

Δ - “Πολύ απλό μοντέλο” - ΛΑΘΟΣ:

Η ιδιότητα ισχύει σε όλα τα γραμμικά μοντέλα που περιλαμβάνουν τον σταθερό όρο

Ακόμα και σε πολύπλοκα μοντέλα: \(\sum e_i = 0\)

Δεν σχετίζεται με την πολυπλοκότητα του μοντέλου

Εννοιολογική εξήγηση:

Ο μέσος όρος ως σημείο ισορροπίας:

Ο μέσος όρος είναι το κέντρο βάρους των δεδομένων

Θετικές αποκλίσεις (πάνω από το μέσο) εξισορροπούνται από αρνητικές (κάτω από το μέσο)

Το άθροισμα των αποκλίσεων είναι πάντα μηδέν

Οι στατιστικολόγοι έχουν διερευνήσει διάφορες μεθόδους για τον ποσοτικό προσδιορισμό του σφάλματος γύρω από έναν μέσο όρο. Δύο από τις πιο συνηθισμένες, τις οποίες θα συζητήσουμε εδώ, είναι το Άθροισμα των Απόλυτων Αποκλίσεων (Sum of Absolute Deviations - SAD) και το Άθροισμα Τετραγώνων των Αποκλίσεων (Sum of Squared Deviations - SS). Ας δούμε καθεμία από αυτές.

Άθροισμα Απόλυτων Αποκλίσεων

Το άθροισμα των απόλυτων αποκλίσεων ξεπερνά το πρόβλημα ότι οι αποκλίσεις γύρω από το μέσο όρο πάντα αθροίζουν στο 0, υπολογίζοντας την απόλυτη τιμή των αποκλίσεων πριν τις αθροίσει.

\[\sum_{i=1}^{n} |Y_i - \bar{Y} |\]

Ποια από τις παρακάτω μαθηματικές εκφράσεις αντιπροσωπεύει τις αποκλίσεις (deviations);

Για να υπολογίσετε το Άθροισμα των Απόλυτων Αποκλίσεων, ποια είναι η σωστή σειρά των πράξεων;

Σε αυτό το πλαίσιο, οι «αποκλίσεις από το μέσο όρο» είναι το ίδιο με τα «υπόλοιπα από το κενό μοντέλο», δεδομένου ότι ο μέσος όρος είναι το μοντέλο μας. Έχουμε ήδη τις αποκλίσεις του μήκους κάθε αντίχειρα από το μέσο όρο στη στήλη Resid του πλαισίου δεδομένων Fingers.

Μπορούμε να υπολογίσουμε την απόλυτη τιμή κάθε απόκλισης από το μέσο όρο με τη συνάρτηση abs() .

Αυτό θα εμφανίσει την απόλυτη τιμή όλων των υπολοίπων (υπάρχουν 157 από αυτά). Για να υπολογίσουμε το άθροισμα, μπορούμε να χρησιμοποιήσουμε τη συνάρτηση sum() γύρω από την abs(Fingers$Resid). Δοκιμάστε το στον παρακάτω κώδικα.

1052.437Αν έπρεπε να γράψετε μία γραμμή κώδικα για να εκφράσετε το Άθροισμα των Απόλυτων Αποκλίσεων (SAD), ποια θα ήταν;

sum(abs(resid(empty_model))) είναι η σωστή απάντηση.

Ανάλυση της μαθηματικής έκφρασης:

Η μαθηματική έκφραση είναι: \(\sum_{i=1}^{n}|Y_i - \bar{Y}|\)

Αναλύοντας από μέσα προς τα έξω:

-

\(Y_i - \bar{Y}\): Αποκλίσεις (deviations)

Στην R:

resid(empty_model)Τα υπόλοιπα είναι ακριβώς αυτό: παρατηρούμενες τιμές μείον μέσος όρος

-

\(|Y_i - \bar{Y}|\): Απόλυτες αποκλίσεις (absolute deviations)

Στην R:

abs(resid(empty_model))Η

abs()παίρνει την απόλυτη τιμή κάθε υπολοίπου

-

\(\sum_{i=1}^{n}|Y_i - \bar{Y}|\): Άθροισμα απόλυτων αποκλίσεων

Στην R:

sum(abs(resid(empty_model)))Η

sum()αθροίζει όλες τις απόλυτες τιμές των αποκλίσεων

Γιατί οι άλλες επιλογές είναι λάθος:

Β - abs(sum(resid(empty_model))) - ΛΑΘΟΣ:

Λάθος σειρά: Πρώτα αθροίζει, μετά παίρνει απόλυτη τιμή

Αφού \(\sum resid = 0\), το

abs(0) = 0Δεν υπολογίζει το άθροισμα των απόλυτων αποκλίσεων

Γ - sum(resid(abs(empty_model))) - ΛΑΘΟΣ:

Συντακτικό σφάλμα: Η

abs()δεν μπορεί να εφαρμοστεί στο μοντέλοΗ

abs()χρειάζεται αριθμητικά δεδομένα, όχι αντικείμενο μοντέλουΗ R θα εμφανίσει σφάλμα

Δ - resid(abs(sum(empty_model))) - ΛΑΘΟΣ:

Πολλαπλά σφάλματα στη σύνταξη

Η

sum()δεν εφαρμόζεται σε αντικείμενο μοντέλουΗ

resid()δεν εφαρμόζεται σε αριθμόΕντελώς λανθασμένη λογική

Τι μετράει το SAD:

Άθροισμα Απόλυτων Αποκλίσεων (SAD):

Συνολική απόκλιση από το μέσο όρο

Μέτρο διασποράς: Πόσο “διεσπαρμένα” είναι τα δεδομένα

Συμπέρασμα:

Η σωστή σειρά των υπολογισμών είναι:

Υπολογισμός αποκλίσεων:

resid(empty_model)Απόλυτη τιμή:

abs(...)Άθροισμα:

sum(...)

Αυτό δίνει: sum(abs(resid(empty_model))) - η μόνη επιλογή που ακολουθεί τη σωστή μαθηματική σειρά και σύνταξη.

Άθροισμα Τετραγώνων των Αποκλίσεων

Ένας άλλος τρόπος να ποσοτικοποιήσουμε το συνολικό σφάλμα είναι υψώσουμε τις αποκλίσεις (δηλαδή, τα υπόλοιπα) στο τετράγωνο και στη συνέχεια να τα αθροίσουμε. (Επειδή η ύψωση στο τετράγωνο θα έχει ως αποτέλεσμα έναν θετικό αριθμό ανεξάρτητα από το πρόσημο της αρχικής τιμής, δεν είναι απαραίτητο να υπολογίσουμε πρώτα την απόλυτη τιμή.)

\[\sum_{i=1}^{n} (Y_i - \bar{Y})^2\]

Έχουμε ήδη υπολογίσει τα υπόλοιπα και τα έχουμε αποθηκεύσει σε μια στήλη-μεταβλητή με το όνομα Resid. Για να τετραγωνίσουμε τα υπόλοιπα, μπορούμε να χρησιμοποιήσουμε τον παρακάτω κώδικα. (Σημειώστε ότι στην R χρησιμοποιούμε το σύμβολο ^ για να αναπαραστήσουμε εκθέτες, το οποίο συνήθως βρίσκεται πάνω από το 6 σε ένα τυπικό πληκτρολόγιο.)

Fingers$Resid^2Η εκτέλεση του παραπάνω κώδικα θα παράγει μια λίστα με 157 τιμές υπολοίπων στο τετράγωνο. Τροποποιήστε τον παρακάτω κώδικα με τη χρήση της sum() για να λάβετε το άθροισμα τετραγώνων των υπολοίπων.

11880.21Αν έπρεπε να γράψετε μία γραμμή κώδικα για να εκφράσετε το άθροισμα τετραγώνων των υπολοίπων, ποια θα ήταν;

sum(resid(empty_model)^2) είναι η σωστή απάντηση.

Ανάλυση της μαθηματικής έκφρασης:

Η μαθηματική έκφραση είναι: \(\sum_{i=1}^{n}(Y_i - \bar{Y})^2\)

Αναλύοντας βήμα προς βήμα:

-

\((Y_i - \bar{Y})\): Αποκλίσεις (deviations)

- Στην R:

resid(empty_model)

- Στην R:

-

\((Y_i - \bar{Y})^2\): τετραγωνικές αποκλίσεις (squared deviations)

- Στην R:

resid(empty_model)^2

- Στην R:

-

\(\sum_{i=1}^{n}(Y_i - \bar{Y})^2\): Άθροισμα τετραγώνων των αποκλίσεων

- Στην R:

sum(resid(empty_model)^2)

- Στην R:

Γιατί οι άλλες επιλογές είναι λάθος:

Α - sum(resid(empty_model))^2 - ΛΑΘΟΣ:

Λάθος σειρά: Πρώτα αθροίζει τα υπόλοιπα, μετά υψώνει στο τετράγωνο

Αφού \(\sum resid = 0\), το \((0)^2 = 0\)

Δεν υπολογίζει το άθροισμα των τετραγώνων

Β - sum(abs(empty_model)^2) - ΛΑΘΟΣ:

Συντακτικό σφάλμα: Η

abs()και το^2δεν μπορούν να εφαρμοστούν στο μοντέλοΤο

empty_modelείναι αντικείμενο μοντέλου, όχι αριθμητικά δεδομέναΜη έγκυρη σύνταξη στην R

Δ - resid(sum(empty_model))^2 - ΛΑΘΟΣ:

Εντελώς λανθασμένη λογική

Η

sum()δεν εφαρμόζεται σε αντικείμενο μοντέλουΗ

resid()δεν εφαρμόζεται σε αριθμό

Τι μετράει το SS:

Άθροισμα Τετραγώνων των Υπολοίπων (SS):

Μέτρο συνολικής διασποράς των δεδομένων

Βάση για υπολογισμό του δείκτη της διακύμανσης

Συμπέρασμα:

Για να υπολογίσουμε το Άθροισμα Τετραγώνων των Υπολοίπων, χρειαζόμαστε:

Τα υπόλοιπα:

resd(empty_model)Ύψωση στο τετράγωνο:

...^2Άθροισμα:

sum(...)

Η μόνη επιλογή που ακολουθεί τη σωστή σειρά είναι: sum(resid(empty_model)^2)

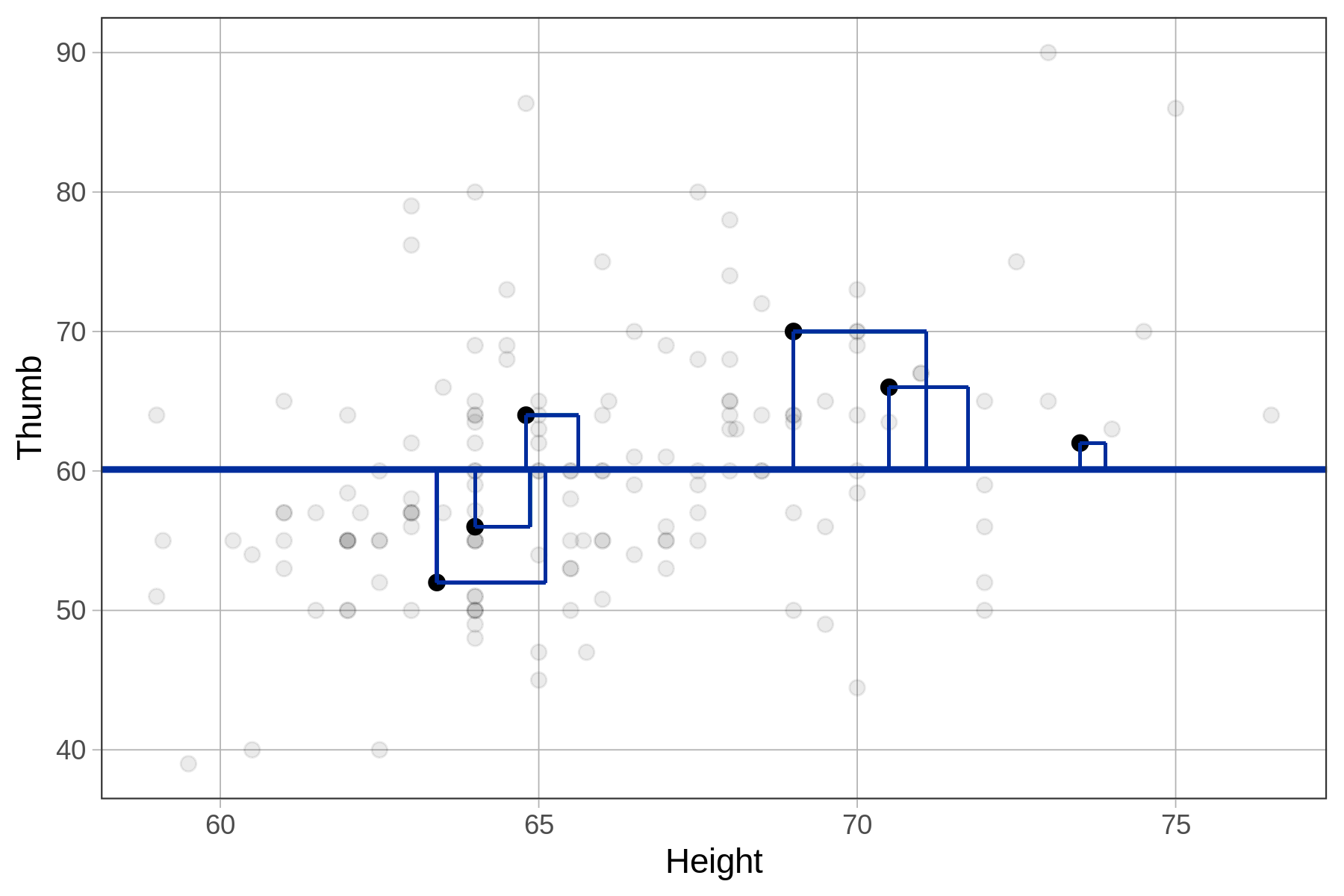

Αν χρησιμοποιήσουμε το μέγεθος ενός υπολοίπου για να δημιουργήσουμε ένα τετράγωνο, η περιοχή αυτού του τετραγώνου αναπαριστά το μέγεθος του τετραγωνισμένου υπολοίπου (βλ. παρακάτω Διάγραμμα). Ενώ τα μήκη αντίχειρα στα δεδομένα Fingers μετρώνται σε χιλιοστά, τα τετραγωνικά υπόλοιπα μετρώνται σε τετραγωνικά χιλιοστά.

Μπορούμε να σκεφτούμε το Άθροισμα Τετραγώνων (SS) ως το συνολικό εμβαδόν των τετραγώνων για όλα τα υπόλοιπα στο σύνολο δεδομένων. Το Άθροισμα Τετραγώνων είναι ένας σημαντικός δείκτης της ποσότητας του σφάλματος που υπάρχει γύρω από τις προβλέψεις ενός μοντέλου.

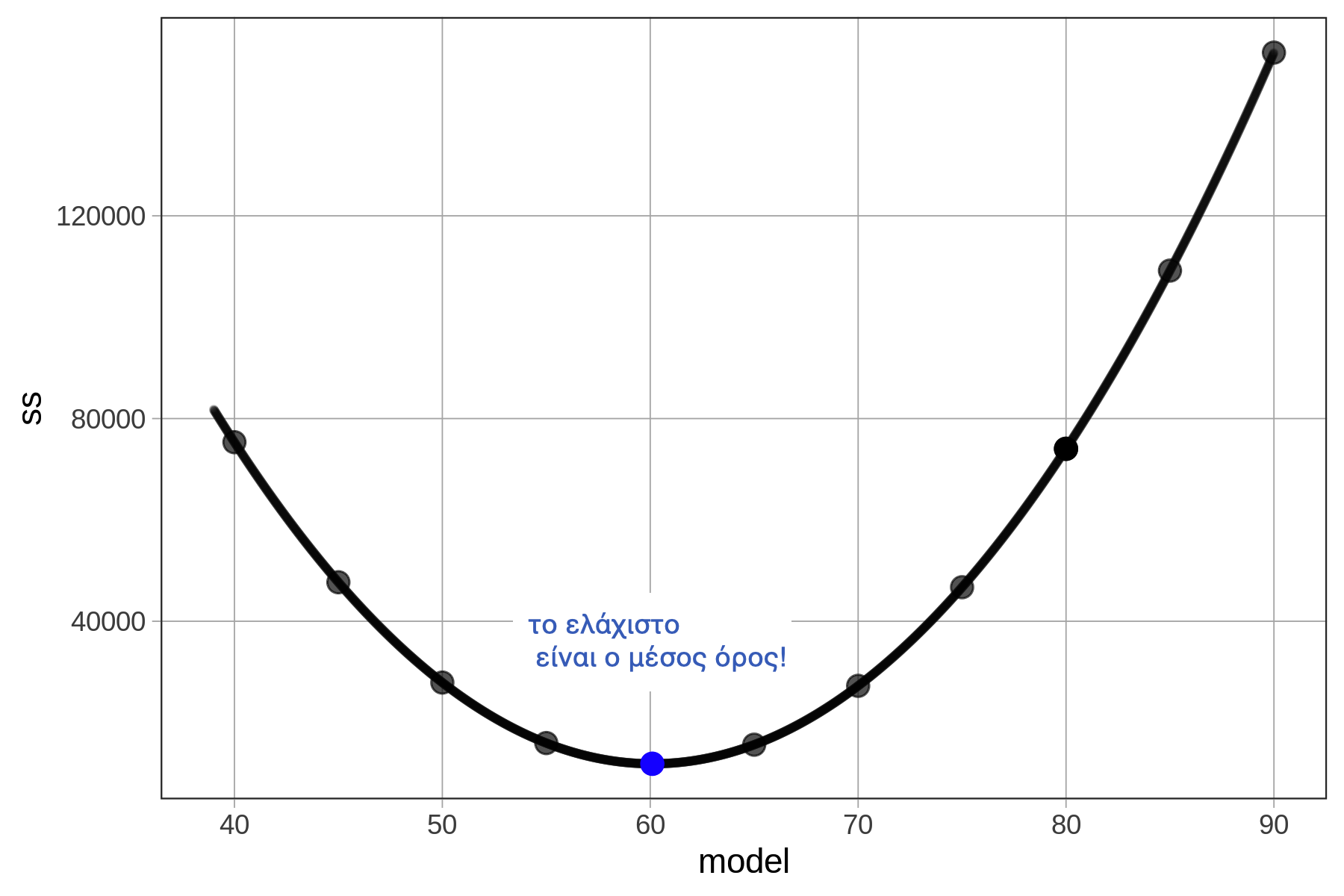

7.2 Η Ομορφιά του Αθροίσματος Τετραγώνων

Όπως αποδεικνύεται, το Άθροισμα Τετραγώνων (SS) έχει μια ειδική σχέση με το μέσο όρο. Στο προηγούμενο κεφάλαιο παρουσιάσαμε αναλυτικά τις αρετές του μέσου όρου. Τώρα είναι η ώρα να αρχίσουμε να εκτιμάμε την ομορφιά του αθροίσματος τετραγώνων!

Το Άθροισμα Τετραγώνων Ελαχιστοποιείται στο Μέσο Όρο

Το πλεονέκτημα του αθροίσματος τετραγώνων των αποκλίσεων ως μέτρου του συνολικού σφάλματος είναι ότι ελαχιστοποιείται ακριβώς στο μέσο όρο. Και επειδή ο στόχος μας στη στατιστική μοντελοποίηση είναι να μειώσουμε το σφάλμα όσο το δυνατόν περισσότερο, αυτό είναι καλό.

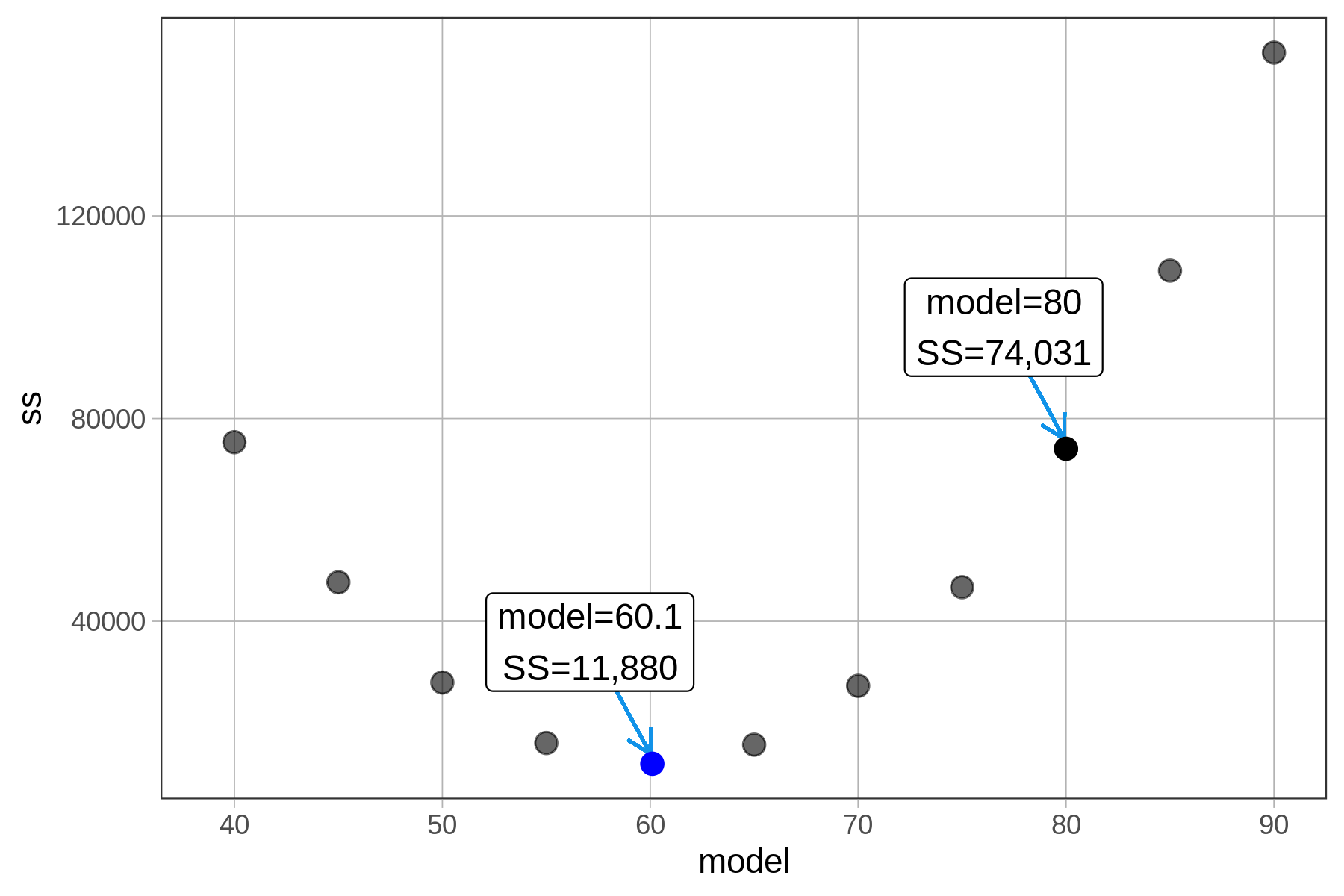

Ας εξετάσουμε αυτόν τον ισχυρισμό για να διαπιστώσουμε αν πραγματικά στέκει. Ας θυμηθούμε ότι αν χρησιμοποιήσουμε το μέσο όρο των 60.1mm για να προβλέψουμε το μήκος αντίχειρα, και στη συνέχεια πάρουμε τα υπόλοιπα από το μέσο όρο, τα υψώσουμε στο τετράγωνο και τα αθροίσουμε για όλες τις γραμμές του συνόλου δεδομένων Fingers, παίρνουμε την τιμή 11880.21.

Όταν λέμε ότι το άθροισμα τετραγώνων ελαχιστοποιείται στο μέσο όρο, εννοούμε ότι αν υπολογίζαμε τις αποκλίσεις των τιμών από οποιονδήποτε άλλο αριθμό εκτός από το μέσο όρο, το συνολικό άθροισμα τετραγώνων θα ήταν μεγαλύτερο από 11880.21. Είναι αλήθεια αυτό;

Τι πιστεύετε; Αν χρησιμοποιούσαμε το 60.0 ως μοντέλο του μήκους αντίχειρα αντί του 60.1, τι θα συνέβαινε στο Άθροισμα Τετραγώνων;

Θα ήταν μεγαλύτερο από 11880.21 είναι η σωστή απάντηση.

Θεμελιώδης αρχή:

Ο μέσος όρος ελαχιστοποιεί το Άθροισμα Τετραγώνων των Αποκλίσεων. Οποιαδήποτε άλλη τιμή θα δώσει μεγαλύτερο άθροισμα.

Εννοιολογική εξήγηση:

Ο μέσος όρος ως σημείο ισορροπίας:

Ο μέσος όρος (60.1) είναι το βέλτιστο σημείο

Οποιαδήποτε απόκλιση από αυτό αυξάνει το συνολικό σφάλμα

Η αλλαγή από 60.1 σε 60.0 είναι απόκλιση κατά 0.1

Γιατί οι άλλες επιλογές είναι λάθος:

Β - “Θα ήταν μικρότερο” - ΛΑΘΟΣ:

Αντίθετο της θεμελιώδους ιδιότητας του μέσου όρου

Ο μέσος όρος πάντα δίνει το ελάχιστο άθροισμα τετραγώνων των αποκλίσεων

Οποιαδήποτε άλλη τιμή δίνει μεγαλύτερο

Γ - “Δεν μπορούμε να ξέρουμε” - ΛΑΘΟΣ:

Μπορούμε να ξέρουμε με βάση τη θεωρία

Είναι μαθηματικά αποδεδειγμένο ότι ο μέσος ελαχιστοποιεί το άθροισμα τετραγώνων των αποκλίσεων

Δεν χρειάζεται υπολογισμός για να γνωρίζουμε την κατεύθυνση

Πρακτικές συνέπειες:

Για μοντελοποίηση:

Χωρίς άλλες μεταβλητές, ο μέσος όρος είναι η καλύτερη επιλογή

Οποιαδήποτε άλλη σταθερή τιμή θα δώσει χειρότερη προσαρμογή

Αυτό δικαιολογεί τη χρήση του μέσου όρου στο κενό μοντέλο

Συμπέρασμα:

Η αλλαγή από 60.1 (μέσος όρος) σε 60.0 θα αυξήσει το Άθροισμα Τετραγώνων των Αποκλίσεων. Αυτό προκύπτει από τη θεμελιώδη ιδιότητα ότι ο μέσος όρος ελαχιστοποιεί το άθροισμα αυτό - οποιαδήποτε άλλη τιμή, όσο κοντά κι αν είναι, θα δώσει μεγαλύτερο άθροισμα.

Στο παρακάτω πλαίσιο κώδικα, έχουμε θέσει το μέσο όρο του μήκους αντίχειρα (Thumb) ως την τιμή πρόβλεψης του μοντέλου (model <- 60.1). Εκτελέστε τον κώδικα για να δείτε ότι θα πάρετε 11880.21 ως τιμή του αθροίσματος τετραγώνων.

Στη συνέχεια, αλλάξτε την τιμή του μοντέλου από 60.1 σε 60.0 και εκτελέστε ξανά τον κώδικα. Τι συμβαίνει στο άθροισμα τετραγώνων; Αν το άθροισμα όντως ελαχιστοποιείται στο μέσο όρο, τότε θα πρέπει να είναι μεγαλύτερο από 11880.21 όταν δοκιμάζετε οποιονδήποτε άλλο αριθμό εκτός από το μέσο όρο.

Δοκιμάστε να χρησιμοποιήσετε μερικούς άλλους αριθμούς ως τιμές μοντέλου για να δείτε αν μπορείτε να κάνετε το Άθροισμα Τετραγώνων ακόμα μικρότερο. Εμείς δοκιμάσαμε μερικές τιμές και τις παρουσιάζουμε στο παρακάτω διάγραμμα.

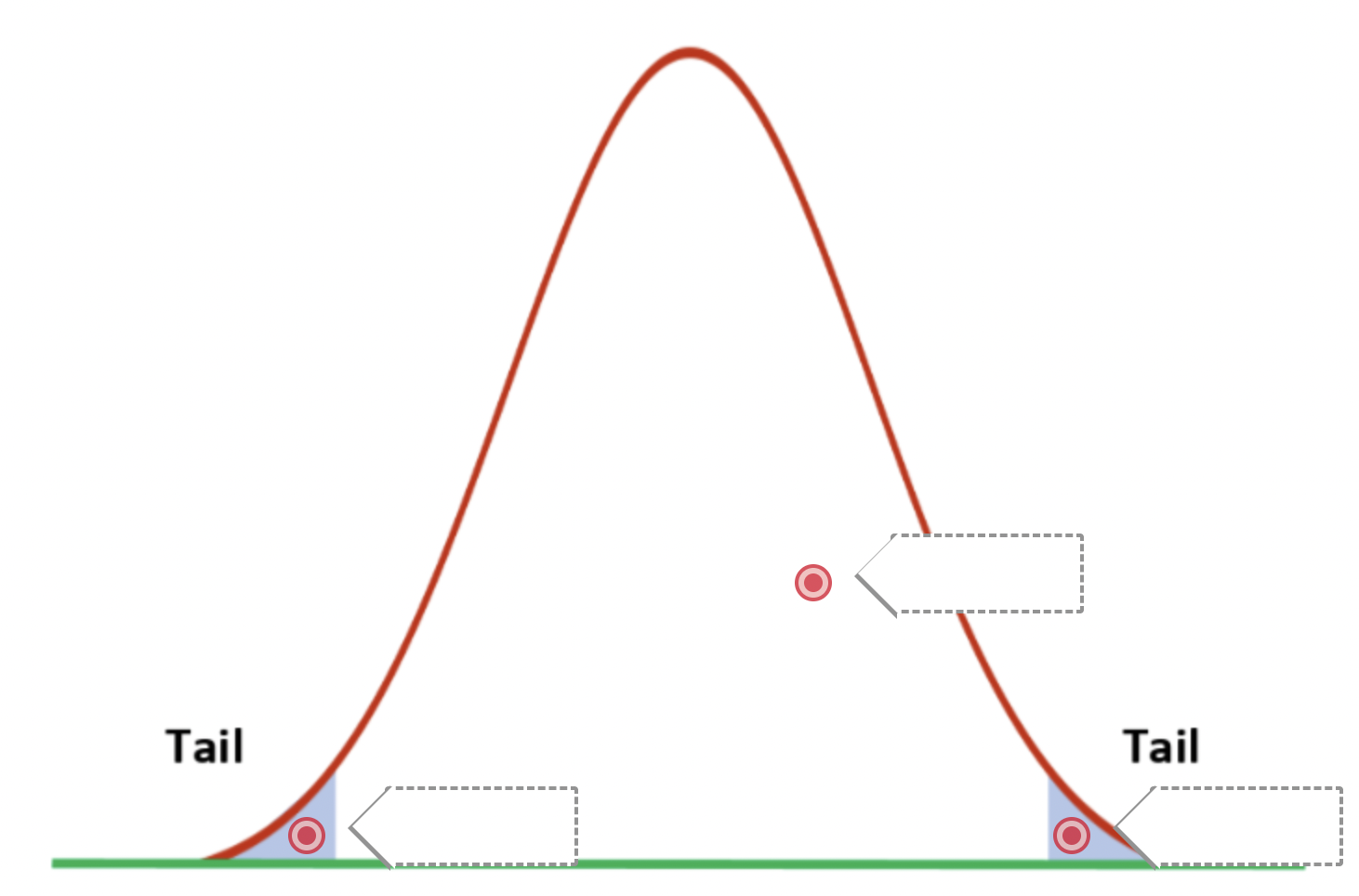

Οι τιμές του αθροίσματος τετραγώνων σχηματίζουν ένα μοτίβο—ένα είδος παραβολής. Στην πραγματικότητα, μπορεί να αποδειχθεί αλγεβρικά ότι το άθροισμα τετραγώνων δεν μπορεί ποτέ να είναι μικρότερο για οποιονδήποτε άλλο αριθμό πέρα από το μέσο όρο της κατανομής. (Μια εξομαλυμένη εκδοχή της συνάρτησης παρουσιάζεται στο παρακάτω διάγραμμα.)

Ο Μέσος Όρος και το Άθροισμα Τετραγώνων Ταιριάζουν

Επειδή το Άθροισμα Τετραγώνων ελαχιστοποιείται στο μέσο όρο, είναι ένα χρήσιμο μέτρο του σφάλματος όταν το μοντέλο μας είναι ο μέσος όρος. Αν επιλέγαμε έναν άλλο αριθμό, όπως τη διάμεσο, για να μοντελοποιήσουμε μια κατανομή, πιθανότατα θα επιλέγαμε ένα διαφορετικό μέτρο σφάλματος—προφανώς ένα που ελαχιστοποιείται στη διάμεσο. Σε αυτό το μάθημα εστιάζουμε κυρίως στο μέσο όρο, οπότε θα επιλέξουμε το Άθροισμα Τετραγώνων των αποκλίσεων από το μέσο όρο ως το προτιμώμενο μέτρο του σφάλματος.

Με μια πρώτη ματιά, πολλές έννοιες της στατιστικής φαίνονται σαν να είναι μέρος μιας ατελείωτης λίστας άσχετων μεταξύ τους μαθηματικών τύπων—ο μέσος όρος, το άθροισμα τετραγώνων, τα γραμμικά μοντέλα. Αλλά ελπίζουμε ότι αρχίζετε να αντιλαμβάνεστε ότι όλα αυτά κάπως ταιριάζουν μεταξύ τους. Η σχέση μεταξύ του μέσου όρου και του Αθροίσματος Τετραγώνων είναι στην πραγματικότητα μόνο ένα παράδειγμα των σχέσεων που συνδέουν όλες αυτές τις έννοιες. Το άθροισμα τετραγώνων θα συνδεθεί και με άλλες ιδέες της στατιστικής στη συνέχεια.

Κάτι αντίστοιχο ισχύει για το Πυθαγόρειο Θεώρημα. Μάθαμε στο σχολείο ότι το τετράγωνο της υποτείνουσας ενός ορθογώνιου τριγώνου ισούται με το άθροισμα των τετραγώνων των δύο καθέτων πλευρών. Δηλαδή, \(\gamma^2 = \alpha^2 + \beta^2\). Η χρήση των τετραγώνων κάνει τα πάντα να αθροίζουν και να ταιριάζουν μεταξύ τους. Αν δεν υψώσουμε στο τετράγωνο, το θεώρημα δεν ισχύει πια: \(\gamma \neq \alpha + \beta\). Έτσι και όταν χρησιμοποιούμε το άθροισμα τετραγώνων για την ποσοτικοποίηση του συνολικού σφάλματος, πολλά πράγματα θα ταιριάξουν μεταξύ τους που διαφορετικά δεν θα ταίριαζαν.

Εύρεση Αθροίσματος Τετραγώνων

Ελπίζουμε ότι σας έχουμε πείσει ότι το Άθροισμα Τετραγώνων και ο μέσος όρος ταιριάζουν μεταξύ τους. Γενικότερα, θα χρησιμοποιήσουμε το Άθροισμα Τετραγώνων ως ένα δείκτη προσαρμογής ενός μοντέλου—και θα επιδιώκουμε να το ελαχιστοποιήσουμε—για όλα τα μοντέλα που θα δούμε στο πλαίσιο του Γενικού Γραμμικού Μοντέλου (GLM). Μέχρι στιγμής, έχουμε εξετάσει μόνο ένα μοντέλο—το κενό μοντέλο \((Y_i = b_0 + e_i\))—στο οποίο το \(b_0\) αντιπροσωπεύει το δειγματικό μέσο όρο (που είναι και η εκτίμησή μας για την τιμή της αντίστοιχης παραμέτρου, του πληθυσμιακού μέσου όρου).

Καθώς προχωράμε στην προσαρμογή πιο σύνθετων μοντέλων στα δεδομένα, θα βασιστούμε σε πίνακες ANOVA για να υπολογίσουμε τα αθροίσματα τετραγώνων. (Το ANOVA σημαίνει Aνάλυση Διακύμανσης—ANalysis Of VAriance.) Σε αυτό το βιβλίο θα χρησιμοποιήσουμε τη συνάρτηση supernova() στην R για να δημιουργήσουμε πίνακες ANOVA. Ας δούμε πώς λειτουργεί για το κενό μοντέλο του μήκους αντίχειρα (Thumb).

supernova(empty_model)Στο παρακάτω πλαίσιο κώδικα, αποθηκεύστε τα αποτελέσματα του κενού μοντέλου για το μήκος αντίχειρα (Thumb) ως empty_model. Έπειτα δοκιμάστε τη συνάρτηση supernova() δίνοντας ως είσοδο το empty_model .

Analysis of Variance Table (Type III SS)

Model: Thumb ~ NULL

SS df MS F PRE p

----- ----------------- --------- --- ------ --- --- ---

Model (error reduced) | --- --- --- --- --- ---

Error (from model) | --- --- --- --- --- ---

----- ----------------- --------- --- ------ --- --- ---

Total (empty model) | 11880.211 156 76.155 Όπως μπορείτε να διαπιστώσετε, τα περισσότερα κελιά σε αυτόν τον πίνακα ANOVA είναι κενά· θα αρχίσουμε να τα γεμίζουμε αργότερα καθώς μαθαίνουμε πώς να προσαρμόζουμε πιο σύνθετα μοντέλα. Προς το παρόν, θα εστιάσουμε στην τελευταία γραμμή του πίνακα, με τίτλο Total (empty model), και τη στήλη με τίτλο SS.

Στον πίνακα, το SS για το κενό μοντέλο είναι ίσο με 11880.211, η ίδια τιμή που πήραμε προηγουμένως υπολογίζοντας τα υπόλοιπα, τετραγωνίζοντάς τα, και στη συνέχεια αθροίζοντάς τα σε κάθε γραμμή του συνόλου δεδομένων.

Υπολογίστηκε ένα Άθροισμα Τετραγώνων (SS) περίπου ίσο με 11880. Ποια είναι η μονάδα μέτρησης αυτού του αριθμού;

Τετραγωνικά χιλιοστά είναι η σωστή απάντηση.

Ανάλυση των μονάδων:

Αν το μήκος αντίχειρα μετριέται σε χιλιοστά (mm):

Sum of Squares (SS):

\[SS = \sum_{i=1}^{n}(x_i - \bar{x})^2\]

Μονάδες κάθε όρου:

\(x_i\): Μέτρηση σε mm

\(\bar{x}\): Μέσος όρος σε mm

\((x_i - \bar{x})\): Απόκλιση σε mm

\((x_i - \bar{x})^2\): Απόκλιση στο τετράγωνο σε mm²

\(\sum(x_i - \bar{x})^2\): Άθροισμα τετραγώνων των αποκλίσεων σε mm²

Γιατί οι άλλες επιλογές είναι λάθος:

Α - “Ίντσες” - ΛΑΘΟΣ:

Οι ίντσες είναι γραμμικές μονάδες, όχι τετραγωνικές

Αν τα δεδομένα ήταν σε ίντσες, το SS θα ήταν σε ίντσες στο τετράγωνο (in²)

Β - “Δεν είναι δυνατό να γνωρίζουμε” - ΛΑΘΟΣ:

Μπορούμε να το προσδιορίσουμε

Αν τα αρχικά δεδομένα είναι σε mm, το SS είναι σε mm²

Η μαθηματική πράξη (ύψωση στο τετράγωνο) καθορίζει τη μονάδα

Γ - “Χιλιοστά” - ΛΑΘΟΣ:

Τα χιλιοστά είναι η μονάδα των αρχικών μετρήσεων

Το Sum of Squares είναι άθροισμα τετραγώνων, άρα mm²

Η πράξη της ύψωσης στο τετράγωνο αλλάζει τη διάσταση

Συμπέρασμα:

Το Άθροισμα Τετραγώνων (Sum of Squares) έχει τετραγωνικές μονάδες επειδή προκύπτει από την ύψωση των αποκλίσεων στο τετράγωνο. Αν οι αρχικές μετρήσεις είναι σε χιλιοστά, το SS είναι σε τετραγωνικά χιλιοστά (mm²). Αυτό είναι αποτέλεσμα του μαθηματικού κανόνα: όταν υψώνουμε μια ποσότητα στο τετράγωνο, το ίδιο συμβαίνει και στη μονάδα της.

7.3 Διακύμανση

Το άθροισμα τετραγώνων είναι ένα καλό μέτρο της συνολικής μεταβλητότητας σε μια εξαρτημένη μεταβλητή όταν χρησιμοποιούμε το μέσο όρο ως μοντέλο. Έχει όμως ένα σημαντικό μειονέκτημα.

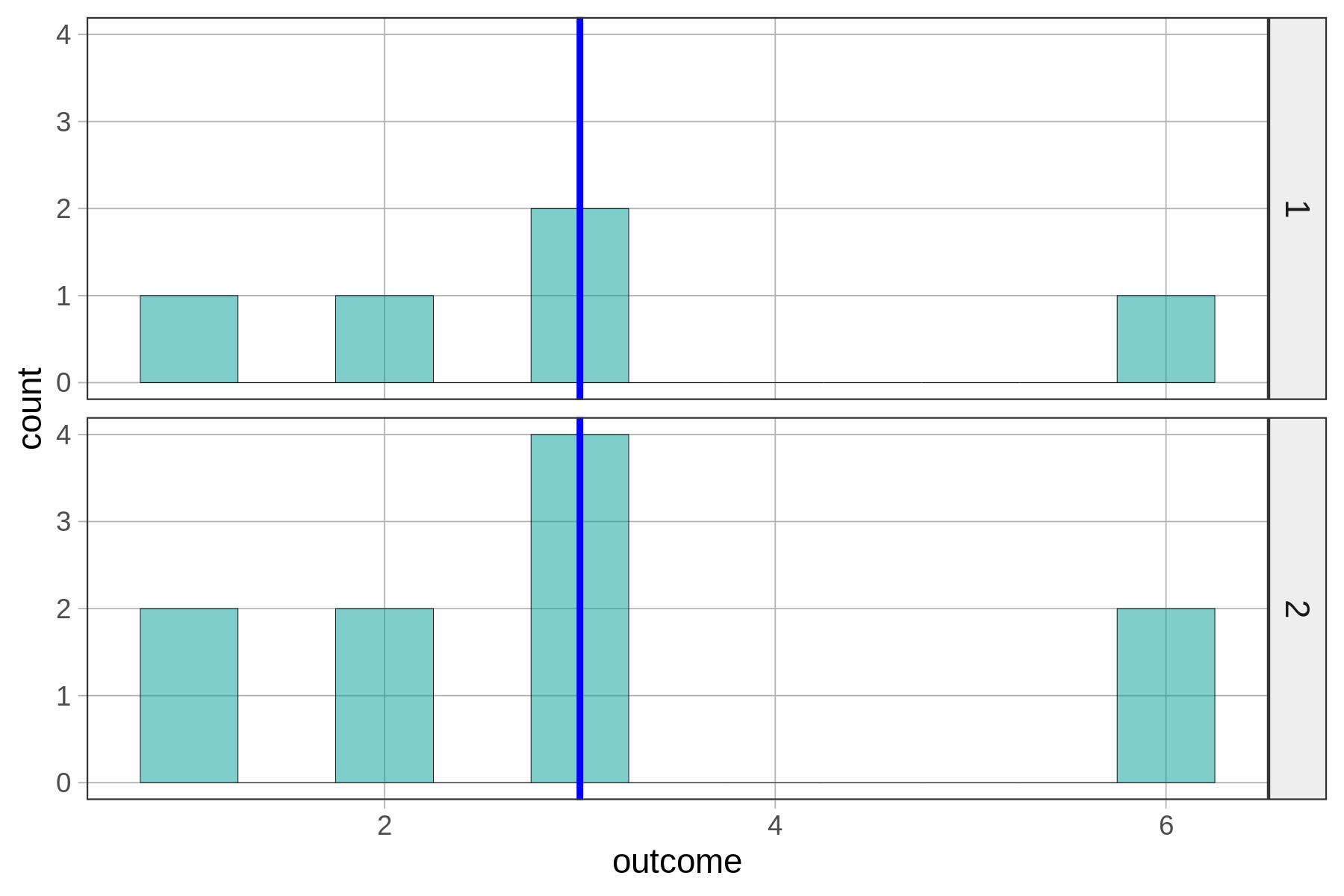

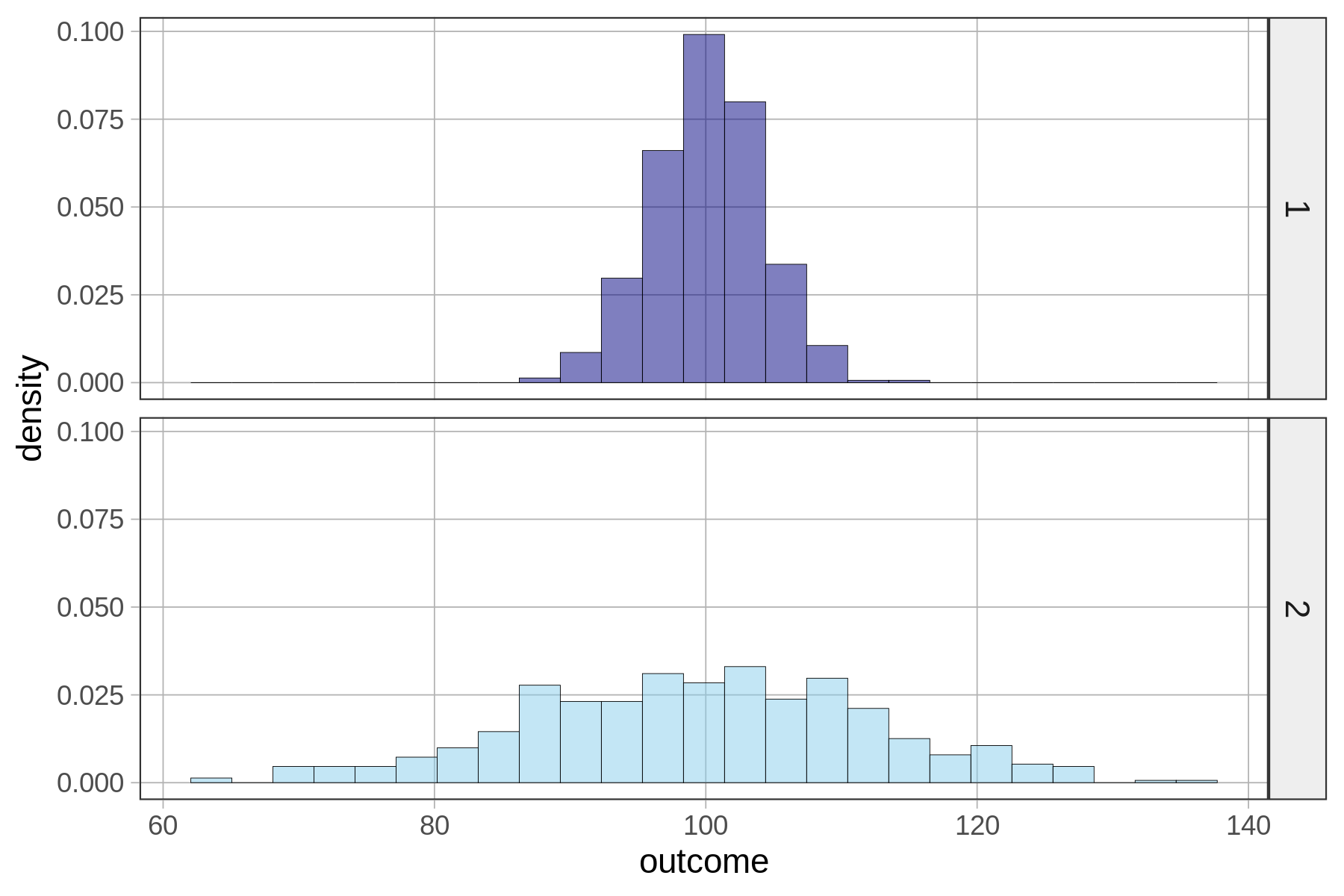

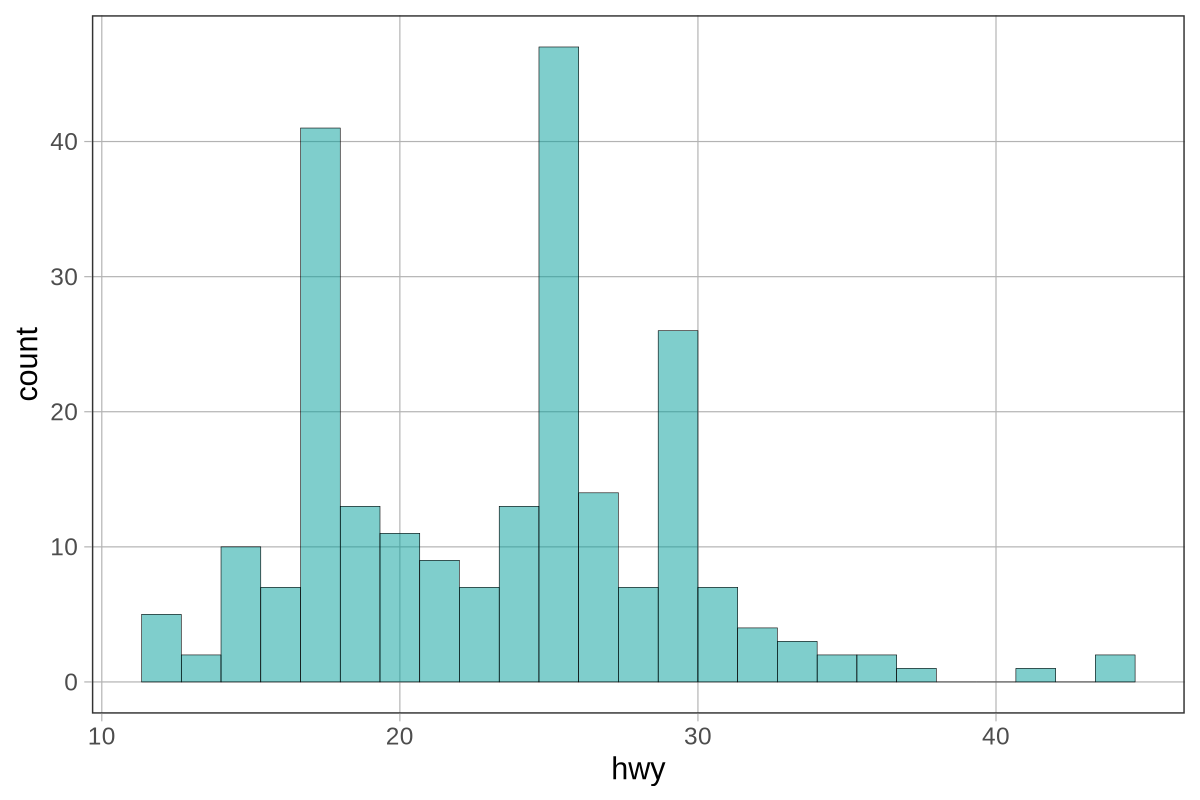

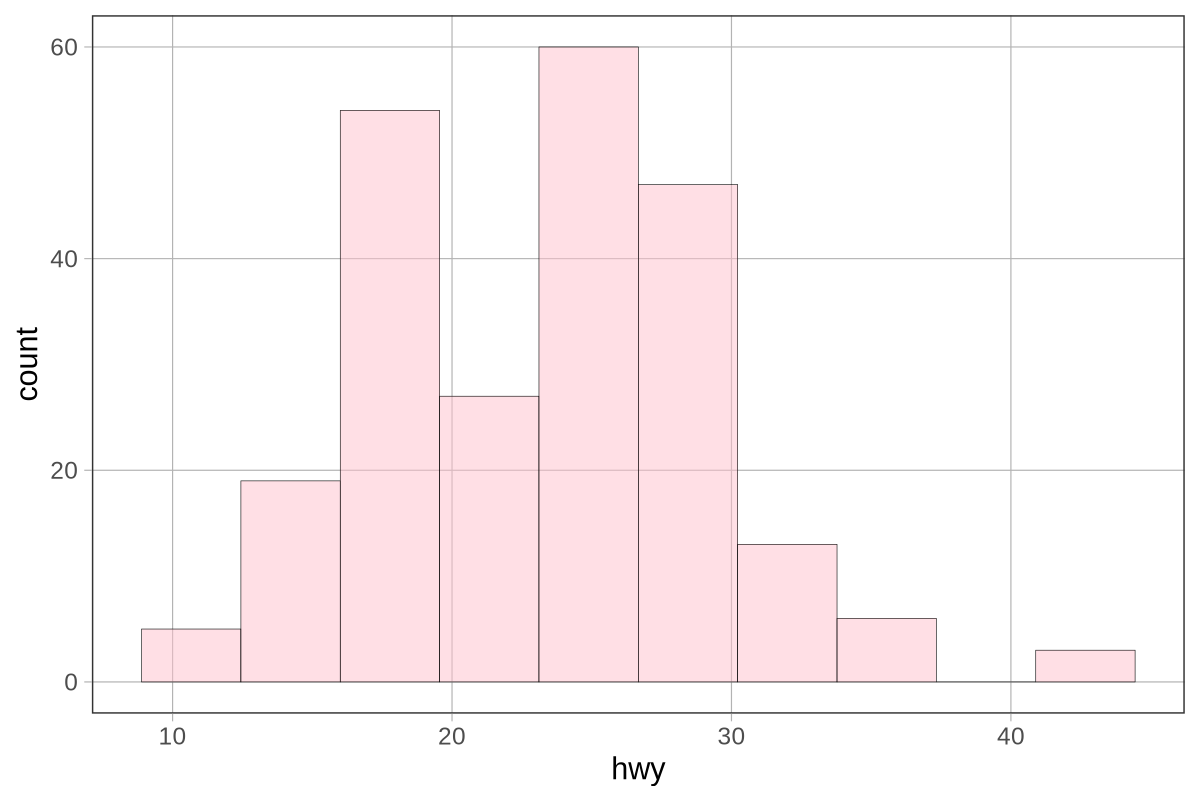

Εξετάστε αυτές τις δύο κατανομές.

Ποια κατανομή σας φαίνεται πιο διεσπαρμένη;

Από τις παραπάνω κατανομές, ποια νομίζετε ότι θα έχει το μεγαλύτερο Άθροισμα Τετραγώνων Υπολοίπων (SS);

Άθροισμα Τετραγώνων Υπολοίπων (`SS`) για το Μέσο Όρο της Κατανομής 1: 14

Άθροισμα Τετραγώνων Υπολοίπων (`SS`) για το Μέσο Όρο της Κατανομής 2: 28Αν και στα παραπάνω διαγράμματα η μεταβλητότητα των τιμών γύρω από το μέσο όρο οπτικά δε φαίνεται να διαφέρει, η Κατανομή 2 έχει τελικά διπλάσιο Άθροισμα Τετραγώνων από την Κατανομή 1.

Ας δούμε και ένα ακόμη πιο χαρακτηριστικό παράδειγμα.

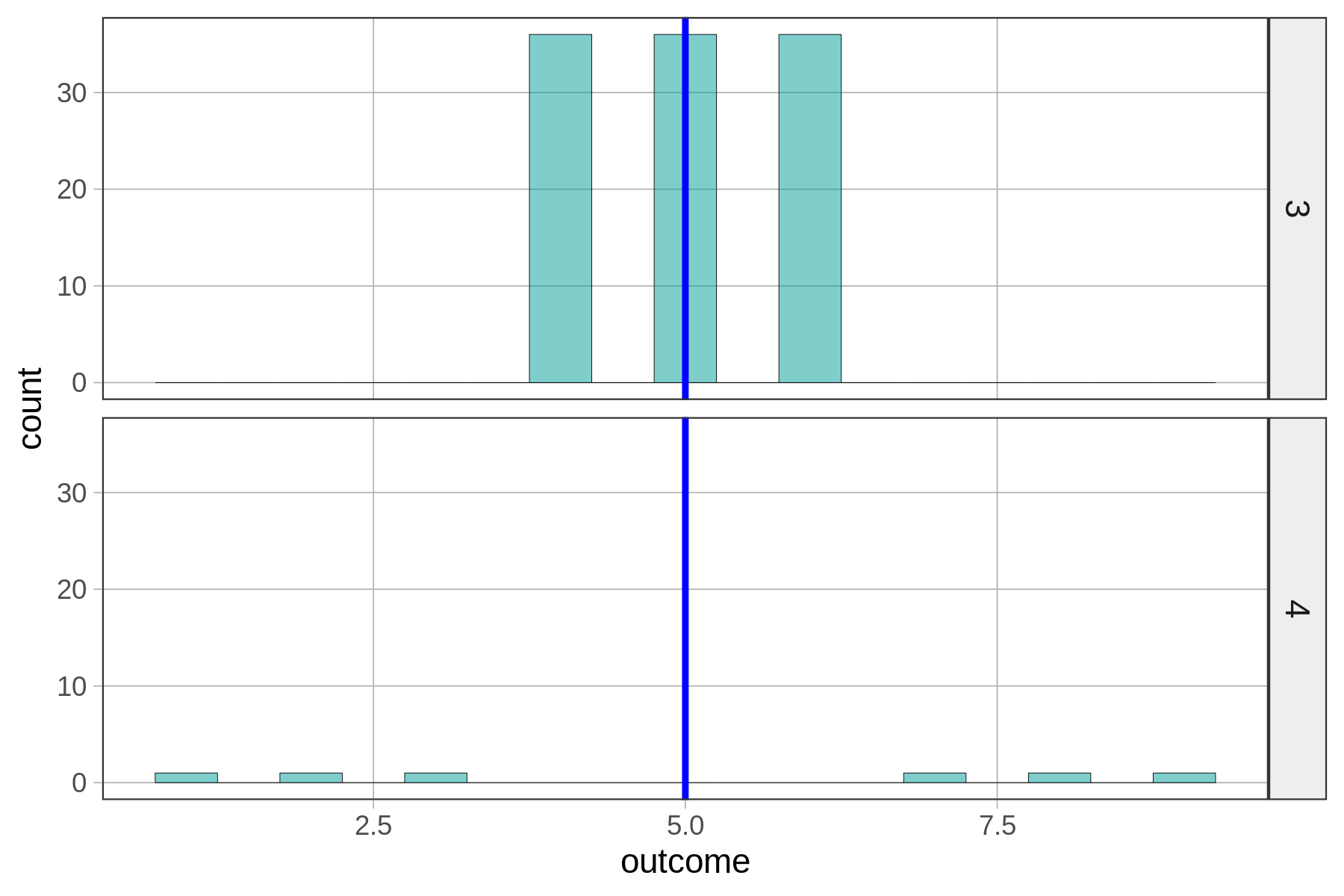

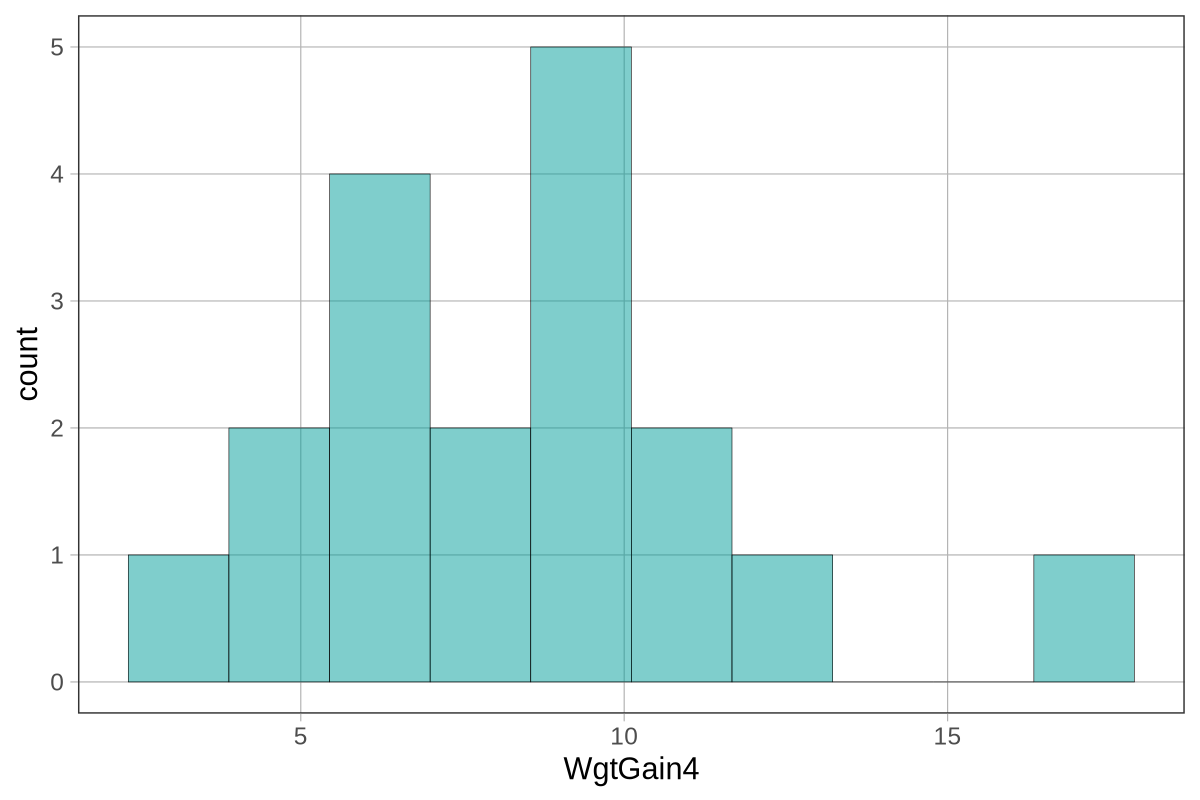

Ποια κατανομή σας φαίνεται πιο διεσπαρμένη;

Από τις παραπάνω κατανομές, για ποια πιστεύετε ότι ο μέσος όρος θα ήταν καλύτερο μοντέλο;

Για την πρώτη ερώτηση: Κατανομή 4 (πιο διεσπαρμένη)

Για τη δεύτερη ερώτηση: Κατανομή 3 (ο μέσος όρος είναι καλύτερο μοντέλο)

Ανάλυση των κατανομών από τα ιστογράμματα:

Κατανομή 3 (συμπαγής, συμμετρική):

Όλες οι τιμές συγκεντρωμένες γύρω από το μέσο (5)

Τρεις στήλες: μία στο ~4.5, μία στο ~5 (ψηλότερη), μία στο ~5.5

Πολύ μικρό εύρος τιμών

Συμμετρική κατανομή

Μικρή διασπορά από το μέσο όρο

Κατανομή 4 (διεσπαρμένη, ασύμμετρη):

Τιμές σε όλο το εύρος (από ~1.5 έως ~9)

Πολλές μικρές στήλες διάσπαρτες

Μεγάλο εύρος τιμών

Ασύμμετρη κατανομή με πιθανές ακραίες τιμές

Μεγάλη διασπορά από το μέσο όρο

Γιατί η Κατανομή 4 είναι πιο διεσπαρμένη:

Οπτικά κριτήρια:

Εύρος δεδομένων: Κατανομή 4 καλύπτει ~7-8 μονάδες, Κατανομή 3 μόνο ~1 μονάδα

Απόσταση από μέσο: Στην Κατανομή 4 υπάρχουν τιμές που απέχουν 3-4 μονάδες από το μέσο

Ομοιογένεια: Κατανομή 3 πολύ συμπαγής, Κατανομή 4 διάσπαρτη

Γιατί ο μέσος είναι καλύτερο μοντέλο για την Κατανομή 3:

1. Μικρή διασπορά:

Όλες οι τιμές είναι πολύ κοντά στο μέσο (5)

Τα υπόλοιπα (αποκλίσεις) είναι πολύ μικρά (±0.5 το πολύ)

Μικρό Άθροισμα Τετραγώνων Υπολοίπων σε σχέση με το μέγεθος του δείγματος

2. Συμμετρία:

Ισορροπημένη κατανομή γύρω από το μέσο

Μέσος ≈ Διάμεσος ≈ Επικρατούσα τιμή

Ο μέσος όρος είναι αντιπροσωπευτικός

3. Προβλεπτική ισχύς:

Αν προβλέψουμε 5 για οποιαδήποτε νέα παρατήρηση, θα κάνουμε πολύ μικρό λάθος

Το σφάλμα πρόβλεψης είναι συνήθως < 0.5

Γιατί ο μέσος είναι χειρότερο μοντέλο για την Κατανομή 4:

1. Μεγάλη διασπορά:

Οι τιμές είναι παντού (1.5 έως 9)

Τα υπόλοιπα (αποκλίσεις) είναι πολύ μεγάλα (έως ±4)

Μεγάλο Άθροισμα Τετραγώνων Υπολοίπων ανά παρατήρηση

2. Ασυμμετρία/Ακραίες τιμές:

Μη ομοιόμορφη κατανομή

Πιθανές ακραίες τιμές που τραβούν το μέσο

Ο μέσος όρος δεν είναι αντιπροσωπευτικός

3. Αναξιόπιστες προβλέψεις:

Αν προβλέψουμε 5, μπορεί η πραγματική τιμή να είναι 2 ή 8

Μεγάλο σφάλμα πρόβλεψης

Ο μέσος όρος δεν είναι χρήσιμος ως πρόβλεψη

Συμπέρασμα:

Η Κατανομή 4 είναι πολύ πιο διεσπαρμένη (μεγάλο εύρος, μεγάλη διασπορά), γι’ αυτό και ο μέσος όρος είναι κακό μοντέλο για αυτήν.

Η Κατανομή 3 είναι συμπαγής (μικρό εύρος, μικρή διασπορά), γι’ αυτό και ο μέσος όρος είναι εξαιρετικό μοντέλο για αυτήν.

Γενικός κανόνας: Όσο πιο διεσπαρμένα τα δεδομένα, τόσο χειρότερο μοντέλο είναι ο μέσος όρος!

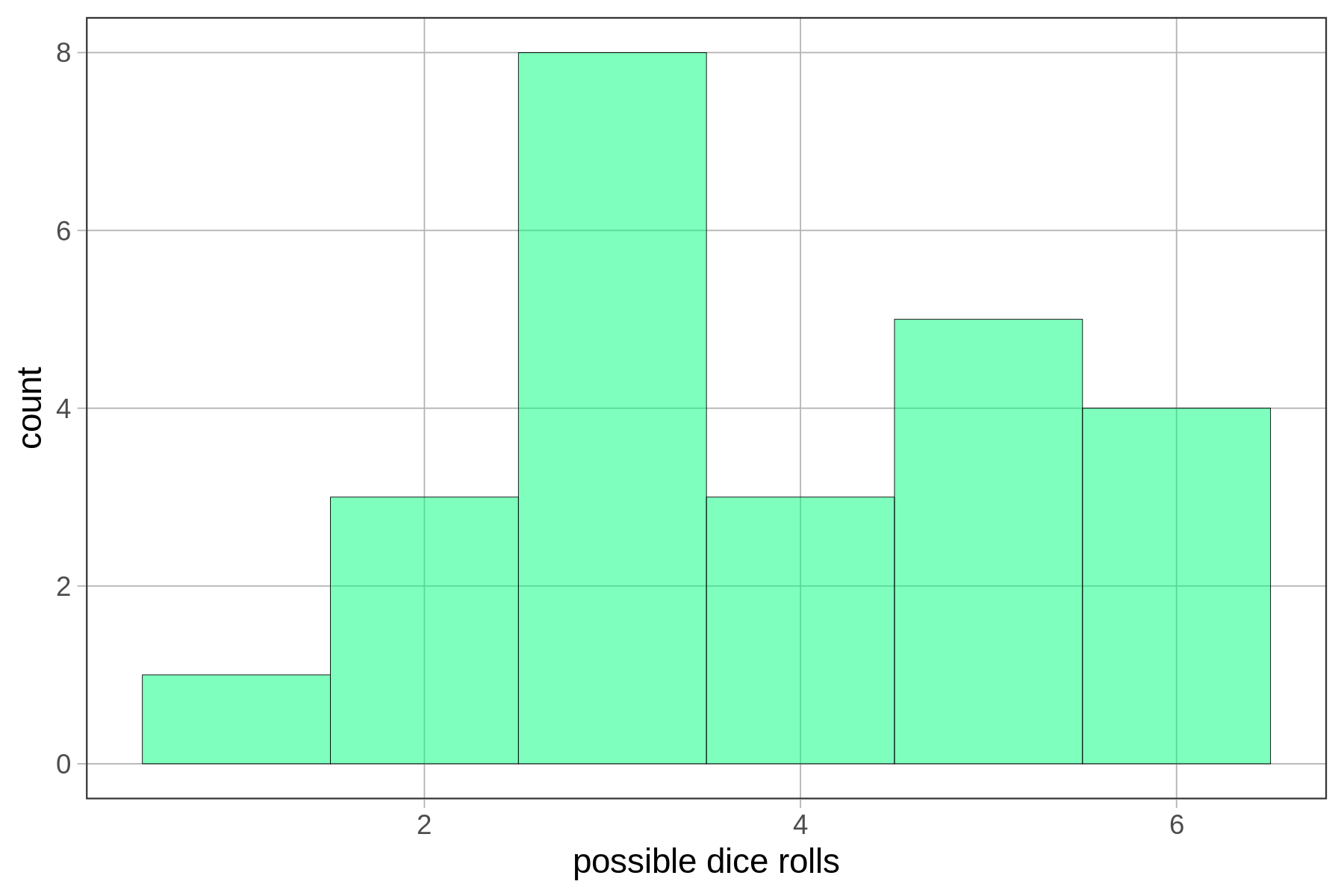

Άθροισμα Τετραγώνων Υπολοίπων (`SS`) για το Μέσο Όρο της Κατανομής 3: 72

Άθροισμα Τετραγώνων Υπολοίπων (`SS`) για το Μέσο Όρο της Κατανομής 4: 58Γιατί, όμως, το

SSείναι τόσο μεγαλύτερο για την Κατανομή 3 σε σχέση με την Κατανομή 4;

Το άθροισμα τετραγώνων των υπολοίπων (ή των αποκλίσεων από το μέσο όρο) είναι καλός τρόπος μέτρησης του σφάλματος γύρω από το μέσο όρο, και σύγκρισης του σφάλματος ανάμεσα σε δύο κατανομές. Αλλά αυτό ισχύει μόνο όταν και οι δύο κατανομές έχουν το ίδιο μέγεθος δείγματος.

Ο λόγος γι’ αυτό είναι ότι κάθε φορά που προσθέτετε μια επιπλέον παρατήρηση στην κατανομή του δείγματος σας, στην ουσία προσθέτετε μία ακόμη τετραγωνική απόκλιση από το μέσο όρο στο συνολικό άθροισμα. Έτσι, ακόμη κι αν δύο κατανομές φαίνεται να μοντελοποιούνται εξίσου καλά από τους αντίστοιχους μέσους όρους τους, μπορεί να έχουν πολύ διαφορετικό SS. Το SS πάντα θα αυξάνεται καθώς αυξάνεται ο αριθμός των παρατηρήσεων, ανεξάρτητα από το μέγεθος της μεταβλητότητας.

Μπορείτε να σκεφτείτε έναν τρόπο μέτρησης του σφάλματος που δεν θα επηρεαζόταν από το μέγεθος του δείγματος; Υπόδειξη: Τι θα μπορούσατε να κάνετε για να αποτρέψετε την αύξηση του

SSκάθε φορά που προσθέτετε μία παρατήρηση;

Αυτό το πρόβλημα λύνεται με δύο νέους στατιστικούς δείκτες στην εργαλειοθήκη μας: τη διακύμανση (variance) και την τυπική απόκλιση (standard deviation). Για να υπολογίσουμε τη διακύμανση, αρχικά υπολογίζουμε το SS, ή συνολικό σφάλμα, αλλά στη συνέχεια το διαιρούμε με το μέγεθος του δείγματος για να καταλήξουμε σε ένα μέτρο του μέσου σφάλματος γύρω από το μέσο όρο—το μέσο όρο των τετραγώνων των αποκλίσεων.

Επειδή η διακύμανση είναι κι αυτή ένας μέσος όρος, δεν επηρεάζεται από το μέγεθος του δείγματος, και συνεπώς, μπορεί να χρησιμοποιηθεί για να συγκρίνουμε την ποσότητα σφάλματος ανάμεσα σε δύο δείγματα διαφορετικού μεγέθους. Μπορείτε να σκεφτείτε τη διακύμανση ως ένα μέτρο της μέσης μεταβλητότητας ανά μονάδα δείγματος στο σύνολο δεδομένων.

Ο τύπος για τη διακύμανση, που συνήθως συμβολίζεται με \(s^2\), είναι ο εξής:

\[s^2 = \frac{\sum_{i=1}^{n}(Y_i - \bar{Y})^2}{n-1}\]

Μπορείτε εύκολα να διαπιστώσετε ότι ο αριθμητής είναι το άθροισμα τετραγώνων των αποκλίσεων από το μέσο όρο. Αν και για να υπολογίσουμε έναν πραγματικό μέσο όρο θα διαιρούσαμε τον αριθμητή με το \(n\), στην περίπτωση αυτή διαιρούμε με το \(n-1\). Αυτό το κάνουμε διότι η διαίρεση με το \(n-1\) μας δίνει μια καλύτερη εκτίμηση της πραγματικής διακύμανσης του πληθυσμού. Αυτό μπορεί να φανεί αν προσομοιώσουμε πολλαπλά τυχαία δείγματα από έναν πληθυσμό με γνωστή διακύμανση και στη συνέχεια εξετάσουμε ποιες εκτιμήσεις είναι καλύτερες—αυτές που προκύπτουν διαιρώντας με το \(n\), ή αυτές που προκύπτουν διαιρώντας με το \(n-1\).

Υπάρχει, φυσικά, και μια μαθηματική απόδειξη γι’ αυτό. Αλλά είναι χρήσιμο να το σκεφτόμαστε ως εξής: όταν έχετε ένα μικρό δείγμα, οι πιο ακραίες τιμές σε έναν πληθυσμό είναι απίθανο να εμφανιστούν στο δείγμα. Έτσι, αν διαιρούσαμε με το \(n\) θα υποεκτιμούσαμε ελαφρώς την πραγματική διακύμανση του πληθυσμού, ειδικά σε μικρότερα δείγματα. Η διαίρεση με το \(n-1\) διορθώνει αυτή την μεροληψία, μεγαλώνοντας λιγάκι την εκτίμηση της διακύμανσης. Και, καθώς το δείγμα μεγαλώνει, η διαφορά μεταξύ \(n\) και \(n-1\) θα γίνεται ολοένα και μικρότερη.

Το βασικό που πρέπει να γνωρίζετε είναι ότι η διαίρεση του SS (αθροίσματος τετραγώνων) με το \(n-1\) προσεγγίζει τη μέση τετραγωνική απόκλιση. Επιπρόσθετα, να σημειωθεί ότι το \(n-1\), που εμφανίζεται στον παρονομαστή, αποκαλείται συχνά βαθμοί ελευθερίας (degrees of freedom) ή df. Η έννοια αυτή θα εξεταστεί αναλυτικότερα σε επόμενη ενότητα.

Στο παραπάνω διάγραμμα, ποιος είναι ο οπτικός ορισμός του Αθροίσματος Τετραγώνων των Υπολοίπων;

Ποιος είναι ο οπτικός ορισμός της διακύμανσης (variance);

Για SS: Το άθροισμα του εμβαδού όλων των τετραγώνων

Για Διακύμανση: Ο μέσος όρος του εμβαδού των τετραγώνων

Ας δούμε τι αναπαριστούν τα μπλε τετράγωνα στο διάγραμμα:

Κάθε τετράγωνο έχει πλευρά ίση με την απόκλιση από το μέσο όρο της Thumb (υπόλοιπο)

Εμβαδόν κάθε τετραγώνου = (απόκλιση)² = υπόλοιπο στο τετράγωνο

Οριζόντια γραμμή (y = 60) = μέσος όρος της Thumb

Μαθηματική σύνδεση:

Άθροισμα Τετραγώνων (SS):

\[SS = \sum_{i=1}^{n}(Y_i - \bar{Y})^2\]

Οπτικά:

Κάθε σημείο έχει ένα τετράγωνο με πλευρά = \(|Y_i - \bar{Y}|\)

Εμβαδόν τετραγώνου = \((Y_i - \bar{Y})^2\)

SS = άθροισμα όλων των εμβαδών

Διακύμανση:

\[s^2 = \frac{SS}{n-1} = \frac{\sum_{i=1}^{n}(Y_i - \bar{Y})^2}{n-1}\]

Οπτικά:

Διακύμανση = μέσο εμβαδόν των τετραγώνων

Παίρνουμε το SS και το διαιρούμε με (n-1)

Δίνει το τυπικό/μέσο μέγεθος τετραγώνου

Διαγραμματική ερμηνεία:

SS (Συνολικό εμβαδόν):

Αν προσθέσουμε όλα τα μπλε τετράγωνα

Παίρνουμε το συνολικό εμβαδόν = SS

Μεγαλύτερα τετράγωνα → μεγαλύτερο SS → μεγαλύτερη διασπορά

Διακύμανση (Μέσο εμβαδόν):

Αν κατά μέσο όρο φτιάχναμε ένα τετράγωνο ανά παρατήρηση

Πόσο μεγάλο θα ήταν;

Διακύμανση = το τυπικό μέγεθος τετραγώνου

Γιατί οι άλλες επιλογές είναι λάθος:

“Ο αριθμός των τετραγώνων” - ΛΑΘΟΣ:

Ο αριθμός τετραγώνων = αριθμός παρατηρήσεων (n)

Δεν μετράει τη διασπορά, μόνο το μέγεθος δείγματος

“Το άθροισμα των πλευρών” - ΛΑΘΟΣ:

Άθροισμα πλευρών = \(\sum|Y_i - \bar{Y}|\) (Άθροισμα Απόλυτων Διαφορών)

Αυτό είναι διαφορετικό μέτρο διασποράς

“Το άθροισμα των περιμέτρων” - ΛΑΘΟΣ:

Περίμετρος = \(4 \times |Y_i - \bar{Y}|\)

Απλά πολλαπλασιάζει το άθροισμα πλευρών επί 4

Δεν σχετίζεται με το SS ή τη διακύμανση

Πρακτική χρήση της οπτικοποίησης:

Για κατανόηση:

Μεγάλα τετράγωνα = μεγάλες αποκλίσεις = κακό μοντέλο

Μικρά τετράγωνα = μικρές αποκλίσεις = καλό μοντέλο

Διαγραμματική σύγκριση μοντέλων

Συμπέρασμα:

Η οπτικοποίηση με τετράγωνα κάνει την έννοια του “Αθροίσματος Τετραγώνων των Υπολοίπων” συγκεκριμένη:

SS = συνολική επιφάνεια όλων των τετραγώνων

Διακύμανση = μέση επιφάνεια ανά τετράγωνο

Τετράγωνα αναπαριστούν γεωμετρικά την ποσότητα \((Y_i - \bar{Y})^2\)

Αυτή η οπτικοποίηση βοηθά να καταλάβουμε γιατί ονομάζεται “Άθροισμα Τετραγώνων**“!

Για να υπολογίσουμε τη διακύμανση στην R μπορούμε να χρησιμοποιήσουμε τη συνάρτηση var(). Στο παρακάτω πλαίσιο, να υπολογίσετε τη διακύμανση του μήκους αντίχειρα (Thumb) από το πλαίσιο δεδομένων Fingers.

var(Fingers$Thumb)Μπορείτε επίσης να υπολογίσετε τη διακύμανση με την εκτέλεση της συνάρτησης supernova() για το κενό μοντέλο (empty_model).

76.155Analysis of Variance Table (Type III SS)

Model: Thumb ~ NULL

SS df MS F PRE p

----- ----------------- --------- --- ------ --- --- ---

Model (error reduced) | --- --- --- --- --- ---

Error (from model) | --- --- --- --- --- ---

----- ----------------- --------- --- ------ --- --- ---

Total (empty model) | 11880.211 156 76.155Μπορείτε εύκολα να διαπιστώσετε ότι η τιμή της διακύμανσης της Thumb είναι η ίδια, είτε παράγεται από τη συνάρτηση var() είτε από τη συνάρτηση supernova(). Στον πίνακα ANOVA, ωστόσο, η διακύμανση βρίσκεται στη στήλη MS. Το MS σημαίνει Mean Square, δηλαδή «μέσο άθροισμα τετραγώνων». Αν διαιρέσετε το συνολικό άθροισμα τετραγώνων (11880.211) με το \(n-1\) (156), θα πάρετε το μέσο άθροισμα τετραγώνων, ή με άλλα λόγια τη διακύμανση της μεταβλητής Thumb (76.155).

Ποια είναι η σωστή ερμηνεία της τιμής 76.155;

Η μέση τετραγωνική απόκλιση σε αυτή την κατανομή είναι περίπου 76 τετραγωνικά χιλιοστά είναι η σωστή απάντηση.

Τι είναι η Μέση Τετραγωνική Απόκλιση (MS - Mean Square):

Mean Square = Variance = Διακύμανση

\[MS = \frac{SS}{df} = \frac{SS}{n-1} = \frac{11880.211}{156} = 76.155\]

Ερμηνεία:

MS = Mean (μέσος όρος) of the Squared (τετραγωνικών) deviations (αποκλίσεων)

Είναι η διακύμανση (variance)

Μετράει τη μέση τετραγωνική απόκλιση από το μέσο όρο

Μαθηματική ανάλυση:

Βήμα προς βήμα:

Αποκλίσεις: \((Thumb_i - \bar{Thumb})\) (σε mm)

Τετραγωνικές αποκλίσεις: \((Thumb_i - \bar{Thumb})^2\) (σε mm²)

Άθροισμα: \(SS = \sum(Thumb_i - \bar{Thumb})^2 = 11880.211\)mm²

Μέση τετραγωνική απόκλιση: \(MS = \frac{SS}{n-1} = 76.155\)mm²

Μονάδες μέτρησης:

Thumb μετριέται σε mm

Απόκλιση \((Thumb_i - \bar{Thumb})\) σε mm

Τετραγωνική απόκλιση \((Thumb_i - \bar{Thumb})^2\) σε mm²

MS (variance) σε mm² (τετραγωνικά χιλιοστόμετρα)

Γιατί οι άλλες επιλογές είναι λάθος:

Α - “76 αντίχειρες μεγαλύτεροι από το μέσο” - ΛΑΘΟΣ:

Το 76.155 είναι μέτρο διασποράς, όχι πλήθος

Ο αριθμός αντίχειρων πάνω από το μέσο είναι περίπου n/2 ≈ 78-79

Δεν σχετίζεται με την τιμή 76.155

Β - “76 αντίχειρες διαφορετικοί από το μέσο” - ΛΑΘΟΣ:

Όλοι οι αντίχειρες είναι διαφορετικοί από το μέσο (εκτός από τυχαία ακριβή ταύτιση)

Το 76.155 δεν είναι πλήθος

Σύγχυση μεταξύ τιμής διακύμανσης και αριθμού παρατηρήσεων

Δ - “Μέση απόκλιση 76mm” - ΛΑΘΟΣ:

Αυτό θα ήταν η Μέση Απόλυτη Απόκλιση - Mean Absolute Deviation (MAD)

MAD = \(\frac{\sum|Thumb_i - \bar{Thumb}|}{n}\) (σε mm, όχι mm²)

Το 76.155 είναι τετραγωνική απόκλιση (mm²), όχι γραμμική (mm)

Ε - “Μέσος αντίχερας 76” - ΛΑΘΟΣ:

Ο μέσος όρος του μήκους αντίχειρα δεν είναι 76 mm

Το 76.155 είναι η διακύμανση, όχι ο μέσος όρος

Εντελώς διαφορετικά μεγέθη!

Πρακτική ερμηνεία του MS = 76.155:

Τι σημαίνει;

Αν πάρουμε κάθε μήκος αντίχειρα και υπολογίσουμε \((Thumb_i - \bar{Thumb})^2\)

Και μετά υπολογίσουμε το μέσο όρο αυτών των τετραγώνων

Παίρνουμε 76.155mm²

Οπτικά (από την προηγούμενη εξήγηση):

Αν σχεδιάσουμε τετράγωνα με πλευρά = απόκλιση

Το μέσο εμβαδόν αυτών των τετραγώνων είναι 76.155mm²

Συμπέρασμα:

Το MS = 76.155 ερμηνεύεται ως: “Η μέση τετραγωνική απόκλιση του μήκους αντίχειρα από το μέσο όρο είναι 76.155 τετραγωνικά χιλιοστά.”

7.4 Τυπική Απόκλιση

Η τυπική απόκλιση (standard deviation) συμβολίζεται με \(s\) και είναι απλά η τετραγωνική ρίζα της διακύμανσης. Γενικά προτιμούμε να σκεφτόμαστε το σφάλμα με όρους τυπικής απόκλισης επειδή είναι μια τιμή σε μονάδες της αρχικής κλίμακας μέτρησης.

Για παράδειγμα, αν μοντελοποιήσουμε το σωματικό βάρος σε kg:

- Η διακύμανση θα εκφράζει το σφάλμα σε τετραγωνικά kg (μια μονάδα μέτρησης που δεν είμαστε συνηθισμένοι να σκεφτόμαστε)

- Η τυπική απόκλιση θα εκφράζει το σφάλμα σε kg (πολύ πιο κατανοητό!)

Υπάρχουν δύο ισοδύναμοι τύποι που αναπαριστούν την τυπική απόκλιση:

\[s = \sqrt{s^2} = \sqrt{\frac{\sum_{i=1}^{n}(Y_i - \bar{Y})^2}{n-1}}\]

Ή απλούστερα:

\[s = \sqrt{\text{Διακύμανση}}\]

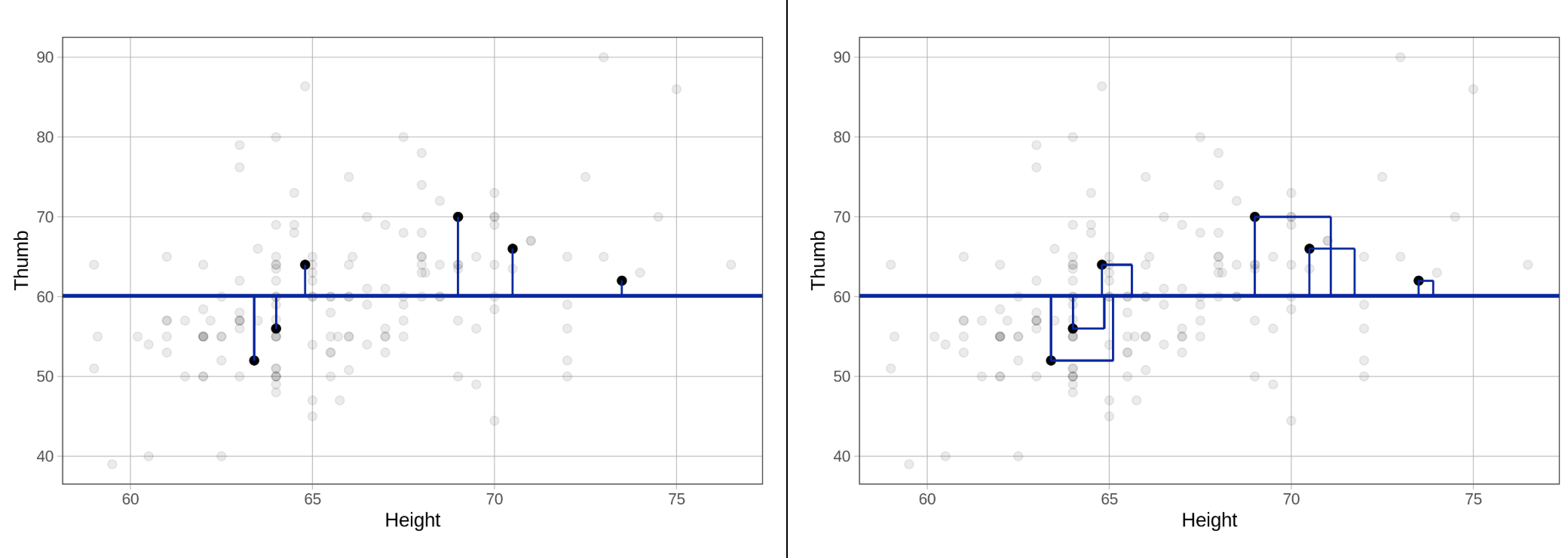

Ποιος είναι ο οπτικός ορισμός της τυπικής απόκλισης; (Υπάρχουν περισσότερες από μία σωστές απαντήσεις.)

Θυμηθείτε ότι η διακύμανση του μήκους αντίχειρα (Thumb) ήταν περίπου ίση με 76. Ποια από τις παρακάτω είναι μια καλή εκτίμηση για την τυπική απόκλιση του μήκους αντίχειρα;

Για την πρώτη ερώτηση: Α, Β είναι σωστές

Για τη δεύτερη ερώτηση: 9 (Γ)

Ανάλυση της τυπικής απόκλισης:

Τυπική απόκλιση (Standard Deviation):

\[SD = \sqrt{variance} = \sqrt{MS} = \sqrt{76} \approx 8.72 \approx 9\]

Οπτικοί ορισμοί της τυπικής απόκλισης:

Α - “Μέση απόλυτη απόκλιση από το μοντέλο” - ΣΩΣΤΟ:

Η τυπική απόκλιση είναι περίπου η μέση απόλυτη απόκλιση

Από το διάγραμμα 1: οι κάθετες γραμμές δείχνουν αποκλίσεις

Τυπική Απόκλιση ≈ μέση απόλυτη τιμή αυτών των αποκλίσεων

Β - “Μέση κάθετη απόσταση από το μέσο” - ΣΩΣΤΟ:

Οι μπλε κάθετες γραμμές στο αριστερό διάγραμμα δείχνουν την κάθετη απόσταση

Από κάθε σημείο στον οριζόντιο μέσο όρο (y = 60)

Η τυπική απόκλιση είναι περίπου ο μέσος όρος αυτών των αποστάσεων

Γ - “Μέσο εμβαδόν τετραγώνων” - ΛΑΘΟΣ:

Το μέσο εμβαδόν των τετραγώνων (διάγραμμα στα δεξιά) είναι η διακύμανση (76mm²)

Η τυπική απόκλιση είναι η ρίζα του μέσου εμβαδού, όχι το εμβαδόν

Τυπική απόκλιση = √(μέσο εμβαδόν) = √76 ≈ 9mm

Δ - “Αριθμός τετραγώνων” - ΛΑΘΟΣ:

Ο αριθμός τετραγώνων = αριθμός παρατηρήσεων (n)

Δεν σχετίζεται με τη μεταβλητότητα

Είναι απλά το μέγεθος του δείγματος

Υπολογισμός τυπικής απόκλισης:

# Δεδομένη διακύμανση

variance <- 76 # mm²

# Τυπική απόκλιση = ρίζα της διακύμανσης

SD <- sqrt(variance)

print(SD)

# [1] 8.717798

# Στρογγυλοποίηση

round(SD)

# [1] 9Γιατί η απάντηση είναι 9:

Έλεγχος όλων των επιλογών:

70: Πολύ κοντά στη διακύμανση (76), όχι στην τυπική απόκλιση

16: √256 = 16, πολύ μεγάλο

9: √81 = 9, πολύ κοντά στο √76 ≈ 8.72 ✓

4: √16 = 4, πολύ μικρό

1: √1 = 1, εξαιρετικά μικρό

Σχέση διακύμανσης και τυπικής απόκλισης:

# Αν SD = 9

SD_estimate <- 9

variance_from_SD <- SD_estimate^2

# 81 (κοντά στο 76)

# Αν SD = 8.72 (ακριβές)

SD_exact <- sqrt(76)

variance_check <- SD_exact^2

# 76 (ακριβώς!)Οπτική επαλήθευση από τα διαγράμματα:

Διάγραμμα στα αριστερά - Κάθετες γραμμές:

Οι περισσότερες αποκλίσεις φαίνονται να είναι 5-15mm

Μερικές πολύ μικρές (2-3mm)

Μερικές μεγάλες (15-20mm)

Μέση απόσταση ≈ 8-9mm ✓

Διάγραμμα στα δεξιά - Τετράγωνα:

Διαφορετικά μεγέθη τετραγώνων

Αν το μέσο εμβαδόν είναι 76mm²

Τότε η πλευρά του μέσου τετραγώνου είναι √76 ≈ 9mm ✓

Σύγκριση μέτρων διασποράς:

Μέτρο | Τιμή | Μονάδα | Ερμηνεία

------------------ | ------ | ------ | ---------

SS | 11.880 | mm² | Συνολική διασπορά

Variance (MS) | 76 | mm² | Μέση τετραγ. απόκλιση

Std Deviation (SD) | 9 | mm | Τυπική απόκλισηΓιατί χρησιμοποιούμε την τυπική απόκλιση αντί για τη διακύμανση:

1. Ίδιες μονάδες με τα δεδομένα:

Διακύμανση σε mm² (τετραγωνικά χιλιοστά)

Τυπική απόκλιση σε mm (χιλιοστά) - πιο κατανοητό

2. Άμεση ερμηνεία:

“Η τυπική απόκλιση είναι 9mm” = κατανοητή μονάδα μέτρησης

“Η διακύμανση είναι 76mm²” = δύσκολο να την κατανοήσουμε

Τετράγωνα που βοηθούν την κατανόηση:

Φανταστείτε ένα τετράγωνο με εμβαδόν 76mm²

Ποια είναι η πλευρά του; √76 ≈ 9mm

Αυτή η πλευρά είναι η τυπική απόκλιση!

Συμπέρασμα:

Η τυπική απόκλιση οπτικά είναι:

Περίπου η μέση κάθετη απόσταση από το μέσο όρο (διάγραμμα στα αριστερά)

Η πλευρά του μέσου τετραγώνου απόκλισης (διάγραμμα στα δεξιά)

Με διακύμανση = 76mm², η τυπική απόκλιση είναι √76 ≈ 9mm, που αντιπροσωπεύει την τυπική απόσταση κάθε μήκους αντίχειρα από το μέσο όρο.

Για να υπολογίσουμε την τυπική απόκλιση στην R, μπορούμε να χρησιμοποιήσουμε τη συνάρτηση sd().

sd(Fingers$Thumb) Εναλλακτικά, μπορούμε να συνδυάσουμε τη συνάρτηση var() με τη συνάρτηση sqrt(). Ένας τρίτος τρόπος είναι η χρήση της συνάρτησης favstats(), η οποία περιλαμβάνει την τυπική απόκλιση στα αποτελέσματά της.

Μπορείτε να δοκιμάσετε και τους τρεις τρόπους στο παρακάτω πλαίσιο κώδικα για να υπολογίσετε την τυπική απόκλιση της Thumb στο πλαίσιο δεδομένων Fingers.

8.726695

8.726695

min Q1 median Q3 max mean sd n missing

39 55 60 65 90 60.10366 8.726695 157 0Ποια είναι η σωστή ερμηνεία της τιμής 8.73;

Η μέση απόκλιση σε αυτή την κατανομή είναι περίπου 8.73mm είναι η σωστή απάντηση.

Τι είναι το 8.73:

Τυπική απόκλιση (Standard Deviation):

\[SD = \sqrt{variance} = \sqrt{76.155} \approx 8.73 \text{mm}\]

Ερμηνεία:

Η τυπική απόκλιση μετράει την τυπική/μέση απόσταση των παρατηρήσεων από το μέσο όρο

8.73mm = η τυπική απόκλιση του μήκους αντίχειρα από το μέσο όρο

Ένα αντιπροσωπευτικό μέτρο του πόσο διασκορπισμένα είναι τα δεδομένα

Γιατί οι άλλες επιλογές είναι λάθος:

Α - “8.73 αντίχειρες διαφορετικοί από το μέσο” - ΛΑΘΟΣ:

Το 8.73 είναι μέτρο απόστασης (mm), όχι πλήθος

Όλα τα μήκη αντίχειρα είναι (σχεδόν) διαφορετικά από το μέσο

Β - “Μέση τετραγωνική απόκλιση 8.73mm²” - ΛΑΘΟΣ:

Η μέση τετραγωνική απόκλιση είναι η διακύμανση = 76.155mm²

Το 8.73² = 76.15 (η διακύμανση)

Το 8.73 είναι η ρίζα της μέσης τετραγωνικής απόκλισης

Επίσης, οι μονάδες είναι mm, όχι mm²

Δ - “Μέσο μήκος αντίχειρα 8.73mm” - ΛΑΘΟΣ:

Ο μέσος όρος του μήκους αντίχειρα δεν είναι 8.73mm (πολύ μικρό!)

Ο μέσος όρος του μήκους αντίχειρα είναι περίπου 60mm

Το 8.73 είναι η διασπορά γύρω από το μέσο, όχι ο μέσος

Ε - “Άθροισμα υπολοίπων 8.73mm” - ΛΑΘΟΣ:

Το άθροισμα των υπολοίπων είναι πάντα 0

\(\sum(Y_i - \bar{Y}) = 0\) (θεμελιώδης ιδιότητα)

Το 8.73 δεν σχετίζεται με άθροισμα των υπολοίπων

Συμπέρασμα:

Το 8.73mm είναι η τυπική απόκλιση του μήκους αντίχειρα, που ερμηνεύεται ως “η μέση απόκλιση είναι περίπου 8.73mm”. Αυτό σημαίνει ότι το μήκος ενός τυπικού αντίχειρα απέχει περίπου 8.73mm από το μέσο όρο, και είναι το πιο κοινό μέτρο για την περιγραφή της διασποράς σε γραμμικές μονάδες (mm).

Άθροισμα Τετραγώνων, Διακύμανση και Τυπική Απόκλιση

Έχουμε συζητήσει τρεις δείκτες για την ποσοτικοποίηση του σφάλματος γύρω από ένα μοντέλο. Όλοι ξεκινούν με τα υπόλοιπα (αποκλίσεις από το μοντέλο), αλλά τα αθροίζουν με διαφορετικούς τρόπους για να συνοψίσουν το συνολικό σφάλμα.

Και οι τρεις ελαχιστοποιούνται στο μέσο όρο, και συνεπώς όλοι είναι χρήσιμοι όταν ο μέσος όρος είναι το μοντέλο για μια ποσοτική μεταβλητή.

Τι σημαίνει ότι αυτά τα τρία μέτρα σφάλματος (άθροισμα τετραγώνων, διακύμανση, και τυπική απόκλιση) ελαχιστοποιούνται στο μέσο όρο;

Αυτά τα μέτρα λαμβάνουν τη μικρότερη τιμή τους όταν το μοντέλο είναι ο μέσος όρος. είναι η σωστή απάντηση.

Τι σημαίνει “ελαχιστοποιούνται στο μέσο όρο”:

Θεμελιώδης ιδιότητα του μέσου όρου:

Ο μέσος όρος είναι η τιμή που ελαχιστοποιεί το Άθροισμα Τετραγώνων (και κατά συνέπεια και τη διακύμανση και την τυπική απόκλιση).

Γιατί οι άλλες επιλογές είναι λάθος:

Β - “Όλα εξίσου μικρά και ίσα” - ΛΑΘΟΣ:

Τα τρία μέτρα δεν είναι ίσα μεταξύ τους

SS = 11,880, Variance = 76, SD = 8.73

Έχουν διαφορετικές κλίμακες και μονάδες

Απλά όλα ελαχιστοποιούνται στην ίδια τιμή (μέσος όρος)

Γ - “Καλύτερο μέτρο για κάθε μοντέλο” - ΛΑΘΟΣ:

Υπάρχουν και άλλα μέτρα του σφάλματος: MAD, Εύρος, IQR κ.λπ.

Το “καλύτερο” μέτρο εξαρτάται από το πλαίσιο

Η δήλωση αφορά ποια τιμή ελαχιστοποιεί αυτά τα μέτρα, όχι ποιο μέτρο είναι καλύτερο

Δ - “Μικρότερα από άλλα μέτρα” - ΛΑΘΟΣ:

Δεν μπορούμε να συγκρίνουμε διαφορετικά μέτρα απευθείας (διαφορετικές κλίμακες)

Π.χ. SS = 11880mm², MAD ≈ 7mm - δεν συγκρίνονται!

Η δήλωση δεν αφορά σύγκριση μεταξύ μέτρων, αλλά ελαχιστοποίηση εντός μέτρου

Μαθηματική σχέση των τριών μέτρων:

Όλα σχετίζονται με το SS:

Άθροισμα Τετραγώνων Υπολοίπων = \(\sum(Y_i - \bar{Y})^2\) = συνολικό σφάλμα

Διακύμανση = SS / (n-1) = μέσο σφάλμα ανά παρατήρηση

Τυπική απόκλιση = √Διακύμανση = σφάλμα σε αρχικές μονάδες

Αφού όλα προέρχονται από το SS, και το SS ελαχιστοποιείται στο μέσο:

→ Όλα ελαχιστοποιούνται στο μέσο

Συμπέρασμα:

Όταν λέμε ότι τα τρία μέτρα “ελαχιστοποιούνται στο μέσο όρο”, εννοούμε:

→ Ο μέσος όρος είναι η τιμή που κάνει αυτά τα μέτρα όσο το δυνατόν μικρότερα

→ Οποιαδήποτε άλλη τιμή (μοντέλο) θα δώσει μεγαλύτερες τιμές SS, διακύμανσης, και τυπικής απόκλισης

→ Αυτό δικαιολογεί τη χρήση του μέσου όρου ως το μοντέλου βάσης στη στατιστική ανάλυση

Είναι μια θεμελιώδης ιδιότητα του μέσου όρου που τον κάνει το φυσικό σημείο αναφοράς για τη μέτρηση της μεταβλητότητας και του σφάλματος μοντέλου.

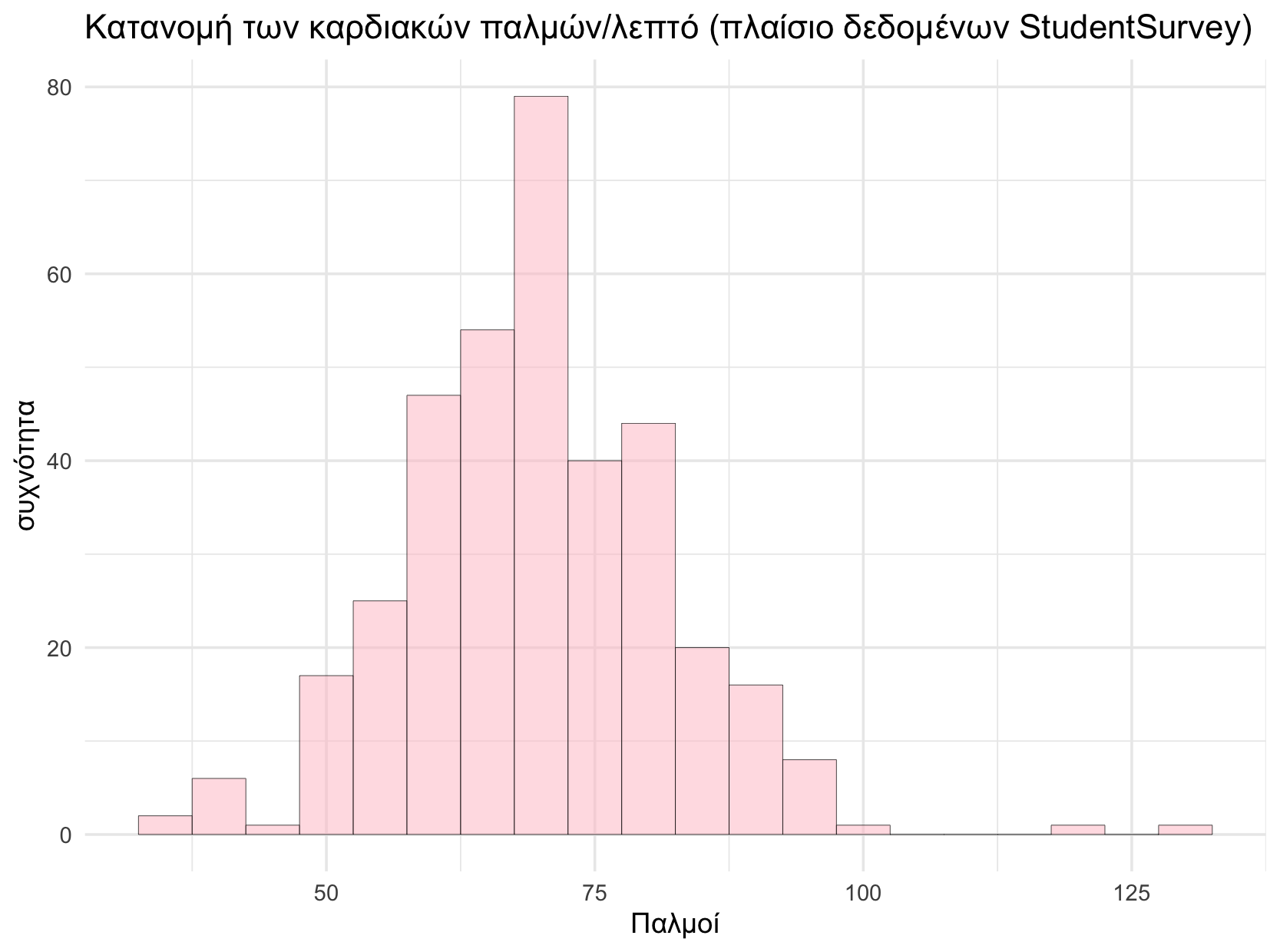

Εφαρμογή: Σκέψεις για την Ποσοτικοποίηση Σφάλματος στο StudentSurvey

Χρησιμοποιήστε την R για να δημιουργήσετε το κενό μοντέλο των καρδιακών παλμών (Pulse) φοιτητή. Θυμίζουμε ότι στην έρευνα συμμετείχαν 362 φοιτητές. Ονομάστε το μοντέλο empty_model. Έπειτα υπολογίστε το SS, τη διακύμανση, και την τυπική απόκλιση αυτού του μοντέλου.

Υπάρχουν πολλοί τρόποι να υπολογίσουμε αυτά τα στατιστικά στην R, αλλά τα αποτελέσματα θα είναι τα ίδια: SS = 53776.486, Διακύμανση (MS) = 148.965, και Τυπική Απόκλιση = 12.20514.

Ποιες από τις παρακάτω εντολές θα σας βοηθούσαν να υπολογίσετε το SS για τους καρδιακούς παλμούς (Pulse); (Υπάρχουν περισσότερες από μία σωστές απαντήσεις.)

Σωστές απαντήσεις: Α και Δ

Α - var(StudentSurvey$Pulse) * (362 - 1) - ΣΩΣΤΟ:

Μαθηματική σχέση:

\[Variance = \frac{SS}{n-1}\]

\[SS = Variance \times (n-1)\]

# Υπολογισμός SS από τη διακύμανση

variance <- var(StudentSurvey$Pulse, na.rm = TRUE)

n <- 362 # μέγεθος δείγματος

SS <- variance * (n - 1)

# Ή σε μία γραμμή

SS <- var(StudentSurvey$Pulse, na.rm = TRUE) * (362 - 1)Γιατί λειτουργεί:

Η

var()υπολογίζει τη διακύμανση: \(s^2 = \frac{\sum(x_i - \bar{x})^2}{n-1}\)Πολλαπλασιάζοντας με \((n-1)\) παίρνουμε: \(SS = s^2 \times (n-1) = \sum(x_i - \bar{x})^2\)

Δ - supernova(empty_model) - ΣΩΣΤΟ:

Γιατί οι άλλες επιλογές είναι λάθος:

Β - SS(Pulse) - ΛΑΘΟΣ:

Δεν υπάρχει συνάρτηση

SS()στη βασική RΘα δώσει σφάλμα: “could not find function ‘SS’”

Το SS πρέπει να υπολογιστεί με άλλο τρόπο

Γ - sum(abs(resid(empty_model))) - ΛΑΘΟΣ:

Αυτό υπολογίζει το Άθροισμα των Απόλυτων Αποκλίσεων (SAD), όχι το SS

SAD = \(\sum|Y_i - \bar{Y}|\) (απόλυτες τιμές)

SS = \(\sum(Y_i - \bar{Y})^2\) (τετράγωνα)

# Αυτό είναι λάθος για SS

sum(abs(resid(empty_model))) # SAD, όχι SS

# Το σωστό για SS είναι

sum(resid(empty_model)^2) # SSΕ - SS(empty_model) - ΛΑΘΟΣ:

Παρόμοια με το Β, δεν υπάρχει συνάρτηση

SS()Ακόμα κι αν υπήρχε, η σύνταξη θα ήταν διαφορετική

Συμπέρασμα:

Για να υπολογίσετε το SS για Pulse, οι δύο σωστοί τρόποι είναι:

var(StudentSurvey$Pulse) * (362 - 1)- Πολλαπλασιάζει τη διακύμανση με το n - 1 (τους βαθμούς ελευθερίας)supernova(empty_model)- Εμφανίζει τον πίνακα ANOVA που περιλαμβάνει το SS

Και οι δύο μέθοδοι θα δώσουν το ίδιο αποτέλεσμα, απλά με διαφορετικό τρόπο παρουσίασης.

Ποιες από τις παρακάτω εντολές R θα σας βοηθούσαν να υπολογίσετε τη διακύμανση των καρδιακών παλμών (‘Pulse’);

Σωστή απάντηση: Μόνο Γ (var(StudentSurvey$Pulse))

Γ - var(StudentSurvey$Pulse) - ΣΩΣΤΟ:

Γιατί λειτουργεί:

Η

var()είναι η σωστή συνάρτηση στην R για τη διακύμανσηStudentSurvey$Pulse σωστά αναφέρεται στη στήλη Pulse του πλαισίου δεδομένων

Υπολογίζει: \(s^2 = \frac{\sum(x_i - \bar{x})^2}{n-1}\)

Γιατί οι άλλες επιλογές είναι λάθος:

Α - Var(Pulse) - ΛΑΘΟΣ:

Κεφαλαίο V: Η συνάρτηση είναι

var()με μικρό v, όχιVar()Η R είναι case-sensitive (διακρίνει πεζά/κεφαλαία)

Θα δώσει σφάλμα: “could not find function ‘Var’”

Β - var(Pulse) - ΛΑΘΟΣ:

Λείπει το πλαίσιο δεδομένων: Το αντικείμενο Pulse δεν υπάρχει ως αυτόνομο, αλλά μέσα στο πλαίσιο δεδομένων

Χρειάζεται να προσδιορίσουμε από ποιο πλαίσιο δεδομένων προέρχεται

Θα δώσει σφάλμα: “object ‘Pulse’ not found”

# ΛΑΘΟΣ - δεν ξέρει που να βρει το αντικείμενο Pulse

var(Pulse)

# Error: object 'Pulse' not found

# ΣΩΣΤΟ - προσδιορίζει το πλαίσιο δεδομένων

var(StudentSurvey$Pulse)Εξαίρεση για Β:

Το var(Pulse) θα δούλευε μόνο αν:

# 1. Έχουμε κάνει attach

attach(StudentSurvey)

var(Pulse) # Τώρα δουλεύει

detach(StudentSurvey)

# 2. Ή χρησιμοποιούμε with

with(StudentSurvey, var(Pulse))

# 3. Ή έχουμε δημιουργήσει ξεχωριστό διάνυσμα

Pulse <- StudentSurvey$Pulse

var(Pulse) # Τώρα δουλεύειΑλλά χωρίς αυτά, το var(Pulse) δεν δουλεύει.

Δ - variance(StudentSurvey$Pulse) - ΛΑΘΟΣ:

Δεν υπάρχει συνάρτηση

variance()στη βασική RΗ σωστή συνάρτηση είναι

var(), όχιvariance()Θα δώσει σφάλμα: “could not find function ‘variance’”

Πρόσθετοι τρόποι υπολογισμού διακύμανσης:

1. Από το SS (όπως στην προηγούμενη ερώτηση):

# Αν έχουμε το SS

SS <- sum((StudentSurvey$Pulse - mean(StudentSurvey$Pulse, na.rm = TRUE))^2, na.rm = TRUE)

n <- length(na.omit(StudentSurvey$Pulse))

variance <- SS / (n - 1)2. Από τον πίνακα ANOVA:

empty_model <- lm(Pulse ~ NULL, data = StudentSurvey)

anova_table <- supernova(empty_model)

variance <- anova_table$MS[1] # MS = Mean Square = Variance3. Από την τυπική απόκλιση:

4. Βήμα-βήμα:

Ποιες από τις παρακάτω εντολές της R θα σας βοηθούσαν να υπολογίσετε την τυπική απόκλιση για των καρδιακών παλμών; (Υπάρχουν περισσότερες από μία σωστές απαντήσεις.)

Σωστές απαντήσεις: Α, Δ, και Ε

Α - favstats(~ Pulse, data = StudentSurvey) - ΣΩΣΤΟ:

Παράδειγμα αποτελεσμάτων:

min Q1 median Q3 max mean sd n missing

-5.0 0 2 4 10 2.133333 3.456789 75 0Γιατί λειτουργεί:

Η

favstats()από το πακέτο mosaic εμφανίζει πολλά στατιστικάΣτη στήλη sd βρίσκεται η τυπική απόκλιση

Δ - sd(StudentSurvey$Pulse) - ΣΩΣΤΟ:

Γιατί λειτουργεί:

Η

sd()είναι η βασική συνάρτηση για τυπική απόκλιση στην RΣωστή αναφορά στο πλαίσιο δεδομένων:

StudentSurvey$PulseΥπολογίζει: \(s = \sqrt{\frac{\sum(x_i - \bar{x})^2}{n-1}}\)

Ε - sqrt(var(StudentSurvey$Pulse)) - ΣΩΣΤΟ:

Γιατί λειτουργεί:

Μαθηματική σχέση: \(SD = \sqrt{Variance}\)

Η

var()δίνει τη διακύμανσηΗ

sqrt()παίρνει την τετραγωνική ρίζαΙσοδύναμο με

sd()

Γιατί οι άλλες επιλογές είναι λάθος:

Β - sd(Pulse) - ΛΑΘΟΣ:

Λείπει το πλαίσιο δεδομένων: Το Pulse δεν υπάρχει ως αυτόνομο αντικείμενο της R

Χρειάζεται

StudentSurvey$PulseΘα δώσει σφάλμα: “object ‘Pulse’ not found”

# ΛΑΘΟΣ - χωρίς πλαίσιο δεδομένων

sd(Pulse)

# Error: object 'Pulse' not found

# ΣΩΣΤΟ

sd(StudentSurvey$Pulse)Εξαίρεση: Θα δούλευε μόνο με attach(), with(), ή αν το Pulse υπάρχει ως αυτόνομο διάνυσμα της R.

Γ - SD(StudentSurvey$Pulse) - ΛΑΘΟΣ:

Κεφαλαίο SD: Η συνάρτηση είναι

sd()με μικρά γράμματαΗ R είναι case-sensitive

Θα δώσει σφάλμα: “could not find function ‘SD’”

# ΛΑΘΟΣ - κεφαλαία γράμματα

SD(StudentSurvey$Pulse)

# Error: could not find function "SD"

# ΣΩΣΤΟ - μικρά γράμματα

sd(StudentSurvey$Pulse)Επαλήθευση ισοδυναμίας:

# Μέθοδος 1: Άμεση με sd()

SD1 <- sd(StudentSurvey$Pulse, na.rm = TRUE)

# Μέθοδος 2: Από variance

SD2 <- sqrt(var(StudentSurvey$Pulse, na.rm = TRUE))

# Μέθοδος 3: Από favstats

stats <- favstats(~ Pulse, data = StudentSurvey)

SD3 <- stats$sd

# Έλεγχος

all.equal(SD1, SD2, SD3)

# TRUE - όλες δίνουν το ίδιο!Πρόσθετοι τρόποι υπολογισμού SD:

1. Από SS:

SS <- sum((StudentSurvey$Pulse - mean(StudentSurvey$Pulse, na.rm = TRUE))^2, na.rm = TRUE)

n <- sum(!is.na(StudentSurvey$Pulse))

SD <- sqrt(SS / (n - 1))2. Από ANOVA table:

empty_model <- lm(Pulse ~ NULL, data = StudentSurvey)

anova_table <- supernova(empty_model)

SD <- sqrt(anova_table$MS[1]) # MS = variance3. Βήμα-βήμα:

Ταιριάξτε κάθε μέτρο σφάλματος με τη σωστή ερμηνεία του.

SS (Άθροισμα Τετραγώνων):

Διακύμανση (Variance):

Τυπική απόκλιση (Standard Deviation)):

Σωστές αντιστοιχίσεις:

SS → Άθροισμα τετραγωνικών αποκλίσεων από το μέσο όρο, σε τετραγωνικά χιλιόμετρα

Διακύμανση → Μέση τετραγωνική απόκλιση από το μέσο όρο, σε τετραγωνικά χιλιόμετρα

Τυπική απόκλιση → Μέση απόκλιση από το μέσο όρο, σε χιλιόμετρα

Αναλυτική εξήγηση:

SS (Άθροισμα Τετραγώνων):

\[SS = \sum_{i=1}^{n}(x_i - \bar{x})^2\]

Ερμηνεία:

Σύνολο (άθροισμα, όχι μέσος όρος)

Τετραγωνικές αποκλίσεις

Μονάδες: τετραγωνικά χιλιόμετρα (km²)

Διακύμανση:

\[s^2 = \frac{SS}{n-1} = \frac{\sum_{i=1}^{n}(x_i - \bar{x})^2}{n-1}\]

Ερμηνεία:

Μέση (μέσος όρος τετραγωνικών αποκλίσεων)

Τετραγωνική απόκλιση

Μονάδες: τετραγωνικά χιλιόμετρα (km²)

Τυπική απόκλιση:

\[s = \sqrt{s^2} = \sqrt{\frac{\sum_{i=1}^{n}(x_i - \bar{x})^2}{n-1}}\]

Ερμηνεία:

Μέση (μέσος όρος)

Απόκλιση, όχι στο τετράγωνο

Μονάδες: χιλιόμετρα (km)

Μαθηματικές σχέσεις:

Σύμβολα για Μέσο Όρο, Διακύμανση και Τυπική Απόκλιση

Τέλος, χρησιμοποιούμε διαφορετικά σύμβολα για να αναπαραστήσουμε τη διακύμανση και την τυπική απόκλιση ενός δείγματος από τη μία πλευρά, και του πληθυσμού (ή της ΔΠΔ) από την άλλη.

Τα δειγματικά στατιστικά ονομάζονται επίσης εκτιμητές επειδή στο πλαίσιο της στατιστικής μοντελοποίησης χρησιμοποιούνται ως εκτιμήσεις των παραμέτρων της ΔΠΔ. Έχουμε συνοψίσει αυτά τα σύμβολα στον παρακάτω πίνακα (η προφορά των συμβόλων αναγράφεται σε παρένθεση).

| Στατιστικό Μέτρο | Δείγμα (ή Εκτιμητής) | ΔΠΓ (ή Πληθυσμός) |

|---|---|---|

| Μέσος Όρος | \(\bar{Y}\) (y παύλα) | \(\mu\) (μι) |

| Διακύμανση | \(s^2\) (s τετράγωνο) | \(\sigma^2\) (σίγμα τετράγωνο) |

| Τυπική Απόκλιση | \(s\) (s) | \(\sigma\) (σίγμα) |

Σημειώσεις:

- Τα λατινικά γράμματα (\(\bar{Y}\), \(s\), \(s^2\)) αναφέρονται στο δείγμα

- Τα ελληνικά γράμματα (\(\mu\), \(\sigma\), \(\sigma^2\)) αναφέρονται στον πληθυσμό

Όπως προαναφέρθηκε, υπάρχουν συχνά πολλοί διαφορετικοί όροι που αντιπροσωπεύουν τις ίδιες ιδέες στη στατιστική. Θα συναντήσετε συχνά τον όρο «μέσο τετραγωνικό σφάλμα». Σε ποιο από τα παρακάτω πιστεύετε ότι αναφέρεται;

Διακύμανση είναι η σωστή απάντηση.

Ανάλυση του όρου “Mέσο Τετραγωνικό Σφάλμα (Mean Square ή Mean Squared Error)” (MSE):

Αναλύοντας τις λέξεις:

Mean = Μέσος όρος

Squared = Τετραγωνικό

Error = Σφάλμα/Απόκλιση

Άρα: Mean Squared Error = Μέσος όρος τετραγώνων των σφαλμάτων

Μαθηματική σύνδεση:

Διακύμανση:

\[s^2 = \frac{\sum(x_i - \bar{x})^2}{n-1}\]

Αυτό είναι:

Μέσος όρος

Τετραγώνων

Σφαλμάτων/αποκλίσεων από το μέσο

Επομένως, διακύμανση = μέσο τετραγωνικό σφάλμα!

Γιατί οι άλλες επιλογές είναι λάθος:

Α - Μέσος όρος - ΛΑΘΟΣ:

Ο μέσος όρος είναι απλά: \(\bar{x} = \frac{\sum x_i}{n}\)

Δεν περιλαμβάνει “τετράγωνα” ή “σφάλματα”

Δεν είναι μέτρο διασποράς

Γ - Τυπική απόκλιση - ΛΑΘΟΣ:

SD = \(\sqrt{variance}\) = ρίζα του μέσου τετραγωνικού σφάλματος

Είναι η “τετραγωνική ρίζα του μέσου τετραγωνικού σφάλματος”, όχι το “μέσο τετραγωνικό σφάλμα”

Δεν είναι στο τετράγωνο - έχει γραμμικές μονάδες

7.5 Τυποποιημένες Τιμές (Τιμές z)

Έχουμε εξετάσει το μέσο όρο ως μοντέλο και έχουμε δει μερικούς τρόπους ποσοτικοποίησης του συνολικού σφάλματος γύρω από το μέσο όρο, καθώς και μερικούς καλούς λόγους για να το κάνουμε αυτό. Υπάρχει όμως και ένας άλλος λόγος να εξετάσουμε μαζί το μέσο όρο και το σφάλμα. Μερικές φορές, συνδυάζοντας τις δύο αυτές ιδέες, μπορούμε να κατανοήσουμε καλύτερα πού βρίσκεται μια συγκεκριμένη τιμή σε μια κατανομή.

Μια φοιτήτρια (ας την ονομάσουμε Σοφία) έχει μήκος αντίχειρα 65.1mm. Τι σημαίνει αυτό; Είναι ένας μεγάλος αντίχειρας; Πώς μπορούμε να το γνωρίζουμε αυτό; Ίσως αρχίζετε να αντιλαμβάνεστε ότι το να γνωρίζετε μόνο μια μεμονωμένη τιμή της μεταβλητής δεν σας λέει πολλά.

Για να ερμηνεύσουμε το νόημα μιας μεμονωμένης τιμής, βοηθάει να γνωρίζουμε και κάτι για την κατανομή από την οποία προέρχεται η τιμή. Συγκεκριμένα, είναι σημαντικό να γνωρίζουμε κάτι για το σχήμα, το κέντρο και τη διασπορά της.

Ας πούμε ότι εκτός από το ότι γνωρίζουμε ότι το μήκος του αντίχειρα της Σοφίας είναι 65.1mm, γνωρίζουμε επίσης ότι ο μέσος όρος της κατανομής των μηκών αντίχειρα είναι 60.1mm. Τι μας δείχνει αυτό που δεν γνωρίζαμε πριν μάθουμε το μέσο όρο;

Τώρα γνωρίζουμε πόσο μακρύς είναι αυτός ο αντίχειρας σε σχέση με τους άλλους αντίχειρες στο δείγμά μας είναι η σωστή απάντηση.

Τι γνωρίζαμε πριν:

Μόνο η μεμονωμένη τιμή: Μήκος αντίχειρα Σοφίας = 65.1mm

Δεν είχαμε πλαίσιο σύγκρισης

Δεν ξέραμε αν αυτό είναι μεγάλο, μικρό, ή μεσαίο μέγεθος

Τι γνωρίζουμε τώρα:

Μεμονωμένη τιμή: 65.1mm

Μέσος όρος: 60.1mm

Σχετική θέση: 65.1 - 60.1 = +5mm πάνω από το μέσο όρο

Η σημασία του μέσου όρου:

Ο μέσος όρος δίνει σημείο αναφοράς:

Μπορούμε να υπολογίσουμε: Απόκλιση = 65.1 - 60.1 = +5mm

Ξέρουμε ότι ο αντίχειρας της Σοφίας είναι πάνω από το κέντρο της κατανομής

Μπορούμε να την τοποθετήσουμε σε σχέση με άλλους

Γιατί οι άλλες επιλογές είναι λάθος ή ανακριβείς:

Β - “Σε σχέση με άλλους μεγάλους αντίχειρες” - ΛΑΘΟΣ:

Ο μέσος όρος δεν δείχνει κάτι για τους “μεγάλους” αντίχειρες συγκεκριμένα

Δείχνει το κέντρο όλων των αντιχείρων

Χρειαζόμαστε περισσότερες πληροφορίες (π.χ. Q3, max) για σύγκριση με μεγάλους

Γ - “Ένας από τους μακρύτερους” - ΛΑΘΟΣ:

Δεν μπορούμε να το ξέρουμε μόνο από το μέσο όρο

-

65.1mm είναι 5mm πάνω από το μέσο, αλλά:

Αν η διακύμανση είναι μικρή, μπορεί να είναι στο ανώτερο 10%

Αν η διακύμανση είναι μεγάλη, μπορεί να είναι μόνο στο 60ο εκατοστημόριο

Χρειαζόμαστε την τυπική απόκλιση ή την κατανομή για να το ξέρουμε

Δ - “Μεγαλύτερος από το μέσο και αυτό είναι όλο” - ΑΝΕΠΑΡΚΕΣ:

Αυτό είναι μερικώς σωστό αλλά ελλιπές

-

Όχι μόνο ξέρουμε ότι είναι μεγαλύτερος, αλλά ξέρουμε:

Πόσο μεγαλύτερος (+5mm)

Τη σχετική του θέση στην κατανομή

Πώς συγκρίνεται με τον τυπικό αντίχειρα

Συμπέρασμα:

Γνωρίζοντας τον μέσο όρο μετατρέπουμε την απόλυτη τιμή “65.1mm” σε σχετική πληροφορία: “5mm πάνω από το μέσο όρο του δείγματος”.

Αυτό μας δίνει ένα πλαίσιο σύγκρισης - τώρα μπορούμε να:

Τοποθετήσουμε τον αντίχειρα της Σοφίας σε σχέση με άλλους στο δείγμα

Καταλάβουμε ότι είναι πάνω από το κέντρο της κατανομής

Υπολογίσουμε την απόκλιση (+5mm)

Χωρίς το μέσο όρο, το “65.1mm” είναι απλά ένας αριθμός χωρίς νόημα. Με το μέσο όρο, καταλαβαίνουμε πού βρίσκεται αυτή η τιμή στο πλαίσιο όλων των άλλων μετρήσεων.

Γνωρίζουμε ότι ο αντίχειρας αυτής της φοιτήτριας είναι περίπου 5mm μεγαλύτερος από το μέσο όρο. Αλλά επειδή δεν έχουμε ιδέα για τη διασπορά της κατανομής, εξακολουθούμε να μην έχουμε πολύ σαφή εικόνα για το πώς να χαρακτηρίσουμε το μήκος αντίχειρα 65.1mm. Είναι τα 5mm αρκετά κοντά στο μέσο όρο, ή είναι μακριά; Είναι δύσκολο να το πούμε αυτό χωρίς να γνωρίζουμε πώς είναι η διασπορά των μηκών αντίχειρα.

Ποιο από τα παρακάτω μέτρα διασποράς θα μπορούσε να είναι πιο χρήσιμο για τη μέτρηση του πόσο μακριά είναι το 65.1mm από το μέσο όρο;

Τυπική απόκλιση, μέσο σφάλμα: 8.726695 είναι η σωστή απάντηση.

Γιατί η Τυπική απόκλιση είναι η πιο χρήσιμη:

1. Ίδιες μονάδες με την απόκλιση:

Μήκος αντίχειρα της Σοφίας: 65.1mm

Μέσος όρος: 60.1mm

Απόκλιση: 65.1 - 60.1 = 5mm

Τυπική απόκλιση: 8.73mm (στις ίδιες μονάδες!)

Μπορούμε να συγκρίνουμε άμεσα:

Η απόκλιση της Σοφίας (5mm) vs τυπική απόκλιση (8.73mm)

Η Σοφία είναι 5/8.73 ≈ 0.57 τυπικές αποκλίσεις πάνω από το μέσο

2. Άμεση ερμηνεία:

# Υπολογισμός τιμής z

deviation <- 65.1 - 60.1 # 5mm

SD <- 8.73 #mm

z_score <- deviation / SD

# z = 5 / 8.73 ≈ 0.57

# Ερμηνεία: Ο αντίχειρας της Σοφίας είναι

# 0.57 τυπικές αποκλίσεις πάνω από το μέσο

# Αυτό είναι λίγο πάνω από το μέσο, αλλά όχι εξαιρετικά3. Κατανοητή κλίμακα:

SD = 8.73mm λέει: “Η τυπική απόσταση από το μέσο είναι ~9mm”

Η Σοφία με +5mm είναι εντός μιας SD

Άρα είναι σχετικά κοντά στο μέσο όρο

Γιατί οι άλλες επιλογές είναι λιγότερο χρήσιμες:

Α - SS (11880.21) - ΛΙΓΟΤΕΡΟ ΧΡΗΣΙΜΟ:

Προβλήματα:

Τετραγωνικές μονάδες: 11880.21mm² vs 5mm (δεν συγκρίνονται)

Συνολικό μέγεθος: Το SS είναι άθροισμα για όλο το δείγμα, όχι για ένα άτομο

Εξαρτάται από n: Μεγαλύτερο δείγμα → μεγαλύτερο SS (ακόμα και με ίδια διασπορά)

# Δεν μπορούμε να συγκρίνουμε

deviation <- 5 # mm

SS <- 11880.21 # mm²

# Τι κάνουμε με αυτά; Δεν έχει νόημα!Β - Διακύμανση (76.1552) - ΛΙΓΟΤΕΡΟ ΧΡΗΣΙΜΟ:

Προβλήματα:

Τετραγωνικές μονάδες: 76.16mm² vs 5mm (δεν συγκρίνονται άμεσα)

Δύσκολη ερμηνεία: Τι σημαίνει “76.16 τετραγωνικά mm” στην πράξη;

Χρειάζεται μετατροπή: Πρέπει να πάρουμε √variance για χρήσιμη σύγκριση

# Μη φυσική σύγκριση

deviation <- 5 # mm

variance <- 76.16 # mm²

# Πρέπει να μετατρέψουμε σε SD πρώτα

SD <- sqrt(variance) # 8.73 mm

z <- deviation / SD # Τώρα έχει νόημα!Σύγκριση των τριών μέτρων:

Μέτρο | Τιμή | Μονάδες | Σύγκριση με 5mm | Χρησιμότητα

---------- | --------- | ------- | --------------- | -----------

SS | 11,880.21 | mm² | Αδύνατη | Χαμηλή

Variance | 76.16 | mm² | Αδύνατη | Μέτρια

SD | 8.73 | mm | 5/8.73 = 0.57 | ΥψηλήΣυμπέρασμα:

Η Τυπική απόκλιση (8.73mm) είναι το πιο χρήσιμο μέτρο επειδή:

Ίδιες μονάδες με την απόκλιση (mm) - άμεση σύγκριση

Επιτρέπει υπολογισμό της τιμής z: deviation/SD = 5/8.73 = 0.57

Άμεση ερμηνεία: “Ο αντίχειρας της Σοφίας είναι 0.57 τυπικές αποκλίσεις πάνω από το μέσο - σχετικά κοντά στο κέντρο”

Τα SS και Διακύμανση, με τετραγωνικές μονάδες, δεν μπορούν να συγκριθούν άμεσα με μια απόκλιση σε γραμμικές μονάδες.

Αν και το SS θα είναι πολύ χρήσιμο αργότερα, για αυτόν τον σκοπό είναι άχρηστο. Οι αριθμοί 65.1 και 11880 δεν φαίνεται να ανήκουν στο ίδιο σύμπαν! Η διακύμανση θα είναι χρήσιμη σε κάποιες περιπτώσεις, αλλά οι μονάδες της είναι κάπως δύσκολο να ερμηνευτούν. Είναι δύσκολο να χρησιμοποιήσουμε τα τετραγωνικά χιλιοστά ως μονάδα όταν προσπαθούμε να κατανοήσουμε απλά χιλιοστά.

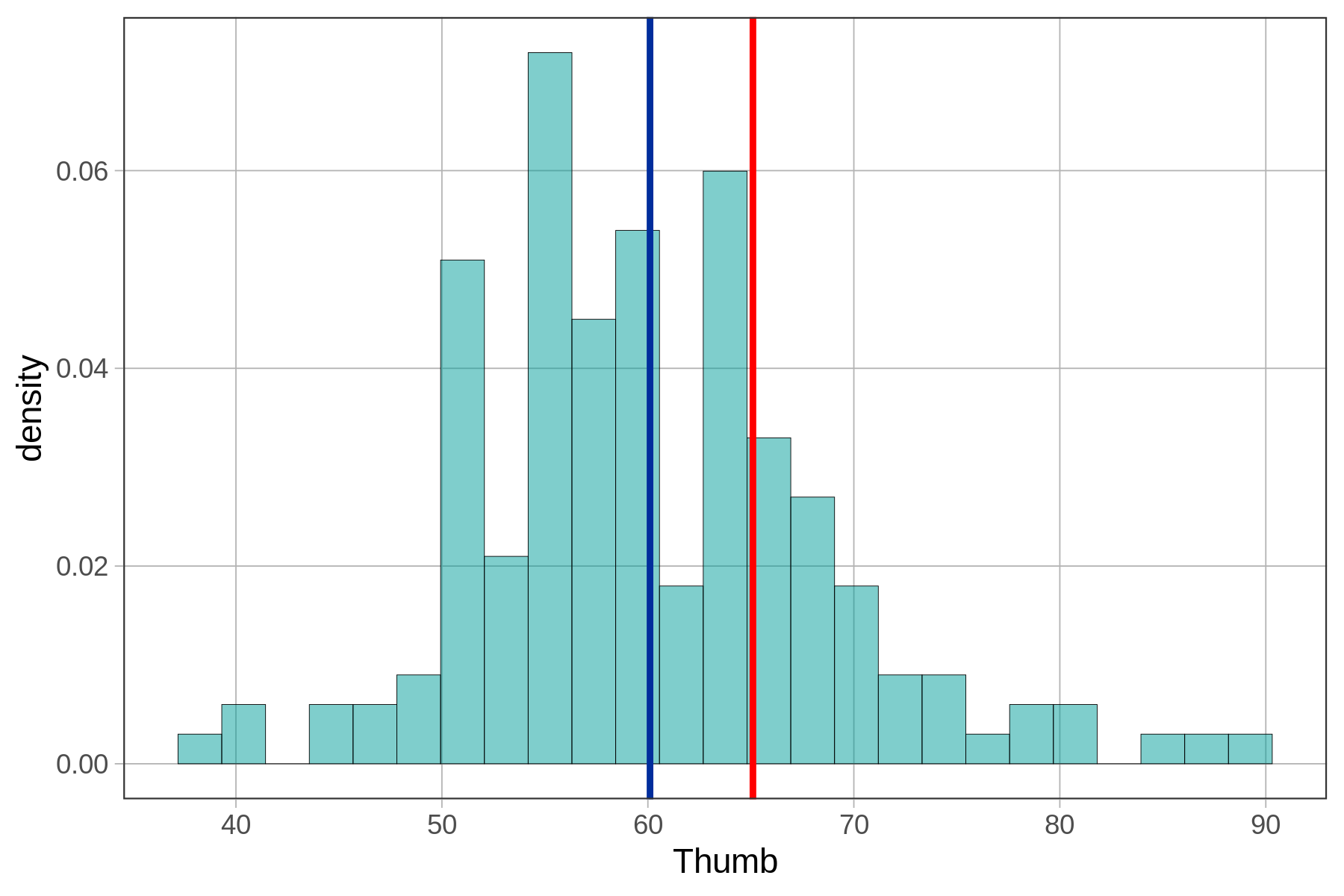

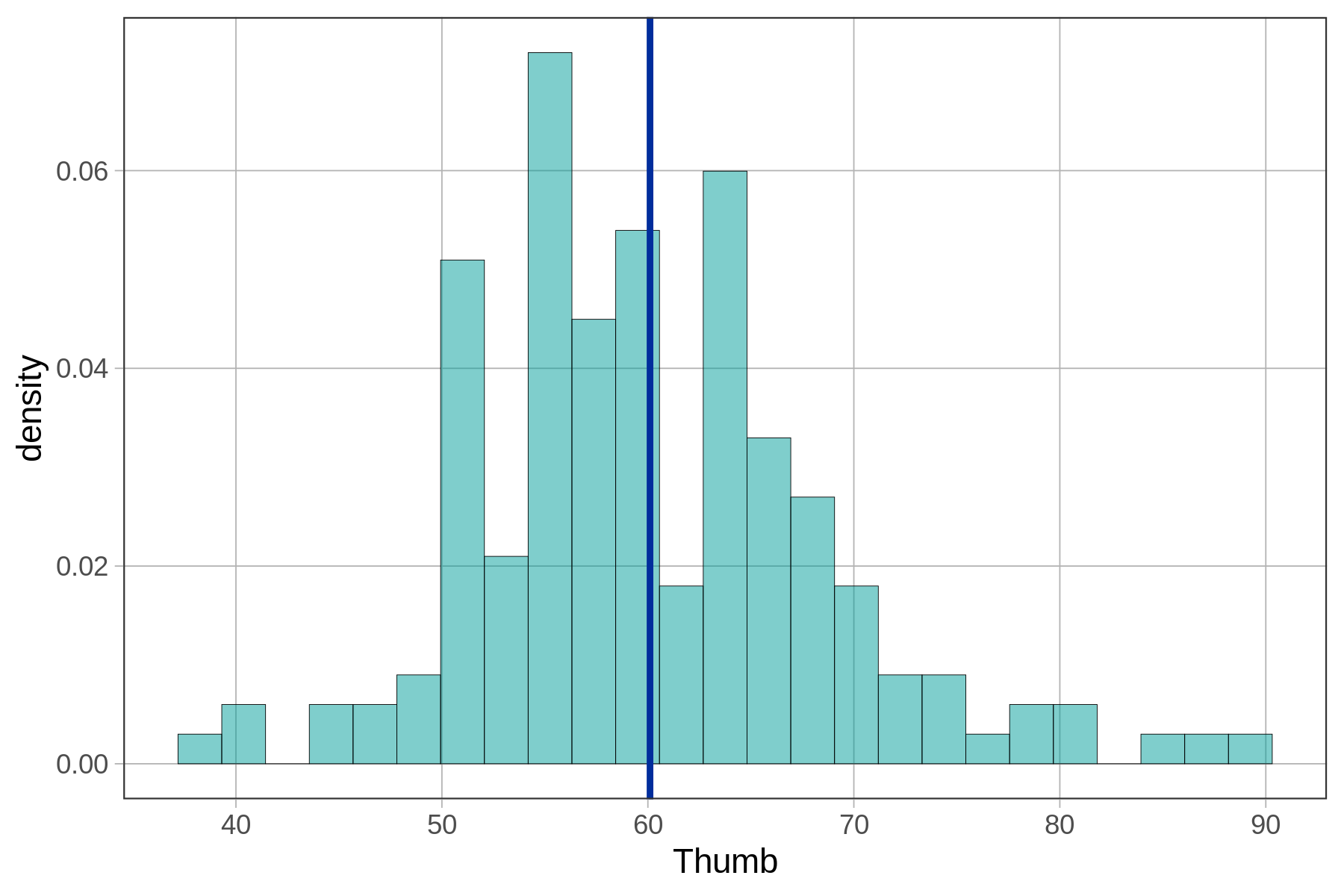

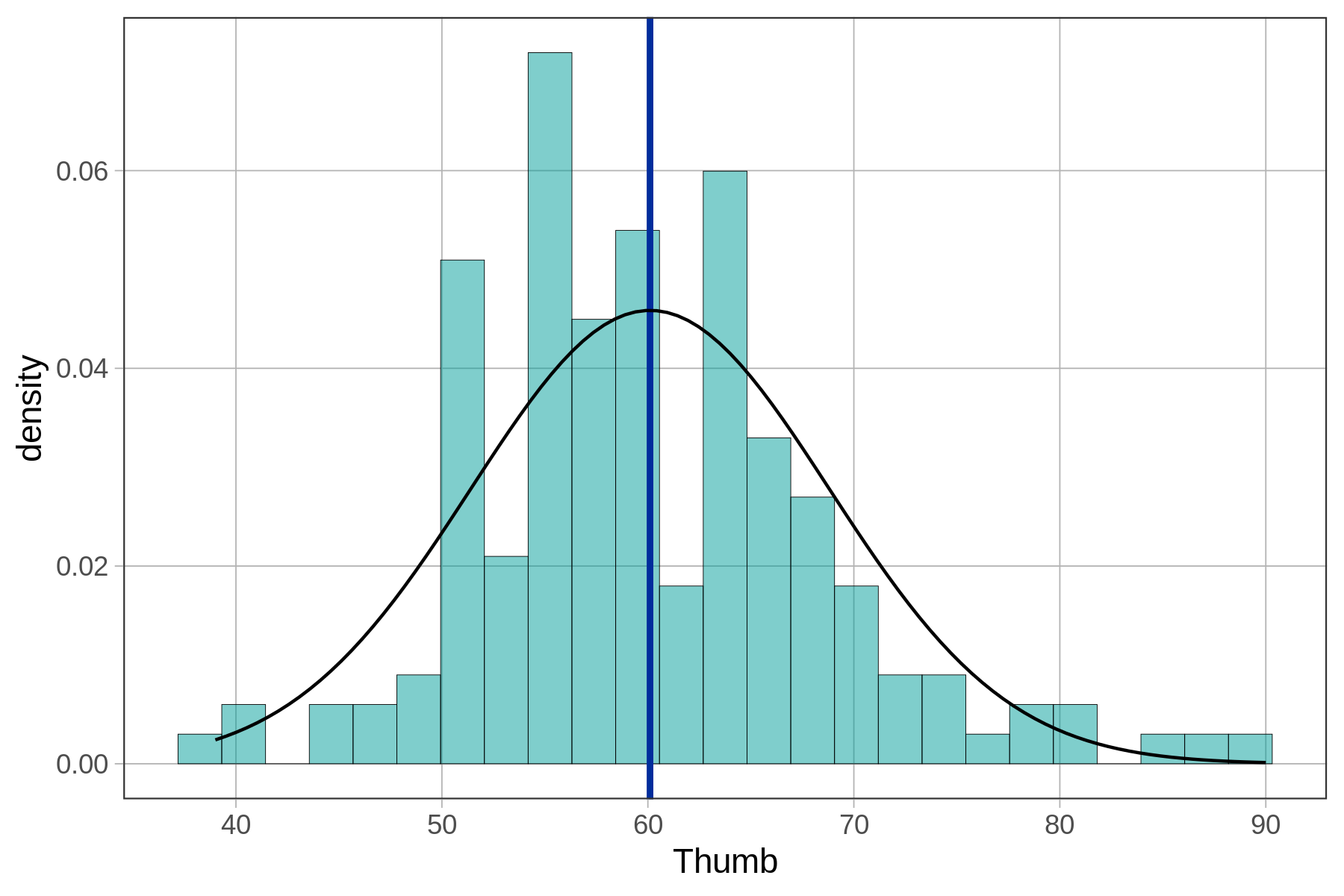

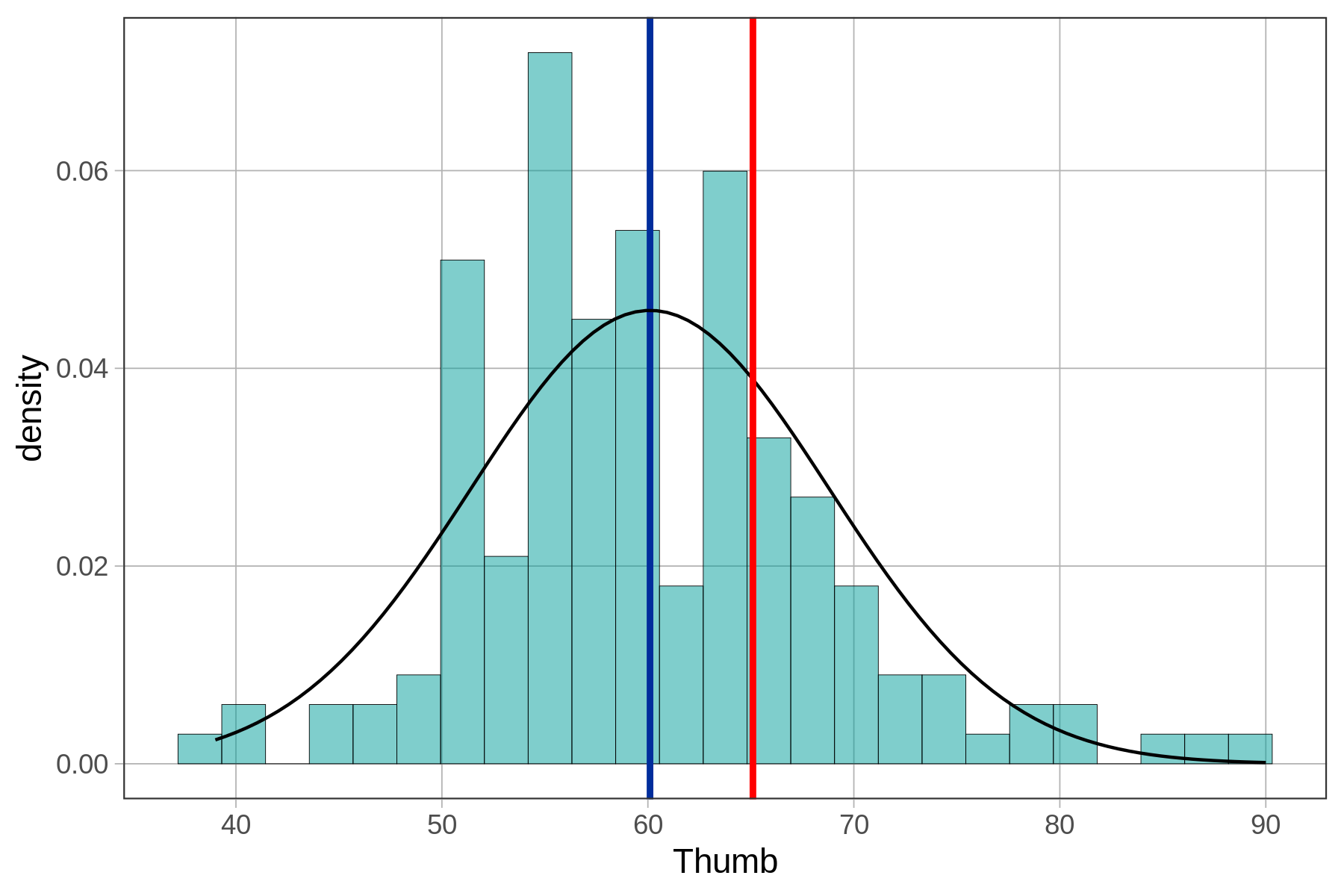

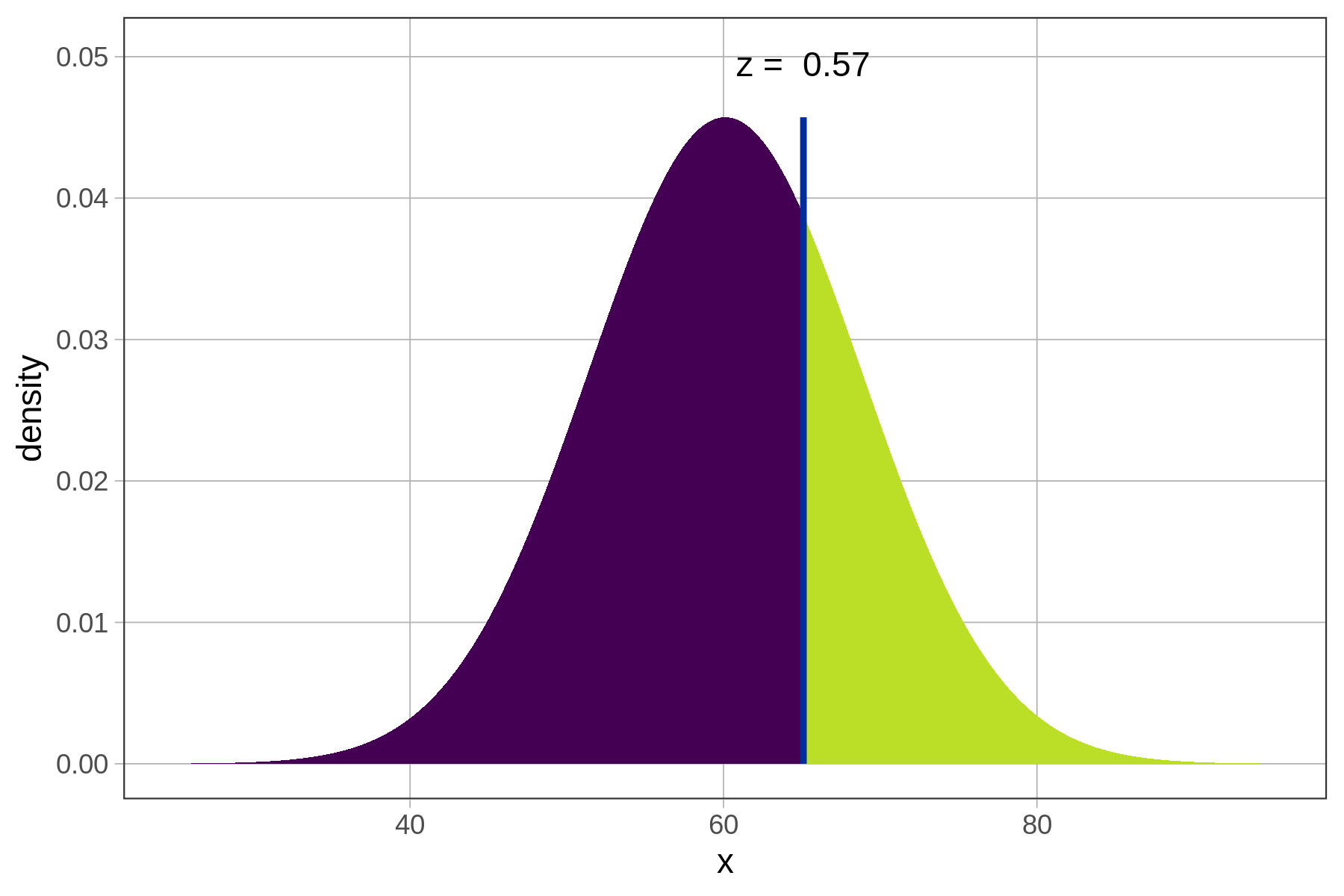

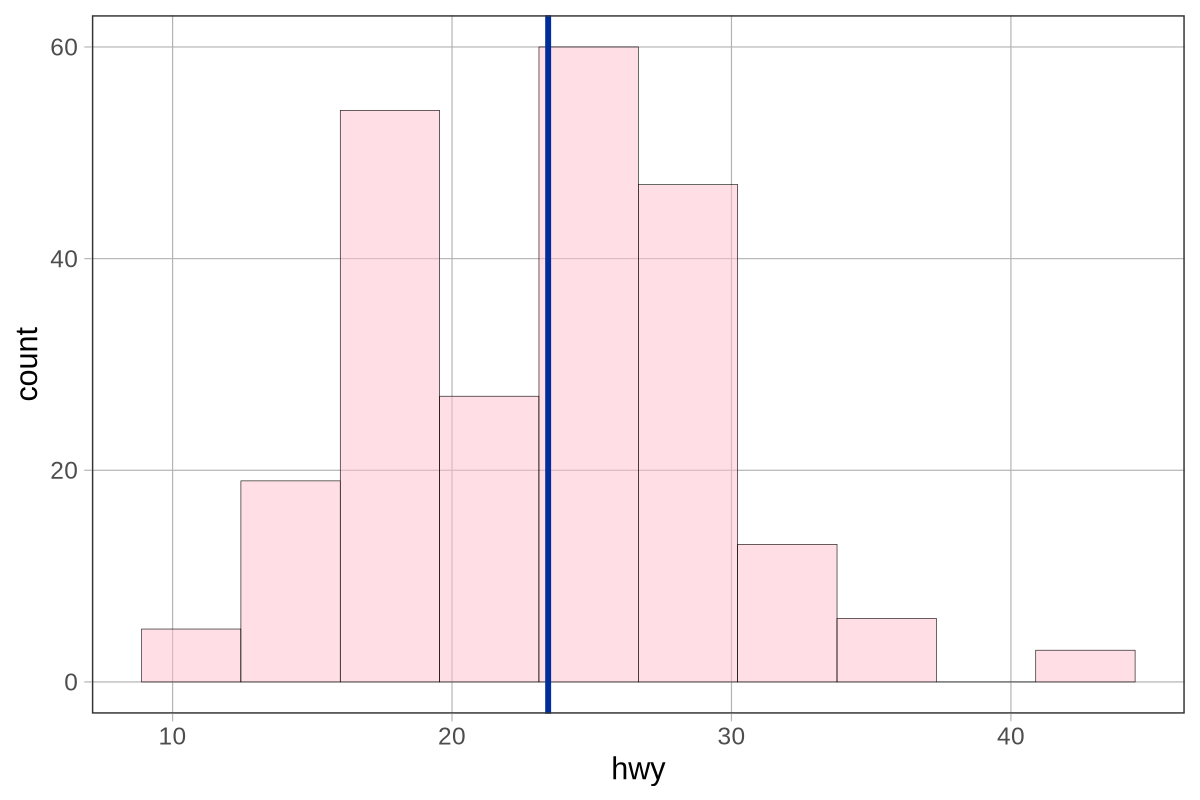

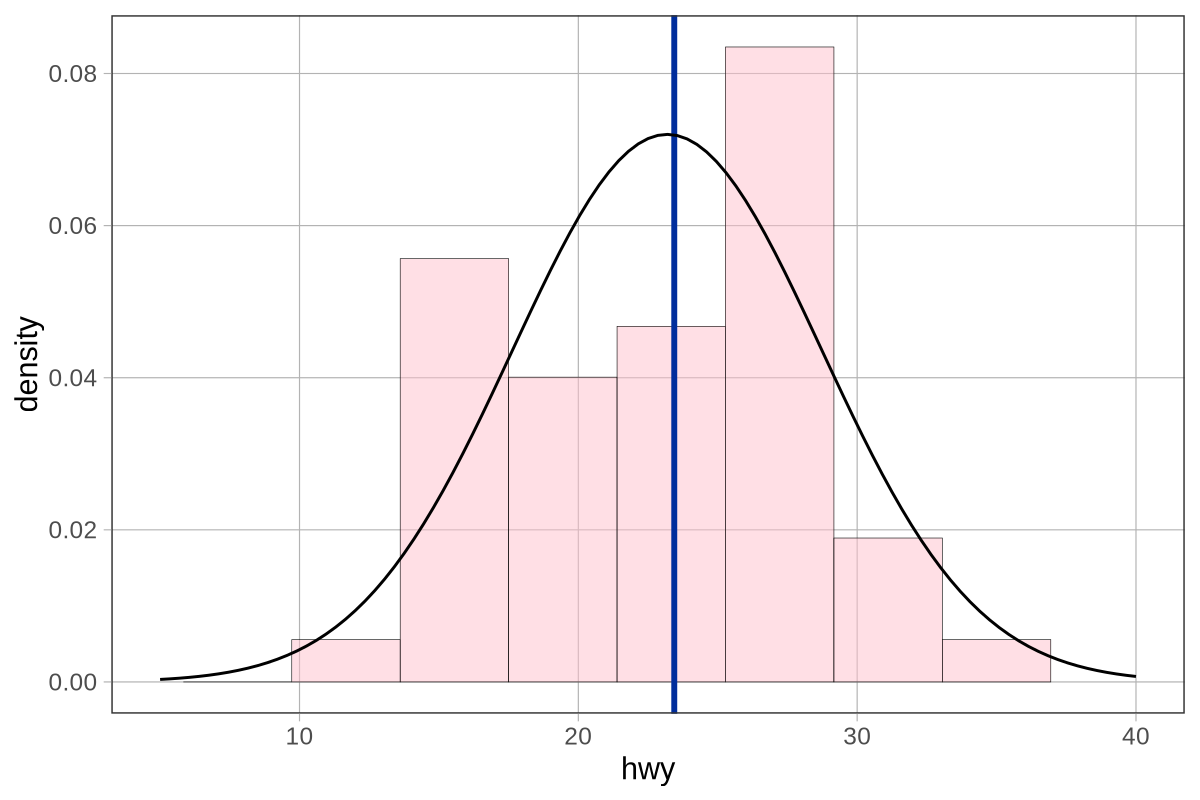

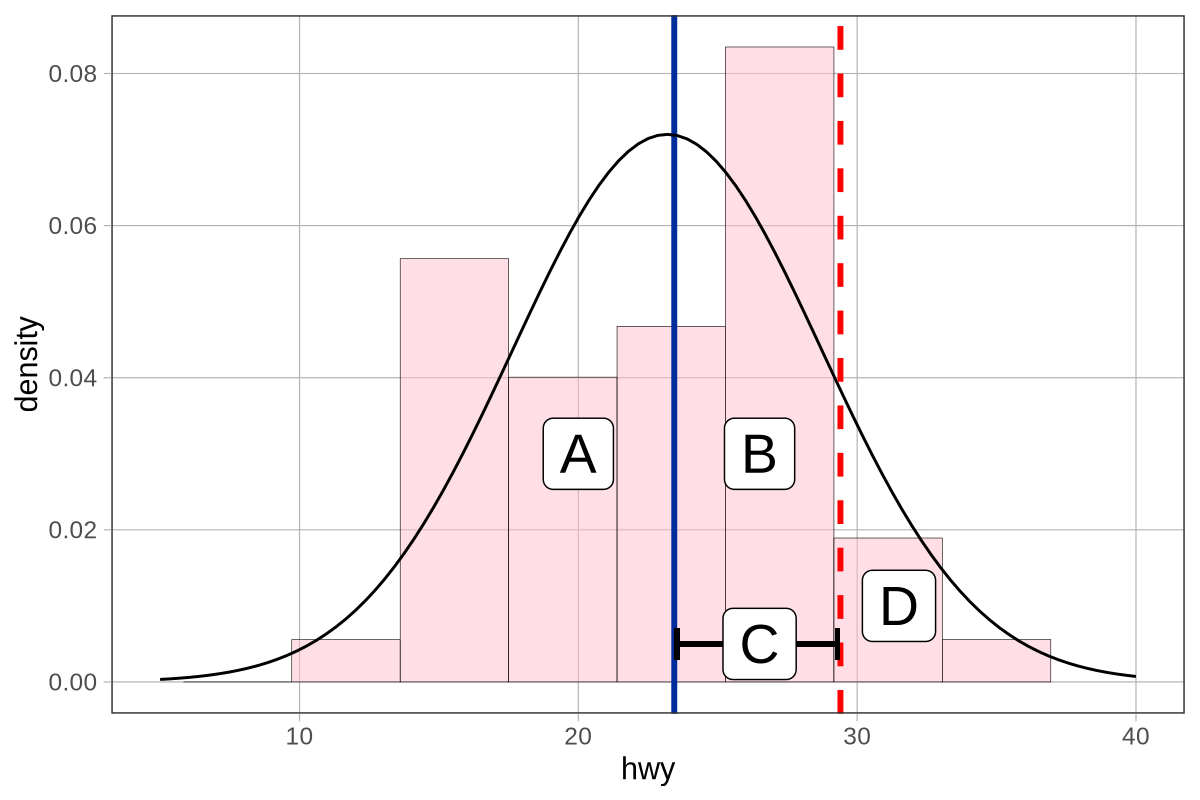

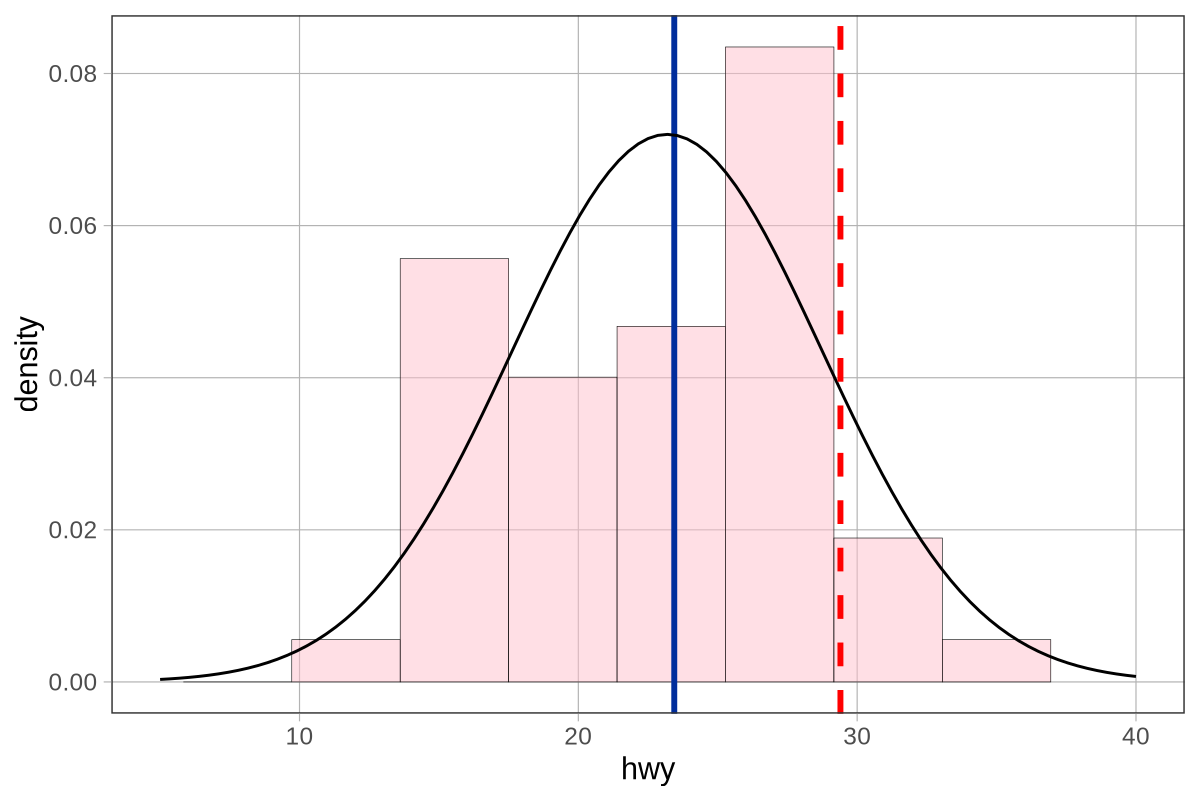

Η τυπική απόκλιση, από την άλλη πλευρά, είναι πραγματικά χρήσιμη. Γνωρίζουμε ότι ο αντίχειρας της Σοφίας είναι περίπου 5mm μεγαλύτερος από το μέσο αντίχειρα. Αλλά τώρα γνωρίζουμε επίσης ότι, κατά μέσο όρο, οι αντίχειρες απέχουν 8.7mm από το μέσο όρο, τόσο προς τα πάνω όσο και προς τα κάτω. Αν και ο αντίχειρας της Σοφίας είναι πάνω από το μέσο όρο σε μήκος, σίγουρα δεν είναι ένας από τους μεγαλύτερους αντίχειρες στην κατανομή. Ας εξετάσουμε το παρακάτω ιστόγραμμα για να δούμε αν αυτή η ερμηνεία υποστηρίζεται.

Ο μέσος όρος του μήκους αντίχειρα εμφανίζεται με μπλε, και ο αντίχειρας της Σοφίας (65.1mm) εμφανίζεται με κόκκινο.

Συνδυασμός Μέσου Όρου και Τυπικής Απόκλισης

Στην περίπτωση του μήκους αντίχειρα (Thumb), βρίσκουμε χρήσιμο να συνδυάσουμε το μέσο όρο και την τυπική απόκλιση για να ερμηνεύσουμε το νόημα μιας μεμονωμένης τιμής. Στο σημείο αυτό, ας εισάγουμε ένα μέτρο που θα συνδυάσει αυτές τις δύο πληροφορίες σε μία μόνο τιμή: την τιμή z (τυποποιημένη τιμή).

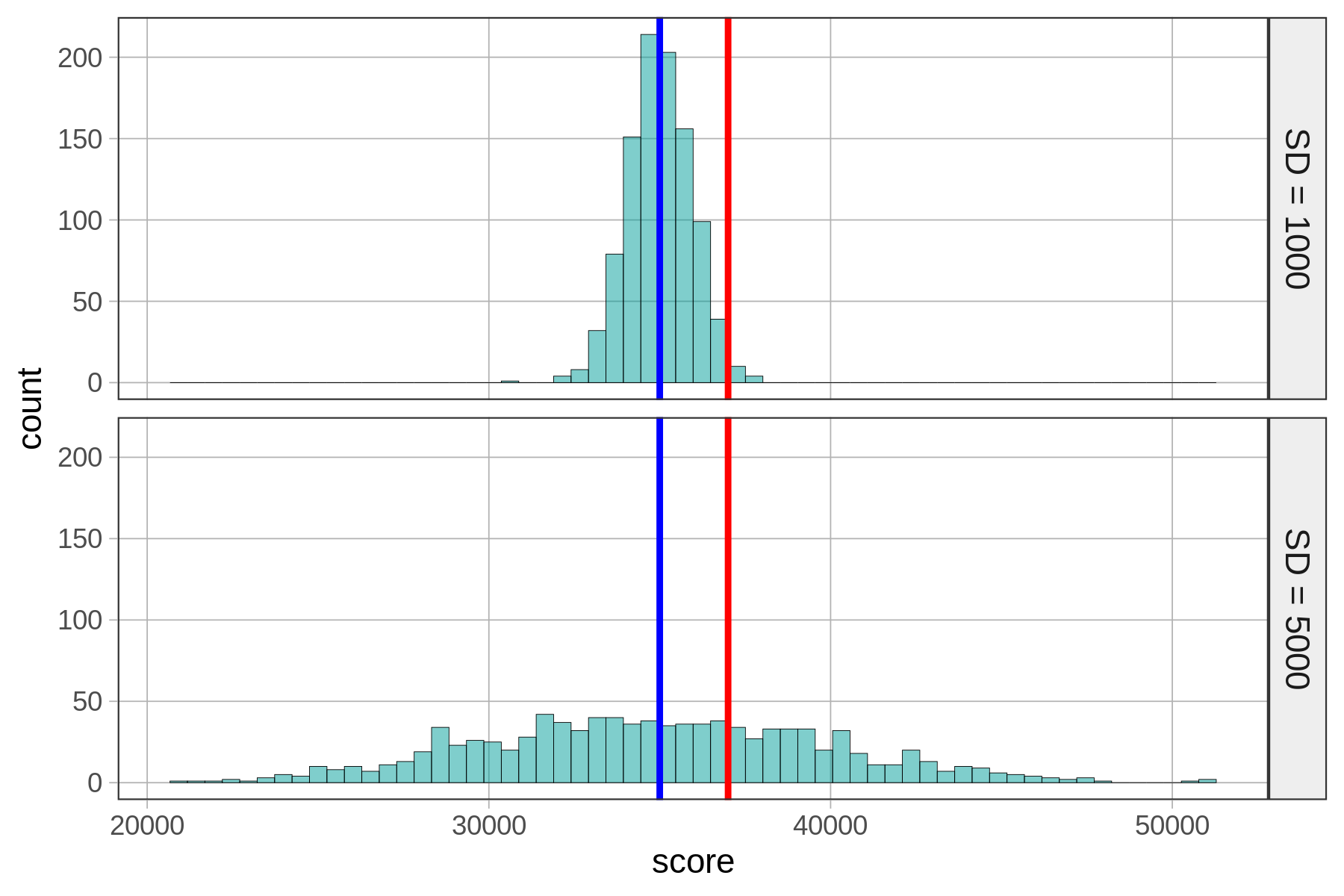

Ένας φίλος σας έχει συγκεντρώσει 37.000 πόντους σε ένα βιντεοπαιχνίδι που ονομάζεται Kargle. Είναι καλό σκορ; Πώς το γνωρίζετε αυτό; Τι άλλο θα θέλατε να μάθετε για να απαντήσετε σε αυτήν την ερώτηση;

Ας υποθέσουμε ότι γνωρίζετε ότι ο μέσος όρος του σκορ όλων των παικτών είναι 35.000. Θα σας βοηθούσε αυτό; Σαφώς θα βοηθούσε. Θα γνωρίζατε ότι το σκορ 37.000 είναι πάνω από το μέσο όρο κατά 2.000 πόντους. Αλλά ακόμα κι αν σας βοηθάει να ερμηνεύσετε το 37.000, δεν είναι αρκετό. Αυτό που δεν σας λέει είναι πόσο πάνω από το μέσο όρο είναι οι 37.000 πόντοι σε σχέση με ολόκληρη την κατανομή.

Τι κοινό έχουν οι 37.000 πόντοι στην περίπτωση του Kargle και το 65.1mm στην περίπτωση του μήκους αντίχειρα;

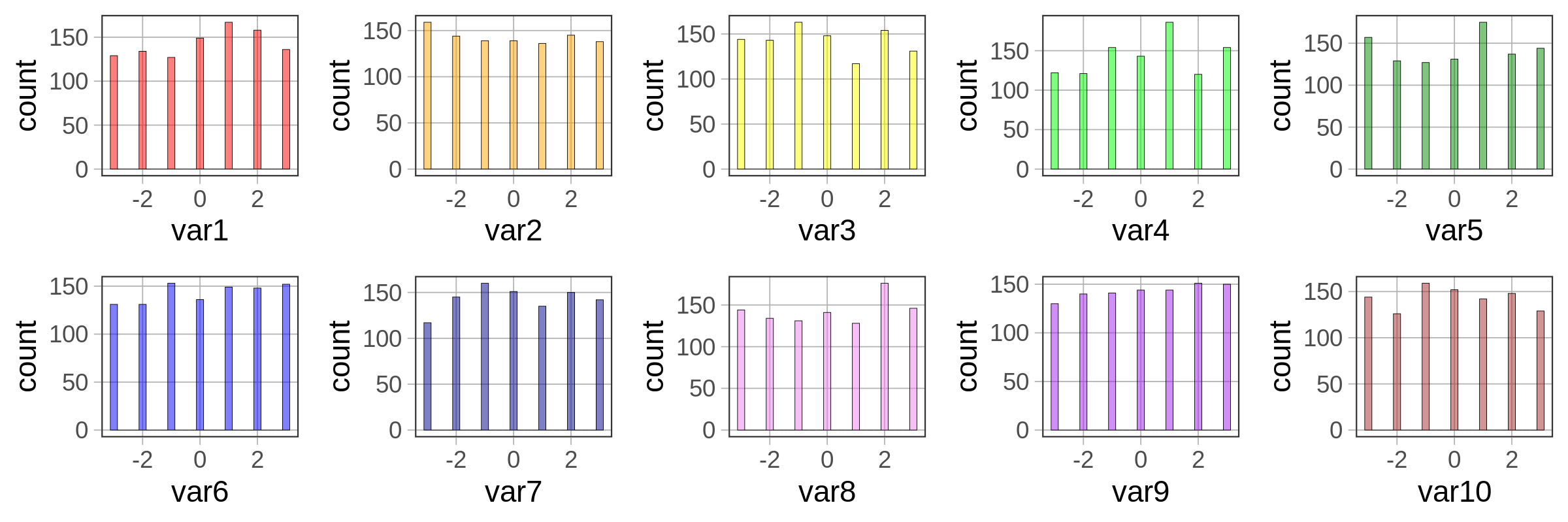

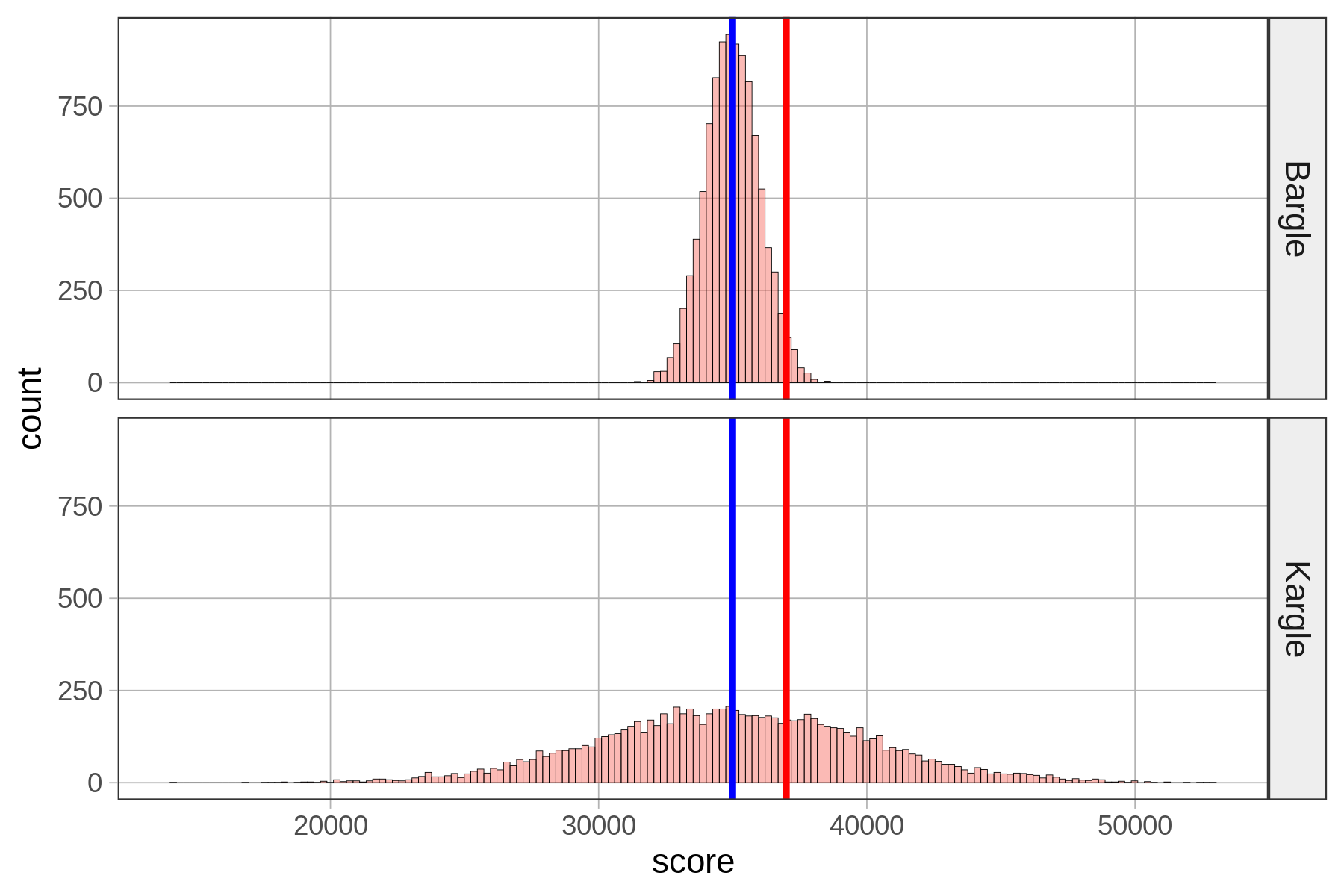

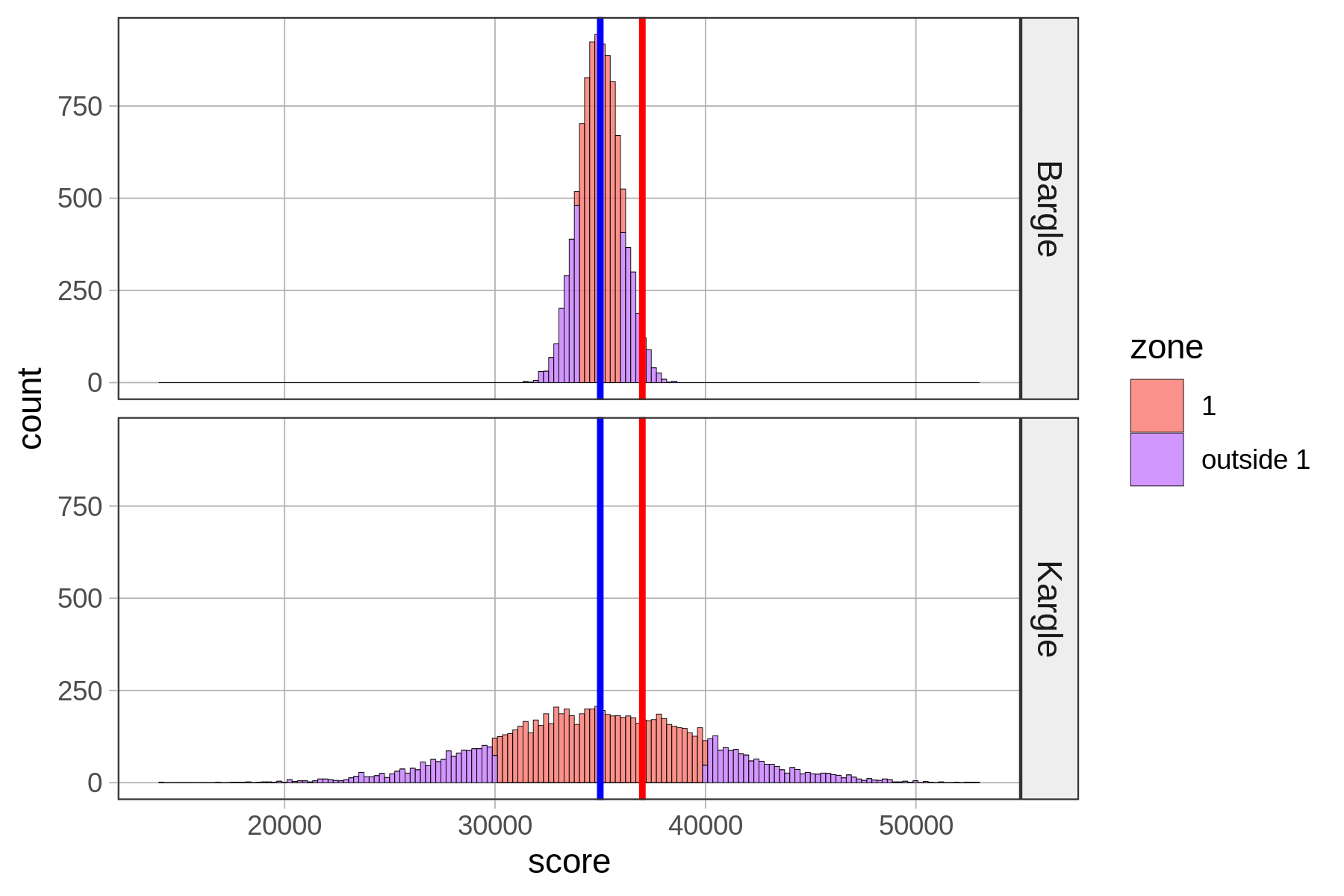

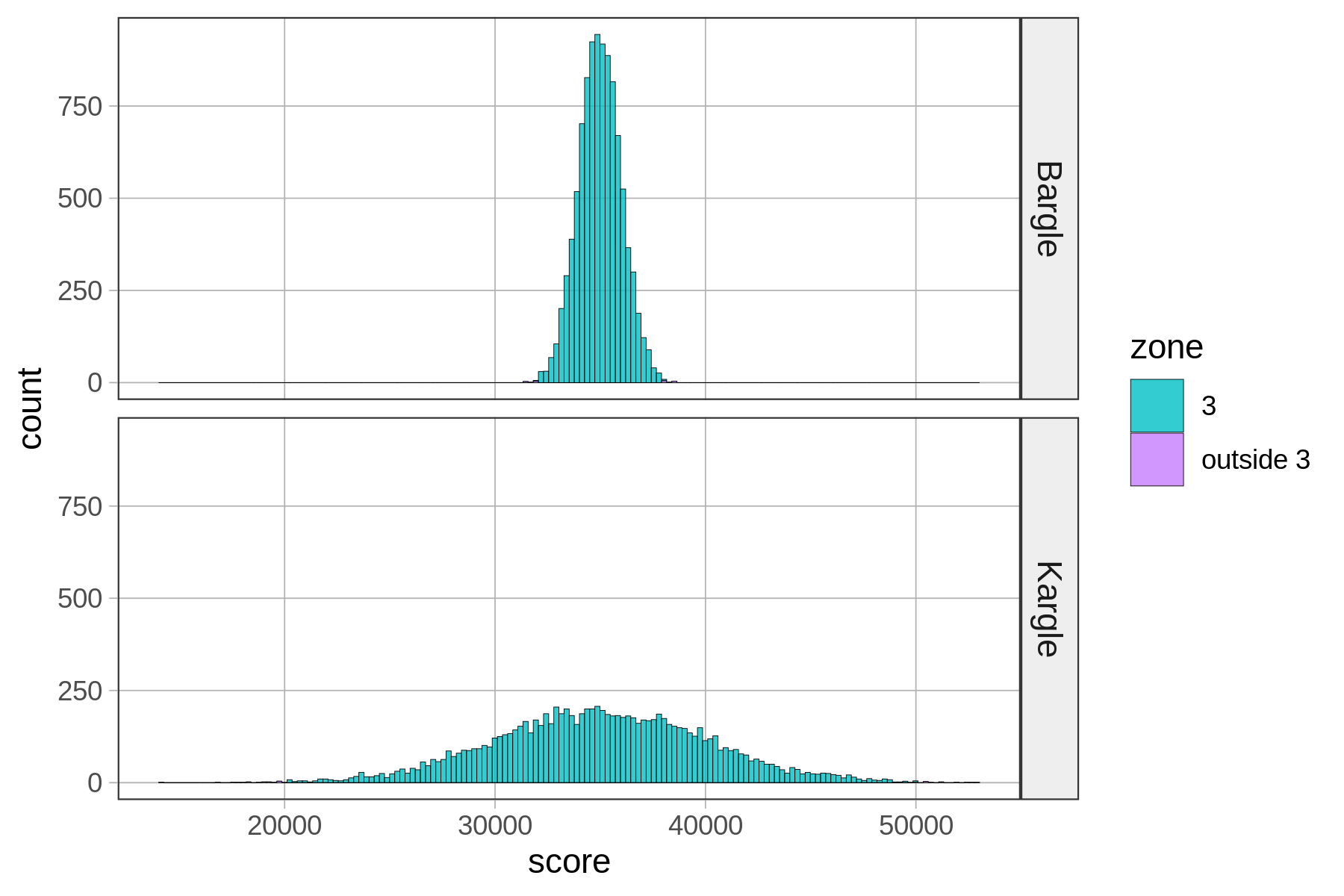

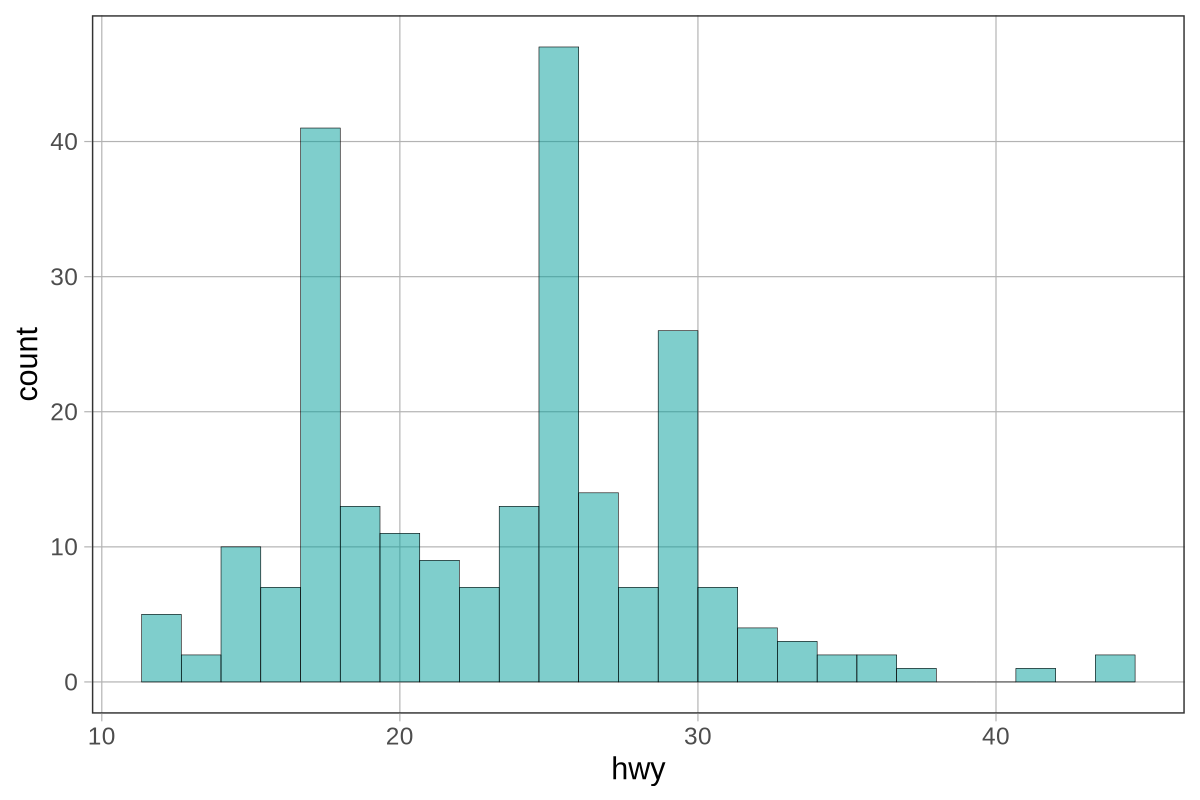

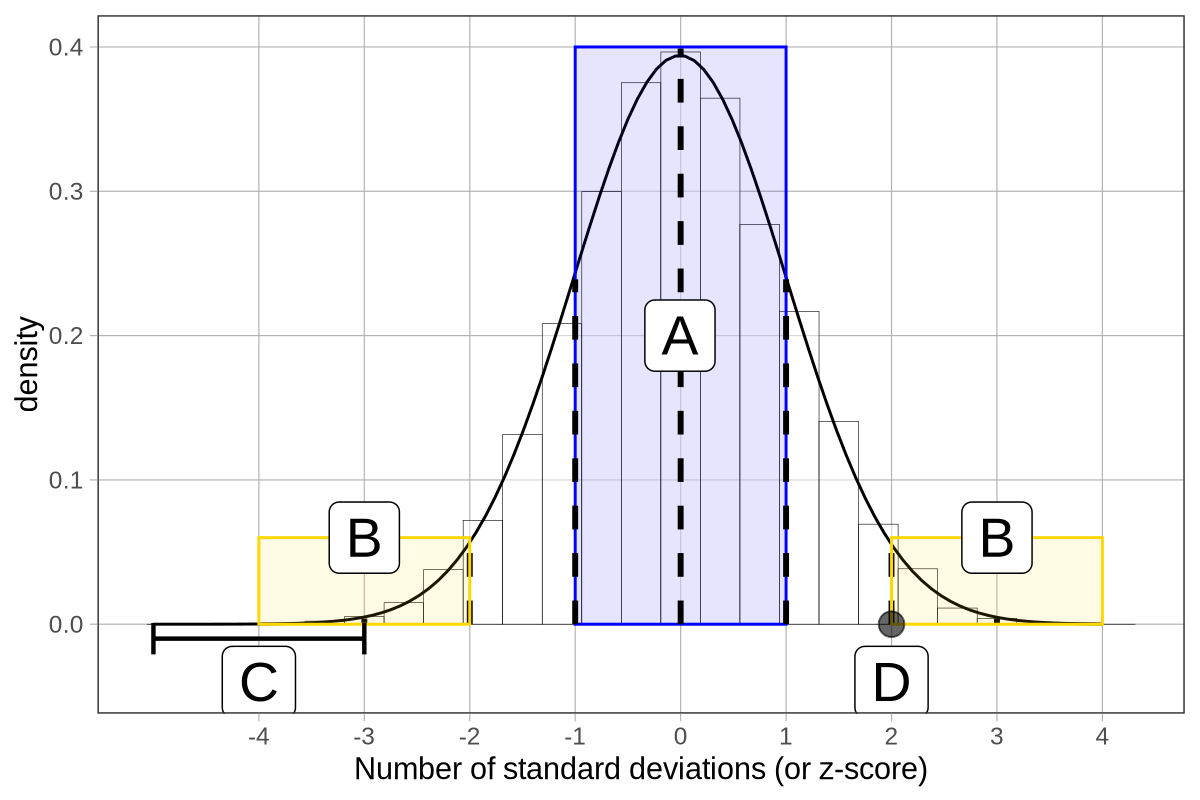

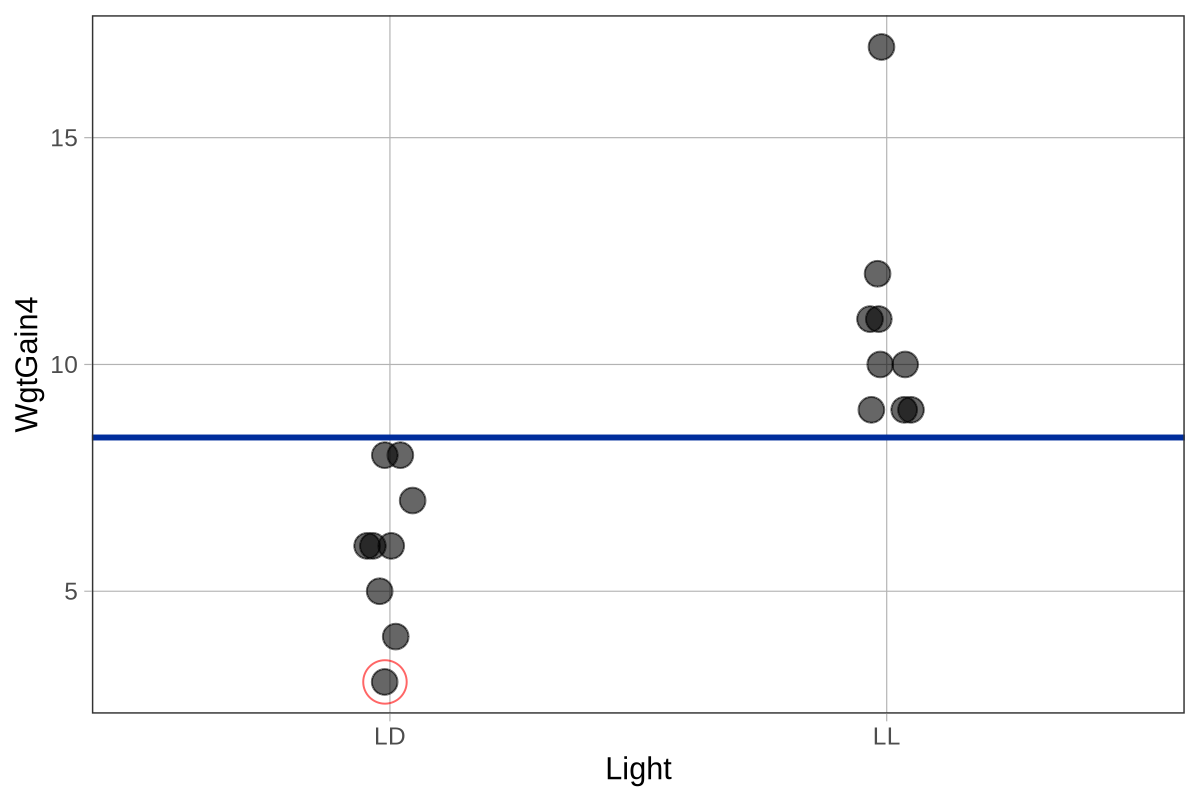

Ας υποθέσουμε ότι η κατανομή των σκορ στο Kargle αναπαρίσταται από ένα από τα παρακάτω ιστογράμματα. Και οι δύο κατανομές έχουν μέσο όρο 35.000 πόντους. Αλλά:

Κατανομή #1: Τυπική απόκλιση = 1.000 πόντοι

Κατανομή #2: Τυπική απόκλιση = 5.000 πόντοι

Αν η πραγματική κατανομή των πόντων στο Kargle ήταν αυτή που βρίσκεται στο πάνω μέρος, τι θα σκεφτόσασταν για το σκορ 37.000 πόντων του φίλου σας;

Τι θα γινόταν αν η πραγματική κατανομή των πόντων στο Kargle ήταν αυτή που βρίσκεται στο κάτω μέρος; Τώρα, τι θα σκεφτόσασταν για το σκορ 37.000 πόντων του φίλου σας;

Σε ποια από αυτές τις δύο κατανομές θα λέγατε ότι η βαθμολογία 37.000 είναι καλύτερη; Γιατί;

Σαφώς ο φίλος σας θα ήταν εξαιρετικός παίκτης αν η Κατανομή 1 ήταν η πραγματική. Αλλά αν ήταν η Κατανομή 2, το σκορ του θα βρισκόταν απλά λίγο πάνω πάνω από το μέσο όρο.

Μπορούμε να δούμε αυτό διαγραμματικά αν παρατηρήσουμε τα δύο ιστογράμματα. Αλλά υπάρχει κάποιος τρόπος να ποσοτικοποιήσουμε τη διαίσθησή μας; Ένας τρόπος είναι να μετασχηματίσουμε την τιμή που προσπαθούμε να ερμηνεύσουμε σε τιμή z με τον παρακάτω τύπο:

\[z = \frac{Y_i - \bar{Y}}{s}\]

Ποιος είναι ο αριθμητής στον παραπάνω τύπο;

Απόκλιση είναι η σωστή απάντηση.

Ανάλυση του τύπου υπολογισμού της τιμής z:

\[z_i = \frac{Y_i - \bar{Y}}{s}\]

Αριθμητής (Numerator): \(Y_i - \bar{Y}\)

Παρονομαστής (Denominator): \(s\)

Τι είναι ο αριθμητής:

\(Y_i - \bar{Y}\) = Απόκλιση

\(Y_i\) = η συγκεκριμένη παρατήρηση (π.χ. μήκος αντίχειρα της Σοφίας)

\(\bar{Y}\) = ο δειγματικός μέσος όρος

\(Y_i - \bar{Y}\) = η απόκλιση της παρατήρησης από το μέσο όρο

Γιατί οι άλλες επιλογές είναι λάθος:

Β - Άθροισμα τετραγώνων - ΛΑΘΟΣ:

SS = \(\sum(Y_i - \bar{Y})^2\) (άθροισμα τετραγώνων όλων των αποκλίσεων)

Ο αριθμητής είναι μία απόκλιση, όχι άθροισμα

Ο αριθμητής δεν είναι υψωμένος στο τετράγωνο

Γ - Δειγματικός μέσος όρος - ΛΑΘΟΣ:

Ο δειγματικός μέσος όρος (\(\bar{Y}\)) είναι μέρος του αριθμητή, όχι ο αριθμητής

Αριθμητής = \(Y_i - \bar{Y}\) (η διαφορά), όχι μόνο το \(\bar{Y}\)

Δ - Πληθυσμιακός μέσος όρος - ΛΑΘΟΣ:

Ο τύπος χρησιμοποιεί \(\bar{Y}\) (δειγματικό μέσο όρο), όχι \(\mu\) (πληθυσμιακό μέσο όρο)

Για την τιμή z του πληθυσμού: \(z = \frac{Y_i - \mu}{\sigma}\)

Εδώ έχουμε δειγματικό στατιστικό (s), όχι πληθυσμιακό (σ)

Ε - Δειγματική τυπική απόκλιση - ΛΑΘΟΣ:

Η τυπική απόκλιση (s) είναι ο παρονομαστής, όχι ο αριθμητής

Βρίσκεται κάτω από τη γραμμή κλάσματος

Ονοματολογία των μερών:

Y_i - Ȳ ← Αριθμητής (Numerator) = Απόκλιση

z_i = ─────────

s ← Παρονομαστής (Denominator) = Τυπική απόκλισηΛεπτομερής ανάλυση:

Τι μετράει ο αριθμητής:

Απόλυτη απόσταση από το μέσο όρο

Κατεύθυνση: θετική (πάνω από μέσο) ή αρνητική (κάτω από μέσο)

Μονάδες: ίδιες με την αρχική μεταβλητή (mm, kg), κλπ)

Τι μετράει ο παρονομαστής:

Τυπική κλίμακα της διασποράς

Δίνει πλαίσιο για το πόσο μεγάλη είναι η απόκλιση

Μονάδες: ίδιες με την αρχική μεταβλητή

Τι μετράει η τιμή z (ολόκληρο το κλάσμα):

Σχετική απόσταση σε τυπικές αποκλίσεις

Xωρίς μονάδες

Δείχνει πόσο ασυνήθιστη είναι η παρατήρηση

Ιδιότητες του αριθμητή (απόκλιση):

1. Μπορεί να είναι θετικός, αρνητικός, ή μηδέν:

Θετικός (+): \(Y_i > \bar{Y}\) (πάνω από μέσο)

Αρνητικός (-): \(Y_i < \bar{Y}\) (κάτω από μέσο)

Μηδέν (0): \(Y_i = \bar{Y}\) (ακριβώς στο μέσο)

2. Άθροισμα όλων των αποκλίσεων = 0:

\[\sum(Y_i - \bar{Y}) = 0\]

3. Διατηρεί μονάδες:

Αν Y σε mm, απόκλιση σε mm

Αν Y σε kg απόκλιση σε kg

Συμπέρασμα:

Ο αριθμητής στον τύπο της τιμής z:

\[z_i = \frac{Y_i - \bar{Y}}{s}\]

είναι το \(Y_i - \bar{Y}\), που ονομάζεται Απόκλιση.

Αυτό αντιπροσωπεύει την απόσταση της συγκεκριμένης παρατήρησης από το μέσο όρο του δείγματος, σε αρχικές μονάδες. Όταν διαιρεθεί με την τυπική απόκλιση (s), μετατρέπεται σε τυποποιημένη τιμή που δείχνει πόσες τυπικές αποκλίσεις μακριά από το μέσο βρίσκεται η παρατήρηση.

Και ποιος είναι ο παρονομαστής;

Δειγματική τυπική απόκλιση είναι η σωστή απάντηση.

Ανάλυση του τύπου:

\[z_i = \frac{Y_i - \bar{Y}}{s}\]

Αριθμητής: \(Y_i - \bar{Y}\) (απόκλιση)

Παρονομαστής: \(s\) (δειγματική τυπική απόκλιση)

Τι είναι το s:

\[s = \sqrt{\frac{\sum(Y_i - \bar{Y})^2}{n-1}}\]

s = δειγματική τυπική απόκλιση

Μετράει την τυπική διασπορά των δεδομένων γύρω από το μέσο

Είναι η κλίμακα με την οποία μετράμε τις αποκλίσεις

Γιατί οι άλλες επιλογές είναι λάθος:

Α - Απόκλιση - ΛΑΘΟΣ:

Η απόκλιση (\(Y_i - \bar{Y}\)) είναι ο αριθμητής, όχι ο παρονομαστής

Βρίσκεται πάνω από τη γραμμή κλάσματος

Β - Άθροισμα τετραγώνων - ΛΑΘΟΣ:

SS = \(\sum(Y_i - \bar{Y})^2\) δεν εμφανίζεται στον τύπο της τιμής z

Το SS χρησιμοποιείται για να υπολογίσουμε το s, αλλά δεν είναι ο παρονομαστής

Γ - Δειγματικός μέσος όρος - ΛΑΘΟΣ:

Ο δειγματικός μέσος όρος (\(\bar{Y}\)) είναι μέρος του αριθμητή, όχι ο παρονομαστής

Χρησιμοποιείται για να υπολογίσουμε την απόκλιση

Δ - Πληθυσμιακός μέσος όρος - ΛΑΘΟΣ:

Ο πληθυσμιακός μέσος όρος (\(\mu\)) δεν εμφανίζεται σε αυτόν τον τύπο

Αυτός ο τύπος χρησιμοποιεί δειγματικά στατιστικά (s και \(\bar{Y}\)), όχι παραμέτρους του πληθυσμού

Ρόλος του παρονομαστή:

Γιατί διαιρούμε με s:

-

Standardization (Τυποποίηση):

Μετατρέπει τις αποκλίσεις σε κοινή κλίμακα

Επιτρέπει σύγκριση μεταξύ διαφορετικών μεταβλητών

-

Σχετικό μέγεθος:

Μια απόκλιση 5mm είναι μεγάλη ή μικρή;

Αν s = 2mm: 5/2 = 2.5 SD (μεγάλη!)

Αν s = 10mm: 5/10 = 0.5 SD (μικρή)

-

Αποτέλεσμα χωρίς μονάδες μέτρησης:

- Η τιμή z δεν έχει μονάδες

Συμπέρασμα:

Ο παρονομαστής στον τύπο υπολογισμού της τιμής z:

\[z_i = \frac{Y_i - \bar{Y}}{s}\]

είναι η s (δειγματική τυπική απόκλιση).

Αυτό:

Τυποποιεί την απόκλιση σε κοινή κλίμακα

Δίνει πλαίσιο για το πόσο μεγάλη είναι η απόκλιση

Μετατρέπει το την τιμή z σε μέτρο χωρίς διαστάσεις

Επιτρέπει σύγκριση μεταξύ διαφορετικών μεταβλητών και κατανομών

Χωρίς τον παρονομαστή (s), θα είχαμε μόνο την απόκλιση, που δεν μας δείχνει αν είναι μεγάλη ή μικρή σε σχέση με τη συνολική διασπορά των δεδομένων.

Ας εφαρμόσουμε αυτόν τον τύπο στο σκορ των 37.000 πόντων με βάση καθεμία από τις δύο υποθετικές κατανομές (1 και 2).

Σας παρουσιάζουμε τον κώδικα τον υπολογισμό της τιμής z για την αρχική τιμή \(37.000\), εάν ισχύει η κατανομή 1. Γράψτε παρόμοιο κώδικα για τον υπολογισμό της τιμής z, εάν ισχύει η κατανομή 2.

Τι τιμές z λάβατε για τις δύο κατανομές;

Και στις δύο περιπτώσεις, ο αριθμητής είναι ο ίδιος: \(37.000\) (το ατομικό σκορ) μείον το μέσο όρο της κατανομής, που ισούται με \(2.000\). Οι παρονομαστές για τα δύο τιμές z είναι διαφορετικοί, επειδή οι κατανομές έχουν διαφορετικές τυπικές αποκλίσεις:

Κατανομή #1:

\(s = 1.000\)

\(z_1 = 2.000 / 1.000 = +2\)

Κατανομή #2:

\(s = 5.000\)

\(z_2 = 2.000 / 5.000 = +0.4\)

Να συγκρίνετε τις δύο τιμές z (+2 έναντι +0.4). Ποια επίδοση είναι πιο εντυπωσιακή, αυτή ενός παίκτη με σκορ z = +2 ή ένός παίκτη με σκορ z = +0.4; Γιατί;

Μια τιμή z ίση με +2 είναι πιο εντυπωσιακή—βρίσκεται δύο τυπικές αποκλίσεις πάνω από το μέσο όρο. Είναι σαφώς πιο δύσκολο κανείς να βρίσκεται δύο τυπικές αποκλίσεις πάνω από το μέσο όρο παρά να βρίσκεται 0.4 (ή λιγότερο από μισή) τυπική απόκλιση πάνω από το μέσο όρο.

7.6 Ερμηνεία και Χρήση των Τιμών z

Ποια είναι η διαφορά ανάμεσα σε μια τιμή z και στην τυπική απόκλιση;

Η τυπική απόκλιση (SD) είναι κατά προσέγγιση η μέση απόκλιση όλων των τιμών από το μέσο όρο. Μπορεί να θεωρηθεί ως δείκτης της διασποράς της κατανομής. Μια τιμή z χρησιμοποιεί την SD ως ένα είδος χάρακα για τη μέτρηση του πόσο μακριά βρίσκεται μια μεμονωμένη τιμή πάνω ή κάτω από το μέσο όρο.

Μια τιμή z δείχνει πόσες τυπικές αποκλίσεις απέχει μια τιμή από το μέσο όρο της κατανομής της, αλλά δεν δείχνει ποια είναι η τυπική απόκλιση (ούτε ποιος είναι ο μέσος όρος). Ένας άλλος τρόπος να σκέφτεστε την τιμή z είναι ως τη σύγκριση της απόκλισης μίας τιμής (ο αριθμητής) με την τυπική απόκλιση της κατανομής (ο παρονομαστής).

Ας χρησιμοποιήσουμε τιμές z για να κατανοήσουμε καλύτερα τα δεδομένα του μήκους αντίχειρα (Thumb). Υπολογίστε την τιμή z ενός αντίχειρα μήκους 65.1mm.

0.5725349Ποια είναι η σωστή ερμηνεία της τιμής z = +0.57;

Αυτός ο αντίχειρας έχει μήκος \(0.57\) τυπικές αποκλίσεις (λιγότερο από 1 τυπική απόκλιση) πάνω από το μέσο όρο είναι η σωστή απάντηση.

Τι σημαίνει \(z = 0.57\):

\[z = 0.57 = \frac{Y_i - \bar{Y}}{s}\]

Ερμηνεία:

Η παρατήρηση είναι \(0.57\) τυπικές αποκλίσεις πάνω από το μέσο όρο

Αυτό είναι λιγότερο από \(1\) τυπική απόκλιση (άρα σχετικά κοντά στο μέσο)

Η θετική τιμή z σημαίνει “πάνω από το μέσο”

Γιατί οι άλλες επιλογές είναι λάθος:

Α - “Μεγαλύτερος από \(0.57\) όλων των αντιχείρων” - ΛΑΘΟΣ:

Η τιμή z δεν δείχνει το εκατοστημόριο στο οποίο βρίσκεται η αρχική τιμή

Αν κατανομή είναι κανονική, για \(z = 0.57\), το εκατοστημόριο είναι περίπου 71.6% (όχι 57%)

Χρειάζεται μετατροπή μέσω κανονικής κατανομής

Β - “\(0.57\)m μήκος” - ΛΑΘΟΣ:

Η τιμή z δεν έχει μονάδες

Δεν μετράει μήκος, αλλά σχετική θέση

\(0.57\)m = 570mm (εξωφρενικά μεγάλος αντίχειρας!)

Γ - “Πιθανότητα \(0.57\) για μεγαλύτερο” - ΛΑΘΟΣ:

- Η τιμή z δεν είναι πιθανότητα

Δ - “\(0.57\)mm μεγαλύτερος” - ΛΑΘΟΣ:

Η τιμή z μετράει σε τυπικές αποκλίσεις, όχι σε mm

Η απόκλιση σε mm είναι: απόκλιση = \(z \times s\)

Διαγραμματική αναπαράσταση:

|←─ 1 SD ─→|←─ 1 SD ─→|

| | |

--------|-----------|----------|---------

μ-σ μ μ+σ

51.4 60.1 68.8

↑

z=0.57

(65.1mm)

Η Σοφία βρίσκεται στο $0.57$ του δρόμου από μέσο όρο ($60.1$) προς τη $1$ τυπική απόκλιση ($68.8$)Συμπέρασμα:

Το \(z = 0.57\) ερμηνεύεται ως:

“Ο αντίχειρας είναι \(0.57\) τυπικές αποκλίσεις πάνω από το μέσο όρο”

Αυτό σημαίνει:

Θετική τιμή z → πάνω από το μέσο

\(0.57\) τυπικές αποκλίσεις → λιγότερο από \(1\) τυπική απόκλιση

Ερμηνεία: Σχετικά κοντά στο μέσο όρο, όχι ασυνήθιστη τιμή

Η τιμή z είναι ένα μέτρο σχετικής θέσης χωρίς μονάδες που δείχνει πόσες τυπικές αποκλίσεις μακριά από το μέσο βρίσκεται μια παρατήρηση, όχι την απόλυτη απόσταση σε mm ή το εκατοστημόριο απευθείας.

Μια μεμονωμένη τιμή z δείχνει πόσες τυπικές αποκλίσεις απέχει αυτός ο συγκεκριμένος αντίχειρας των \(65.1\)mm από το μέσο όρο. Επειδή η τυπική απόκλιση είναι κατά προσέγγιση η μέση απόσταση όλων των τιμών από το μέσο όρο, είναι πιο πιθανό οι περισσότερες τιμές να συγκεντρώνονται μεταξύ μίας τυπικής απόκλισης πάνω από το μέσο όρο και μίας τυπικής απόκλισης κάτω από το μέσο όρο. Είναι λιγότερο πιθανό να συναντήσουμε τιμές που απέχουν δύο ή τρεις τυπικές αποκλίσεις από το μέσο όρο. Οι τιμές z μας επιτρέπουν να χαρακτηρίσουμε τις αρχικές τιμές με πιο λεπτομερή τρόπο από το να πούμε απλά ότι είναι «μεγαλύτερες» ή «μικρότερες» από το μέσο όρο.

Χρήση Τιμών z για Σύγκριση Τιμών από Διαφορετικές Κατανομές

Μια επιπλέον χρήση της τιμής z είναι για τη σύγκριση τιμών που προέρχονται από διαφορετικές κατανομές, ακόμα κι αν οι μεταβλητές μετρώνται σε διαφορετικές κλίμακες.

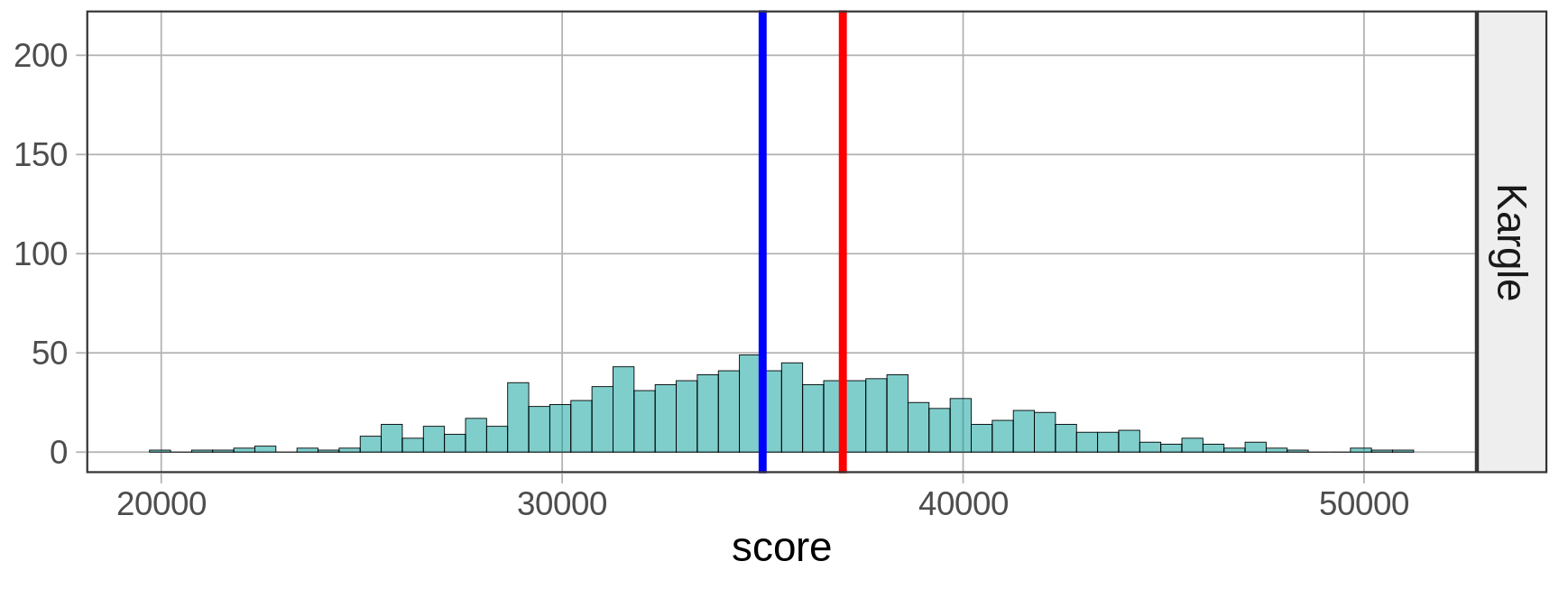

Ας δούμε ξανά την κατανομή των τιμών για όλους τους παίκτες του βιντεοπαιχνιδιού Kargle. Γνωρίζουμε ότι η κατανομή είναι κατά προσέγγιση κανονική, με μέσο όρο \(35.000\) και τυπική απόκλιση \(5.000\).

Μια φίλη σας συγκέντρωσε \(45.000\) πόντους στο παιχνίδι Kargle. Ποια είναι η αντίστοιχη τιμή z;

Η φίλη σας έχει συγκεντρώσει \(45.000\) πόντους. Η τιμή z είναι \(+2\). Εντυπωσιακό! Το σκορ της βρίσκεται δύο τυπικές αποκλίσεις πάνω από το μέσο όρο! Δεν υπάρχουν πολλά σκορ τόσο ψηλά.

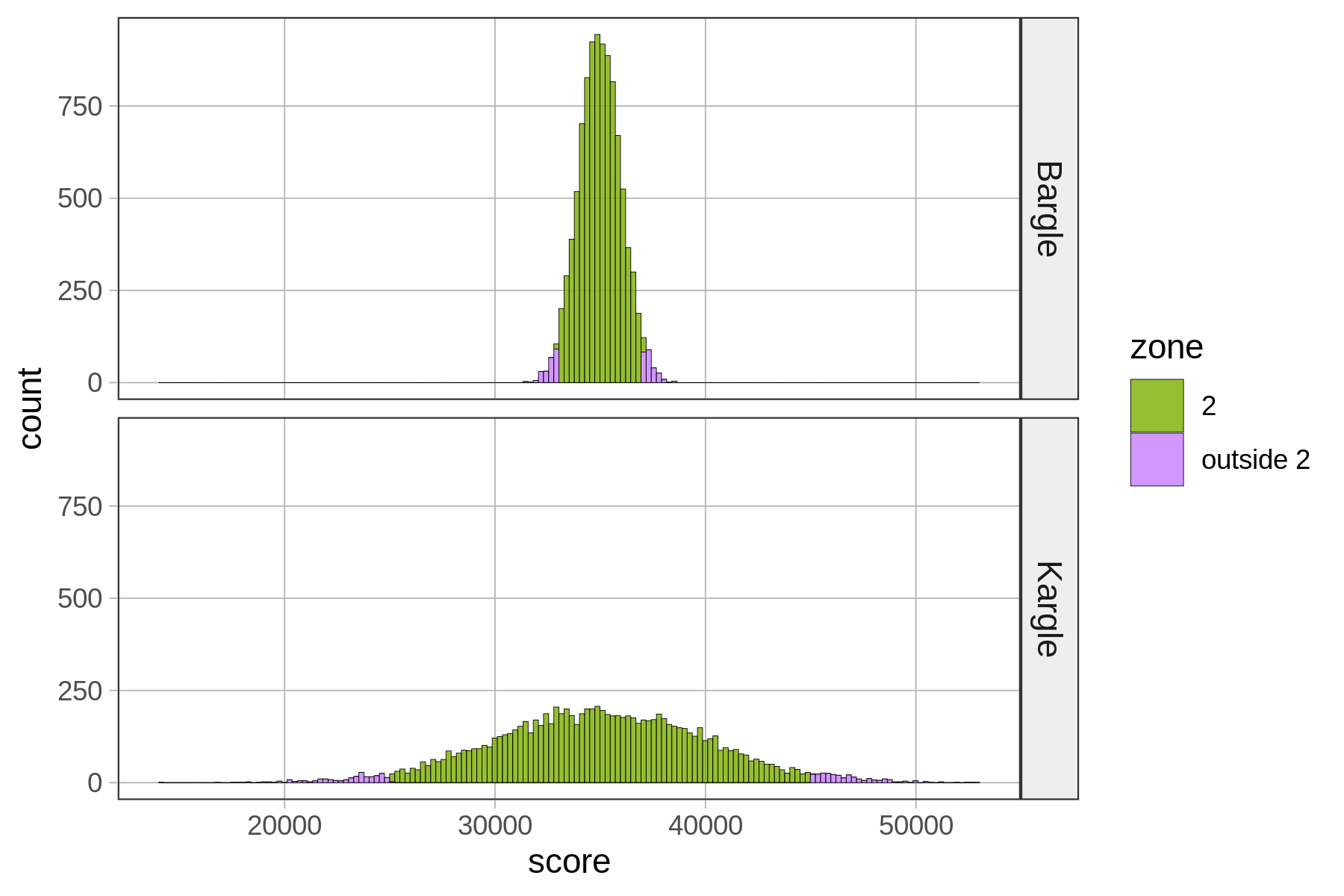

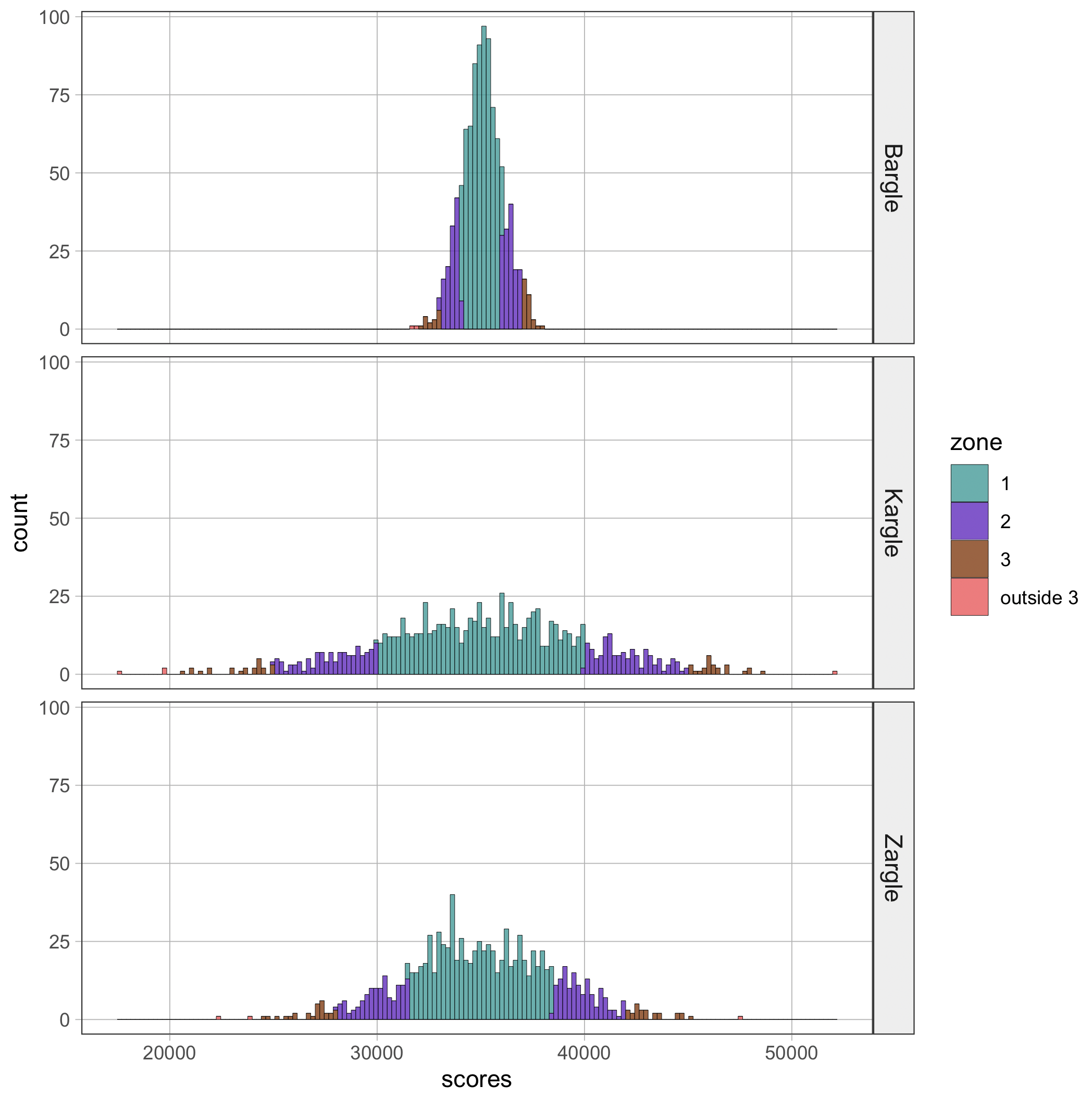

Ας υποθέσουμε ότι έχετε και μια άλλη φίλη που δεν παίζει καθόλου Kargle. Παίζει όμως ένα παρόμοιο παιχνίδι—το Bargle!

Το Bargle μπορεί να είναι παρόμοιο, αλλά έχει εντελώς διαφορετικό σύστημα βαθμολόγησης. Η κατανομή της βαθμολογίας του είναι κατά προσέγγιση κανονική, ο μέσος όρος είναι \(50\) και η τυπική απόκλιση είναι \(5\) πόντοι. Η φίλη σας έχει συγκεντρώσει \(65\) πόντους.

Ποια φίλη από τις δύο είναι καλύτερη gamer; Αυτή που παίζει Kargle ή αυτή που παίζει Bargle; Αυτή είναι μια δύσκολη ερώτηση και υπάρχουν πολλοί τρόποι για να την απαντήσουμε. Ο υπολογισμός των τιμών z είναι ένας από αυτούς.

Έχουμε συνοψίσει τις τιμές z για τις δύο φίλες σας στον παρακάτω πίνακα.

| Παιχνίδι | Σκορ Παίκτριας | Μέσος Όρος | Τυπική Απόκλιση | Τιμή z |

|---|---|---|---|---|

| Kargle | \(45.000\) | \(35.000\) | \(5.000\) | +2 |

| Bargle | \(65\) | \(50\) | \(5\) | +3 |

Η εξέταση των τιμών z μας βοηθά να συγκρίνουμε τις ικανότητες των δύο παικτριών, παρόλο που παίζουν παιχνίδια με διαφορετικά συστήματα βαθμολόγησης. Με βάση τις τιμές z, θα μπορούσαμε να πούμε ότι η παίκτρια του Bargle είναι καλύτερη, επειδή σκόραρε τρεις τυπικές αποκλίσεις πάνω από το μέσο όρο, σε σύγκριση με μόνο δύο τυπικές αποκλίσεις πάνω από το μέσο όρο για την παίκτρια του Kargle.

Με ποια έννοια είναι η παίκτρια του Bargle καλύτερη; Πώς αυτό αποτυπώνεται με την τιμή z;

Μπορείτε να σκεφτείτε έναν λόγο για τον οποίο, παρά την καλύτερη τιμή z, η παίκτρια του Bargle μπορεί τελικά να μην είναι καλύτερη gamer;

Φυσικά, τίποτα δεν είναι σίγουρο με αυτές τις συγκρίσεις. Κάποιος θα μπορούσε να υποστηρίξει ότι το Bargle είναι πολύ πιο εύκολο παιχνίδι, και έτσι οι περισσότεροι παίκτες του τείνουν να είναι αρχάριοι. Ίσως η παίκτρια του Kargle να είναι καλύτερη gamer από αυτήν του Bargle, επειδή παρόλο που η τιμή z της είναι μικρότερη, συγκρίνεται τελικά με πιο έμπειρους παίκτες!

7.7 Μοντελοποίηση του Σχήματος της Κατανομής του Σφάλματος

Είδαμε προηγουμένως ότι η ποσοτικοποίηση του σφάλματος δείχνει πόσο καλά προσαρμόζεται το μοντέλο μας στα δεδομένα. Όταν το μοντέλο μας είναι ο μέσος όρος, οι υπολογισμοί του Αθροίσματος Τετραγώνων (SS), της διακύμανσης και της τυπικής απόκλισης είναι χρήσιμοι επειδή όλα αυτά τα μέτρα ελαχιστοποιούνται στο μέσο όρο. Και η ελαχιστοποίηση του σφάλματος είναι η πρώτη μας προτεραιότητα. Όσο λιγότερο σφάλμα, τόσο περισσότερη μεταβλητότητα εξηγείται από το μοντέλο.

Η ποσοτικοποίηση του σφάλματος μας δίνει επίσης έναν τρόπο να εξετάσουμε τις αποκλίσεις υπό ένα διαφορετικό πρίσμα. Ανεξάρτητα από την κλίμακα μέτρησης μιας εξαρτημένης μεταβλητής, η τυπική απόκλιση είναι ένας βολικός τρόπος εκτίμησης του πόσο μακριά βρίσκονται συγκεκριμένες τιμές πάνω ή κάτω από το μέσο όρο—ειδικά όταν λαμβάνεται υπόψη στον υπολογισμό των τιμών z.

Αλλά όσο χρήσιμο κι αν είναι να ποσοτικοποιούμε την ποσότητα του σφάλματος που υπάρχει, είναι επίσης χρήσιμο να μοντελοποιούμε το σχήμα της κατανομής του σφάλματος—ειδικά αν θέλουμε να κάνουμε καλύτερες προβλέψεις για μελλοντικές, τυχαία επιλεγμένες παρατηρήσεις.

Αν και ο μέσος όρος είναι η καλύτερη σημειακή εκτίμηση του μέσου όρου της ΔΠΔ, και η καλύτερη πρόβλεψη μιας μελλοντικής παρατήρησης αν θα έπρεπε να επιλέξουμε ένα μόνο αριθμό, μπορούμε να κάνουμε ακόμα πιο ακριβείς προβλέψεις αν είμαστε διατεθειμένοι να κάνουμε κάποιες υποθέσεις για το σχήμα της κατανομής του σφάλματος στον πληθυσμό.